1.本发明属于目标识别领域,具体涉及一种基于深度学习的船舶目标识别检测方法。

背景技术:

2.目标识别是智能交通领域的一个重要课题,经济全球化的不断发展使海上运输需求迅猛上升,随着船只数量日益增长,海上航行的安全性备受人们关注。为了提高船舶航行的效率、可靠性和安全性,目前航运业正逐步向船舶自动驾驶、自动避障、自动进离码头的智能化、全自动化方向发展,使得智能船舶逐渐成为一个新的研究方向。

3.随着水上交通流量密度的增加,导航环境越来越复杂。船舶的目标识别能力直接关系到海上(江河)航行安全。在将卷积神经网络应用于船舶目标检测之前,传统的船舶目标检测算法主要包括区域选择、结合特征提取和背景纹理建模等。近年来,深度学习技术被广泛用于目标检测领域,这进一步提升了船舶实时目标识别检测能力。但在实际海上航行中往往伴随着多变的自然条件和复杂的活动场景,这使其在复杂海域中目标识别检测效果并不理想。比如,小目标集群、船只密集且类型复杂、海面大雾影响造成目标模糊等,这些问题使得检测海域具有较高的复杂性,很难准确区分、识别目标间的差异,对船舶目标识别检测能力有了更高的要求。

技术实现要素:

4.本发明的目的在于克服上述现有技术中存在的不足,提出一种基于深度学习的船舶目标识别检测方法,在复杂海域中提高小目标检测能力和多目标分类效果。

5.为实现上述发明目的,本发明提供一种基于深度学习的船舶目标识别检测方法,包括如下步骤:(1)采集船舶航行水域的图像样本;(2)对图像进行预处理及标注;(3)进行数据增强,制作用于训练的数据集;(4)基于yolov4网络构建深度学习网络模型;(5)使用预训练的参数作为初始权重,训练深度学习网络;(6)将处理后的待检测图片输入骨干网络进行特征提取,经过颈部网络进行特征融合,并进行非极大值抑制操作,完成对船舶目标的预测;(7)进行输出后处理,使用置信度阈值进行结果过滤,结合其他指标判断得到最优的检测结果。

6.进一步地,所述步骤(2)中,对采集的图像使用labelimage进行至少以下五种海面目标的标注:散货船、集装箱船、渔船、游轮、岛屿。

7.进一步地,所述步骤(3)中,使用mosaic数据增强的方法制作用于训练的数据集,采用4张图片一组,随机缩放、随机裁剪、随机排布的方式进行拼接,得到新的4张图像,使其输入总数不变,并对得到的新的图像采取随机遮挡。

8.进一步地,所述步骤(4)中,所述深度学习网络模型包括骨干特征提取网络、spp结构、panet多路径特征融合结构和head检测头结构;所述骨干特征提取网络使用尺寸为640*640的rgb图像作为输入,经过卷积、batchnormalization和mish激活函数后,再通过尺寸分

别为(320,320,64),(160,160,128),(80,80,256),(40,40,512),(20,20,1024)的残差块结构;进行特征提取后,最后一个残差块的输出经过spp结构,拼接后将经过csp与cbl结构的结果与主干网络倒数第二和倒数第三个残差块的输出结果一起作为panet结构的输入;所述panet结构,进行一系列的上采样、下采样和卷积操作,并将三个输入进行多路径特征融合处理,然后输入head;所述head将输出解码前船舶的目标坐标信息,包括目标框横坐标x、目标框纵坐标y、目标框宽w及目标框高h,分类置信度和目标有无置信度。

9.进一步地,所述步骤(5)中,引入自适应锚框计算模块,在训练的过程中自动计算锚框,网络在初始锚框的基础上输出预测框,进而和真实框进行比对,计算两者差距,再反向更新,迭代网络参数。

10.进一步地,步骤(6)中所述骨干网络为darknet-53,在darknet-53中将特征注意模块fa嵌入调整后的残差结构中,对特征通道关系中的特征权重进行重新分配,在全局平均池化前加入1

×

1和3

×

3的卷积,实现跨通道信息集成,增强船舶图像的空间连通能力;然后,通过全局平均池化,将特征图的全局空间信息转化为一维向量求和,得到特征图的全局信息。

11.进一步地,所述全局平均池化公式如下:

[0012][0013]

其中,gc为特征图全局平均池化后的向量和,h和w为输入特征图的宽度和高度,uc(i,j)为第c通道uc在(i,j)处的值。

[0014]

进一步地,所述步骤(6)中,对mosaic数据增强后的图像自适应添加最少的黑边,进行标准化处理,缩放到640*640大小,并转换为rgb图片;标准化的图片输入到训练好的网络中,得到head的输出;head的输出将包括三个特征层,每个特征层分别划分20*20,40*40和80*80个网格,每个格点将对应三个anchor,每个anchor在其对应的网格点内进行中心偏移和长宽放缩;对于解码,首先将预测结果根据对应anchor的原始尺寸进行比例放缩,然后根据网格划分与anchor中心的偏移量计算出预测框相对于标准化输入图的长宽和位置,最后根据标准化处理时所加入的灰色边框过滤掉多余的预测;解码后,将进行非极大值抑制操作,直接选择置信度最高的一个目标作为输出。

[0015]

进一步地,所述步骤(7)中,对步骤(6)的输出先进行输出区域阈值过滤,防止网络在没有船舶目标时给出预测,减少误检;然后使用置信度阈值进行最后的结果过滤,即置信度大于阈值的船舶目标被输出作为最终预测。

[0016]

进一步地,所述输出区域阈值包括宽度方向阈值和高度方向阈值两个部分,其中所述宽度方向阈值为船舶目标的中心坐标距所在图片边界的距离,所述高度方向阈值为整张图片宽和高的比值。

[0017]

进一步地,步骤(7)中所述其他指标包括目标边界框、定位置信度、所有类别概率图,定位置信度大于阈值的船舶目标被输出作为预测结果;目标边界框与预测边界框偏移量小于一定值、所有类别概率图中概率大的为所检测目标。

[0018]

与现有技术相比,本发明的有益效果为:

[0019]

1、对yolov4进行改进得到深度学习网络模型ship-yolov4,针对训练数据不足的

问题,在输入端进行mosaic数据增强、自适应图片缩放优化、k-means聚类算法自适应锚框,提高框架的泛化能力,避免了过拟合的发生。

[0020]

2、基于注意力机制构建特征注意模块,嵌入到darknet-53中进行特征重新校准,提高了模型在复杂环境下的特征提取能力。

[0021]

3、针对特征融合过程中底层特征语义信息不足、网络过深导致特征消失的问题,优化panet多路径特征融合结构,融合多层次特征信息,以增强网络层的接受域和特征提取网络的关联度,提高在复杂海域中小目标检测能力和多目标分类效果。实验在自定义数据集中进行,充分验证了该方法在船舶目标识别检测中的优越性。

附图说明

[0022]

图1为本发明一个实施例的算法架构图;

[0023]

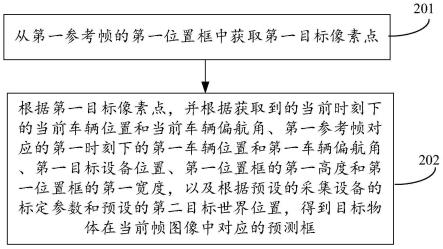

图2为本发明一个实施例的流程图;

[0024]

图3为本发明一个实施例的数据集分析结果图;

[0025]

图4为本发明一个实施例的数据增强实现流程图;

[0026]

图5为本发明一个实施例的网络结构图;

[0027]

图6为本发明一个实施例的优化panet结构图;

[0028]

图7为本发明一个实施例的网络训练效果图;

[0029]

图8为本发明一个实施例的检测效果图。

具体实施方式

[0030]

下面结合附图和具体实施例,对本发明的技术方案做进一步说明。

[0031]

如图1-图8所示,本发明基于深度学习的船舶目标识别检测方法的一个实施例,包括如下步骤:(1)采集船舶航行水域的图像样本;(2)对图像进行预处理及标注;(3)进行数据增强,制作用于训练的数据集;(4)基于yolov4网络构建深度学习网络模型;(5)使用预训练的参数作为初始权重,训练深度学习网络;(6)将处理后的待检测图片输入骨干网络进行特征提取,经过颈部网络进行特征融合,并进行非极大值抑制操作,完成对船舶目标的预测;(7)进行输出后处理,使用置信度阈值进行结果过滤,结合其他指标判断得到最优的检测结果。

[0032]

如图1所示,采用单阶段的检测识别算法架构,主要由特征提取、特征融合和检测分类等部分组成,其中特征提取基于注意力机制构建特征注意模块,得到的特征信息经过优化的panet多路径特征融合结构完成特征融合,最后将图像特征传递到检测分类器,对图像特征进行预测,判断边界框位置和框内船舶类别。

[0033]

如图2所示,可分为七个步骤:图像采集、图像标注、数据增强、模型构建、网络训练、网络预测和输出后处理。

[0034]

在一个实施例中,所述步骤(2)中,对采集的图像使用labelimage进行至少以下五种海面目标的标注:散货船、集装箱船、渔船、游轮、岛屿。具体地,将得到的船舶目标图像样本每一幅图像样本添加数值标签,标注格式为coco格式,如,不含船舶目标的图像添加数值“0”、含邮轮的图像添加数值“1”、含集装箱船的图像添加数值“2”、含散货船的图像添加数值“3”、含渔船的图像添加数值“4”、含岛礁的图像添加数值“5”。正确的标注内容才能保证

训练的模型在实际运行中具有良好的效果。标准完的数据包含五种海面目标:散货船、集装箱船、渔船、游轮、岛屿。数据分析结果如图3所示。

[0035]

在一个实施例中,所述步骤(3)中,使用mosaic数据增强的方法制作用于训练的数据集,采用4张图片一组,随机缩放、随机裁剪、随机排布的方式进行拼接,得到新的4张图像,使其输入总数不变,并对得到的新的图像采取随机遮挡,大大丰富了检测数据集,特别是随机缩放增加了很多小目标,让网络的鲁棒性更好。但是mosaic数据增强的引入会导致目标变小,导致模型的泛化能力变差,因此这里将mosaic数据增强的图片数选定为4。基于收集的图像信息,使用mosaic数据增强的方法制作用于训练的数据集,其实现过程如图4所示,大大丰富了数据集,特别是随机缩放增加了很多小目标,让网络的鲁棒性更好。使得单次迭代输入的图片大小并不需要很大,对单gpu训练更加友好。在生成的数据集中训练集占80%,测试集占20%。

[0036]

在一个实施例中,所述步骤(4)中,所述深度学习网络模型包括骨干特征提取网络、spp结构、panet多路径特征融合结构和head检测头结构;所述骨干特征提取网络使用尺寸为640*640的rgb图像作为输入,经过卷积、batch normalization和mish激活函数后,再通过尺寸分别为(320,320,64),(160,160,128),(80,80,256),(40,40,512),(20,20,1024)的残差块结构;进行特征提取后,最后一个残差块的输出经过spp结构,拼接后将经过csp与cbl结构的结果与主干网络倒数第二和倒数第三个残差块的输出结果一起作为panet结构的输入;所述panet结构,进行一系列的上采样、下采样和卷积操作,并将三个输入进行多路径特征融合处理,然后输入head;所述head将输出解码前船舶的目标坐标信息,包括目标框横坐标x、目标框纵坐标y、目标框宽w及目标框高h,分类置信度和目标有无置信度。

[0037]

本实施例中,参考yolov4网络结构,改进输入端、骨干网络结构、颈部网络结构和输出端,构建船舶目标识别检测所用的深度学习网络模型ship-yolov4,网络结构如图5所示,可分为三大部分:backone为引入特征注意模块fa的特征提取网络cspdarknet53,neck由spp与优化后的panet多路径特征融合结构构成,head为检测结构。特征提取网络使用尺寸为640*640的rgb图像作为输入,经过卷积、batch normalization和mish激活函数后,再通过尺寸分别为(320,320,64),(160,160,128),(80,80,256),(40,40,512),(20,20,1024)的残差块结构;进行特征提取后,最后一个残差块的输出经过spp结构,拼接后将经过csp与cbl结构的结果与主干网络倒数第二和倒数第三个残差块的输出结果一起作为panet结构的输入。

[0038]

panet结构如图6所示,(a)和(b)部分是自顶向下的网络结构,通过横向连接进行特征融合,(c)部分是自底向上的网络结构,保持横向连接同时聚合低层特征。每一个顶层特征都通过融合三个不同路径特征产生,通过图6这种方式将低层次特征、中间特征与顶层特征相互融合。特征上传过程中给出每层特征的预测结果,然后输入head。head将输出解码前的船舶目标x,y,w,h坐标信息,分类置信度和目标有无置信度。

[0039]

在一个实施例中,所述步骤(5)中,引入自适应锚框计算模块,在训练的过程中自动计算锚框,网络在初始锚框的基础上输出预测框,进而和真实框进行比对,计算两者差距,再反向更新,迭代网络参数。网络训练时,使用预训练的参数作为初始权重,预训练权重文件为yolov4.conv.137,训练深度学习网络使用如下的训练参数:学习率0.001、batch为64、subdivisions为16,训练集验证集相对于数据集的划分比例为0.9和0.1。网络训练策略

是首先使用预训练的参数作为初始权重,然后冻结backbone部分的权重,对剩余部分进行50个epoch的训练,最后解冻所有权重,进行50个epoch的训练。训练设备使用2张nvidia rtx 2080ti型号gpu,训练时间约16小时。训练结果当epoch为100时,验证集loss为3.1534。训练效果如图7所示。训练过程中map值越来越大,loss值越来越小。

[0040]

在一个实施例中,步骤(6)中所述骨干网络为darknet-53,在darknet-53中将特征注意模块fa嵌入调整后的残差结构中,对特征通道关系中的特征权重进行重新分配,在全局平均池化前加入1

×

1和3

×

3的卷积,实现跨通道信息集成,增强船舶图像的空间连通能力;然后,通过全局平均池化,将特征图的全局空间信息转化为一维向量求和,得到特征图的全局信息。

[0041]

在一个实施例中,所述全局平均池化公式如下:

[0042][0043]

其中,gc为特征图全局平均池化后的向量和,h和w为输入特征图的宽度和高度,uc(i,j)为第c通道uc在(i,j)处的值。

[0044]

spp最大值池化应用于大小为5

×

5、9

×

9、13

×

13的卷积核,空间维度被保留。将来自不同内核大小的feature map连接在一起作为输出。比单纯的使用k

×

k最大池化的方式,更有效的增加主干特征的接收范围,显著的分离了最重要的上下文特征。

[0045]

cbl作为panet多路径特征融合结构中的基本组件,其由普通卷积层conv 归一化层bn 激活函数层silu三者组成。

[0046]

silu函数是sigmoid函数的一种变体,其函数形式为:

[0047]

silu(x)=x*sigmoid(x)

[0048][0049]

concat将两个张量拼接,会扩充两个张量的维度。

[0050]

csp结构用普通的cbl替换resunit,应用于neck中。backbone为较深的网络,增加残差结构可以增强层与层之间反向传播的梯度值,避免因为加深而带来的梯度消失,从而提取到更细粒度的特征而不必担心网络退化。

[0051]

在一个实施例中,所述步骤(6)中,对mosaic数据增强后的图像自适应添加最少的黑边,进行标准化处理,缩放到640*640大小,并转换为rgb图片;标准化的图片输入到训练好的网络中,得到head的输出;head的输出将包括三个特征层,每个特征层分别划分20*20,40*40和80*80个网格,每个格点将对应三个anchor,每个anchor在其对应的网格点内进行中心偏移和长宽放缩;对于解码,首先将预测结果根据对应anchor的原始尺寸进行比例放缩,然后根据网格划分与anchor中心的偏移量计算出预测框相对于标准化输入图的长宽和位置,最后根据标准化处理时所加入的灰色边框过滤掉多余的预测;解码后,将进行非极大值抑制操作,直接选择置信度最高的一个目标作为输出,提升检测速度。

[0052]

在一个实施例中,所述步骤(7)中,对步骤(6)的输出先进行输出区域阈值过滤,防止网络在没有船舶目标时给出预测,减少误检;然后使用置信度阈值进行最后的结果过滤,即置信度大于阈值的船舶目标被输出作为最终预测。

[0053]

在一个实施例中,所述输出区域阈值包括宽度方向阈值和高度方向阈值两个部分,其中所述宽度方向阈值为船舶目标的中心坐标距所在图片边界的距离,所述高度方向阈值为整张图片宽和高的比值。

[0054]

在一个实施例中,步骤(7)中所述其他指标包括目标边界框、定位置信度、所有类别概率图,定位置信度大于阈值的船舶目标被输出作为预测结果;目标边界框与预测边界框偏移量小于一定值、所有类别概率图中概率大的为所检测目标。

[0055]

本发明的实施例中,ship-yolov4不需要提前生成感兴趣区域,可以直接以一种回归的方式训练网络。利用k-means算法对训练样本的边界框进行聚类,按3个尺度大小预置3组预定义边界框,并基于这9个边界框进行后续的定位预测。首先,通过特征提取网络对原始640

×

640输入图像进行特征提取,然后将特征向量输入到spp与panet结构中,生成3个网格区域,分别为20

×

20、40

×

40和80

×

80。每个网格区域预测三个边界框。共生成(80

×

80 40

×

40 20

×

20

×

3=25200个边界框。在每个边界中预测一个向量n,向量n的组合如下式所示:

[0056]

n=(t

x

ty tw th) n0 (n1 n2

…

nn)

[0057]

t

x

、ty表示边界框的横纵坐标,tw、th表示边界框的宽高。n0…

nn表示预测框中对象的概率值。

[0058]

最终预测结果边界框的中心到特征图左上角的距离计算公式、预测边界框的长度和宽度计算公式如下所示:

[0059]bx

=δ(t

x

) cx

[0060]by

=δ(ty) cy

[0061]bw

=pw×etw

[0062]bh

=ph×eth

[0063]

δ表示sigmoid函数,c

x

和cy表示边界框所属网格相对于图片左上角的偏移量,ph和pw表示预定义边界框的长度和宽度,b

x

和by表示最终预测结果边界框的中心到图片左上角的距离,bh和bw表示预测边界框的长度和宽度。

[0064]

训练中采用ciou_loss作为目标bounding box的损失,考虑预测框和目标框的长宽比,ciou_loss公式为:

[0065][0066]

α是权横参数,定义为:

[0067][0068]

v是用来度量长宽比的相似性,定义为:

[0069][0070]

ciou_loss优化时v对于w和h的偏导需要被明确,即:

[0071][0072][0073]

w、h在[0,1]情况下,w2 h2的值通常很小,可能会导致梯度爆炸,为避免该问题,在实现时将其替换成1。

[0074]

综上,ciou_loss将目标框回归函数三个重要几何因素:重叠面积、中心点距离、长宽比全都包括。

[0075]

如图8所示,本发明实施例的方法可以识别出散货船、集装箱船、渔船、游轮、岛屿目标信息,性能与识别精度比yolov4有了明显的提高。

[0076]

最后应当说明的是:以上实施例仅用以说明本发明的技术方案而非对其限制,尽管参照上述实施例对本发明进行了详细的说明,所属领域的普通技术人员应当理解:依然可以对本发明的具体实施方式进行修改或者等同替换,而未脱离本发明精神和范围的任何修改或者等同替换,其均应涵盖在本发明的权利要求保护范围之内。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。