技术特征:

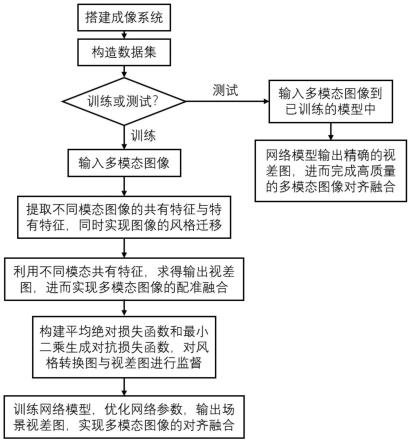

1.基于视差估计的多模态图像配准方法,其特征在于,该方法包括以下步骤:步骤1,同时采集不同波段的红外图像和可见光图像,并进行图像的畸变矫正与立体矫正,得到红外-可见光的多模态立体图像对;步骤2,构建数据集,包括训练集和测试集;所述数据集中包括步骤1得到的多模态立体图像对以及利用生成对抗网络得到的多模态立体图像对;步骤3,将训练集中的多模态立体图像对数据输入神经网络,所述神经网络包括特征提取编码器、风格迁移解码器、立体匹配子网络以及对齐融合模块;对于红外-可见光的两种不同模态的输入图像,所述神经网络采用双支路策略,通过特征提取编码器对不同模态图像分别提取其对应的共有特征与特有特征,然后将跨模态的不同特征交叉送入所述风格迁移解码器,完成图像的风格迁移;步骤4,将步骤3所得的不同模态图像的共有特征送入所述立体匹配子网络,其包括通道注意力增强模块、匹配代价构建模块、代价聚合模块以及视差回归模块;所述通道注意力增强模块先对不同模态图像的共有特征进行特征增强,然后所述匹配代价构建模块根据增强后的特征构建基于视差的匹配代价,再通过所述代价聚合模块进行匹配代价的正则化,最终通过视差回归模块得到输出视差图;步骤5,利用步骤4所求得的视差图,通过所述对齐融合模块,采用单应性扭曲方法将不同模态和不同视角的图像对齐到同一视角,实现多模态图像的配准融合;步骤6,构建所述神经网络的损失函数,该损失函数包括平均绝对损失函数与最小二乘生成对抗损失函数;对所述神经网络进行训练;步骤7,在测试阶段,将测试集中的多模态立体图像对数据输入到已训练的神经网络中,得到配准融合后的多模态图像。2.根据权利要求1所述的基于视差估计的多模态图像配准方法,其特征在于,所述步骤2中,利用生成对抗网络得到多模态立体图像对的具体步骤为:先使用生成对抗网络在已有多模态配对数据集上进行网络模型预训练,实现可见光图像到红外图像的风格转换;然后将训练好的网络模型在已有可见光图像的立体数据集上进行风格转换,生成所需要的多模态立体图像对。3.根据权利要求1所述的基于视差估计的多模态图像配准方法,其特征在于,所述步骤3中,特征提取编码器分为共有特征提取编码器与特有特征提取编码器,其中所述共有特征提取编码器使用基本残差块提取可靠特征,进行下采样后,得到输入图像的共有特征;所述特有特征提取编码器在浅层网络使用大卷积核以及最大池化操作进行下采样,在深层网络处使用步长为2的卷积进行下采样,得到不同尺度的特征,提取输入图像的风格特征。4.根据权利要求3所述的基于视差估计的多模态图像配准方法,其特征在于,所述步骤3中,在图像输入到所述特有特征提取编码器进行风格特征提取前,先使用模糊操作,破坏图像的结构信息,得到抽象的风格特征,避免错误结构信息的干扰。5.根据权利要求4所述的基于视差估计的多模态图像配准方法,其特征在于,所述模糊操作为:设定一个固定窗口大小的随机块在图像上进行滑动,每次滑动后都将随机块内所有像素随机打乱顺序,遍历整张图像;然后对随机块打乱后的图像进行均值滤波,去除噪点,得到结构模糊图像。6.根据权利要求1所述的基于视差估计的多模态图像配准方法,其特征在于,所述步骤

3中,风格迁移解码器接收来自特征提取编码器的共有特征与不同尺度的深层特有特征,使用反卷积进行上采样操作;所述风格迁移解码器在深层网络使用不同尺度的特有特征,以类u-net型网络结构不断进行特征连接与融合,并在浅层网络连接共有特征,通过不断地上采样-特征连接-特征融合操作,得到风格迁移后的生成图像。7.根据权利要求1所述的基于视差估计的多模态图像配准方法,其特征在于,所述步骤3中,所述风格迁移解码器在解码过程中进行两次解码,第一次是域内解码,使用相同模态的共有特征和特有特征,实现模态内原图像重建;第二次是跨域解码,使用不同模态的共有特征与特有特征,完成跨模态交叉风格转换,保证不同的特征具备其对应的模态性质,同时实现图像的风格迁移。8.根据权利要求1所述的基于视差估计的多模态图像配准方法,其特征在于,所述步骤3中,所述步骤4中,通道注意力增强模块对输入的不同模态图像的共有特征进行增强,将共有特征中对应接近的通道给予高权重,相差较大的通道给予低权重,提升不同模态共有特征的匹配度。9.根据权利要求1所述的基于视差估计的多模态图像配准方法,其特征在于,所述步骤6中,对所述神经网络进行训练的具体步骤为:步骤61,在不使用所述立体匹配子网络的情况下,仅仅使用所述特征编码器与所述风格迁移解码器完成图像风格转换任务,训练神经网络并使之收敛,从而可以得到匹配度较高的不同模态共有特征;步骤62,训练所述立体匹配子网络,此时将神经网络其他部分进行冻结,网络参数固定不变化;利用所述特征提取编码器提取的不同模态的共有特征,进行立体匹配,通过视差回归求出场景视差图;步骤63,将整个神经网络联合起来进行训练,使用平均绝对损失函数与最小二乘生成对抗损失函数进行监督,将网络模型中风格迁移部分与立体匹配部分联合训练,使网络进一步收敛,达到更精确的视差估计结果,实现更优的多模态图像对齐与融合效果。

技术总结

本发明公开了一种基于视差估计的多模态图像配准方法。具体步骤为:(1)搭建阵列成像系统;(2)构造数据集;(3)将图像输入神经网络,采用双支路策略,提取共有特征与特有特征;(4)利用通道注意力增强模块进行特征增强,构建基于视差的匹配代价,通过视差回归得到视差图;(5)利用所求得视差图,通过单应性扭曲进行图像对齐,实现多模态图像的配准融合;(6)构建损失函数,包括平均绝对损失函数和最小二乘生成对抗损失函数;(7)将测试集的图像输入神经网络,得到风格生成图、预测视差图和对齐融合后的多模态图。本发明的方法可以通过不同视角的多模态图像得到视差图,进而求得配准融合后的多模态图像。图像。图像。

技术研发人员:岳涛 李娜 黄志聪 胡雪梅

受保护的技术使用者:南京大学

技术研发日:2022.07.14

技术公布日:2022/12/12

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。