1.本发明属于计算机视觉技术领域,特别涉及一种基于语义注意力机制的零样本语义分割方法。

背景技术:

2.深度学习技术的飞速发展推动了计算机视觉领域的快速发展。其中以低层次的去噪、去模糊和去伪与高层次的物品分类、物体检测和物体语义分割等为主的计算机视觉任务的效果提升最为明显。其中,语义分割作为计算机视觉任务中一个有着广泛应用的基础任务,更是受到了科研界和工业界的广泛重视。虽然基于深度学习的语义分割方法在各大数据集上的效果都不错,得到了前所未有的实验结果,但是这些传统的语义分割方法需要大量的逐像素点标注的标注数据的支撑才能得到这样的结果。同时这些方法只能对在训练阶段提供了标注的类别进行语义分割,当其处理未见类的时候则无能为力,缺乏泛化能力和通用性。

3.为了解决基于深度学习的传统语义分割的上述问题,提出了零样本语义分割任务。零样本语义分割任务旨在通过少量类别的标注数据实现对更多类别的图片的进行语义分割。该任务不仅解决了减少标记的训练数据的需求,同时还提升了语义分割模型的泛化能力,使其具有语义分割未见类的能力。

4.当前零样本语义分割任务基本的解决方法都是利用固定的语义特征对传统的语义分割模型提取的图片特征图进行相似度计算进行像素点的分类。没有充分利用零样本的语义特征的特点,针对不同的像素点得使用可变的语义特征进行语义分割。此方法基于这个问题,提出了可学习的背景类语义特征,根据图片的背景更新背景语义特征,同时还根据像素点对不同类的注意力获取该像素点对应的语义特征,每个像素点根据调节后的语义特征计算相似度后再进行分类。

技术实现要素:

5.(一)要解决的技术问题

6.解决当前零样本语义分割任务基本的解决方法都是利用固定的语义特征对传统的语义分割模型提取的图片特征图进行相似度计算进行像素点的分类,没有充分利用零样本的语义特征的特点,针对不同的像素点得使用可变的语义特征进行语义分割的问题,提供了一种基于语义注意力机制的零样本语义分割方法。

7.(二)技术方案

8.本发明的目的是通过以下技术方案来实现的:一种基于语义注意力机制的零样本语义分割方法,包括以下步骤:

9.步骤一:构建零样本语义分割数据集;

10.步骤二:将步骤一数据集的训练图片输入到背景提取模块,输出训练图片背景区域的掩码图;

11.步骤三:使用步骤二得到的掩码图掩盖训练图片的前景部分,得到训练图片的背景区域;

12.步骤四:利用训练图片的背景标注,计算训练图片背景的语意分割损失;

13.步骤五:将步骤三得到的背景区域输入到背景特征更新模块,同时将初始背景特征输入到背景模块中;背景特征更新模块输出适用于当前图片语义分割的背景特征;

14.步骤六:将训练图片输入到像素特征提取模块中,像素特征提取模块输出两个图,一个是图片的像素级视觉特征的特征图,另一个是语义注意力图;

15.步骤七:将步骤六中得到的语义注意力图作用在语义特征上得到针对每个像素点进行语义分割的语义特征向量;

16.步骤八:计算步骤七中得到的针对每个像素点的语义特征向量和步骤五中得到的背景特征与步骤六中输出的特征图的每个像素点的相似度,作为每个像素点的分类置信度,通过损失函数计算整图的语义分割损失;

17.步骤九:根据步骤四和步骤八计算的背景和整图的语义分割损失计算总损失,用总损失训练背景提取模块、背景特征更新模块和像素特征提取模块;

18.步骤十:测试的时候,先利用步骤三中的背景提取模块提取测试图片的背景区域掩码,然后利用掩码得到测试图片的背景区域,将背景区域和初始背景特征输入到步骤五中的背景特征更新模块中得到当前测试图片的背景特征;与此同时,将测试图片输入到步骤六中的像素特征提取模型,利用像素特征提取模型输出的语义注意力图得到测试语义特征;最后采用步骤八的方法计算每个像素点的分类置信度,取最大值作为每个像素点的分类结果。

19.作为优选的技术方案,步骤一中,采用visual object classes challenge2012(voc2012)数据集,训练图片有8256张,测试图片有1449张,可见类有15类,未见类有5类。

20.作为优选的技术方案,步骤二中,背景提取模块采用maskformer模型,该模型主要用于有监督的语义分割任务,输入图片后可以输出图片的背景区域。

21.作为优选的技术方案,步骤四中的训练图片背景的语义分割损失是通过二元交叉熵损失函数计算得到。

22.作为优选的技术方案,步骤五中的初始背景特征是“background”这个单词的词向量特征。

23.作为优选的技术方案,步骤五中的背景特征更新模块由2层3

×

3卷积层和relu激活层组成,最后通过全局平局池化得到背景特征,然后拼接初始背景特征后,经过1层全连接层和relu激活层后得到步骤五中的适用于当前图片语义分割的背景特征。

24.作为优选的技术方案,步骤六中的像素特征提取模块采用的骨架模型是deeplabv3模型。

25.作为优选的技术方案,步骤六中通过deeplabv3输出的像素特征图,将像素特征图与可见类的语义特征相乘后得到相似度图,然后将相似度图输入到3层的3

×

3卷积层和relu层后输出一个语义注意力图。

26.作为优选的技术方案,步骤七中将语义注意力图作用在语义特征上的具体操作为,先在每个像素点上复制对可见类数目的语义特征得到语义特征图,然后将步骤六中得到的语义注意力图和复制得到的语义特征图相乘得到利用语义注意力之后的语义注意力

语义特征图。

27.作为优选的技术方案,步骤八中通过余弦相似度计算特征向量和语义特征向量的相似度,步骤八中的语义分割损失通过二元交叉熵损失函数计算得到。

28.(三)有益效果

29.本发明的有益效果是:本方法利用语义注意力的方式学习可变的针对每个像素点语义分割的语义特征进行零样本语义分割任务。具体而言,本方法通过提取图片的背景区域获取背景区域,从而更新背景语类的语义特征,得到适用于当前图片的背景语义特征。同时本方法通过像素特征提取模块提取语义注意力图,帮助每个像素点得到适用于其的语义特征。从两个方面学习可变的语义特征帮助零样本语义分割模型提升性能。

附图说明

30.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

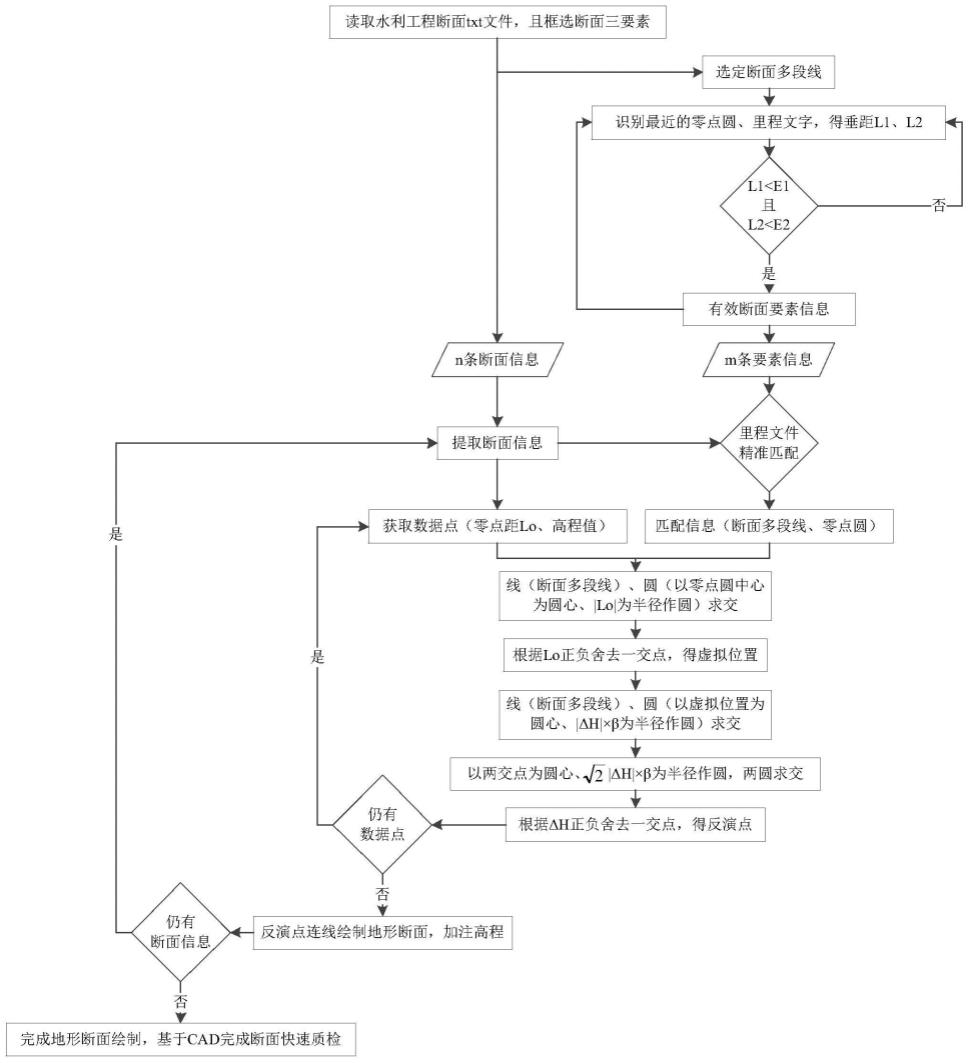

31.图1是整体的模型结构;

32.图2是背景特征更新模块;

具体实施方式

33.下面结合附图和具体实施例对本发明作进一步详细说明。

34.如图1所示,本发明采用的技术方案的主要步骤如下:

35.步骤一:使用visual object classes challenge 2012(voc2012)数据集中的15类共8256张图片作为零样本语义分割的训练数据集。

36.步骤二:利用图1中的背景提取模块提取训练图片的背景区域,我们使用maskformer作为背景提取模块。

37.步骤三:使用步骤二得到的掩码图掩盖训练图片的前景部分,得到训练图片的背景掩码图。

38.步骤四:利用训练图片的背景标注,通过二元交叉熵损失函数计算训练图片背景的语意分割损失。

39.步骤五:将步骤三得到的背景区域输入到背景特征更新模块,同时将初始背景特征输入到背景模块中。背景特征更新模块输出适用于当前图片语义分割的背景特征。背景更新模块结构如图2所示,由2层3

×

3卷积层和relu激活层组成,通过全局平局池化得到提取的背景特征,然后拼接初始背景特征后,最后经过1层全连接层和relu激活层后输出最终的背景特征。

40.步骤六:将训练图片输入到像素特征提取模块中,像素特征提取模块输出两个图,一个是图片的像素级视觉特征图,另一个是语义注意力图。像素特征提取模块的基础模型是deeplabv3,将deeplabv3输出的特征图与可见类的语义特征相乘后得到的相似度图输入到3层的卷积层和relu激活层后得到语义注意力图。

41.步骤七:将步骤六中得到的语义注意力图作用在语义特征上得到适用于每个像素

点进行语义分割的语义特征向量。

42.步骤八:将步骤七中得到的适用于每个像素点的语义特征向量和步骤五中得到的背景特征用于步骤六中输出的特征图的语义分割,得到每个像素点的分类置信度,通过二元交叉熵根据图片的语义分割标注计算整图的语义分割损失。

43.步骤九:根据步骤四和步骤八计算的背景和整图的语义分割损失计算总损失,用总损失训练背景提取模块、背景特征更新模块和像素特征提取模块。

44.步骤十:测试的时候,先利用步骤三中的背景提取模块提取测试图片的背景区域掩码,然后利用掩码得到测试图片的背景区域,将背景区域和初始背景特征输入到步骤五中的背景特征更新模块中得到当前测试图片的背景特征。与此同时,将测试图片输入到步骤六中的像素特征提取模型,利用像素特征提取模型输出的语义注意力图得到测试语义特征。最后采用步骤八的方法计算每个像素点的分类置信度,取最大值作为每个像素点的分类结果。

45.需要说明的是:本发明通过搭建可学习的语义特征的零样本语义分割模型,利用可更新的背景语义特征和利用语义注意力机制得到的语义特征帮助模型更好的使用语义特征进行图片的语义分割。

46.上面的实施例仅仅是对本发明的优选实施方式进行描述,并非对本发明的构思和范围进行限定,在不脱离本发明设计构思的前提下,本领域普通人员对本发明的技术方案做出的各种变型和改进,均应落入到本发明的保护范围,本发明请求保护的技术内容,已经全部记载在权利要求书中。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。