1.本发明属于装配仿真技术领域,具体涉及一种基于虚拟现实的装配仿真人机工效评价系统及方法。

背景技术:

2.随着社会的进步与科学技术的日新月异,催生了一种新兴的制造概念和理论

‑‑‑

虚拟制造,其全新的制造体系和模式已成为现代制造技术发展的必然趋势。虚拟装配仿真是虚拟制造研究领域的重要研究分支。虚拟装配仿真是在虚拟环境中,通过虚拟现实技术对设计产品的三维模型进行预装配,实现快速改进产品的设计和装配结构,达到缩短产品设计优化周期、降低成本的目的。

3.在实际装配场景中,人的核心因素是不可忽视的。装配工艺设计不合理、装配单元(工位)布局不合理、操作者的动作不规范等因素,都会影响工人的身体健康及生产效率。此外,传统的人机工效分析评价是在工人已经出现不适或职业伤害已经发生的前提下进行的,而理想的人机工效分析评价方法,应当尽可能在伤害发生之前,就能分析判断其可能发生的情况。因此需要建立一种系统和方法,用虚拟产品代替传统的物理样机,在虚拟环境中进行人机工效分析,从人员健康的角度对操作者进行人机工效监测和评价,并分析人在工作时的舒适度以及人对工作负荷的适应能力,以便及时消除无效劳动,减轻疲劳,合理利用人力和设备,提高工效。

4.当前随着产品的个性化定制需求日益增多,装配工艺规划和工位布局往往经常发生变化调整,在场地、成本和时间等多重因素的制约下,需要通过虚拟装配仿真代替实际的试装配过程,快速进行装配工艺验证与人机工效分析评价,预先发现装配过程存在的工艺设计及人因问题。因此利用虚拟现实及计算机视觉技术搭建实时的装配作业仿真人机功效评价体系,能够快速构建与实际场景一致的虚拟装配环境并进行装配作业仿真与人机工效评估,降低验证成本与周期。

5.传统的虚拟装配仿真和人机工效评价方法往往基于虚拟人,没有充分体现“人”在装配作业过程中真正的参与性与交互性。专利号为cn113633281a、cn113331825a的发明分别提出了装配过程中姿态采集与评估和基于虚拟现实的rula实时评价方法,关注于操作者的健康风险因素并给出了姿态评分细则。但这些评估方法忽略了对工艺信息的有效利用,如未考虑装配过程中零部件与工具的尺寸、重量对人体生物力学负荷水平的影响,缺乏准确性。同时,上述发明以可穿戴设备作为人体运动捕捉设备,需要特定的实验场地与设备,对于测试评价的要求较高,且评价成本也较高,难以灵活部署和应用。此外,上述发明没有涉及操作受力的影响,而专利号为cn110163425a的发明对操作力和人体姿态做了结合,借助力矩对人员操作时的安全性做了更加科学的分析,但是其通过构建虚拟人体模型进行分析计算和评价,没有提供现实人体姿态实时数据的采集方案,并且计算过程过于复杂,资源开销大,难以推广。

技术实现要素:

6.解决的技术问题:为了解决现有技术存在的缺乏准确性、对于评估的环境要求和成本较高、缺乏具体的人体姿态实时数据的采集方案的问题,本发明基于虚拟现实、计算机视觉、深度学习等技术,提出一种基于虚拟现实的装配仿真人机工效评价系统及方法,实现了对装配过程中装配作业人员舒适性、操作可达性和装配单元空间布局合理性的验证;通过在与实际装配作业单元1:1映射的虚拟环境下识别人体动作特征点,结合标准的结构化工艺信息,对装配作业人员的操作姿态与动作进行实时数据采集、分析和评估,根据反馈结果指导工艺设计人员对工位布局和装配工艺进行优化改进,使操作者可以在更加合理、健康的环境下,养成规范的操作习惯,进行标准化的作业,以人为本提升制造行业的生产效率。

7.技术方案:一种基于虚拟现实的装配仿真人机工效评价系统,所述装配仿真人机工效评价系统包括虚拟装配仿真子系统和人机工效监测与评价子系统;所述虚拟装配仿真子系统包括装配单元构建模块、工艺引导模块和交互处理模块;所述装配单元构建模块读取装配单元层级结构与空间布局信息,加载装配作业环境及工位设施的三维模型,生成由非装配对象构成的基础作业场景;再读取结构化工艺信息,载入装配单元所有装配工序对应的零件、装配体、工具、夹具的三维模型,生成与真实装配环境一致的虚拟装配作业场景;所述工艺引导模块从装配工艺路线中依次读取当前装配工序的装配操作指导说明、待装配零部件信息、涉及的工具夹具信息,引导操作者在虚拟装配作业场景中选取对应的待装配零部件和工具夹具,按照装配工艺要求的装配约束和装配路径将待装配零部件置于最终装配位置上;所述交互处理模块识别装配仿真操作过程中的碰撞干涉,并捕捉操作者对零部件与工具夹具的拾取、移动、放置、固定交互动作,结合制造bom数据实时生成包含拾取零部件与工具的重量信息、尺寸信息、操作工件的起始位置和当前位置在内的装配仿真操作信息,发送给人机工效监测与评价子系统进行分析计算;所述人机工效监测与评价子系统包括人体姿态捕捉模块、计算与分析模块;所述人体姿态捕捉模块采用单目摄像头实时捕捉操作者的装配作业动作姿态视频图像;所述计算与分析模块对人体姿态捕捉模块所采集的装配作业动作姿态视频图像进行分析处理得到操作者的人体关键点的3d坐标信息,基于人体关键点3d坐标信息,计算基于rula、luba的人体关键部位角度,分析得到基于人体姿态的第一人机工效评价数据,再基于人体关键点3d坐标信息和交互处理模块发送的装配仿真操作信息,计算人体关键节点与肢体所受的外力矩,并依据niosh评估方法计算负载指数,分析得到基于人体所受外力的第二人机工效评价数据;综合第一人机工效评价数据和第二人机工效评价数据,得到实时综合人机工效数据并记录至人机工效评分日志。

8.进一步地,所述人机工效监测与评价子系统包括预警模块;所述预警模块在进行参数配置及初始标定后,在虚拟装配过程中对操作者进行实时的评价结果显示和风险报警提醒;所述交互处理模块实时接收预警模块发送的风险报警提醒,实时提醒操作者察觉可能引起疲劳和肌肉骨骼损伤的装配操作。

9.进一步地,所述计算与分析模块包括基于resnet-50网络进行迁移学习的3d姿态

估计全卷积神经网络和基于rula、luba构建的人机工效分析模块;每次单目摄像头更换位置时,人体姿态捕捉模块连续捕捉操作者在场地中央以正常舒适姿势站定时的放松状态下的姿态图像,将采集结果发送至3d姿态估计全卷积神经网络进行基础标定操作,以记录多组有效的3d关键点的三维坐标并求取其平均值作为后续虚拟现实装配模拟时进行人体姿态评估的基础比较信息;开始进行虚拟装配操作后,人体姿态捕捉模块实时捕捉操作者的装配作业动作姿态视频图像,将装配作业动作姿态视频图像导入3d姿态估计全卷积神经网络,计算得到操作者的3d关键点的实时相对坐标信息;所述3d姿态估计全卷积神经网络将操作者的3d关键点的实时相对坐标信息和基础比较信息同时输入至人机工效分析模块,进行人体姿态的计算、评估与预警。

10.进一步地,所述人机工效分析模块根据操作者的3d关键点的实时相对坐标信息和基础比较信息计算得到躯干、颈部、左臂与右臂的相对角度;对于躯干的矢状面相对角度计算,以左肩、右肩以及骨盆的坐标计算出躯干面向方向向量,将虚拟装配操作时监测并计算得到的躯干面向方向向量与标定得到躯干面向方向向量进行对比,计算出躯干面向方向在垂直面所变化的角度,得到虚拟操作中操作者实时的躯干矢状面的相对角度;对于躯干的冠状面相对角度计算,将左肩至右肩的向量作为躯干侧向方向向量,将虚拟装配操作时监测并计算得到的躯干侧向方向向量与标定得到躯干侧向方向向量进行对比,计算出躯干侧向方向在垂直面所变化的角度,得到虚拟操作中操作者实时的躯干冠状面的的相对角度;对于颈部的矢状面相对角度计算,先计算左眼、右眼与鼻的中心点p1,再计算左耳与右耳的中点p2,将p2至p1的向量作为头部的面向方向向量,将虚拟装配操作时监测并计算得到的头部的面向方向向量与标定得到头部的面向方向向量进行对比,计算出头部的面向方向在垂直面所变化的角度,得到虚拟操作中操作者实时的颈部矢状面的的相对角度;对于颈部的冠状面相对角度计算,计算左耳至右耳的向量v1和左眼至右眼的方向v2,将v1与v2的平均向量作为头部的侧向方向向量,将虚拟装配操作时监测并计算得到的头部的侧向方向向量与标定得到头部的侧向方向向量进行对比,计算出头部的侧向方向在垂直面所变化的角度,得到虚拟操作中操作者实时的颈部冠状面的相对角度;对于左臂的矢状面相对角度计算,计算左肩至左手肘的左臂方向向量,计算左肩与右肩的中点p3,计算左胯至右胯的中点p4,计算p3至p4的向量得到人体躯干的竖直方向向量v3,再计算出躯干的面向方向向量v4,以v3和v4表示躯干相对矢状平面;将左臂的方向向量投影至躯干相对矢状平面,并计算投影后的向量与v3的夹角,得到虚拟操作中操作者实时的左臂矢状面的相对角度;对于左臂的矢状面相对角度计算,将投影平面更换为由左肩、右肩以及骨盆所确定的躯干相对冠状平面,计算得到虚拟操作中操作者实时的左臂冠状面的相对角度;对于右臂的矢状面相对角度计算,计算右肩至右手肘的右臂方向向量,计算左肩与右肩的中点p3,计算左胯至右胯的中点p4,计算p3至p4的向量得到人体躯干的竖直方向向量v3,再计算出躯干的面向方向向量v4,以v3和v4表示躯干相对矢状平面;将右臂的方向向量投影至躯干相对矢状平面,并计算投影后的向量与v3的夹角,得到虚拟操作中操作者实时的右臂矢状面的相对角度;对于右臂的矢状面相对角度计算,将投影平面更换为由左

肩、右肩以及骨盆所确定的躯干相对冠状平面,计算得到虚拟操作中操作者实时的右臂冠状面的相对角度。

11.进一步地,所述人机工效分析模块针对躯干、颈部、左臂与右臂的相对角度设置有多个取值范围,每个取值范围对应有评分,根据操作者实时相对坐标信息对应的躯干、颈部、左臂与右臂的相对角度的取值,判断得到相应的关键点评分;再综合所有的关键点评分分析得到基于人体姿态的第一人机工效评价数据。

12.进一步地,所述人机工效分析模块根据3d关键点的实时相对坐标信息以及接收到的实时装配仿真操作信息中的当前工件重量和尺寸数据计算人体关键节点与肢体所受的外力矩;对于单手握持的工件,直接计算工件对于对应肘部、肩部以及腰部产生的力矩;对于双手握持的工件,将工件的重力等分为两份,根据等分后的工件重力分别计算等分后的工件对于相应肘部、肩部和腰部产生的力矩,对两个等分后的工件重力对于腰部产生的力矩进行加和处理,作为完整工件对腰部产生的力矩。

13.进一步地,所述人机工效分析模块依据niosh评估方法计算负载指数,分析得到基于人体所受外力的第二人机工效评价数据的过程包括以下步骤:依据3d关键点的实时相对坐标信息,计算得到操作者手到两只脚中心线中点的水平距离h、操作者手到两只脚中心线中点的垂直距离v、操作者左胯到右胯的向量与左肩到右肩的向量夹角,以及操作者身体转动的角度a;获取装配仿真操作信息中的当前工件尺寸、工件操作起始和当前位置在垂直方向的距离d,得到相应的拾取难易程度等级c;记录并计算虚拟装配过程中某一任务的操作频率f;依据操作者手到两只脚中心线中点的水平距离h计算水平因子hm;依据操作者手到两只脚中心线中点的垂直距离v计算垂直因子vm;依据工件操作起始和当前位置在垂直方向的距离d计算距离因子dm;依据操作者身体转动的角度a计算不对称因子am;基于操作频率f计算频率因子fm;依据拾取难易程度等级c计算耦合因子cm;计算推荐极限重量rwl=lc

×

hm

×

vm

×

dm

×

fm

×

am

×

cm,其中,lc为负载常量;计算提举系数li=m/rwl,其中m为当前所操作工件的质量。

14.进一步地,取第一人机工效评价数据和第二人机工效评价数据中的较小值作为实时综合人机工效数据并记录至人机工效评分日志。

15.本发明公开了一种基于虚拟现实的装配仿真人机工效评价方法,所述装配仿真人机工效评价方法基于如前所述的装配仿真人机工效评价系统执行;所述装配仿真人机工效评价方法包括以下步骤:s1,将装配单元布局信息和结构化工艺信息载入虚拟装配仿真子系统;s2,利用装配单元构建模块读取装配单元层级结构与空间布局信息,加载装配作业环境及工位设施的三维模型,生成由非装配对象构成的基础作业场景;再读取结构化工艺信息,载入该装配单元所有装配工序中需要用到的零件、装配体、工具、夹具的三维模型,由操作人员交互式的调整各对象的摆放位置与空间布局,生成与真实装配环境一致的虚拟装配作业场景;s3,利用工艺引导模块从装配工艺路线中依次读取当前装配工序的装配操作指导

说明、待装配零部件信息、需使用的工具夹具信息,引导操作者在步骤s2中生成的虚拟装配作业场景中选取对应的待装配零部件和工具夹具,按照装配工艺要求的装配约束和装配路径将待装配零部件置于最终装配位置上;s4,利用交互处理模块识别装配仿真操作过程中的碰撞干涉,并捕捉步骤s3中操作者对零部件与工具夹具的拾取、移动、放置、固定交互动作,结合制造bom数据实时生成包含拾取零部件与工具的重量信息、尺寸信息、操作工件的起始位置和当前位置在内的装配仿真操作信息,发送给人机工效监测与评价子系统进行分析计算;s5,利用人机工效监测与评价子系统中的人体姿态捕捉模块捕捉操作者的虚拟装配实时操作图像,再利用计算与分析模块对图像进行分析处理计算出人体关键点的3d坐标信息;基于得到的人体关键点的3d坐标信息,计算基于rula、luba的人体关键部位角度,实时得到基于人体姿态的第一人机工效评价数据;s6,基于步骤s5中得到的人体关键点的3d坐标信息以及接收到的实时装配仿真操作信息中的当前工件重量和尺寸数据计算人体关键节点与肢体所受的外力矩,并依据niosh评估方法计算负载指数,得到基于人体所受外力的第二人机工效评价数据;s7,基于人体姿态的第一人机工效评价数据与基于人体所受外力的第二人机工效评价数据,通过计算与分析模块计算分析实时综合人机工效数据并记录至人机工效评分日志;其中,在虚拟装配仿真过程中,若实时综合人机工效数据低于设定的标准,预警模块对操作者进行预警提醒;s8,对人机工效评分日志数据进行综合统计分析,得到包含装配单元的综合人机工效统计图、最终评分表、风险因素分析、工位调整建议在内的虚拟产线综合人机工效评估结果。

16.有益效果:第一,本发明的基于虚拟现实的装配仿真人机工效评价系统及方法,通过虚拟现实技术与计算机视觉技术相结合的方式,在虚拟装配仿真过程中基于低成本的单目摄像头对操作者的姿态及动作进行捕捉采集和分析,利用结构化工艺数据估计人机工效负荷,实现定性与定量的人机工效实时综合分析,帮助工艺设计人员通过评估结果找出装配工艺设计缺陷。此方法大大降低了装配作业人机工效评价工作的实施成本和操作难度,无需在真实的装配单元进行试装验证,提高了人机工效评价的准确性、全面性和客观性,能够灵活应用于各种生产装配场景。

17.第二,本发明的基于虚拟现实的装配仿真人机工效评价系统及方法,不仅利用rula、luba评估方法对人体姿态进行评估和分析,更重要的是考虑到了当前操作工件和工具的尺寸、重量对人体负载的影响,利用niosh方法以及工件对人体关键点的力矩分析进行人体所受外力的人机工效评估,解决了传统方法仅基于人体姿态进行评估导致结果不准确、不全面、不客观的问题。该方法利用单目便携式摄像头并结合计算机视觉和深度学习技术进行人体姿态数据的采集,和现有的人机工效评价人体姿态数据采集方法相比,大大降低了对环境的要求和人体姿态数据采集的成本。

附图说明

18.图1为本发明实施例的基于虚拟现实的装配仿真人机工效评价系统结构示意图;

图2为本发明实施例的基于虚拟现实的装配仿真人机工效评价方法流程图;图3为本发明实施例的基于虚拟现实的装配仿真人机工效评价方法的架构图。

具体实施方式

19.下面的实施例可使本专业技术人员更全面地理解本发明,但不以任何方式限制本发明。

20.图1为本发明实施例的基于虚拟现实的装配仿真人机工效评价系统结构示意图。参见图1,该装配仿真人机工效评价系统包括虚拟装配仿真子系统和人机工效监测与评价子系统。操作者在虚拟装配仿真子系统引导下执行虚拟装配操作,并通过人机工效监测与评价子系统进行人机工效的评价。

21.虚拟装配仿真子系统主要通过虚拟现实的方式对装配过程进行仿真,操作者通过沉浸式交互的方式在与实际装配场景一致的虚拟场景中进行装配仿真操作,识别可装配性设计缺陷、工位布局不合理、装配工艺不合理等问题。虚拟装配仿真子系统是基于unreal虚拟引擎开发实现的虚拟仿真环境,主要包括装配单元构建模块、工艺引导模块和交互处理模块。

22.装配单元构建模块读取装配单元层级结构与空间布局信息,加载装配作业环境及工位设施的三维模型,生成由非装配对象构成的基础作业场景;再读取结构化工艺信息,载入该装配单元(工位)所有装配步序中需要用到的零件、装配体、工具、夹具的三维模型,可由操作人员交互式的调整各对象的摆放位置与空间布局,生成一个与真实装配环境一致的虚拟装配作业场景。

23.工艺引导模块从装配工艺路线中依次读取当前工序工步的装配操作指导说明、待装配零部件信息、需使用的工具夹具信息,引导操作者通过vr设备在虚拟装配作业场景中选取对应的待装配零部件和工具夹具,按照装配工艺要求的装配约束和装配路径将待装配零部件置于最终装配位置上。工艺引导模块提供的装配仿真引导信息包括装配工具的选取、零部件的拾取、移动、放置、固定动作、装配动作路径等具体操作指示。

24.交互处理模块识别装配仿真操作过程中的碰撞干涉,并捕捉操作人员对零部件与工具夹具的拾取、移动、放置、固定等交互动作,结合制造bom数据实时生成包含拾取零部件与工具的重量信息、尺寸信息、操作工件的起始位置和当前位置在内的装配仿真操作信息,发送给人机工效监测与评价子系统进行分析计算。交互处理模块还实时接收人机工效监测与评价子系统发送的实时报警反馈信息,实时提醒操作者察觉可能引起疲劳和肌肉骨骼损伤的装配操作。

25.人机工效监测与评价子系统根据装配仿真操作信息和计算机视觉信息实现对人机工效进行分析与评价,基于英伟达边缘计算平台jetson nano搭建,主要包含人体姿态捕捉模块、计算与分析模块和预警模块。

26.人体姿态捕捉模块使用单目摄像头捕捉与识别操作者的装配作业动作姿态,采集操作者的虚拟装配操作图像。

27.计算与分析模块对人体姿态捕捉模块所采集的实时图像信息进行分析处理得到人体的姿态信息,得到人体相对3d坐标,再利用计算得出的人体相对3d坐标、实时接收的装配仿真操作信息,结合生理力学极限、快速上肢评估(rula、luba)得到人机工效的实时评价

与统计评分。与可穿戴动作捕捉设备相比,使用摄像头与机器视觉算法成本更低,部署更为灵活方便,能在各种环境下进行测试;计算与分析模块还对得到的人体姿态信息和虚拟装配仿真子系统发送的装配仿真操作信息进行整合分析得到人机工效的实时评价与统计评分。

28.预警模块在进行参数配置及初始标定后,能够在虚拟装配过程中对操作者进行实时的评价结果显示和风险报警提醒。预警模块包含操作界面交互子模块和音频交互子模块,用于实时向操作者显示人机工效的计算信息,辅助操作者完成规范完整的虚拟操作测试步骤。

29.本实施例所用的系统在虚拟装配过程中,仅利用边缘计算平台与单目摄像头就能完成人体姿态识别与人机工效的评价,解决了传统方法依赖于可穿戴式人体姿态捕捉设备成本高、部署复杂、对于实现环境要求高的问题。

30.参见图2和图3,本实施例还提出了一种基于虚拟现实的装配仿真人机工效评价方法,基于前述基于虚拟现实的装配仿真人机工效评价系统实现,该方法包括以下步骤:s1,将装配单元布局信息和结构化工艺信息载入虚拟装配仿真子系统。

31.s2,利用装配单元构建模块读取装配单元层级结构与空间布局信息,加载装配作业环境及工位设施的三维模型,生成由非装配对象构成的基础作业场景;再读取结构化工艺信息,载入该装配单元(工位)所有装配步序中需要用到的零件、装配体、工具、夹具的三维模型,可由操作人员交互式的调整各对象的摆放位置与空间布局,生成一个与真实装配环境一致的虚拟装配作业场景。

32.s3,利用工艺引导模块从装配工艺路线中依次读取当前工序工步的装配操作指导说明、待装配零部件信息、需使用的工具夹具信息,引导操作者通过vr设备在步骤s2中生成的虚拟装配作业场景中选取对应的待装配零部件和工具夹具,按照装配工艺要求的装配约束和装配路径将待装配零部件置于最终装配位置上。工艺引导模块提供的装配仿真引导信息包括装配工具的选取、零部件的拾取、移动、放置、固定动作、装配动作路径等具体操作指示。

33.s4,利用交互处理模块识别装配仿真操作过程中的碰撞干涉,并捕捉步骤s3中操作人员对零部件与工具夹具的拾取、移动、放置、固定等交互动作,结合制造bom数据实时生成包含拾取零部件与工具的重量信息、尺寸信息、操作工件的起始位置和当前位置在内的装配仿真操作信息,发送给人机工效监测与评价子系统进行分析计算。交互处理模块还实时接收人机工效监测与评价子系统发送的实时报警反馈信息,实时提醒操作者察觉可能引起疲劳和肌肉骨骼损伤的装配操作。

34.s5,利用人机工效监测与评价子系统中的人体姿态捕捉模块捕捉由单目摄像头采集的操作者的虚拟装配实时操作图像,将实时采集的图像输入基于resnet-50进行迁移学习的3d姿态估计全卷积神经网络,得到人体关键点的相对3d坐标数据。基于得到的人体关键点3d坐标信息,计算基于rula、luba的人体关键部位角度,依据规定的评价规则实时得到基于人体姿态的第一人机工效评价数据。本方法使用摄像头与机器视觉算法实现操作者实时操作图像的捕捉,与采用可穿戴动作捕捉设备的方法相比,成本更低,部署更为灵活方便,能在各种环境下进行测试。

35.具体地,在实际操作过程中,每次单目摄像头更换位置时,模拟操作者在场地中央

以正常舒适姿势站定,进行基础标定操作,记录20个有效的三维坐标并求取其平均值作为后续虚拟现实装配模拟时进行人体姿态评估的基础比较信息。开始进行虚拟装配操作后,单目摄像头实时捕捉操作者的操作画面,并通过上述方法得到操作者的3d关键点的相对坐标信息。将上述信息以及基础信息输入至基于rula、luba的人机工效计算与分析模块,进行人体姿态的计算、评估与预警。

36.在基于rula、luba的人机工效计算与分析模块中,首先进行人体关键部位的相对角度计算,包括躯干、颈部、左臂与右臂。

37.对于躯干的矢状面相对角度计算,以左肩、右肩以及骨盆的坐标计算出躯干面向方向向量。将虚拟装配操作时监测并计算得到的躯干面向方向向量与标定得到躯干面向方向向量进行对比,计算出躯干面向方向在垂直面所变化的角度,得到虚拟操作中操作者实时的躯干矢状面的相对角度。

38.对于躯干的冠状面相对角度计算,将左肩至右肩的向量作为躯干侧向方向向量。将虚拟装配操作时监测并计算得到的躯干侧向方向向量与标定得到躯干侧向方向向量进行对比,计算出躯干侧向方向在垂直面所变化的角度,得到虚拟操作中操作者实时的躯干冠状面的的相对角度。

39.对于颈部的矢状面相对角度计算,先计算左眼、右眼与鼻的中心点p1,再计算左耳与右耳的中点p2,将p2至p1的向量作为头部的面向方向向量。将虚拟装配操作时监测并计算得到的头部的面向方向向量与标定得到头部的面向方向向量进行对比,计算出头部的面向方向在垂直面所变化的角度,得到虚拟操作中操作者实时的颈部矢状面的的相对角度。

40.对于颈部的冠状面相对角度计算,计算左耳至右耳的向量v1和左眼至右眼的方向v2,将v1与v2的平均向量作为头部的侧向方向向量。将虚拟装配操作时监测并计算得到的头部的侧向方向向量与标定得到头部的侧向方向向量进行对比,计算出头部的侧向方向在垂直面所变化的角度,得到虚拟操作中操作者实时的颈部冠状面的相对角度。

41.对于左臂的矢状面相对角度计算,计算左肩至左手肘的左臂方向向量,计算左肩与右肩的中点p1,计算左胯至右胯的中点p2,计算p1至p2的向量从而得到人体躯干的竖直方向向量v1。由之前的步骤计算出躯干的面向方向向量v2,以v1和v2可表示躯干相对矢状平面。将左臂的方向向量投影至躯干相对矢状平面,并计算投影后的向量与v1的夹角,得到虚拟操作中操作者实时的左臂矢状面的相对角度。

42.对于左臂的矢状面相对角度计算,依照上述方法,将投影平面更换为由左肩、右肩以及骨盆所确定的躯干相对冠状平面,计算得到虚拟操作中操作者实时的左臂冠状面的相对角度。

43.对于右臂采取同样的方式进行矢状面与冠状面的计算,可得到实时角度。

44.基于rula、bula方法,按照以下方式进行实时评分:姿态评分初始均为5。

45.若躯干矢状角度小于-10

°

(向后倾倒10

°

),时长超过1秒,躯干矢状评分为2。

46.若躯干矢状角度在-10

°

至20

°

(向前倾倒20

°

)间,躯干矢状评分为5。

47.若躯干矢状角度在20

°

至60

°

间,时长超过5秒,躯干矢状评分为4。

48.若躯干矢状角度超过60

°

,时长超过1秒,躯干矢状评分为2。

49.若躯干冠状角度在-10

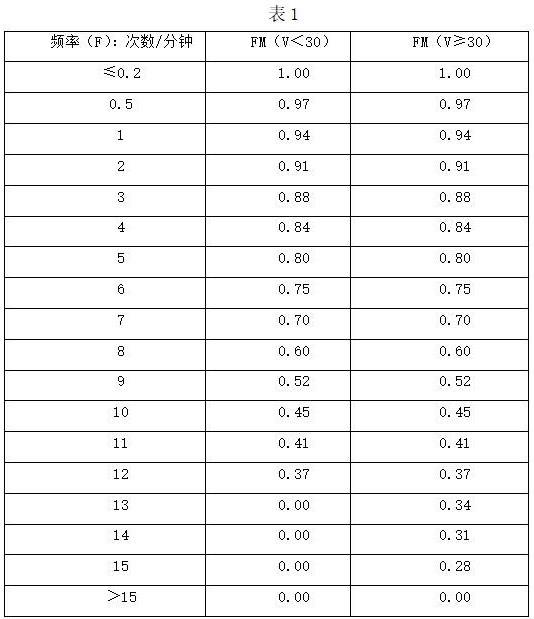

°

至10

°

间,躯干冠状评分为5。

50.若躯干冠状角度小于-10

°

或大于10

°

,时长超过1秒,躯干冠状评分为3。

51.躯干评分为躯干矢状评分与躯干冠状评分中的较小值。

52.若颈部矢状角度小于-5

°

(向后倾倒5

°

),时长超过1秒,颈部矢状评分为2。

53.若颈部矢状角度在-5

°

至10

°

(向前倾倒10

°

)间,颈部矢状评分为5。

54.若颈部矢状角度在10

°

至20

°

间,时长超过5秒,颈部矢状评分为4。

55.若颈部矢状角度超过20

°

,时长超过1秒,颈部矢状评分为2。

56.若颈部冠状角度在-5

°

至5

°

间,颈部冠状评分为5。

57.若颈部冠状角度小于-10

°

或大于10

°

,时长超过1秒,颈部冠状评分为3。

58.颈部评分为颈部矢状评分与颈部冠状评分中的较小值。

59.若手臂矢状角度小于-20

°

(向后垂直举起20

°

),时长超过1秒,手臂矢状评分为2。

60.若手臂矢状角度在-20

°

至20(向前垂直举起20

°

)间,手臂矢状评分为5。

61.若手臂矢状角度在20

°

至45

°

间,时长超过10秒,手臂矢状评分为4。

62.若手臂矢状角度在45

°

至90

°

间,时长超过5秒,手臂矢状评分为3。

63.若手臂矢状角度超过45

°

,时长超过1秒,手臂矢状评分为2。

64.若手臂冠状角度在-20

°

至20

°

间,手臂冠状评分为5。

65.若手臂冠状角度小于-20

°

或大于20

°

,时长超过5秒,手臂冠状评分为3。

66.手臂评分为颈部手臂评分与手臂冠状评分中的较小值,且左臂与右臂评分标准相同。

67.基于人体姿态的人机工效评价数据的全身评分为所有身体部位评分的平均值。

68.s6,基于步骤s5中得到的人体关键点3d坐标信息以及接收到的实时装配仿真操作信息中的当前工件重量和尺寸数据计算人体关键节点与肢体所受的外力矩,并依据niosh评估方法计算负载指数,再依据规定的评价规则得到基于人体所受外力的第二人机工效评价数据。

69.具体地,接收装配仿真操作信息的当前工件重量数据,分别计算操作工件对肘部、肩部、腰部产生的力矩。

70.若单手握持工件,则计算工件对于对应肘部、肩部以及腰部产生的力矩。

71.若工件对肘部的力矩小于2.5n

·

m且对于肩部的力矩小于4n

·

m,则手臂的评分为5,颈部的评分为5。

72.若工件对肘部的力矩在2.5n

·

m与5n

·

m之间且对于肩部的不大于8n

·

m,或对肩部的力矩在4n

·

m与8n

·

m之间且对于肘部的不大于5n

·

m,则手臂的评分为4,颈部的评分为5。

73.若工件对肘部的力矩在5n

·

m与7.5n

·

m之间且对于肩部的不大于12n

·

m,或对肩部的力矩在8n

·

m与12n

·

m之间且对于肘部的不大于7.5n

·

m,则手臂的评分为3,颈部的评分为4。

74.若工件对肘部的力矩大于7.5n

·

m或对肩部的力矩大于12n

·

m,则手臂的评分为2,颈部的评分为3。

75.若工件对腰部的力矩小于5n

·

m,则躯干的评分为5。

76.若工件对腰部的力矩在5n

·

m与10n

·

m之间,则躯干的评分为4。

77.若工件对腰部的力矩在10n

·

m与15n

·

m之间,则躯干的评分为3。

78.若工件对腰部的力矩大于15n

·

m,则躯干的评分为2。

79.对于双手握持的工件,将工件的重力等分为两份,分别对相应肘部、肩部计算,对于腰部的计算结果进行加和,再按照上述方式进行评分。

80.进行基于niosh的人体负载评分,处理流程如下:依据人体关键点3d坐标信息,计算以下信息:操作者手到两只脚中心线中点的水平距离h,单位为cm。

81.操作者手到两只脚中心线中点的垂直距离v,单位为cm。

82.计算操作者左胯到右胯的向量与左肩到右肩的向量夹角,获得操作者身体转动的角度a。

83.同时接收装配仿真操作信息中的当前工件尺寸、工件操作起始和当前位置在垂直方向的距离d,得到拾取难易程度等级c,分为好、较好和差。

84.记录并计算虚拟装配过程中某一任务的操作频率f。

85.依据h计算水平因子hm:若h<25,则hm=1;若25≤h≤63,则hm=(25/h);若h>63,则hm=0。

86.依据v计算垂直因子vm:若v≤175,则vm=(1-0.003|v-75|);若h>175,则vm=0。

87.依据d计算距离因子dm:若d<25,则dm=1;若25≤d≤175,则dm=0.82 (4.5/d);若d>175,则dm=0。

88.依据a计算不对称因子am:若a≤135度,则am=1-(0.0032a),若a>135度,则am=0。

89.基于f计算频率因子fm,如表1所示。

90.依据c计算耦合因子cm:若c为好,则cm=1.0;若c为较好,则cm=0.95;若c为差,则cm=0.9。

91.lc为负载常量,取男18kg,女15kg;单手分别为7kg,5kg。

92.计算推荐极限重量rwl=lc

×

hm

×

vm

×

dm

×

fm

×

am

×

cm计算提举系数li=m/rwl,其中m为当前所操作工件的质量。

93.若li<0.5,则niosh评分为5.0;若0.5≤li<0.75,则niosh评分为4.0;若0.75≤li<0.85,则niosh评分为3.0;若li≥0.85,则niosh评分为2.0;基于人体所受外力的人机工效评分取人体关键点所受外力矩评分与niosh评分较小值。

94.s7,基于人体姿态的第一人机工效评价数据与基于人体所受外力的第二人机工效评价数据,取两者较小值作为实时综合人机工效评分,并记录至人机工效评分日志。

95.s8,在虚拟装配仿真过程中,若人机工效评分低于设定的标准,则预警模块对操作者进行预警提醒。例如,若评分出现2,则进行音频提示报警。

96.s9,对人机工效评分日志数据进行综合统计分析,得到包含装配单元的综合人机工效统计图、最终评分表、风险因素分析、工位调整建议在内的虚拟产线综合人机工效评估结果。

97.本实施例采用的方法使虚拟装配仿真子系统和人机工效监测与评价子系统紧密结合,不仅利用rula、luba评估方法对人体姿态进行评估和分析,更重要的是考虑到了当前操作工件和工具的尺寸、重量对人体负载的影响,利用niosh方法以及工件对人体关键点的力矩分析进行人体所受外力的人机工效评估,解决了传统方法仅基于人体姿态进行评估导致结果不准确、不全面、不客观的问题,同时计算简单,资源开销小,便于实现和推广。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。