技术特征:

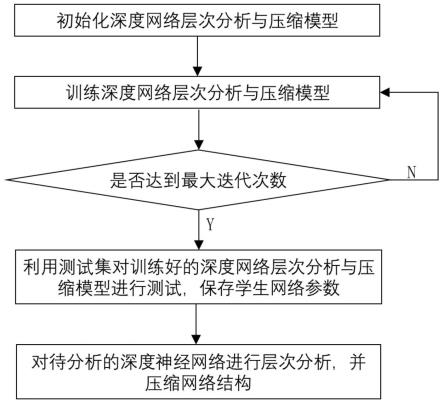

1.一种基于生成对抗掩膜的深度网络层次分析与压缩方法,其特征在于:包括以下步骤:步骤一、初始化深度网络层次分析与压缩模型;步骤101、将待分析的深度神经网络作为教师网络f

t

,复制该教师网络并在每个卷积层之后加入掩膜层构建学生网络f

s

;步骤102、将训练好的待分析网络权重参数加载到教师网络f

t

和学生网络f

s

,初始化掩膜层参数m,初始化判别网络d;步骤103、对于待分析的深度神经网络所用的分类识别任务数据集,将其随机划分为训练集和测试集;步骤二、训练深度网络层次分析与压缩模型:步骤201、将训练数据集样本x输入到教师网络f

t

得到教师网络特征f

t

(x,w

t

),将样本x输入到学生网络f

s

得到学生网络特征f

s

(x,w

s

,m),其中w

t

表示教师网络参数,w

s

表示学生网络参数,m表示掩膜层的参数;步骤202、将教师网络特征f

t

(x,w

t

)输入到判别网络d得到预测结果将学生网络特征f

s

(x,w

s

,m)输入到判别网络d得到预测结果判别网络d用于鉴别由掩膜层约束的学生网络输出特征的真伪,使得学生网络生成的特征与教师网络输出的特征尽量相似;步骤203、固定教师网络参数w

t

、学生网络参数w

s

,通过梯度反向传播以更新判别网络d的参数w

d

,更新优化判别网络d的损失函数l

d

如下:步骤204、固定教师网络参数w

t

、判别网络参数w

d

和掩膜层参数m,通过梯度反向传播以更新学生网络f

s

的参数w

s

,更新优化学生网络f

s

的损失函数l

s

如下:其中,第一项l

g

表示对抗损失,用于约束学生网络f

s

生成高质量的输出特征来欺骗判别网络d,第二项l

r

表示特征重构损失,用于减小教师网络特征与学生网络特征之间的差异,使得学生网络具备教师网络一致的功能;步骤205、固定教师网络参数w

t

、判别网络参数w

d

和学生网络参数w

s

,通过梯度反向传播以更新掩膜层参数m,更新优化掩膜层参数m的损失函数l

m

如下:其中,第一项l

s

为步骤204中的损失函数,第二项l

c

表示掩膜层约束损失,该损失将学生网络f

s

的掩膜层参数m总和限制在一定范围内,训练好的掩膜层参数m可以用于衡量待测深度神经网络各层的贡献度,上式中λ和μ为超参数,l表示待测深度神经网络的层数,n表示训

练样本的数量,m

j

表示第j层卷积之后掩膜层的参数;步骤三、利用测试集对训练好的深度网络层次分析与压缩模型进行测试,保存学生网络参数:步骤301、按照步骤二进行迭代训练,迭代过程中将测试集中的样本输入学生网络f

s

,计算分类精度,直到网络训练完成;步骤302、选取分类精度最高的学生网络参数进行保存,获取各个掩膜层的参数m;步骤四、对待分析的深度神经网络进行层次分析,并压缩网络结构:步骤401、计算各个卷积层的贡献度c

j

,计算公式定义如下:其中,c

j

表示待测深度神经网络的第j个卷积层贡献度,l表示待测深度神经网络的卷积层数,m

j

表示第j层卷积之后掩膜层的参数;步骤402、设置阈值t,考虑到贡献度低于阈值t的卷积层可以认为对深度神经网络的贡献度较低,删减深度网络中贡献度c

j

低于阈值t的卷积层,获得压缩后的深度网络结构。

技术总结

本发明公开了一种基于生成对抗掩膜的深度网络层次分析与压缩方法,包括以下步骤:步骤一、初始化深度网络层次分析与压缩模型;步骤二、训练深度网络层次分析与压缩模型;步骤三、利用测试集对训练好的深度网络层次分析与压缩模型进行测试,保存学生网络参数;步骤四、对待分析的深度神经网络进行层次分析,并压缩网络结构。本发明结构简单、设计合理,将掩膜层加入到待分析的深度神经网络构成学生网络,原深度神经网络作为教师网络,经生成对抗训练后,使得学生网络具备教师网络一致的功能,并利用各个掩膜层参数获得深度神经网络各层的贡献度,从而实现深度网络的层次分析与压缩。从而实现深度网络的层次分析与压缩。从而实现深度网络的层次分析与压缩。

技术研发人员:耿杰 张宇航 来加威 蒋雯

受保护的技术使用者:西北工业大学

技术研发日:2022.07.25

技术公布日:2022/11/25

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。