1.本发明涉及智慧教育和教育大数据挖掘领域,具体是基于双图神经网络的知识追踪建模方法及系统。

背景技术:

2.纵观世界,教育已被人们发现与经济、政治和文化发展呈现出密切而积极的关系。各国政府不断努力调整其教育政策,以促进本国青少年的成长和发展。但自从2020年以来,约1.6亿的学生被迫在家上网课。在这种背景下,在线教育正在以前所未有的规模发展。

3.同时,根据每个学生自身的实际情况制定学习计划,可以高效得利用教育资源和提高学习效率和教育产出,这种“因材施教”的教育手段一直深受教育工作者的关注。在传统的教育成果评判机制,仅仅依靠考试最终分数来评估学生的知识掌握水平并不能体现出学生对每一个知识概念的掌握情况。比如,即使甲乙两位同学在同一份试题中得到了相同的分数,也不能简单认为两位学生对于知识的掌握水平是相同的,因为可能存在学生甲答错的试题,学生乙却回答正确的情况。即使两位同学在同一道题出错,也可能是两位学生在这一道题中所考察的不同知识概念上出现错误。能够建模出学生在每一个知识概念上的掌握水平是实现因材施教、实施个性化教学以及提升教学工作质量的基本前提。

4.知识追踪(knowledge tracing,kt)是根据学生过去的答题情况对学生的知识掌握情况进行建模,以便我们能精确预测学生对于知识概念的掌握程度。知识追踪问题可以形式化为在一次学生答题交互中,存在一组学生s和一组练习e,其中要求不同的学生回答不同的练习,以达到对相关知识的掌握。每个练习都与特定的知识概念有关。学生的学习顺序表示为 i={(e1,a1),(e2,a2),...,(en,an)},其中e

t

表示学生回答的第t道练习, a

t

表示正误性标签(即1表示正确答案,0表示错误答案),n表示学习交互的序列长度。知识追踪的研究内容就是对学生的答题序列建模,得到学生每个时刻的知识状态(学生对于每个知识概念的掌握程度),这样就可以在学生做下一道题目之前,根据学生知识状态来预测学生答对这道题的概率。

5.基于深度神经网络的方法大多采用“独热表示”方法对问题、知识概念以及回答表现等信息进行编码。该编码方式简单、易于理解,但是无法利用到试题之间的关系、知识概念之间的关系、以及试题与知识概念之间的关系,这很大程度上限制了模型性能的进一步提升。且在传统的深度知识追踪方法中,大多方法均以知识概念s作为模型的输入,并未考虑实际答题的题号q,即假如 q1与q2同属于一个知识概念s1,则认为此两题同属一题。但实际上,如果一道题有两个及以上的知识概念,这种方法并不能很好地体现出题目之间的差异性和相关性。

技术实现要素:

6.为了解决上述问题,够提升教学工作质量,实现个性化教学,本发明公开了一种基于双图神经网络的知识追踪建模方法及系统。本发明使用双的图神经网络来对学生的答题

交互进行编码,将得到的两种表示进行融合,得到最终输入到门控循环单元gru中建模预测学生的答题表现,从而提升模型预测的精准度。

7.本发明为实现上述目的,通过以下技术方案实现:

8.答题交互节点:在题目信息的基础上,加入学生可能对该题的答题情况(即答对或答错),融合成学生答题交互,作为构建图的节点;

9.概念关联超图:构建答题交互节点之间的超图。在该超图中,每个知识概念被分解为两个超边,分别对应于掌握与未掌握该知识概念。根据一个题目所关联的知识概念,将答对题目的交互节点加入掌握知识概念所应对的超边,将答错题目的交互节点加入未掌握知识概念所应对的超边。使用超图卷积网络,得到每个答题交互节点的表示,该表示融合了题目与知识概念之间的关联信息;

10.有向转移图:构建答题交互节点之间的有向图。根据所有学生的历史答题交互序列,在该有向图中,使用有向边连接序列中任意两个连续出现的交互所对应的节点,从而体现答题交互之间的转移情况。使用有向图神经网络,得到每个答题交互节点的表示,该表示融合了答题交互节点之间的转移信息;

11.还包括以下步骤:

12.(1)问题定义及数据预处理;

13.(2)双图神经网络编码的融合;

14.(3)门控单元gru建模;

15.(4)预测、损失计算与优化函数。

16.优选的,所述问题定义及数据预处理即数据集中,实际的学生答题交互序列中往往存在短序列(答题数量小于2个)、空缺值(试题缺乏知识概念或者知识概念无对应试题)等情况。对于序列较短的学生样本数据、以及数据不全的信息在预处理阶段需要进行去除。

17.优选的,所述双图神经网络编码的融合包括对概念关联超图编码和有向转移图编码进行融合。

18.优选的,所述门控单元gru建模包括:

19.z

t

=σ(wzx

t

u

zht-1

)

20.r

t

=σ(wrx

t

u

rht-1

)

[0021][0022][0023]

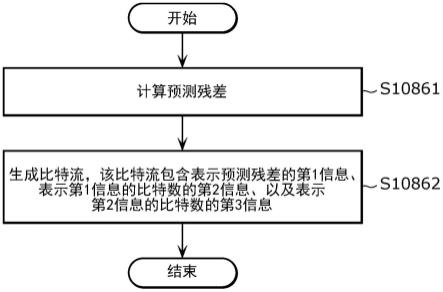

优选的,所述预测、损失计算与优化函数包括:

[0024]

(1)在gru中得到的h

t

与权重矩阵w

yh

,偏置by运算,经过sigmoid函数σ后得到y

t

,y

t

是包含2n道题目(包含答对和答错两种情况)的矩阵,每道题对应答对的概率(0-1之间):

[0025]

yt=σ(w

yh

ht by)

[0026]

(2)将y

t

预测值大于等于0.5的认为会答对下道题(即q

t 1

=1),将小于0.5的认为答错(q

t 1

=0)。与真实的(q

t 1

,a

t 1

)进行对比,计算损失loss并用adam优化函数优化:

[0027]

[0028]

基于双图神经网络的知识追踪建模系统,包括一种终端设备,包括服务器,所述服务器包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行程序时实现上述的所有方法。

[0029]

对比现有技术,本发明的有益效果在于:

[0030]

1、不同于传统的题目和答题情况分别表示的做法,本发明将它们融合成答题交互节点统一表示,避免了分别表示时可能出现的不兼容的问题。

[0031]

2、构建一种概念关联超图,并利用超图神经网络来学习答题交互节点的嵌入表征向量,相比于传统独热编码表示方法,本发明方法可以充分利用题目与知识概念之间的关联信息。

[0032]

3、构建一种有向转移图,并利用有向图神经网络来学习答题交互节点的嵌入表征向量,相比于传统独热编码表示方法,本发明方法可以充分利用学生历史答题交互序列中的交互转移信息。

[0033]

4、对两种图神经网络的节点表示进行融合,再输入到门控循环单元gru学习学生知识状态,综合利用了题目与知识概念之间的关联关系、学生历史答题记录中交互转移关系,与已有方法相比,可显著提高知识追踪模型的准确率。

附图说明

[0034]

附图1是本发明的各方法的auc指标值。

[0035]

附图2是本发明的方法示意图。

具体实施方式

[0036]

下面结合具体实施例,进一步阐述本发明。应理解,这些实施例仅用于说明本发明而不用于限制本发明的范围。此外应理解,在阅读了本发明讲授的内容之后,本领域技术人员可以对本发明作各种改动或修改,这些等价形式同样落于本技术所限定的范围。

[0037]

实施例一:基于双图神经网络的知识追踪建模方法

[0038]

具体实施步骤如下:

[0039]

(1)问题定义及数据预处理

[0040]

本发明主要在三个公开的、常用于知识追踪问题的数据集上进行实验。在 assist2009和assist2017这两个数据集中,实际的学生答题序列中往往存在短答题序列(答题数量小于2个)、空缺值(试题缺乏知识概念或者知识概念无对应试题)等情况。对于序列较短的学生样本数据、以及数据不全的信息在预处理阶段需要进行去除。对于ednet数据集,由于其原始数据过于庞大(约有78 万个学生数据),故从中随机选出5000个学生,之后处理方式与上述两个数据集相同。为了直观的体现出学生的答题序列,在数据集中每个学生的答题序列用四行来表示:第一行为答题序列的答题数量;第二行为答题序列的题号;第三行为题号所对应的知识概念;第四行为学生答对与否(1为答对,0为答错)。

[0041]

(2)双图神经网络编码

[0042]

以往对知识追踪的研究无论是对题目信息或知识概念编码,均未充分考虑题目信息和答题情况的结合,而实际上,同一道题目答对和答错对整个模型带来的影响是有很大区别的。为消除传统知识追踪中题目信息和答题情况分别表示的必要性,使用答题交互同

时包含了题目信息以及学生在此题的答题情况(答对或答错),作为构建图的答题交互节点。假设有n道题目,每道题有答对和答错这两种可能,所以视作有2n道题目,为所有的2n道题目,随机初始化一个d维度的特征,得到然后将依次输入到概念关联超图(cahg)和有向转移图(dtg),分别得到两种题目的编码表示及融合后得到新的题目的表示

[0043]

概念关联超图编码

[0044]

在实际的问题中,每道题目至少与一个知识概念对应,具有相同知识概念的题目具有潜在关系,本发明利用超图结构表示答题交互与知识概念之间的关联关系。超图是简单图的扩展,不同于简单图一条边连接两个节点,超图的超边可以连接任意个数的节点,定义一条超边为节点的子集。设gc=(v,e)为关联超图cahg,其中e={h

1

,h

1-,h

2

,h

2-,...,h

m

,h

m-}表示超边的集合,由于节点表示学生正确或错误回答的答题交互,每个知识概念也分解成两个超边h

j

和h

j-,分别对应于掌握与未掌握该知识概念。故超边e的个数也是知识概念数的两倍。答题交互与知识概念的关联关系可以通过超边及其节点之间的关联关系来表示,注意节点和超边之间存在多对多的对应关系,这是由于答题交互和知识概念之间存在这些对应关系。

[0045]

将练习所包含的知识概念的关联矩阵h及初始化d维特征的x输入到超图卷积神经网络中,得到题目与知识概念之间关系的题目编码,网络包括两层超边卷积hgnn_conv_,激活函数relu。对于超图,其中v={v1,v2,...,vn}为学生节点集合,e={e1,e2,...,em}为超边集合。超图可以用关联矩阵h来表示,一条超边可连接多个节点,如果节点vi被ej连接,则h(i,j)=1。

[0046]

下面利用概念关联超图构建题目与知识概念之间的关系进行训练,其中网络的组成为:hgnnconv1→

relu

→

hgnnconv2→

relu

[0047]

概念关联超图的组成为:

[0048]

g=dv-1/2

*h*w*de-1

*h

t

*dv-1/2

[0049]

x1=relu(hgnnconv1(x,g))

[0050]

x2=relu(hgnnconv2(x1,g))

[0051]

其中,dv和de分别为节点和超边的度矩阵,w代表每个点的权重矩阵(默认为1)。经过两层超图卷积网络,最后得到的x2就是题目的表示

[0052]

有向转移图编码

[0053]

除了答题交互与知识概念关联外,答题交互的顺序路径也是知识追踪的重要因素,但在以往的研究中尚未充分探讨。从直观上看,学生连续两次的互动更容易在变化不大的知识状态下被触发。基于此,本发明采用有向转移图dtg对答题交互之间的转移路径进行建模。在任何学生的答题序列中假如学生答题序列是{v1,v2},即答完第一题后回答第二题,则在邻接矩阵中体现为 a(v1,v2)=1。用gt=(v,e)表示dtg,其邻接矩阵为:

[0054][0055]

对于每道题,它既是上一题的未来答题序列,同时也是下一题的最邻近历史答题序列,所以应当同时考虑它的出度和入度两种情况,即:

[0056][0057]

有向转移图是对所有的答题路径上的交互节点作为有向图的节点,可以得到答题交互节点之间的转移信息。与

①

类似的,有向转移图由两层卷积 graph_conv1和graph_conv2,表现答题序列的邻接矩阵adj组成。

[0058]

该网络的组成为:

[0059]

x1=relu(graph_conv1(x,adj))

[0060]

x2=relu(graph_conv2(x1,adj))

[0061]

图神经网络也是一个神经网络层,它的层与层之间的传播方式是:

[0062]h(l 1)

=σ(dv-1/2

*adj*dv-1/2

*h

(l)

*w

(l)

)

[0063]

其中dv是节点的度矩阵,w代表每个点的权重矩阵(默认为1)最后得到x2 即题目的表示

[0064]

得到两种题目的编码表示及之后,通过torch.cat()函数将得到的两种编码表示并列融合得到新的编码表示作为下一步模型的输入, 其具体融合方式是(其中[]表示融合拼接操作):

[0065][0066]

(3)门控循环单元gru建模

[0067]

解决每个学生答题数目长短不一的问题,设置步长为50(不足50的利用零填充补齐),每50道题为一组,与“独热编码”得到的题目表示内积,可得到当前50道题目的双图神经网络编码后的表示,输入到门控循环单元gru中,将得到的输出映射成2n维的表示即可得到每道题答对的概率。

[0068]zt

=σ(wzx

t

u

zht-1

)

[0069]rt

=σ(wrx

t

u

rht-1

)

[0070][0071][0072]

(4)预测、损失计算与优化函数

[0073]

在gru中得到的h

t

与权重矩阵w

yh

,偏置by运算,经过sigmoid 函数σ后得到y

t

,y

t

是

包含2n道题目(包含答对和答错两种情况) 的矩阵,每道题对应答对的概率(0-1之间)。

[0074]

yt=σ(w

yh

ht by)

[0075]

将y

t

预测值大于等于0.5的认为会答对下道题(即q

t 1

=1),将小于 0.5的认为答错(q

t 1

=0)。与真实的(q

t 1

,a

t 1

)进行对比,计算损失loss并用adam优化函数优化。

[0076][0077]

对本实施方法进行仿真验证,图1为本发明在公开数据集assist2009、 assist2017和ednet上的性能,并与现有的4种深度知识追踪建模方法(分别记为dkt、dkvmn、sakt、akt)进行了比较,可以看出本发明的方法性能较好。本发明利用auc指标来衡量各方法的性能,其中,auc(area under curve)是衡量模型方法性能的一种常用指标,它的含义是roc曲线下与坐标轴围成区域的面积。

[0078]

实施例二:基于双图神经网络的知识追踪建模系统

[0079]

在一个或多个实施方式中,公开了一种终端设备,包括服务器,所述服务器包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现实施例一中的基于双图神经网络的知识追踪建模方法。为了简洁,在此不再赘述。应理解本实施例中处理器可以是中央处理单元cpu,处理器还可以是其他通用处理器、数字信号处理器dsp、专用集成电路asic,现成可编程门阵列fpga或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等。通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等。存储器可以包括只读存储器和随机存取存储器,并向处理器提供指令和数据、存储器的一部分还可以包括非易失性随机存储器。例如,存储器还可以存储设备类型的信息。在实现过程中,上述方法的各步骤可以通过处理器中的硬件的集成逻辑电路或者软件形式的指令完成。实施例一中的基于双图神经网络的知识追踪建模方法可以直接体现为硬件处理器执行完成,或者用处理器中的硬件及软件模块组合执行完成。软件模块可以位于随机存储器、闪存、只读存储器、可编程只读存储器或者电可擦写可编程存储器、寄存器等本领域成熟的存储介质中。该存储介质位于存储器,处理器读取存储器中的信息,结合其硬件完成上述方法的步骤。为避免重复,这里不再详细描述。本领域普通技术人员可以意识到,结合本实施例描述的各示例的单元即算法步骤,能够以电子硬件或者计算机软件和电子硬件的结合来实现。这些功能究竟以硬件还是软件方式来执行,取决于技术方案的特定应用和设计约束条件。专业技术人员可以对每个特定的应用来使用不同方法来实现所描述的功能,但是这种实现不应认为超出本技术的范围。上述虽然结合附图对本发明的具体实施方式进行了描述,但并非对本发明保护范围的限制,所属领域技术人员应该明白,在本发明的技术方案的基础上,本领域技术人员不需要付出创造性劳动即可做出的各种修改或变形仍在本发明的保护范围以内。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。