1.本发明涉及家具设计技术领域,具体涉及一种基于深度学习与三维重建的家具设计系统。

背景技术:

2.基于多视角图像的三维重建因其数据获取的便捷性以及更高的实用性而一直是三维重建领域的一个重要研究方向。目前,基于多视角图像的三维重建最常用方法是利用基于运动恢复结构(structure from motion,sfm)算法完成特征提取与匹配、相机标定与稀疏重建,然后利用几何与光学一致性等传统方法完成稠密重建,最后对模型进行表面重建与纹理重建。申请号为202210120008.6,发明名称为基于三维重建的虚拟家居设计系统便采用了该方法。该方法虽然计算相对简单、对硬件要求相对较低,但重建精度不高,且由于传统的特征点提取与匹配算法往往精度有限,导致该方法在对室内的家具这类弱纹理物体或无纹理物体,以及光线变化较剧烈的环境中的物体的三维重建近乎无能为力。

3.申请号为201910701784.3,发明名称为一种基于神经网络的图像三维模型构建方法及装置,在进行基于多视角图像的三维重建时,首先利用二维cnn提取单幅二维图像的图像特征;将原始网格模型的三维坐标与所述单幅图像特征拼接为图结构的顶点特征向量;利用gcn对所述图结构的顶点特征向量进行卷积变形,获得新顶点及对应的三维坐标;根据新顶点的三维坐标获得三维模型;然后对所有图像依次重复以上步骤获得多个三维模型;最后将所有三维模型融合获得最终的三维模型。该方法虽然利用神经网络取得了较好的重建效果,但对每幅图像都进行一次重建,计算复杂度过高且效率较低。

4.申请号为202111527159.5,发明名称为一种基于单目rgb的室内三维重建方法及其系统,由于其数据提取方式为从视频数据中提取关键帧,因此本质为多视角图像的三维重建。该方法首先采集连续的影像视频流并采用角点检测算法以及光流跟踪算法进行特征点提取与匹配,同时提取关键帧,并且用多视觉立体几何得到关键帧实时的位姿信息;然后用预先训练好的深度神经网络从获取的关键帧中预测出深度图;再对深度图进行尺度矫正,得到矫正后的深度图;最后将关键帧实时的位姿信息与矫正后的深度图进行融合,重建出室内三维模型。该方法引入神经网络进行深度估计,能够取得较好的效果且降低了计算的复杂度,但其数据源使用视频数据,且特征点检测与匹配使用的角点检测算法以及光流跟踪算法,导致特征点检测与匹配精度较低;而且该方法没有对图像进行畸变矫正,深度估计值容易出现错误。

技术实现要素:

5.本发明针对现有技术重建精度不高、特征点检测与匹配精度较低、深度估计值容易出现错误且复杂度过高、效率较低的技术问题,而提出了一种基于深度学习与三维重建的家具设计系统,该系统利用多视图三维重建技术,通过一个满足特定要求的图像序列重建出家具的三维模型,避免了多次重建的重复运算,再通过提供修改该模型的基本参数与

外观的功能,满足人们通过一种较为简单的方式进行基本的家具设计的需求,为了适应室内环境下光照条件变化剧烈、家具纹理弱或无纹理的特点,通过基于多视图几何与深度神经网络的三维重建技术对目标家具进行三维重建,构建目标家具的三维模型,本发明采用如下具体技术方案:

6.一种基于深度学习与三维重建的家具设计系统,包括:

7.用户个人家具数据库,包括用户个人保存的家具三维模型以及家具装扮;

8.图像输入模块,用户将一组满足要求的图像序列通过图像输入模块输入本系统;

9.图像处理模块,与图像输入模块相连接,用于接收所述图像输入模块发来的图像序列,并使用语义分割模型对所述图像序列中的图像依次进行背景去除处理,获得去除了背景的图像,并发送给家具建模模块;

10.家具建模模块,与图像处理模块相连接,用于接收所述图像处理模块发来的若干图像,然后使用基于多视图几何与深度神经网络的三维重建技术构建出家具的三维模型,再将该家具的三维模型发送给家具模型设计模块;

11.家具模型设计模块,与家具建模模块相连,用于接受所述家具建模模块发送来的家具三维模型并进行展示,同时向用户提供调整家具三维模型的部分参数及装扮的功能,以及切割、增添、组合家具三维模型的功能,用户完成设计后,将家具三维模型发送给服务器存储模块;

12.服务器存储模块,与家具建模模块相连,用于接收家具建模模块发来的家具三维模型,并将所述家具三维模型保存至用户个人家具数据库。

13.进一步地,所述通过图像输入模块输入的目标家具的图像序列,该图像序列中应有一个或多个子图像序列,每个子图像序列中,所有图像的拍摄高度应当尽量相同且在水平方向上相邻的两张图片应当有重合的目标家具的细节;对于所有的图像,目标家具应当尽可能地在图像中完整出现且占整张图像的画面比例尽量高。

14.优选地,使用语义分割模型对所述图像序列依次进行背景去除处理,具体包括以下步骤:

15.对于单张图像,使用基于mask r-cnn深度神经网络的语义分割模型,检测出该图像中的所有语义目标及其对应的像素位置;在该图像上增添一个图层,在该图层上将所有目标对应的像素覆盖上颜色,用不同的颜色覆盖不同的语义目标;

16.提取上述图层中面积最大的颜色区域对应的所有原图像的像素,按照像素在原图像的位置保存为一张新的图像,即为所述去除了背景的图像。

17.优选地,使用基于多视图几何与深度神经网络的三维重建技术构建出家具的三维模型,具体包括以下步骤:

18.步骤(1)对所有去除了背景的图像,采用改进的harris-sift算法进行特征点提取与匹配;

19.步骤(2)采用sfm方法,对去除了背景的图像对应的原图像的相机进行自标定,并求得目标家具的稀疏点云,获得相关中间参数;所述相关中间参数包括相机内部参数、相机外部参数、所有去除了背景的图像的二维特征与三维空间点的对应信息,以及三维空间点在世界坐标系下的坐标、rgb值与在各个去除了背景的图像上的轨迹;

20.步骤(3)对所有去除了背景的图像进行畸变矫正;

21.步骤(4)利用几何与光学算法计算出初始估计深度范围;

22.步骤(5)利用训练好的一种基于级联r-mvsnet深度神经网络,进行深度预测,并计算出所有畸变矫正后的图像对应的深度图,再利用深度图融合技术进行点云的稠密重建,获得稠密点云;

23.步骤(6)对稠密点云采用泊松表面重建算法进行表面重建,获得目标家具的三角面片模型;

24.步骤(7)对所述三角面片模型进行纹理重建,获得目标家具的三维模型。

25.优选地,步骤(1)中采用改进的harris-sift算法进行特征点提取与匹配的具体步骤为:

26.步骤(1.1)对彩色的目标家具图像进行灰度化处理;

27.步骤(1.2)采用harris角点检测算法对灰度化后的目标家具图像进行角点提取,获得图像特征角点集;

28.步骤(1.3)采用sift算法对灰度化后的目标家具图像中的关键点进行定位,得到关键点集;

29.步骤(1.4)将通过harris算法获得的图像特征角点集与通过sift算法获得的关键点集合并,剔除重复点及对尺度变化不稳定的点,获得特征点集;

30.步骤(1.5)确定每个特征点的主方向,并为每个特征点生成128维的特征描述符;

31.步骤(1.6)对所有目标家具图像使用上述方法提取特征点;

32.步骤(1.7)在所有目标家具图像间两两进行特征点匹配,得到精确匹配点集,具体步骤如下:

33.计算出两幅图像之间的每个特征点之间的马氏距离:

[0034][0035]

s=e{[x-e(x)][y-e(y)]}

[0036]

式中,dm

xy

为特征点之间的马氏距离,x、y分别为特征点的坐标向量,s为两组向量的协方差矩阵,s-1

为协方差逆矩阵,e为均值;

[0037]

计算出距离后,在两幅图像中找到马氏距离最近的两个特征点,采用下列公式决定是否接受该对匹配点:

[0038][0039]

式中,dm1、dm2分别为两个特征点的马氏距离,且dm1《=dm2;如果dm1与dm2的比值小于阈值ε,则接受该对匹配点,并将该对匹配点加入初始匹配点集;在所有图像之间重复以上步骤,得到初始匹配点集;

[0040]

采用随机抽样一致性ransac算法对得到的初始匹配点集进行进一步提纯,得到精确匹配点集。

[0041]

进一步地,步骤(1.5)的具体做法如下:

[0042]

首先计算出所有特征点的邻域范围内像素点的梯度方向和梯度的模值,可表示为:

[0043]

[0044][0045]

式中,x、y为像素点的坐标,m(x,y)为(x,y)处梯度的模值,θ(x,y)为(x,y)处梯度的方向,l(x,y)为邻域窗口内的采样点;

[0046]

统计特征点邻域内像素的梯度幅值和方向,获得邻域梯度直方图,取邻域梯度直方图的峰值为特征点处邻域梯度的主方向,即作为该特征点的方向;

[0047]

对特征点周围图像区域分块,计算块内梯度直方图,生成128维特征描述符。

[0048]

进一步地,步骤(5)利用训练好的一种级联r-mvsnet深度神经网络,计算出所有去除了背景的图像所对应的深度图的具体做法是:

[0049]

步骤(5.1)对所有经过畸变矫正后的目标家具图像,通过一层卷积进行降采样,通过调整卷积核的步长,获得不同分辨率的多个初始图像集pic0~picm,所有经过畸变矫正后的目标家具图像通过同样的一个卷积层得到的图像组成一个所述初始图像集,一个所述初始图像集中的初始图像分辨率相同;

[0050]

步骤(5.2)按照分辨率由小到大对所有初始图像集分别利用r-mvsnet深度神经网络进行深度预测,获得各自对应深度图集,在深度预测时,首个初始图像集中初始图像的估计深度范围采用几何与光学算法计算得到的估计深度范围,之后其他初始图像集中初始图像的估计深度范围采用上一个初始图像集中对应的初始图像通过r-mvsnet神经网络计算得到的估计深度范围;

[0051]

步骤(5.3)取最后一个初始图像集计算得到的深度图集作为最终采用的深度图集。

[0052]

进一步地,步骤(5.2)中利用r-mvsnet深度神经网络进行深度预测的具体做法为:

[0053]

步骤(5.2.1)对输入的初始图像集picm,通过resnet神经网络对其中的初始图像进行深度特征抽取,输出32通道的深度特征图集depm;

[0054]

步骤(5.2.2)利用平面扫描算法,选择深度特征集depm中未构造三维代价体的一幅深度特征图i_ref,,根据估计深度范围scope构建i_ref对应的相机锥体,并将深度特征图集depm中与i_ref最相似的j幅深度特征图通过单应性矩阵投影至所述相机锥体的不同深度平面上,获得与深度特征图i_ref对应的j个特征体v,对所有的特征体,采用下列公式构造三维代价体:

[0055][0056]

其中,c为三维代价体,vi为第i个特征体,为所有特征体的均值,j为特征体的总数;

[0057]

步骤(5.2.3)沿深度方向分割三维代价体,得到不同深度上的代价图集map;

[0058]

步骤(5.2.4)利用gru的递归正则化方法对代价空间进行处理,得到单通道的正则化代价图集cr;

[0059]

步骤(5.2.5)将每个深度上正则化处理的代价图结合形成一个过滤后代价体,再利用softmax计算得到概率体p;

[0060]

步骤(5.2.6)沿着概率体p的深度方向,以深度期望值作为该像素的深度估计值,

具体公式如下:

[0061][0062]

其中,表示该像素的深度估计值,分别表示在概率体p的深度方向上取得的深度及其最大值与最小值,表示特征l在深度的置信度;

[0063]

步骤(5.2.7)利用多视角光学一致性对深度图进行进一步的优化,获得优化深度图;

[0064]

步骤(5.2.8)重复步骤(5.2.2)~(5.2.7)至深度特征集depm中所有深度特征图都完成三维代价体的构建,即获得初始图像集picm对应的深度图集。

[0065]

进一步地,在对所述级联r-mvsnet深度神经网络进行训练时,通过概率体p与基于深度图与独热编码生成的占据空间q进行交叉熵计算来得到模型的损失:

[0066][0067]

其中p指的是图像坐标系中的空间坐标(深度图上的x,y),k指的是不同深度层,p(k,p)为概率体p中的一个体素,q(k,p)指的是占据空间q中与p(k,p)对应的一个体素,d指的是深度层的总数。

[0068]

进一步地,所述家具三维模型的部分参数包括家具三维模型的整体长、整体宽与整体高,所述家具三维模型的装扮包括家具三维模型的贴图和纹理。

[0069]

本发明的有益效果为:

[0070]

本发明通过一种改进的harris-sift算法进行特征点提取与匹配,通过合并harris角点检测算法以及sift算法的特征点检测结果,同时结合了harris角点检测算法的稳定性以及sift算法的精确性,能够在弱纹理图像、无纹理图像或者光照条件剧烈变化图像中进行,相比于原有harris-sift算法能更加精确的特征点提取与匹配。

[0071]

本发明通过一种基于级联r-mvsnet深度神经网络的深度估计方法,提高三维重建精度,尤其是提升对弱纹理物体、无纹理物体或者光照条件剧烈变化区域中的物体的三维重建能力,同时在神经网络计算时利用估计深度范围保证深度图的尺度正确;采用级联思想以及循环神经网络中的gru方法,在保证精确度的同时降低3d-cnn、gcn等传统神经网络应用于深度估计与三维重建时过高的硬件配置需求;利用sgm算法实现r-mvsnet深度神经网络初始所需输入参数的自动计算,解决了现有技术复杂度过高、效率较低的技术问题。

[0072]

本发明在利用基于级联r-mvsnet深度神经网络的深度估计方法时,通过先验估计深度范围对深度估计进行约束,降低了尺度误差,同时避免了额外的尺度矫正。

[0073]

本发明通过计算机视觉将2d图像转换成较为逼真的三维模型,并允许用户对家具三维模型进行再设计,满足用户通过一种便捷、低使用门槛的方式进行家具设计的需求,帮助用户更好地进行家具选择以及房屋装修。同时家具厂商可选择入驻商城平台,以向消费者销售、展示自己设计生产的家具以及家具三维模型,促进产品的销售。

附图说明

[0074]

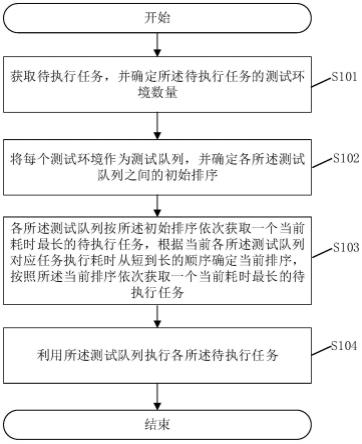

图1为本系统的整体框架图;

[0075]

图2为基于多视图几何与深度神经网络的三维重建技术流程;

[0076]

图3为改进的harris-sift算法流程;

[0077]

图4为级联r-mvsnet深度神经网络进行深度图计算流程。

[0078]

图5展示了用户将图片输入系统的界面;

[0079]

图6展示了图像序列的中的部分图像;

[0080]

图7展示了稠密重建结果;

[0081]

图8展示了表面重建结果;

[0082]

图9展示了纹理重建结果;

[0083]

图10展示了图像匹配结果。

具体实施方式

[0084]

如图1所示,一种基于深度学习与三维重建的家具设计系统,包括:

[0085]

用户个人家具数据库,所述用户个人家具数据库包括用户个人保存的家具三维模型以及用户个人保存的家具装扮;家具三维模型的部分参数,包括家具三维模型的整体长、整体宽与整体高,所述家具三维模型的装扮,为家具三维模型的贴图、纹理。

[0086]

图像输入模块,用户将一组满足特定要求的图像序列通过所述图像输入模块输入本系统,如图5所示;通过图像输入模块输入的目标家具的图像序列,该图像序列中应有一个或多个子图像序列,如图6所示,每个子图像序列中,所有图像的拍摄高度应当尽量相同,且在水平方向上相邻的两张图片应当有重合的目标家具的细节。对于所有的图像,目标家具应当尽可能地在图像中完整出现且占整张图像的画面比例尽量高。

[0087]

图像处理模块,所述图像处理模块与图像输入模块相连接,用于接收所述图像输入模块发来的图像序列,并使用语义分割模型对所述图像序列中的图像依次进行背景去除处理,获得去除了背景的图像,并发送给家具建模模块;

[0088]

使用语义分割模型对所述若干图像依次进行背景去除处理,具体包括以下步骤:

[0089]

对于单张图像,使用基于mask r-cnn深度神经网络的语义分割模型,检测出该图像中的所有语义目标及其对应的像素位置;

[0090]

在该图像上增添一个图层,在该图层上将所有目标对应的像素覆盖上颜色,覆盖不同的语义目标所用的颜色也是不同的;

[0091]

提取所述图层上面积最大的颜色区域对应的所有原图像的像素,按照像素在原图像的位置保存为一张新的图像,即为所述去除了背景的图像。

[0092]

家具建模模块,所述家具建模模块与图像处理模块相连接,用于接收所述图像处理模块发来的若干图像,然后根据所述若干图像使用基于多视图几何与深度神经网络的三维重建技术构建出家具的三维模型,再将该家具的三维模型发送给家具模型设计模块;

[0093]

如图2,使用基于多视图几何与深度神经网络的三维重建技术构建出家具的三维模型,具体包括以下步骤:

[0094]

步骤(1)对所有去除了背景的图像,采用改进的harris-sift算法进行特征点提取与匹配;具体步骤为如图3所示:

[0095]

步骤(1.1)对彩色的目标家具图像利用直方图均衡化算法进行灰度化处理,使图像灰度级分布更均匀,从而增强图像的细节信息;

[0096]

步骤(1.2)采用harris角点检测算法对灰度化后的目标家具图像进行角点提取,

获得图像特征角点集,角点提取公式如下:

[0097]

m(x,y)=det[h(x,y)]-cons

·

{tr[h(x,y)]}2[0098]

式中,(x,y)为像素点坐标,m(x,y)为角点响应函数,h为hessian矩阵,tr(h)为矩阵h的迹,det(h)为矩阵h的行列式值,cons为常量,本系统取cons=0.04,角点响应函数的局部极大值点即为角点。

[0099]

步骤(1.3)采用sift算法对灰度化后的目标家具图像中的关键点进行定位,得到关键点集;

[0100]

步骤(1.4)将通过harris算法获得的图像特征角点集与通过sift算法获得的关键点集合并,剔除重复点及对尺度变化不稳定的点,获得特征点集;

[0101]

步骤(1.5)确定每个特征点的主方向,并为每个特征点生成128维的特征描述符,具体步骤如下:

[0102]

首先计算出所有特征点的3

×

1.5σ(σ指尺度空间因子)邻域范围内像素点的梯度方向和梯度的模值,可表示为:

[0103][0104][0105]

式中,x、y为像素点的坐标,m(x,y)为(x,y)处梯度的模值,θ(x,y)为(x,y)处梯度的方向,l(x,y)为邻域窗口内的采样点;

[0106]

采用尺度为1.5σ的高斯函数加权统计特征点邻域内像素的梯度幅值和方向,获得邻域梯度直方图,取邻域梯度直方图的峰值为特征点处邻域梯度的主方向,即作为该特征点的方向;

[0107]

对特征点周围图像区域按照4

×

4分块,计算块内梯度直方图,生成128维特征描述符。

[0108]

步骤(1.6)对所有目标家具图像使用上述方法提取特征点;

[0109]

步骤(1.7)在所有目标家具图像间两两进行特征点匹配,得到精确匹配点集,具体步骤如下:

[0110]

计算出两幅图像之间的每个特征点之间的马氏距离:

[0111][0112]

s=e{[x-e(x)][y-e(y)]}

[0113]

式中,dm

xy

为特征点之间的马氏距离,x、y分别为特征点的坐标向量,s为两组向量的协方差矩阵,s-1

为协方差逆矩阵,e为均值;

[0114]

计算出距离后,在两幅图像中找到马氏距离最近的两个特征点,采用下列公式决定是否接受该对匹配点:

[0115][0116]

式中,dm1、dm2分别为两个特征点的马氏距离,且dm1《=dm2;如果dm1与dm2的比值小于阈值ε,则接受该对匹配点,并将该对匹配点加入初始匹配点集。在本实施例中,取ε为0.8。

[0117]

在所有图像之间重复以上步骤,得到初始匹配点集;

[0118]

采用随机抽样一致性(ransac)算法对得到的初始匹配点集进行进一步提纯,得到精确匹配点集,以图6所示的图像序列中的两张图片为例,得到的匹配结果如图10所示。

[0119]

步骤(2)采用sfm方法,利用小孔相机模型对拍摄的去除了背景的图像对应的原图像的相机进行自标定,求得相机内部参数,然后利用内部参数求得相机外部参数,并进一步求出相机位姿,然后求得目标家具的稀疏点云,获得相关中间参数。所述相关中间参数包括相机内部参数、相机外部参数、所有去除了背景的图像的二维特征与三维空间点的对应信息,以及三维空间点在世界坐标系下的坐标、rgb值与在各个去除了背景的图像上的轨迹;

[0120]

步骤(3)对所有去除了背景的图像利用张正友标定法进行畸变矫正;

[0121]

步骤(4)利用几何与光学算法计算出初始估计深度范围;为了保证算法的实时性与精确性,采用sgbm算法,具体步骤为:

[0122]

步骤(4.1)采用水平sobel算子,对经过畸变矫正的目标家具图像进行预处理,然后将预处理后的图像映射成一个新的图像,该新的图像包含了原图像的梯度信息,预处理公式为:

[0123]

sobel(x,y)=2[pix(x 1,y)-pix(x-1,y)] pix(x 1,y-1)-pix(x-1,y-1) pix(x 1,y 1)-pix(x-1,y 1)

[0124]

其中,x,y为像素点的坐标,pix表示坐标为(x,y)的像素点的像素值;

[0125]

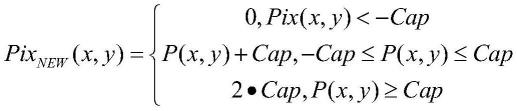

映射函数为:

[0126][0127]

其中,pix

new

表示新图像上的像素值,cap为一个常数参数,表示sobel滤波时的截断值,此处取63;

[0128]

步骤(4.2)对经过预处理与映射得到的新的图像以及原图像分别逐像素地计算bt代价并将两图像的bt代价取和,得到融合bt代价,再对融合bt代价进行成块处理,即对每个像素的代价值用周围邻域代价值的总和来代替;

[0129]

步骤(4.3)对于每个像素pix,在每个方向上进行代价累积,然后将各个方向上的匹配代价相加得到总的匹配代价,选择使总的匹配代价最小的视差dp作为像素p的最终视差,对所有像素均计算完毕后即得到初始视差图,代价累积如下式所示:

[0130][0131]

式中lr(pix,dp)为像素pix,在视差为dp时在方向r上累积的代价,pun1、pun2为像素点与相邻点视差存在较小和较大差异情况下的平滑惩罚,且pun1《pun2,pun1与pun2各自的公式如下:

[0132]

pun1=8

·

cn

·

square;

[0133]

pun2=32

·

cn

·

square;

[0134]

cn是图像的通道数,square是sad窗口面积,由于cn与square在本系统中均是确定且统一的,因此pun1与pun2均可视为常数;总的匹配代价计算公式如下:

[0135]

s(pix,d)=∑rlr(pix,dp)

[0136]

s(pix,d)代表对于像素pix,视差为dp时的总的匹配代价;

[0137]

步骤(4.4)对步骤(4.3)计算得到的初始视差图进行后处理,后处理包括唯一性检测、亚像素插值以及左右一致性检测。

[0138]

唯一性检测:当视差窗口范围内最低代价是次低代价的(1 ratio/100)倍时,最低代价对应的视差值才是该像素点的视差,否则该像素点的视差为0。其中ratio是一个常数参数,唯一性检测避免算法中经常遇到的局部最优解问题

[0139]

亚像素插值:对于误匹配区域的像素点,利用其周围像素进行内插值,从而让物体表面视差更加的平滑;

[0140]

左右一致性检测:对左图计算一个视差图后,对右图计算一个视差图,然后进行一致性校验,其中,左右图关系由图像对应的相机位姿决定,通过左右一致性检测确保唯一性约束。

[0141]

步骤(4.5)将经过后处理的视差图转化为深度图,取深度图上的最大深度与最小深度组成初始估计深度范围转换公式如下:

[0142][0143]

是深度,b是双目相机的光心间距(基线长度),f是相机焦距,d是视差值。

[0144]

步骤(5)利用训练好的一种基于级联r-mvsnet深度神经网络进行深度预测,并计算出所有畸变矫正后的图像对应的深度图,再根据所有深度图利用深度图融合技术进行点云的稠密重建,获得稠密点云,如图7所示;

[0145]

如图4,利用训练好的一种级联r-mvsnet深度神经网络,计算出所有去除了背景的图像所对应的深度图的具体做法是:

[0146]

步骤(5.1)对所有经过畸变矫正后的目标家具图像,通过一层卷积进行降采样,通过将卷积核的步长分别设置为1、2、3、4,获得分辨率由高到低的四个初始图像集pic0~picm,所有经过畸变矫正后的目标家具图像通过同样的一个卷积层得到的图像组成一个所述初始图像集,一个所述初始图像集中的初始图像分辨率相同;

[0147]

步骤(5.2)按照分辨率由小到大对所有初始图像集分别利用r-mvsnet深度神经网络进行深度预测,获得各自对应深度图集,在深度预测时,首个初始图像集中初始图像的估计深度范围采用几何与光学算法计算得到的估计深度范围,之后其他初始图像集中初始图像的估计深度范围采用上一个初始图像集中对应的初始图像通过r-mvsnet神经网络计算得到的估计深度范围;

[0148]

步骤(5.3)取最后一个初始图像集计算得到的深度图集作为最终采用的深度图集。

[0149]

利用训练好的一种基于级联r-mvsnet深度神经网络进行深度预测,具体步骤为:

[0150]

步骤(5.2.1)对输入的初始图像集picm,通过resnet神经网络对其中的初始图像进行深度特征抽取,输出32通道的深度特征图集depm;

[0151]

步骤(5.2.2)利用平面扫描算法,选择深度特征集depm中未构造三维代价体的一幅深度特征图i_ref,,根据估计深度范围scope构建i_ref对应的相机锥体,并将深度特征图集depm中与i_ref最相似的j幅深度特征图通过单应性矩阵投影至所述相机锥体的不同

深度平面上,获得与深度特征图i_ref对应的j个特征体v,对所有的特征体,采用下列公式构造三维代价体:

[0152][0153]

其中,c为三维代价体,vi为第i个特征体,为所有特征体的均值,j为特征体的总数;

[0154]

步骤(5.2.3)沿深度方向分割三维代价体,得到不同深度上的代价图集map;

[0155]

步骤(5.2.4)利用gru的递归正则化方法对代价空间进行处理,得到单通道的正则化代价图集cr,具体步骤如下:先将代价图集map中某个深度下32通道的代价图经过卷积作用变为16通道的代价图集,而后利用三层输出通道数依次为16,4,1的gru单元对代价图集进行连续处理,当代价图集map中所有深度的代价图均通过以上步骤处理后,即得到单通道的正则化代价图集。

[0156]

步骤(5.2.5)将每个深度上经过正则化处理的代价图结合形成一个过滤后代价体,再利用softmax计算得到概率体p;

[0157]

步骤(5.2.6)沿着概率体p的深度方向,以深度期望值作为该像素的深度估计值,具体公式如下:

[0158][0159]

其中,表示该像素的深度估计值,分别表示在概率体p的深度方向上取得的深度及其最大值与最小值,表示特征l在深度的置信度;

[0160]

步骤(5.2.7)利用多视角光学一致性对深度图进行进一步的优化,获得优化深度图,具体来讲,利用参考视图下的深度将某个视角下的图像ii投影到参考视图下,并计算参考视图下的重投影误差:

[0161][0162]

其中,pix

deep

为像素,pix

′

deep

为邻域像素,i1为参考图像,ii→1为某个视角下的图像在参考图像上的重投影图像,为像素间的光度误差、为深度平滑误差、cl(i1(pix

deep

),ii→1(pix

deep

))为颜色一致性项,为邻域的双边平方深度差。

[0163]

根据误差对深度图进行误差修正,即可得到优化深度图;

[0164]

步骤(5.2.8)重复步骤(5.2.2)~(5.2.7)至深度特征集depm中所有深度特征图都完成三维代价体的构建,即获得初始图像集picm对应的深度图集。

[0165]

在对所述级联r-mvsnet深度神经网络进行训练时,通过概率体p与基于深度图与独热编码生成的占据空间q进行交叉熵计算来得到模型的损失:

[0166][0167]

其中p指的是图像坐标系中的空间坐标(深度图上的x,y),k指的是不同深度层,p(k,p)为概率体p中的一个体素,q(k,p)指的是与p(k,p)对应的占据空间q中的一个体素,d指的是深度层的总数。

[0168]

步骤(6)对稠密点云采用泊松表面重建算法进行表面重建,获得目标家具的三角面片模型,如图8所示;

[0169]

步骤(7)对所述三角面片模型进行纹理重建,获得目标家具的三维模型,如图9所示。

[0170]

家具模型设计模块,所述家具模型设计模块与家具建模模块相连,用于接受所述家具建模模块发送来的家具三维模型并进行展示,同时向用户提供调整家具三维模型的部分参数及装扮的功能,以及切割、增添、组合家具三维模型的功能,用户完成设计后,将家具三维模型发送给服务器存储模块;切割家具三维模型的功能,可通过删除稠密点云中的三维点,然后重新进行表面重建与纹理重建实现,所述增添、组合家具三维模型的功能,可通过导入其他家具三维模型,然后调整展示界面中所有家具三维模型的坐标至展示界面中所有家具三维模型均有重合部分来实现。

[0171]

服务器存储模块,所述服务器存储模块与家具调整模块相连,用于接收家具调整模块发来的家具三维模型,并将所述家具三维模型保存至用户个人家具数据库。

[0172]

商城模块,所述商城模块用于用户向家具厂商购买实物家具、向家具厂商订做家具、发布或购买家具三维模型、发布或购买家具装扮。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。