1.本发明涉及情感识别领域,特别是涉及一种情感识别模型的训练方法,本发明还涉及一种情感识别模型及其训练装置、设备及计算机可读存储介质。

背景技术:

2.情感识别是现下可应用于医疗保健,自动驾驶,情绪安抚,机器人等众多领域中的热门应用,由于人机交互方式的丰富,现在情感识别应用中的数据来源也呈现出多样化的趋势,情感识别可以从文本、音频、视频以及脑电等类型的数据源中识别出用户的情绪(例如开心或者伤心等)。

3.领域内已经出现多种情感识别模型,但是这些模型在训练过程中,一般都是将模型预测的输出和原始数据实际的标签进行情感学习损失函数的度量,这种度量方式虽然直接有效,但是也存在为了判别而判别的风险,即模型的目标只是为了分类,而错误的标签也会参与模型的训练过程,从而导致训练出的情感识别模型进行情感识别的准确性较差。

4.因此,如何提供一种解决上述技术问题的方案是本领域技术人员目前需要解决的问题。

技术实现要素:

5.本发明的目的是提供一种情感识别模型的训练方法,由于聚类算法作为经典的无监督的学习方式,能够在不需要数据标签的情况下学习原始数据中潜在的特征表达并挖掘数据的本质特征,这种表达不带有主观的判别倾向,因此有利于提高情感分类的准确性;本发明的另一目的是提供一种情感识别模型及其训练装置、设备及计算机可读存储介质,由于聚类算法作为经典的无监督的学习方式,能够在不需要数据标签的情况下学习原始数据中潜在的特征表达并挖掘数据的本质特征,这种表达不带有主观的判别倾向,因此有利于提高情感分类的准确性。

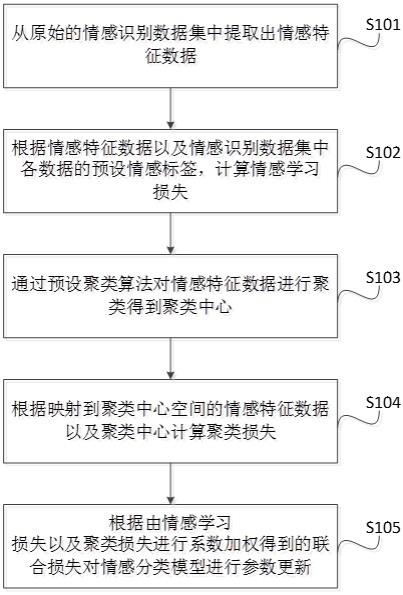

6.为解决上述技术问题,本发明提供了一种情感识别模型的训练方法,包括:从原始的情感识别数据集中提取出情感特征数据;根据所述情感特征数据以及所述情感识别数据集中各数据的预设情感标签,计算情感学习损失;通过预设聚类算法对所述情感特征数据进行聚类得到聚类中心;根据映射到聚类中心空间的所述情感特征数据以及所述聚类中心计算聚类损失;根据由所述情感学习损失以及所述聚类损失进行系数加权得到的联合损失对情感分类模型进行参数更新。

7.优选地,所述根据由所述情感学习损失以及所述聚类损失构建的联合损失对情感分类模型进行参数更新之后,该情感识别模型的训练方法还包括:判断所述情感分类模型是否满足预设的模型收敛条件;若是,则结束训练;

若否,则将所述情感识别数据集打乱顺序并执行所述从原始的情感识别数据集中提取出情感特征数据的步骤。

8.优选地,所述预设的模型收敛条件具体为迭代次数是否达到预设迭代次数。

9.优选地,所述从原始的情感识别数据集中提取出情感特征数据具体为:对原始的情感识别数据集进行预处理;从经过预处理后的所述情感识别数据集中提取出情感特征数据。

10.优选地,所述预处理包括去噪、去除异常样本以及归一化中的至少一者。

11.优选地,所述根据映射到聚类中心空间的所述情感特征数据以及所述聚类中心计算聚类损失具体为:;其中,为聚类损失,为k个维度为d的映射到聚类中心空间的所述情感特征数据,为由k个维度为d的聚类中心向量拼成的二维矩阵。

12.优选地,当所述情感识别数据集中各数据的标签为离散型,所述根据所述情感特征数据以及所述情感识别数据集中各数据的预设情感标签,计算情感学习损失具体为:基于所述情感特征数据,使用情感分类头部网络得到包含所述情感识别数据集中各数据的预测概率值的概率向量;根据所述概率向量以及所述情感识别数据集中各数据的预设情感标签,计算情感分类损失。

13.优选地,当所述情感识别数据集中各数据的标签为连续的浮点值,所述根据所述情感特征数据以及所述情感识别数据集中各数据的预设情感标签,计算情感分类学习损失具体为:基于所述情感特征数据,使用情感回归头部网络得到所述情感识别数据集中各数据的预测概率值;根据所述预测概率值以及所述情感识别数据集中各数据的预设情感标签,计算情感回归损失。

14.优选地,所述情感分类模型的结构相关的超参数通过随机搜索random search或网格搜索grid search确定。

15.优选地,所述情感分类模型具体为非均匀注意力模型或对话情感识别神经网络模型。

16.优选地,所述根据所述情感特征数据以及所述情感识别数据集中各数据的预设情感标签,计算情感学习损失之后,该情感识别模型的训练方法还包括:根据所述情感学习损失对情感分类模型进行参数预更新;则所述根据由所述情感学习损失以及所述聚类损失进行系数加权得到的联合损失对情感分类模型进行参数更新具体为:根据由所述情感学习损失以及所述聚类损失进行系数加权得到的联合损失,对预

更新后的所述情感分类模型进行参数更新。

17.为解决上述技术问题,本发明还提供了一种情感识别方法,应用于由如上所述情感识别模型的训练方法训练得到的情感识别模型。

18.为解决上述技术问题,本发明还提供了一种情感识别模型的训练装置,包括:提取模块,用于从原始的情感识别数据集中提取出情感特征数据;第一计算模块,用于根据所述情感特征数据以及所述情感识别数据集中各数据的预设情感标签,计算情感学习损失;聚类模块,用于通过预设聚类算法对所述情感特征数据进行聚类得到聚类中心;第二计算模块,用于根据映射到聚类中心空间的所述情感特征数据以及所述聚类中心计算聚类损失;更新模块,用于根据由所述情感学习损失以及所述聚类损失进行系数加权得到的联合损失对情感分类模型进行参数更新。

19.为解决上述技术问题,本发明还提供了一种情感识别模型的训练设备,包括:存储器,用于存储计算机程序;处理器,用于执行所述计算机程序时实现如上所述情感识别模型的训练方法的步骤。

20.为解决上述技术问题,本发明还提供了一种计算机可读存储介质,所述计算机可读存储介质上存储有计算机程序,所述计算机程序被处理器执行时实现如上所述情感识别模型的训练方法的步骤。

21.本发明提供了一种情感识别模型的训练方法,本技术可以通过预设聚类算法对情感特征数据进行聚类得到聚类中心,并结合映射到聚类中心空间的情感特征数据计算得到聚类损失,随后将聚类损失与情感学习损失进行系数加权得到联合损失并根据联合损失对情感分类模型进行参数更新,以便完成训练,由于聚类算法作为经典的无监督的学习方式,能够在不需要数据标签的情况下学习原始数据中潜在的特征表达并挖掘数据的本质特征,这种表达不带有主观的判别倾向,因此有利于提高情感分类的准确性。

22.本发明还提供了一种情感识别模型及其训练装置、设备及计算机可读存储介质,具有如上情感识别模型的训练方法相同的有益效果。

附图说明

23.为了更清楚地说明本发明实施例中的技术方案,下面将对现有技术和实施例中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

24.图1为本发明提供的一种情感识别模型的训练方法示意图;图2为本发明提供的另一种情感识别模型的训练方法的流程示意图;图3为本发明提供的一种情感识别模型的训练装置的结构示意图;图4为本发明提供的一种情感识别模型的训练设备的结构示意图。

具体实施方式

25.本发明的核心是提供一种情感识别模型的训练方法,由于聚类算法作为经典的无监督的学习方式,能够在不需要数据标签的情况下学习原始数据中潜在的特征表达并挖掘数据的本质特征,这种表达不带有主观的判别倾向,因此有利于提高情感分类的准确性;本发明的另一核心是提供一种情感识别模型及其训练装置、设备及计算机可读存储介质,由于聚类算法作为经典的无监督的学习方式,能够在不需要数据标签的情况下学习原始数据中潜在的特征表达并挖掘数据的本质特征,这种表达不带有主观的判别倾向,因此有利于提高情感分类的准确性。

26.为使本发明实施例的目的、技术方案和优点更加清楚,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

27.图1为本发明提供的一种情感识别模型的训练方法示意图,该情感识别模型的训练方法包括:s101:从原始的情感识别数据集中提取出情感特征数据;具体的,考虑到如上背景技术中的技术问题,又结合考虑到聚类作为经典的无监督的学习方式,能够在不需要数据标签的情况下,学习原始数据当中潜在的特征表达,这种表达不带有主观的判别倾向,而是从原始的数据中挖掘数据的本质特征。因此本技术欲通过聚类算法对情感特征数据进行聚类并计算出聚类损失,而后将聚类损失结合常规的情感分类损失得到联合损失,以便通过联合损失对情感分类模型进行参数更新,因此本步骤中可以首先从原始的情感识别数据集中提取出情感特征数据,以便将其作为后续步骤的数据基础。

28.其中,原始的情感识别数据集中可以包含多类具有情感标签的数据,每类均具有大量的数据。

29.具体的,提取情感特征数据的方法可以为多种,例如可以为包括但不限于卷积,全连接,循环神经网络以及resnet(deep residual network,深度残差网络)等,本发明实施例在此不做限定。

30.s102:根据情感特征数据以及情感识别数据集中各数据的预设情感标签,计算情感学习损失;具体的,一般的情感分类模型的训练方法中均会计算出情感学习损失,而本发明实施例需要在情感学习损失的基础上结合聚类损失,因此本发明实施例也需要首先根据情感特征数据以及情感识别数据集中各数据的预设情感标签,计算情感学习损失,并将其作为后续步骤的数据基础。

31.s103:通过预设聚类算法对情感特征数据进行聚类得到聚类中心;具体的,为了计算得到聚类损失,则需要首先通过预设聚类算法对情感特征数据进行聚类得到聚类中心,这些聚类中心就代表了不带任何判别倾向的数据原始表达,这些表达也在后续步骤中用来对情感分类模型的权重进行更新。

32.其中,值得一提的是,本发明实施例中的聚类中心的数目可以自主设定,无监督的思想导致了本发明方案中有关情感聚类样本空间的大小也需要沿袭原始聚类算法中的参

数设置,给参数需要根据不同的业务场景展开实质性的调整,这一调整过程和不同数据源,不同样本源的情感数据统计特性密切相关,在实际进行情感识别的过程中,可以通过反复的测试来最终确定聚类样本空间的大小,该大小和原始聚类算法中的聚类中心的数目是协同变化的。

33.s104:根据映射到聚类中心空间的情感特征数据以及聚类中心计算聚类损失;具体的,在计算得到聚类中心后,便可以根据映射到聚类中心空间的情感特征数据以及聚类中心计算聚类损失,为了从原始的样本特征和聚类中心进行损失度量,需要建立从原始的样本(情感特征数据)到聚类中心的重构映射,这个映射和传统的深度学习学习范式不同,在传统的深度学习中,最终都是每个样本和每个的真实标签进行对比,而在本发明提出的无监督的情感识别学习范式下,样本需要和无监督的聚类中心进行重构学习,这样的学习过程能够更好地对样本数据本身包含地情感语义进行表达学习,情感本身地模糊性也使得这种非判别式地重构训练能够更充分地表达数据特征。

34.其中,想要完成这样地一个重构训练过程,就需要构建从样本空间到聚类中心空间的映射,这个映射对深度学习中的样本数量维度进行了映射变换,相比之下,传统的都是对样本特征维度进行变换,本技术中的变换方式可以直接将原始特征所处的样本空间转化到聚类中心空间中,然后进行损失度量,进而通过反向传播,将重构信息更新到对应的网络权重当中。

35.s105:根据由情感学习损失以及聚类损失进行系数加权得到的联合损失对情感分类模型进行参数更新。

36.具体的,相比于现有技术,本技术中进行参数更新所用到的联合损失在情感学习损失的基础上与聚类损失进行了系数加权,也即利用更加能反映数据本质特征的聚类损失对情感学习损失进行了补偿,有利于使得训练得到的情感分类模型的分类更加准确。

37.具体的,本发明提出的训练方法可以普遍适用于各种模态的各种模型,即本发明的方法主要新颖之处在于训练方式,能够兼容当下的所有基于深度学习的情感识别方法。

38.本发明提供了一种情感识别模型的训练方法,本技术可以通过预设聚类算法对情感特征数据进行聚类得到聚类中心,并结合映射到聚类中心空间的情感特征数据计算得到聚类损失,随后将聚类损失与情感学习损失进行系数加权得到联合损失并根据联合损失对情感分类模型进行参数更新,以便完成训练,由于聚类算法作为经典的无监督的学习方式,能够在不需要数据标签的情况下学习原始数据中潜在的特征表达并挖掘数据的本质特征,这种表达不带有主观的判别倾向,因此有利于提高情感分类的准确性。

39.为了更好地对本发明实施例进行说明,请参考图2,图2为本发明提供的一种情感识别模型的训练方法示意图,在上述实施例的基础上:作为一种优选的实施例,根据由情感学习损失以及聚类损失构建的联合损失对情感分类模型进行参数更新之后,该情感识别模型的训练方法还包括:s206:判断情感分类模型是否满足预设的模型收敛条件;s207:若是,则结束训练;s208:若否,则将情感识别数据集打乱顺序并执行从原始的情感识别数据集中提取出情感特征数据的步骤。

40.具体的,在图2中,s201至s205分别与s101至s105一一对应。

41.具体的,考虑到在训练过程中需要经过多次的迭代过程以对情感分类模型的权重参数进行反复更新,直至情感分类模型收敛,因此本技术中可以在根据由情感学习损失以及聚类损失构建的联合损失对情感分类模型进行参数更新之后判断情感分类模型是否满足预设的模型收敛条件,如果未收敛则可以将情感识别数据集打乱顺序并执行从原始的情感识别数据集中提取出情感特征数据的步骤,本发明实施例可以应用于处理器中,从而提升整个情感识别模型的训练方法的自动化程度以及工作效率。

42.具体的,假设原始的情感识别数据集用表示,其中,表示原始数据,表示真实标签,代表样本数量,这里详细给出的是单模态情感识别的情形。对于多模态的数据,可以进行灵活的扩展,比如两种模态,可以将聚类重构损失同时加入到两种模态中或者只加入到其中某一种模态中,具体要根据业务数据本身的分布特征来判断。

43.首先,对原始数据进行预处理,这里包括但不限于去噪,去除异常样本和归一化的操作,这一步骤的目的是为了对数据进行清洗和规范,方面后续的特征提取和参数学习。具体地:;其中,代表所有预处理的集合,代表预处理后的样本数据。

44.然后,对预处理之后的数据进行特征提取,这一步的网络结构可以使用现有的情感识别方法的框架,经过这一步骤,原始的数据已经从模态数据变成了特征数据。具体地:;其中,代表特征提取的操作,这些操作可以是现有的能够提取情感特征的各种网络结构。代表已经从原始情感样本数据中进行过抽象的情感特征数据。

45.其次,添加情感识别的分类层并构建损失,这一步骤式在特征的基础上直接映射到情感的分类空间,在这一空间中,每个样本都有对应的唯一情感标签,具体地:;;其中,代表情感分类的头部网络,该头部网络一般可以包含单层或者多层全连接层,甚至包含一些注意力层,值得注意的是,最后一层都是和该数据集情感类别数目相同的全连接层,最后接上归一化指数函数将输出的向量归一化成概率形式,将该概率向量和输入样本对应的标签向量通过交叉熵损失函数进行损失度量,得到对应的分类损失

,该损失也是一般情感识别方法的常用损失函数。

46.再次,添加聚类损失,学习重构情感聚类中心,在这一部分,情感的数据统计特征被尽可能保留重构,具体地:;;其中,代表的是聚类算法,这里给出的公式表示的是在整个数据集(包含个样本)上进行聚类,在实际使用的时候,也可以抽取一部分数据,在深度学习的batch(批量)概念下进行聚类,除了进行聚类的数据外,还可以在聚类算法本身上进行修改,比如使用效率更高的kmeans 聚类方法,这里不对方法进行限制,只要是使用无监督的方式能够拿到类似聚类中心的代表性向量即可,式中代表性向量表示的就是聚类中心。随后,需要对样本集的特征数据进行样本维度映射,也就是映射完成的功能,该功能的作用是将样本集特征的转置,即映射到聚类中心空间,t为迭代次序。需要注意,这一部分作为损失,连同映射定义的参数,都是只起到更新网络中其他参数的作用,在训练过后的推理阶段,并不需要进行聚类和重构操作。这一步的损失定义为原始聚类中心和重构聚类中心的误差:;其中,代表的是前向传播过程中按照聚类算法得到的个维度为的聚类中心向量拼成的二位张量,这个张量就是重构损失中的监督信息,这个信息的获得没有使用任何标签信息,所以是完全无监督的一种方式。

47.最后,通过将两个损失经过一个可调节超参整合起来形成联合损失共同对网络权重进行更新:;其中,是一个人工可设置的系数,该系数决定了在进行神经网络的训练过程中,分类损失和聚类损失两者的贡献程度的大小。

48.最后,就可以通过联合损失对情感识别模型中包含的参数进行更新,通过判断一定的收敛条件,最终固定模型参数,在推理测试阶段,不需要进行聚类操作,直接基于情感特征数据,使用情感分类头部网络得到数据的预测概率值分布,并将概率最高的类别作为原始数据的情感分类即可。

49.因为本发明重点在训练方法,所以该训练方法适用于多种数据的多种模型。首先

选择一种包含情感标签的数据,就可以按照工作流程开始实施。下载好对应的数据集,按照机器学习的标准学习模式将所有的数据划分为训练集,验证集和测试集,其中,训练集用来更新确定模型中的参数,验证集用来验证模型的有效性,更一般的,通过模型在训练集和验证集上的综合表现来防止模型在训练集上的过拟合。随后对所有数据进行预处理,随后,选择一种适用于当前数据的情感识别模型,初始化模型的权重,并开始训练。训练直到模型收敛之后,固定下模型参数,就可以在测试集上进行测试,测试的过程不需要计算聚类中心,直接获得情感识别的结果,整个流程结束。在模型损失函数的定义上,可以根据输入数据包含的情感类别数目进行调整,如果是两种类型(一般定义为积极和消极两种情感),可以采用平均绝对误差(mean absolute error)作为损失函数,也可以采用均方误差(mean square error)等其他度量的方法,如果是多种类型,可以选用适用于多分类的交叉熵损失函数,或者适用于多分类模型的其他改进方法。在模型的参数更新方面,可以采用rmsprob(root mean square propagation,前向均方根梯度下降算法)算法,同时也可以选用其它基于梯度下降的参数优化方法,包括但不限于随机梯度下降(stochastic gradient descent,sgd),adagrad(adaptive subgradient,自适应次梯度方法),adam(adaptive moment estimation,自适应矩估计),adamax(adam基于无穷范数的变种),asgd(averaged stochastic gradient descent,随机梯度下降)等。

50.具体的,为了更清楚明确地说明本发明的技术方案,接下来按照本发明的内容构建神经网络,进行情感识别,以便对本发明的具体实施进行详细说明。需要注意的是,此处所描述的具体实施方式仅用于解释本发明,但并不仅限定本发明。

51.(1)下载多模态的情感识别数据集,该数据集中包含cmumosi,cmumosei,iemocap三个数据集,这里以cmumosi为例,需要注意的是,同样的操作在包括但不限于cmumosei,iemocap的同类数据集上一样适用。cmumosi数据集包含2199个自拍的视频片段,整体上被划分为三个部分:训练集,验证集和测试集。这里下载的是基于视频数据提取的特征数据,其中训练集包含1284个样本数据,验证集包含229个样本数据,测试集包含686个样本数据。不同模态数据分别是:文本是一个包含最多50个单词的句子,如果句子单词数目不足50,则使用0来填充;图像数据是对和每个单词对齐的视频序列图像的特征表达,每段视频序列对应的表达是一个维度为20的向量,同样的每个单词对应的音频片段被压缩成一个特征表达,每个音频片段的表达是一个维度为5的向量。对于输出标签,每个样本数据对应一个数值,数值的范围是(-3,3),分别代表从最消极的情感到最积极的情感,在本次实施中,通过0为分界线,将情感识别分为两分类的任务(大于等于0定义为积极情感,小于0定义为消极情感)。

52.(2)定义网络结构,这里采用一种叫做非均匀注意力模型的情感识别模型来进行实施案例展示,非均匀注意力模型是一种用于多模态数据的情感识别网络,首先使用lstm(long short-term memory,长短期记忆人工神经网络)对文本,图像和音频的数据进行特征编码,然后使用非均匀注意力机制融合三种不同的特征数据,最后使用由全连接层构成的头部网络进行情感类别输出。因为需要对模型进行一定的修改,值得注意的是,因为这种数据和对应模型对应的数据包含三种不同的模态,所以这里可以对其中的一种或者三种进行聚类重构,这里选择文本模态进行重构,选择原始最终的文本模态特征作为聚类输入的特征来获得聚类中心。

53.(3)按照上述流程图的过程,开始在选定的数据和模型上进行参数的更新,模型的收敛这里定义为验证集上的识别精度在5个epoch(迭代)内不再变化,则认为模型收敛,固定此时的模型中的所有参数,同时注意,聚类分支上的参数在测试过程中会被跳过,不参与实际计算。

54.(4)将测试数据中的三种模态的信息输入到训练好的模型中进行前向计算,得到最终的情感识别输出。

55.本发明的另一种实施实例:(1)数据可以选择情感对话数据,而情感分类模型可以选择一种称作对话情感识别神经网络模型的情感分类模型,对话情感识别神经网络模型是用于识别一组对话中不同文本传递出的情感类别的网络,首先使用卷积神经网络获得对话中每个句子的特征表达,随后根据句子在对话中的位置构建图结构并使用图神经网络提取特征,最后通过由全连接层构成的头部网络输出对话中每个句子的情感类别。

56.(2)对上述(1)中的对话情感识别神经网络的前一层进行聚类重构损失添加,不失一般性的,这里将两种损失按照1:1的方式进行损失融合。

57.(3)其余部分按照上述流程图的方式进行模型的参数更新。

58.(4)在测试集上输入对应的对话数据,不进行聚类计算,直接获得最终的对话情感分类概率,选择概率最大的类别作为识别出的情感类别。

59.作为一种优选的实施例,预设的模型收敛条件具体为迭代次数是否达到预设迭代次数。

60.具体的,通过迭代次数的限定作为模型收敛条件可以准确控制训练时长,且能够保证模型训练到一定的精度。

61.当然,除了该收敛条件外,预设的模型收敛条件具体还可以为其他多种类型,例如可以为训练误差下降程度稳定到一定范围,还可以设定预测值和真实值间的误差的阈值,当模型的误差小于给定阈值的时候,可以判定训练停止。本发明实施例在此不做限定。

62.作为一种优选的实施例,从原始的情感识别数据集中提取出情感特征数据具体为:对原始的情感识别数据集进行预处理;从经过预处理后的情感识别数据集中提取出情感特征数据。

63.具体的,为了提高数据集的可用性以及加快数据处理速度,本发明实施例中可以首先对原始的情感识别数据集进行预处理,然后从经过预处理后的情感识别数据集中提取出情感特征数据。

64.作为一种优选的实施例,预处理包括去噪、去除异常样本以及归一化中的至少一者。

65.具体的,去噪、去除异常样本以及归一化的处理过程可以去除无效数据以及干扰数据,有利于提升模型训练效果并提升训练速度。

66.其中,值得注意的是,去噪等预处理方式对不同模型是一样的,但是如果是归一化操作,需要在训练集上得到均值和方差,用来归一化验证集和测试集。

67.当然,除了上述方式外,预处理还可以为其他类型,本发明实施例在此不做限定。

68.作为一种优选的实施例,根据映射到聚类中心空间的情感特征数据以及聚类中心

计算聚类损失具体为:;其中,为聚类损失,为k个维度为d的映射到聚类中心空间的情感特征数据,为由k个维度为d的聚类中心向量拼成的二维矩阵。

69.具体的,本发明实施例实际将映射到聚类中心空间的情感特征数据与聚类中心的距离作为聚类损失,通过该方式能够准确表征聚类损失。

70.当然,除了该方式外,根据映射到聚类中心空间的情感特征数据以及聚类中心计算聚类损失具体还可以为为其他方式,本发明实施例在此不做限定。

71.作为一种优选的实施例,预设聚类算法为kmeans 聚类方法。

72.具体的,kmeans 具有准确度高以及计算速度快等优点。

73.当然,除了kmeans 外,预设聚类算法还可以为其他类型,例如kmeans等,本发明实施例在此不做限定。

74.作为一种优选的实施例,当情感识别数据集中各数据的标签为离散型,根据情感特征数据以及情感识别数据集中各数据的预设情感标签,计算情感学习损失具体为:基于情感特征数据,使用情感分类头部网络得到包含情感识别数据集中各数据的预测概率值的概率向量;根据概率向量以及情感识别数据集中各数据的预设情感标签,计算情感分类损失。

75.具体的,在情感识别数据集中各数据的标签为离散型时,可以采用情感分类头部网络进行损失度量以得到情感分类损失,具体的可以使用情感分类头部网络得到包含情感识别数据集中各数据的预测概率值的概率向量,然后根据概率向量以及情感识别数据集中各数据的预设情感标签,计算情感分类损失,该情感分类损失也即情感学习损失中的一类。

76.其中,头部网络一般可以包含单层或者多层全连接层,甚至包含一些注意力层,值得注意的是,最后一层都是和该数据集情感类别数目相同的全连接层,最后接上归一化指数函数将输出的向量归一化成概率形式。

77.其中,可以用交叉熵等方式计算情感分类损失,本发明实施例在此不做限定。

78.作为一种优选的实施例,当情感识别数据集中各数据的标签为连续的浮点值,根据情感特征数据以及情感识别数据集中各数据的预设情感标签,计算情感分类学习损失具体为:基于情感特征数据,使用情感回归头部网络得到情感识别数据集中各数据的预测概率值;根据预测概率值以及情感识别数据集中各数据的预设情感标签,计算情感回归损失。

79.具体的,在情感识别数据集中各数据的标签为连续的浮点值时,可以采用情感回归头部网络进行损失度量以得到情感分类损失,具体的可以使用情感回归头部网络得到情

感识别数据集中各数据的预测概率值,然后根据预测概率值以及情感识别数据集中各数据的预设情感标签,计算情感回归损失,该情感回归损失也即情感学习损失中的一类。

80.其中,可以用均方误差等方式计算情感回归损失,本发明实施例在此不做限定。

81.作为一种优选的实施例,情感分类模型的结构相关的超参数通过随机搜索random search或网格搜索grid search确定。

82.具体的,在情感分类模型的定义过程中,需要对模型中涉及的结构相关的超参数进行确定,而此时可以采用多种方式,本发明实施例中提及的随机搜索random search或网格搜索grid search的方式具有准确性高以及稳定性强等优点。

83.当然,除了该两种方式外,还可以通过其他方式进行结构相关的超参数的确定,本发明实施例在此不做限定。

84.作为一种优选的实施例,情感分类模型具体为非均匀注意力模型或对话情感识别神经网络模型。

85.具体的,非均匀注意力模型或对话情感识别神经网络模型均为准确度高以及稳定性强的情感分类模型。

86.当然,除了该两种模型外,情感分类模型还可以为其他类型,本发明实施例在此不做限定。

87.作为一种优选的实施例,根据情感特征数据以及情感识别数据集中各数据的预设情感标签,计算情感学习损失之后,该情感识别模型的训练方法还包括:根据情感学习损失对情感分类模型进行参数预更新;则根据由情感学习损失以及聚类损失进行系数加权得到的联合损失对情感分类模型进行参数更新具体为:根据由情感学习损失以及聚类损失进行系数加权得到的联合损失,对预更新后的情感分类模型进行参数更新。

88.具体的,为了降低使用联合损失进行模型参数更新时的学习率,本发明实施例中还可以预先利用情感学习损失对情感分类模型进行参数预更新,之后再利用联合损失对预更新后的情感分类模型进行参数更新,如此一来,便降低了“使用联合损失进行模型参数更新时的学习率”,在根据联合损失进行模型参数更新时,可以对参数进行微调,以达到更好的情感识别精度。

89.本发明还提供了一种情感识别方法,应用于由前述实施例中的情感识别模型的训练方法训练得到的情感识别模型。

90.对于本发明实施例提供的情感识别方法的介绍请参照前述的情感识别模型的训练方法的实施例,本发明实施例在此不做限定。

91.请参考图3,图3为本发明提供的一种情感识别模型的训练装置的结构示意图,该情感识别模型的训练装置包括:提取模块31,用于从原始的情感识别数据集中提取出情感特征数据;第一计算模块32,用于根据情感特征数据以及情感识别数据集中各数据的预设情感标签,计算情感学习损失;聚类模块33,用于通过预设聚类算法对情感特征数据进行聚类得到聚类中心;第二计算模块34,用于根据映射到聚类中心空间的情感特征数据以及聚类中心计

算聚类损失;更新模块35,用于根据由情感学习损失以及聚类损失进行系数加权得到的联合损失对情感分类模型进行参数更新。

92.对于本发明实施例提供的情感识别模型的训练装置的介绍请参照前述的情感识别模型的训练方法的实施例,本发明实施例在此不做限定。

93.请参考图4,图4为本发明提供的一种情感识别模型的训练设备的结构示意图,该情感识别模型的训练设备包括:存储器41,用于存储计算机程序;处理器42,用于执行计算机程序时实现如前述实施例中情感识别模型的训练方法的步骤。

94.对于本发明实施例提供的情感识别模型的训练设备的介绍请参照前述的情感识别模型的训练方法的实施例,本发明实施例在此不做限定。

95.本发明还提供了一种计算机可读存储介质,计算机可读存储介质上存储有计算机程序,计算机程序被处理器执行时实现如前述实施例中情感识别模型的训练方法的步骤。

96.对于本发明实施例提供的计算机可读存储介质的介绍请参照前述的情感识别模型的训练方法的实施例,本发明实施例在此不做限定。

97.本说明书中各个实施例采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,各个实施例之间相同相似部分互相参见即可。对于实施例公开的装置而言,由于其与实施例公开的方法相对应,所以描述的比较简单,相关之处参见方法部分说明即可。还需要说明的是,在本说明书中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。而且,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括该要素的过程、方法、物品或者设备中还存在另外的相同要素。

98.对所公开的实施例的上述说明,使本领域专业技术人员能够实现或使用本发明。对这些实施例的多种修改对本领域的专业技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本发明的精神或范围的情况下,在其他实施例中实现。因此,本发明将不会被限制于本文所示的这些实施例,而是要符合与本文所公开的原理和新颖特点相一致的最宽的范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。