1.本发明属于计算机视觉领域,涉及图像数据在深度学习网络模型训练中标签标注的软件,尤其是一种可交互式标注的标注方法。

背景技术:

2.在计算机视觉领域中,图像数据对深度学习模型的迭代训练,以及模型最终呈现的效果有着至关重要的作用。

3.随着大数据的蓬勃发展,给深度学习提供了大量的数据样本,使深度学习得到了空前的发展。随着深度学习技术的不断发展及计算能力的增强,图像数据预处理需要更高效、更方便才能跟上技术的发展。现有数据标注往往采用人工逐个标注,对于目标检测类的矩形框标注较方便,但分割模型类的象素类的标注,需要大量的时间和人力,造成效率低下,人工标注庞大的数据不符合工业大数据高效率的生产需求。

技术实现要素:

4.本发明提供一种可交互式标注的标注方法,以至少解决现有技术中分割模型类象素类的标注,需要大量时间和人力,效率低下问题。

5.本发明提供了一种可交互式标注的标注方法,包括以下步骤:

6.s1,在标注系统内嵌轻量级分割网络;

7.s2,训练数据集预处理,包括:对部分需标注图片输入交互式标注信息;

8.s3,将s2标注完成的图片及其交互式标注信息输入至封装好的模型中;

9.s4,根据s3图片及交互式标注信息训练分割网络模型;

10.s5,使用s4训练完成的分割网络模型推理出剩余需标注图片的标注信息。

11.进一步地,所述训练数据集预处理还包括对含有交互式标注信息的输入模型训练图片进行数据增强预处理。

12.更进一步地,所述数据增强预处理为随机旋转、随机亮度、随机饱和度、随机对比度中的一种或多种;设随机增强概率用p表示,输入的原始图像用original_img表示,宽和高分别用w、h表示,新生成的图像为generate_img。

13.更进一步地,所述随机旋转可以自定义旋转角,也可以通过随机函数随机生成旋转角;

14.通过旋转角度angle和输入的原始图像生成纺射矩阵mat,计算仿射变化公式,得到旋转后新生成图像:

15.generate_img=warpaffine(original_img,mat,(w,h))。

16.更进一步地,所述自定义旋转角,先给一组旋转角,从给出的数组中选择一个或多个角度作为旋转角,

17.set_angles=[ang_1,ang_2,...,ang_n]。

[0018]

更进一步地,所述随机函数选择旋转角,先给出旋转角的最大值angle_max和最小

值angle_min,再通过随机函数的正态分布函数random.uniform(angle_min,angle_max)生成随机的角度。

[0019]

更进一步地,所述随机亮度,根据正太分布随机生成权重值,先设置随机权重最小值weight_min和最大值weight_max。

[0020]

weight=random.uniform(weight_min,weight_max).

[0021]

generate_img=weight*original_img,

[0022]

generate_img=clip(generate_img,0,255).

[0023]

上式中,clip函数可以将超出像素值0或255的图像亮度值约束至阈值范围内。

[0024]

更进一步地,所述随机饱和度根据正太分布随机生成权重值,先设置随机权重最小值weight_min和最大值weight_max。

[0025]

weight=random.uniform(weight_min,weight_max).

[0026]

grayscale=dot(original_img,[0.299,0.587,0.114]),

[0027]

generate_img=weight*grayscale (1-weight)*original_img,

[0028]

generate_img=clip(generate_img,0,255).

[0029]

上式中数组[0.299,0.587,0.114]是rgb图像和灰度图像相对应的视觉转换系数,grayscale是原始图像转换后的灰度图。

[0030]

更进一步地,所述随机对比度根据正太分布随机生成权重值,先设置随机权重最小值weight_min和最大值weight_max。

[0031]

weight=random.uniform(weight_min,weight_max).

[0032]

generate_img=weight*mean(original_img) (1-weight)*original_img,

[0033]

generate_img=clip(generateimg,0,255)。

[0034]

进一步地,所述分割网络模型为轻量级语义分割模型cgnet,所述cg模块通过全局残差学习的方式逐步获取深层网络信息和浅层网络信息,完成分割任务。

[0035]

本发明相对于现有技术,构建一套交互式标注软件,软件内嵌深度学习语义分割网络,把预标注的数据作为训练数据来训练分割模型,需要标注的图片经训练好的分割网络模型推导出掩码,即是所需要的标注信息,这种交互式的标注方法,可大批量快速的标注大量图片,提高图片标注效率,节省人力。

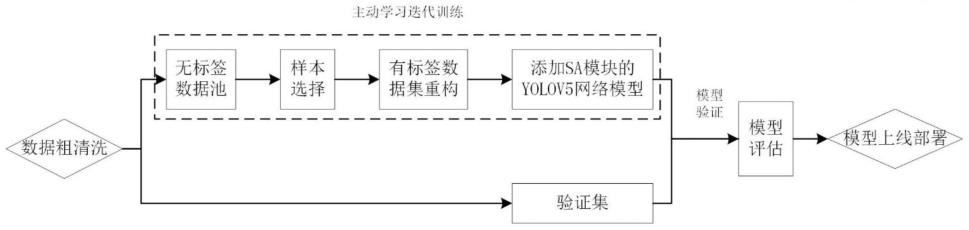

附图说明

[0036]

图1为cg模块图;

[0037]

图2为本发明cg模块全局残差学习图;

[0038]

图3为本发明网络结构图。

具体实施方式

[0039]

为了使本技术领域的人员更好地理解本发明方案,下面将对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分的实施例,而不是全部的实施例。

[0040]

本实施例公开的可交互式标注的标注方法,包括以下步骤:

[0041]

s1,在标注系统内嵌轻量级分割网络;

[0042]

s2,训练数据集预处理,包括:对部分需标注图片输入交互式标注信息;

[0043]

s3,将s2标注完成的图片及其交互式标注信息输入至封装好的模型中;

[0044]

s4,根据s3图片及交互式标注信息训练分割网络模型;

[0045]

s5,使用s4训练完成的分割网络模型推理出剩余需标注图片的标注信息。

[0046]

具体的,s1中将分割网络模型内嵌入标注软件中,其中分割网络模型是基于上下文的轻量级网络模型,可极大节省内存空间及网络训练时间,使得该标注软件可实时进行交互式标注,极大节省标注时间与精确度。

[0047]

s2中首先将需要标注的图片导入交互式标注系统中;对需要标注的图像输入交互式标注信息,这些交互式标注信息具体指背景图像和各类别。

[0048]

本实施例若需要标注的图片数量较大,图片标注需要交互式处理,则将图片及其交互式信息输入至封装好的模型中,模型根据此图片及其标注的交互式信息进行训练分割网络模型,训练完成后,剩余的需标注的图片可使用该分割模型推理出标注信息,若标注信息有误差,不准确的位置可以进行再次修正,使用正负功能点对目标边缘位置进行校正调整,使标注更加精细准确化,达到高效且实用的效果。

[0049]

优选的,所述训练数据集预处理还包括对含有交互式标注信息的输入模型训练图片进行数据增强预处理。

[0050]

具体的,为增强分割网络的训练效果,需对含有交互式标注信息的输入模型训练图像进行数据增强预处理;可选的所述数据增强预处理为随机旋转、随机亮度、随机饱和度、随机对比度中的一种或多种;

[0051]

设随机增强概率用p表示,输入的原始图像用original_img表示,宽和高分别用w、h表示,新生成的图像为generate_img。

[0052]

优选的,所述随机旋转可以自定义旋转角,也可以通过随机函数随机生成旋转角;

[0053]

通过旋转角度angle和输入的原始图像生成纺射矩阵mat,计算仿射变化公式,得到旋转后新生成图像:

[0054]

generate_img=warpaffine(original_img,mat,(w,h))。

[0055]

可选的,所述自定义旋转角,先给一组旋转角,从给出的数组中选择一个或多个角度作为旋转角,

[0056]

set_angles=[ang_1,ang_2,...,ang_n]。

[0057]

可选的,所述随机函数选择旋转角,先给出旋转角的最大值angle_max和最小值angle_min,再通过随机函数的正态分布函数random.uniform(angle_min,angle_max)生成随机的角度。

[0058]

可选的,所述随机亮度,根据正太分布随机生成权重值,先设置随机权重最小值weight_min和最大值weight_max。

[0059]

weight=random.uniform(weight_min,weight_max).

[0060]

generate_img=weight*original_img,

[0061]

generate_img=clip(generate_img,0,255).

[0062]

上式中,clip函数可以将超出像素值0或255的图像亮度值约束至阈值范围内。

[0063]

可选的,所述随机饱和度根据正太分布随机生成权重值,先设置随机权重最小值weight_min和最大值weight_max。

[0064]

weight=random.uniform(weight_min,weight_max).

[0065]

grayscale=dot(original_img,[0.299,0.587,0.114]),

[0066]

generate_img=weight*grayscale (1-weight)*original_img,

[0067]

generate_img=clip(generate_img,0,255).

[0068]

上式中数组[0.299,0.587,0.114]是rgb图像和灰度图像相对应的视觉转换系数,grayscale是原始图像转换后的灰度图。

[0069]

可选的,随机对比度

[0070]

根据正太分布随机生成权重值,先设置随机权重最小值weight_min和最大值weight_max。

[0071]

weight=random.uniform(weight_min,weight_max).

[0072]

generate_img=weight*mean(original_img) (1-weight)*original_img,

[0073]

generate_img=clip(generate_img,0,255)。

[0074]

可选的,模型训练时配置相关超参数,其中包括:输入图像分辨率、训练迭代次数、batch_size、学习率、优化器等;软件提供默认的超参数,也有保留修改超参数端口。

[0075]

优选的,所述分割网络模型为轻量级语义分割模型cgnet;

[0076]

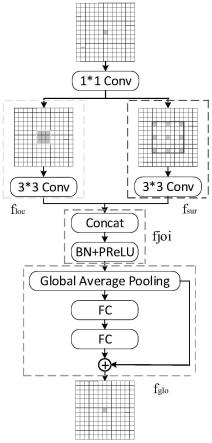

具体的,context grided netwirk分割网络是基于上下文语义信息提取特征而设计,主要通过构建cg模块,其中cg模块通过学习局部特征和上下文语义特征的联系信息,以及全局上下文信息来逐步获取深层网络信息和浅层网络信息,以完成分割任务。

[0077]

空间像素之间的依赖性和上下文信息可以很大程度上提升分割网络的精度,而cg模块正是基于此而设计提出,其中cg模块包含以下特点:

[0078]

(1)学习局部特征信息和上下文特征信息的联合特征信息;

[0079]

(2)利用全局上下特征信息来改善联合特征信息;

[0080]

(3)学习局部特征信息、上下文特征信息、全局上下文特征信息及改善后的联合特征信息在整个网络模型中一直存在;

[0081]

(4)只存在3步下采样操作,可以减少对边缘特征信息的丢失。

[0082]

如图1所示,cg模块由4部分构成,分别为:通过普通卷积实现局部特征信息提取部分floc;通过空洞卷积实现上下文特征信息提取部分fsur;联合特征信息部分fjoi,包括:拼接层,及bn网络和prelu激活函数;全局特征信息提取部分fglo,即全局池化层,及两个全连接层提取特征信息,得到一个权重向量,通过该权重向量来融合联合特征信息。

[0083]

如图2所示,本实施例模型的cg模块优选全局残差学习方式,全局残差把输入连接到全局特征信息提取部分。经实验验证,全局残差比局部残差更能促进网络信息的传递,对精度的提升更好。

[0084]

如图3所示,cgnet网络模型由三个部分组成,其中第一部分是使用普通的三个卷积层、bn层及prelu激活函数的组合来提取特征信息,第二部分和第三部分是堆叠cgnet模块,最后通过1*1卷积层得到分割结果。

[0085]

具体的,第一部分中,首个卷积层组合中卷积层的步长为2,所以经过第一部分后可得到1/2分辨率的特征图;通过第二部分,第三部分后,可得到1/4和1/8分辨率的特征图。

[0086]

需要注意的是,第二部分和第三部分的输入特征分辨率分别是由上一部分的输入和最后一个模块的输出组合输出。为增强特征信息的传递,把输入图像下采样1/4和1/8后

分别输入给第二部分和第三部分。

[0087]

本发明采用交互式标注的方法,把轻量级分割网络内嵌至标注软件中,实时对标注信息进行交互式处理,使用该方法可以极大节省标注时间,加快图片预处理效率。

[0088]

为方便较少标注图片训练分割网络模型,软件提供数据增强功能,以提高模型的泛化能力和准确度。该标注软件主要作用是加快标注效率和标注的准确性,因此,分割网络模型采用轻量级分割网络模型cgnet,该模型基于上下文语义信息提取特征而设计,不仅轻量,而且可以很大程度上提升分割网络的精度。

[0089]

本发明在传统人工标注的基础上,加入图像分割网络算法,通过多次传统人工标注和图像分割网络的交互,从而得到更加灵活准确的标注结果,为图像标注提供了一种交互式的图片标注方法。

[0090]

最后应当说明的是,以上实施例仅用以说明本发明的技术方案而非对其限制,尽管参照上述实施例对本发明进行了详细的说明,所属领域的普通技术人员应当理解,技术人员阅读本技术说明书后依然可以对本发明的具体实施方式进行修改或者等同替换,但这些修改或变更均未脱离本发明申请待批权利要求保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。