一种基于通道-空间注意力和deeplabv3plus的遥感影像语义分割方法

技术领域

1.本发明涉及一种基于通道-空间注意力和deeplabv3plus的遥感影像语义分割方法,属于城市规划和城市管理领域。

背景技术:

2.随着卫星传感器的快速发展,遥感图像的分辨率不断提高,高分辨率遥感影像提供了适用于各种观测任务的信息,有利于社会和经济的多方面发展,语义分割是解析遥感影像的关键。并且随着人工智能的发展,遥感图像语义分割的方法得到了扩充,基于卷积神经网络及其变种算法的遥感地物分割因精度高、鲁棒性强等优点逐步代替了传统的研究。因此如何使用人工智能算法结合高精度分辨率遥感影像进行语义分割成为亟需解决的问题。

技术实现要素:

3.针对上述现有技术存在的问题,本发明提供一种基于通道-空间注意力和deeplabv3plus的遥感影像语义分割方法,从而能够更准确、高效地分割遥感影像的地物类别,以便于快速精确地监测城市地物的空间分布格局。

4.为了实现上述目的,本发明采用的技术方案是:一种基于通道-空间注意力和deeplabv3plus的遥感影像语义分割方法,包括以下步骤:

5.s1.样本采集与掩膜标注:采集遥感影像样本,得到原始遥感影像数据集及其对的地物类别掩膜数据集并将其按照7:2:1的比例划分为训练集、验证集和测试集;

6.s2.边缘检测算法强化纹理特征:根据所述的原始遥感影像训练数据集和验证数据集,在数据集通道构件中利用opencv中的canny边缘检测算子对其进行地物纹理提取,强化遥感地物类别的纹理特征;

7.s3.训练改进的deeplabv3plus语义分割模型:采用经过强化纹理特征处理的数据集作为改进的deeplabv3plus语义分割算法模型中的输入进行训练,即可得到训练后的deeplabv3plus语义分割算法模型;

8.s4.对遥感影像进行语义分割:将遥感影像测试集数据作为训练后的deeplabv3plus模型的输入,获取各遥感影像的语义分割结果,并计算其准确率和交并比。

9.进一步的,所述步骤s1具体的:

10.s11.采集遥感影像样本;

11.首先在地理空间数据云和开放网络地图接口获取城市遥感影像;对于获得的城市遥感影像进行大气校正和地理配准后得到遥感影像样本,具体过程为:

12.1)大气校正,在遥感影像处理软件中对城市遥感影像进行大气校正,减小云和雾对城市遥感影像清晰度的影响;

13.2)地理配准,在arcgis软件中将数据转换为相应的地理坐标系,并进行几何校正。

14.s12.标记遥感影像样本中的各地物类型,并进行遥感地物类型的掩膜提取;地物类型选择为建筑、水体、植被、裸地、道路;以1-5五个阿拉伯数字对建筑、水体、植被、裸地、道路地物类型进行标注并进行掩膜提取;利用labelme工具,绘制各地物类型的形状;若遥感影像存在建筑物,则编码为1,并提取出建筑物的形状;若遥感影像存在水体,则编码为2,并提取出水体的形状;若遥感影像存在植被,则编码为3,并提取出植被的形状;若遥感影像存在裸地,则编码为4,并提取出裸地的形状;若遥感影像存在道路,则编码为5,并提取出道路的形状;得到5个地物类型的原始影像数据集以及掩膜数据集;

15.s13.按照7:2:1的比例划分为训练集、验证集和测试集。

16.进一步的,所述步骤s2的具体步骤为:

17.s21:将所述原始遥感影像训练数据集和验证数据集的遥感影像的尺寸统一变换为m*m像素;

18.s22:canny算法采用python-opencv中的canny模块,参数threshold1=100,参数threshold2=200;

19.s23:对变换后的影像进行扭曲变换得到强化、变换后的遥感影像训练数据集和验证数据集。

20.进一步的,所述步骤s22中canny算法的边缘提取过程如下:

21.s221:对原始图像进行灰度化;

22.s222:对图像进行高斯滤波,其中高斯滤波器公式如下:

[0023][0024]

上式中,h(x,y)表示(x,y)处的像元值,σ表示方差,k表示把滤波器维度;

[0025]

s223:利用一阶偏导的有限积分计算梯度的幅值和方向,采用sobel算子进行梯度幅值的计算,其公式如下:

[0026][0027][0028]sx

=(a2 2a3 a4)-(a0 2a7 a6)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(4);

[0029]

sy=(a0 2a1 a2)-(a6 2a5 a4)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(5);

[0030]

上式中,s

x

表示x方向卷积核模板,sy表示y方向卷积核模板,k表示待处理点的领域点标记矩阵,g[i,j]表示[i,j]处像元的幅值;

[0031]

s224:对梯度幅值进行非极大值抑制;

[0032]

s225:双阈值算法检测和连接边缘。

[0033]

进一步的,所述步骤s3具体为:

[0034]

s31:构建基于通道-空间注意力和deeplabv3plus的遥感影像语义分割网络;

[0035]

s32:将变换后的遥感影像训练数据集和验证数据集输入改进的deeplabv3plus语义分割网络模型中,前向传播获得语义分割网络模型输出的所述变换后的遥感影像样本地物类型的形状信息;

[0036]

s33.利用focal loss函数,将损失值按照平均化误差进行反向传播,调整所述改进deeplabv3plus语义分割网络模型的权重,其损失函数计算公式如下

[0037]

fl=-(1-p

t

)

γ

log(p

t

)

ꢀꢀꢀꢀ

(6);

[0038]

上式中,fl表示损失值,log(p

t

)表示模型交叉熵损失函数的结果,γ表示常数,在本实施例中γ=2。

[0039]

s34.利用样本相似度损失函数dice loss函数以减少正负样本不平衡问题,将损失值按照平均化误差进行反向传播调整所述改进deeplabv3plus语义分割网络模型的权重,得到训练后的deeplabv3plus语义分割网络模型其损失函数计算公式如下:

[0040][0041][0042][0043]

上式中,ti表示目标值,yi表示预测值,ε表示平滑系数,在本实施例中ε=1e-5。

[0044]

本发明的有益效果是:与现有技术相比,本发明采用canny边缘检测算法强化图像纹理特征以及通道-空间注意力机制强化图像深层特征对deeplav3plus进行改进,提出了一种基于通道-空间注意力改和deeplav3plus遥感影像语义分割算法模型。采用训练集和验证集对该模型进行训练、验证,高效、准确地分割遥感影像的地物类别(建筑、水体、植被、裸地、道路),实现了通道-空间注意力与deeplabv3plus语义分割模型之间的嵌入式使用,提高语义分割的准确率和交并比。

附图说明

[0045]

图1是本发明提供的一种基于通道-空间注意力和deeplabv3plus的遥感影像语义分割方法流程图;

[0046]

图2是本发明实施例中构建的基于通道-空间注意力和deeplabv3plus的遥感影像语义分割算法模型的结构图;

[0047]

图3是本发明实施例中使用的部分遥感影像示意图;

[0048]

图4是本发明实施例中一种基于通道-空间注意力和deeplabv3plus的遥感影像语义分割算法模型时的网络学习损失示意图。

具体实施方式

[0049]

为使本发明的目的、技术方案和优点更加清楚明了,下面通过附图及实施例,对本发明进行进一步详细说明。但是应该理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限制本发明的范围。

[0050]

除非另有定义,本文所使用的所有的技术术语和科学术语与属于本发明的技术领域的技术人员通常理解的含义相同,本文中在本发明的说明书中所使用的术语只是为了描

述具体的实施例的目的,不是旨在于限制本发明。

[0051]

如图1所示,本实施例提供的一种基于通道-空间注意力和deeplabv3plus的遥感影像语义分割方法,包括以下步骤:

[0052]

s1.样本采集与掩膜标注:采集遥感影像样本,得到原始遥感影像数据集及其对的地物类别掩膜数据集并将其按照7:2:1的比例划分为训练集、验证集和测试集;具体的,

[0053]

s11.采集遥感影像样本;

[0054]

首先在地理空间数据云和开放网络地图接口获取城市遥感影像;对于获得的城市遥感影像进行大气校正和地理配准后得到遥感影像样本,具体过程为:

[0055]

1)大气校正,在遥感影像处理软件中对城市遥感影像进行大气校正,减小云和雾对城市遥感影像清晰度的影响;

[0056]

2)地理配准,由于路网数据的空间参考与其他步骤中的数据空间参考不一致,导致空间分析时其位置无法相互匹配,故需要在arcgis软件中将数据转换为相应的地理坐标系,并进行几何校正。

[0057]

s12.标记遥感影像样本中的各地物类型,并进行遥感地物类型的掩膜提取;地物类型选择为建筑、水体、植被、裸地、道路;以1-5五个阿拉伯数字对建筑、水体、植被、裸地、道路地物类型进行标注并进行掩膜提取;利用labelme工具,绘制各地物类型的形状;若遥感影像存在建筑物,则编码为1,并提取出建筑物的形状;若遥感影像存在水体,则编码为2,并提取出水体的形状;若遥感影像存在植被,则编码为3,并提取出植被的形状;若遥感影像存在裸地,则编码为4,并提取出裸地的形状;若遥感影像存在道路,则编码为5,并提取出道路的形状;得到5个地物类型的原始影像数据集以及掩膜数据集;

[0058]

s13.按照7:2:1的比例划分为训练集、验证集和测试集。

[0059]

步骤s2.边缘检测算法强化纹理特征:根据所述的原始遥感影像训练数据集和验证数据集,在数据集通道构件中利用opencv中的canny边缘检测算子对其进行地物纹理提取,强化遥感地物类别的纹理特征;

[0060]

步骤s2的具体步骤为:

[0061]

s21:将所述原始遥感影像训练数据集和验证数据集的遥感影像的尺寸统一变换为m*m像素;本实施例中m取值为256;

[0062]

s22:canny算法采用python-opencv中的canny模块,参数threshold1=100,参数threshold2=200;

[0063]

s221:对原始图像进行灰度化;

[0064]

s222:对图像进行高斯滤波,其中高斯滤波器公式如下:

[0065][0066]

上式中,h(x,y)表示(x,y)处的像元值,σ表示方差,k表示把滤波器维度;

[0067]

s223:利用一阶偏导的有限积分计算梯度的幅值和方向,采用sobel算子进行梯度幅值的计算,其公式如下:

[0068]

[0069][0070]sx

=(a2 2a3 a4)-(a0 2a7 a6)

ꢀꢀꢀꢀ

(4);

[0071]

sy=(a0 2a1 a2)-(a6 2a5 a4)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(5);

[0072]

上式中,s

x

表示x方向卷积核模板,sy表示y方向卷积核模板,k表示待处理点的领域点标记矩阵,g[i,j]表示[i,j]处像元的幅值;

[0073]

s224:对梯度幅值进行非极大值抑制;

[0074]

s225:双阈值算法检测和连接边缘;

[0075]

s23:对变换后的影像进行扭曲变换得到强化、变换后的遥感影像训练数据集和验证数据集。

[0076]

步骤s3.训练改进的deeplabv3plus语义分割模型:采用经过强化纹理特征处理的数据集作为改进的deeplabv3plus语义分割算法模型中的输入进行训练,即可得到训练后的deeplabv3plus语义分割算法模型;

[0077]

s31:构建基于通道-空间注意力和deeplabv3plus的遥感影像语义分割网络;具体如图3所示。

[0078]

其基于geforce rtx 3060gpu硬件平台,利用python pytorch模块,以xception网络为分类网络,以通道-空间注意力强化xception网络提取出遥感影像的深层特征信息,以aspp网络为特征多尺度划分模块采用不同膨胀卷积率(0,6,12,18)的卷积块以及一个基础卷积块共五个特征层并将其拼接起来,构造基于通道-空间注意力改进的deeplabv3plus语义分割网络。该语义分割网络中输入图像的尺寸确定为m*m像素,本发明实例中m取值为256。

[0079]

其中通道-空间注意力网络设计为:

[0080]

通道注意力卷积模块:

[0081]

一个全局平均池化层和一个全局极大池化层分别构成一个池化模块;

[0082]

一个卷积核大小为1

×

1的卷积层和一个relu激活层以及一个卷积核大小为1

×

1的卷积层堆叠成一个卷积块;

[0083]

sigmoid激活函数作为激活层;

[0084]

其前向传播过程为:将xception网络提取出的深层特征分别作为全局平均池化层和全局极大池化层的输入,再输入到卷积块中,最后将两个特征层相加并经过sigmoid激活函数活化后输出。

[0085]

空间注意力卷积模块:

[0086]

一个卷积核大小为7

×

7的卷积层构成卷积块,sigmoid激活函数作为激活层;

[0087]

其前向传播过程为:通道注意力卷积模块输出的特征与xception网络提取出的深层特征的乘积作为输入,将其划分为列数为1的平均特征和极大特征,将两特征进行拼接输入卷积块中,经过sigmoid激活函数活化后输出。

[0088]

通道-空间注意力卷积模块的前向传播过程为:

[0089]

将xception网络提取出的深层特征作为通道注意力卷积模块的输入,输出的结果与深层特征的乘积作为空间注意力卷积模块的输入,空间注意力卷积模块输出的结果与深层特征的乘积作为通道-空间注意力卷积模块的输出。

[0090]

s32:将变换后的遥感影像训练数据集和验证数据集输入改进的deeplabv3plus语义分割网络模型中,前向传播获得语义分割网络模型输出的所述变换后的遥感影像样本地物类型的形状信息;

[0091]

s33.利用focal loss函数,将损失值按照平均化误差进行反向传播,调整所述改进deeplabv3plus语义分割网络模型的权重,其损失函数计算公式如下

[0092]

fl=-(1-p

t

)

γ

log(p

t

)

ꢀꢀꢀꢀꢀ

(6);

[0093]

上式中,fl表示损失值,log(p

t

)表示模型交叉熵损失函数的结果,γ表示常数,在本实施例中γ=2。

[0094]

s34.利用样本相似度损失函数dice loss函数以减少正负样本不平衡问题,将损失值按照平均化误差进行反向传播调整所述改进deeplabv3plus语义分割网络模型的权重,得到训练后的deeplabv3plus语义分割网络模型其损失函数计算公式如下:

[0095][0096][0097][0098]

上式中,ti表示目标值,yi表示预测值,e表示平滑系数,在本实施例中ε=1e-5。

[0099]

s4.对遥感影像进行语义分割:将遥感影像测试集数据作为训练后的deeplabv3plus模型的输入,获取各遥感影像的语义分割结果,并计算其准确率和交并比。

[0100]

本发明实施例中所采集的遥感影像样本中包括江浙沪区域选取的一系列遥感影像,包含建筑、水体、植被、裸地、道路地物类型20000张。其中,部分遥感影像样本如图3(a)所示。目标城市为南通市崇川区。具体环境为pycharm和arcgis软件平台以及geforce rtx 3060gpu等硬件平台,利用python及其相关库进行开发实验,如numpy、pytorch、pil、opencv等。遥感影像数据为2018-2020年百度遥感影像,分辨率为0.5米。

[0101]

图4为改进的deeplabv3plus网络模型的网络学习损失示意图,epoch loss和val loss成缓慢下降趋势,曲线波动较为稳定,当训练到第90代左右时,两条曲线基本收敛,模型在此时达到良好的效果。

[0102]

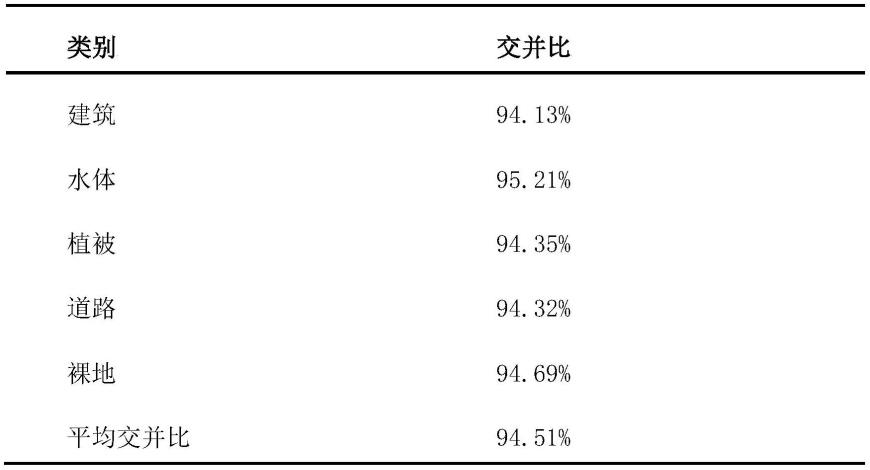

将遥感影像测试数据集输入到训练后改进的deeplabv3plus语义分割模型中,部分测试数据和预测结果如图3(b)所示。在图中可以看出,大部分地物能够被很好地分割出来,且分割精度较高。计算测试数据集的预测结果与其真实标签的交并比,数据如表1所示,可以看到,五个地物类别的平均交并比达到94.51%,其中水体的交并比最高,达到了95.21%。说明改进后的deeplabv3plus语义分割模型,能在遥感影像语义分割问题上取得良好的效果。

[0103]

表1

[0104][0105]

以上所述仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内所作的任何修改、等同替换或改进等,均应包含在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。