1.本发明涉及深度学习技术领域,尤其涉及一种表情识别方法、装置、电子设备和存储介质。

背景技术:

2.情绪识别作为人机交互的重要组成部分,可提升交互过程中的用户体验。近些年,随着深度学习技术的发展,人脸表情识别也随之发展。

3.但由于情绪本身的主观性以及不同情绪之间的相似性,人脸表情数据较难收集,且人工标注费时费力,导致目前人脸表情识别的精度较低,无法大规模落地使用。

技术实现要素:

4.本发明提供一种表情识别方法、装置、电子设备和存储介质,用以解决现有技术中人脸表情识别的精度较低,无法大规模落地使用的缺陷。

5.本发明提供一种表情识别方法,包括:

6.基于编码网络,确定待识别的人脸图像的图像特征;

7.基于表情提取网络,对所述图像特征进行表情特征提取,得到表情特征;

8.基于表情分类网络,对所述表情特征进行表情识别;

9.所述表情提取网络基于基准图像和第一图像之间的第一表情特征相似度,以及所述基准图像和第二图像之间的第二表情特征相似度训练得到,所述基准图像、第一图像和第二图像对应样本人脸视频中的同一人脸,所述基准图像与所述第一图像间的时间间隔小于所述基准图像与所述第二图像间的时间间隔。

10.根据本发明提供的一种表情识别方法,所述编码网络和所述表情提取网络基于如下步骤训练得到:

11.确定初始提取网络,所述初始提取网络包括初始编码网络和初始表情提取分支;

12.基于所述初始提取网络,分别确定所述基准图像、所述第一图像和所述第二图像的预测表情特征;

13.基于所述基准图像和所述第一图像的预测表情特征,确定所述第一表情特征相似度,基于所述基准图像和所述第二图像的预测表情特征,确定所述第二表情特征相似度;

14.基于所述第一表情特征相似度和所述第二表情特征相似度,确定表情提取损失;

15.基于所述表情提取损失,对所述初始提取网络进行训练,得到所述编码网络和所述表情提取网络。

16.根据本发明提供的一种表情识别方法,所述基于所述第一表情特征相似度和所述第二表情特征相似度,确定表情提取损失,包括:

17.基于所述第一表情特征相似度和所述第二表情特征相似度之间的差值,确定表情提取损失。

18.根据本发明提供的一种表情识别方法,所述初始提取网络还包括初始身份提取分

支;

19.所述基于所述表情提取损失,对所述初始提取网络进行训练,包括:

20.基于所述初始编码网络,确定样本图像的预测图像特征;

21.基于所述初始身份提取分支,对所述样本图像的预测图像特征进行身份特征提取,得到所述样本图像的预测身份特征;

22.基于对应同一人脸的各样本图像的预测身份特征,确定第一身份特征相似度,基于对应不同人脸的各样本图像的预测身份特征,确定第二身份特征相似度;

23.基于所述第一身份特征相似度和第二身份特征相似度,确定身份提取损失;

24.基于所述表情提取损失和所述身份提取损失,对所述初始提取网络进行训练。

25.根据本发明提供的一种表情识别方法,所述初始提取网络还包括初始解码网络;

26.所述基于所述表情提取损失和所述身份提取损失,对所述初始提取网络进行训练,包括:

27.基于所述初始解码网络,对所述样本图像的预测表情特征和预测身份特征进行特征解码,得到所述样本图像的重建图像特征;

28.基于所述样本图像的预测图像特征和重建图像特征,确定解码损失;

29.基于所述表情提取损失和所述身份提取损失,以及所述解码损失,对所述初始提取网络进行训练。

30.根据本发明提供的一种表情识别方法,所述基于所述表情提取损失和所述身份提取损失,以及所述解码损失,对所述初始提取网络进行训练,包括:

31.基于所述表情提取损失和所述身份提取损失,以及所述解码损失,对所述初始提取网络进行第一阶段训练,得到第一阶段训练后的初始提取网络作为第一提取网络;

32.基于对应不同人脸的样本图像的预测身份特征和预测表情特征,生成扰动特征;

33.基于所述第一提取网络中的第一解码网络,对所述扰动特征进行特征解码,得到扰动重建特征;

34.基于所述第一提取网络中的第一表情提取分支,对所述扰动重建特征进行表情特征提取,得到所述扰动特征的重建表情特征,和/或,基于所述第一提取网络中的第一身份提取分支,对所述扰动重建特征进行身份特征提取,得到所述扰动特征的重建身份特征;

35.基于所述扰动特征的重建表情特征和预测表情特征,确定表情扰动损失,和/或,基于所述扰动特征的重建身份特征和预测身份特征,确定身份扰动损失;

36.基于所述表情提取损失和所述表情扰动损失,和/或,基于所述身份提取损失和所述身份扰动损失,对所述第一表情提取分支和/或所述第一身份提取分支进行训练。

37.根据本发明提供的一种表情识别方法,所述基于所述扰动特征的重建表情特征和预测表情特征,确定表情扰动损失,和/或,基于所述扰动特征的重建身份特征和预测身份特征,确定身份扰动损失,包括:

38.基于所述扰动特征的重建表情特征和预测表情特征之间的差值,确定表情扰动损失;和/或,

39.基于所述扰动特征的重建身份特征和预测身份特征之间的差值,确定身份扰动损失。

40.根据本发明提供的一种表情识别方法,所述基于所述表情提取损失,对所述初始

提取网络进行训练,之后还包括:

41.基于携带表情分类标签的样本图像,对训练完成的初始编码网络和初始表情提取分支,联合初始分类网络进行微调,将微调完成后的初始编码网络、初始表情提取分支和初始分类网络分别作为所述编码网络、所述表情提取网络和所述表情分类网络。

42.根据本发明提供的一种表情识别方法,所述基准图像、第一图像和第二图像基于如下步骤确定:

43.确定样本人脸视频,所述样本人脸视频中的各帧图像对应同一人脸;

44.从所述样本人脸视频的图像帧序列中,提取相邻两帧图像作为基准图像和第一图像,提取与所述基准图像间的时间间隔最远的一帧图像作为第二图像。

45.本发明还提供一种表情识别装置,包括:

46.图像特征确定单元,用于基于编码网络,确定待识别的人脸图像的图像特征;

47.表情特征提取单元,用于基于表情提取网络,对所述图像特征进行表情特征提取,得到表情特征;

48.表情识别单元,用于基于表情分类网络,对所述表情特征进行表情识别;

49.所述表情提取网络基于基准图像和第一图像之间的第一表情特征相似度,以及所述基准图像和第二图像之间的第二表情特征相似度训练得到,所述基准图像、第一图像和第二图像对应样本人脸视频中的同一人脸,所述基准图像与所述第一图像间的时间间隔小于所述基准图像与所述第二图像间的时间间隔。

50.本发明还提供一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现如上述任一种所述表情识别方法的步骤。

51.本发明还提供一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现如上述任一种所述表情识别方法的步骤。

52.本发明还提供一种计算机程序产品,包括计算机程序,所述计算机程序被处理器执行时实现如上述任一种所述表情识别方法的步骤。

53.本发明提供的表情识别方法、装置、电子设备和存储介质,通过基于基准图像和第一图像之间的第一表情特征相似度,以及基准图像和第二图像之间的第二表情特征相似度训练得到表情提取网络,从而使得表情提取网络能够更好地区分同一人脸表情变化下的表情特征之间的差异,提取到的表情特征更多的聚焦于表情信息;并基于表情特征进行表情识别,避免了收集大量人脸表情数据,减少了人工标注成本的同时,有效提高了人脸表情识别结果的准确率和可靠性。

附图说明

54.为了更清楚地说明本发明或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作一简单地介绍,显而易见地,下面描述中的附图是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

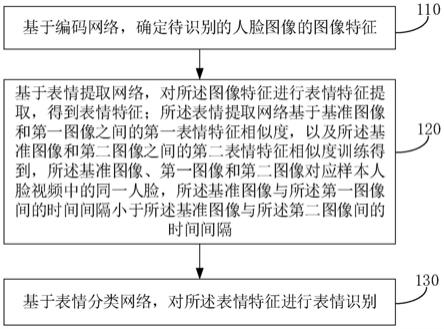

55.图1是本发明提供的表情识别方法的流程示意图之一;

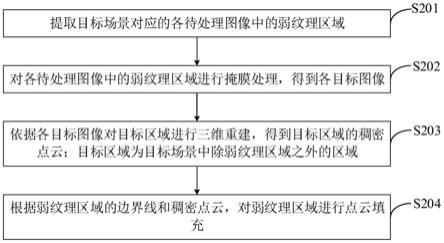

56.图2是本发明提供的初始提取网络的训练方法的流程示意图之一;

57.图3是本发明提供的初始提取网络的训练方法的流程示意图之二;

58.图4是本发明提供的初始提取网络的训练方法的流程示意图之三;

59.图5是本发明提供的初始提取网络的训练方法的流程示意图之四;

60.图6是本发明提供的基准图像、第一图像和第二图像确定方法的流程示意图;

61.图7是本发明提供的自监督学习网络的数据流向示意图;

62.图8是本发明提供的表情识别装置的结构示意图;

63.图9是本发明提供的电子设备的结构示意图。

具体实施方式

64.为使本发明的目的、技术方案和优点更加清楚,下面将结合本发明中的附图,对本发明中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

65.现有的表情识别技术方案,通过自监督学习方案学习一个表征信息再迁移到人脸表情有监督数据上,最终学习的表征可能更多的聚焦于身份信息,对于表情信息的表征能力较弱,因此不利于下游表情识别任务,导致表情识别的精度较低。

66.基于此,本发明实施例提供了一种表情识别方法,图1是本发明提供的表情识别方法的流程示意图,如图1所示,该方法包括:

67.步骤110,基于编码网络,确定待识别的人脸图像的图像特征。

68.具体地,人脸图像包括人脸面部表情,待识别的人脸图像即需要进行人脸表情识别的图像,待识别的人脸图像可以是通过手机、相机等图像采集设备采集得到的,也可以是通过网络爬取或者下载得到的,本发明实施例对此不作具体限定。

69.此处,编码网络可以是卷积神经网络或者残差网络,可以采用编码网络对待识别的人脸图像进行编码,也就是将人脸图像压缩到图像特征空间中得到图像特征,这一过程也称之为特征提取。特征提取的方法可以采用现有技术中任意一种人脸图像特征提取算法实现,本实施例此处不再赘述。

70.特征提取得到的图像特征可以表征待识别的人脸图像的全局或局部信息,比如具体可以包括人脸身份特征和人脸表情特征。

71.步骤120,基于表情提取网络,对图像特征进行表情特征提取,得到表情特征。

72.表情提取网络基于基准图像和第一图像之间的第一表情特征相似度,以及基准图像和第二图像之间的第二表情特征相似度训练得到,基准图像、第一图像和第二图像对应样本人脸视频中的同一人脸,基准图像与第一图像间的时间间隔小于基准图像与第二图像间的时间间隔。

73.具体地,表情提取网络用于提取图像特征中的表情特征,从而得到能够表征人脸图像的表情表征向量,即表情特征。表情特征可以以向量表示作为结果输出。

74.在执行步骤120之前,还可以预先对表情提取网络进行训练,具体可以通过如下方法进行网络训练:

75.首先,采集大量包含人脸的样本人脸视频,从同一人脸的样本人脸视频中选取三张图像,分别为基准图像、第一图像和第二图像。其中,基准图像与第一图像间的时间间隔

小于基准图像与第二图像间的时间间隔。比如,基准图像在样本人脸视频中是第1秒,第一图像在样本人脸视频中是第2秒,第二图像在样本人脸视频中是第5秒,基准图像与第一图像间的时间间隔为1秒,小于基准图像与第二图像间的时间间隔4秒。也就是说,相比于基准图像和第二图像,基准图像和第一图像在样本人脸视频中离得更近。

76.随即,将经编码网络编码得到的基准图像特征、第一图像特征和第二图像特征输入至初始表情提取网络中进行训练,初始表情提取网络在训练过程中,可以放大并学习基准图像和第一图像的表情特征的共性特征,同时放大并学习基准图像和第二图像的表情特征的差异性特征。由此训练得到的表情提取网络能够更好地区分同一个人表情变化下的表情特征之间的差异。

77.其中,基准图像和第一图像之间的第一表情特征相似度即基准图像对应的表情特征与第一图像对应的表情特征之间的相似度,由于基准图像和第一图像间的时间间隔相对较短,两者之间的表情特征相似度越高,则两者对应的表情特征越能够反映基准图像和第一图像的表情特征的共性特征。

78.基准图像和第二图像之间的第二表情特征相似度即基准图像对应的表情特征与第二图像对应的表情特征之间的相似度,由于基准图像和第二图像间的时间间隔相对较长,两者之间的表情特征相似度越低,则两者对应的表情特征越能够反映基准图像和第二图像的表情特征的差异性特征。

79.步骤130,基于表情分类网络,对表情特征进行表情识别。

80.具体地,表情分类网络用于对提取到的人脸表情特征进行分类预测,将人脸表情特征输入表情分类网络,通过表情分类网络进行表情分类识别。

81.其中,表情分类网络可以是在各个样本图像的表情特征基础上,针对初始分类网络独立训练得到。或者,也可以通过对编码网络和训练后的表情提取网络,结合初始分类网络进行微调得到。微调过程中,仅需要少量的带有表情分类标签的样本图像,即可实现表情分类网络的训练损失稳定。相比于直接采用大量的人脸表情分类标签的样本图像进行训练,该方法避免了收集大量人脸表情数据,减少了人工标注成本的同时,有效提高了人脸表情识别结果的准确率和可靠性。

82.本发明实施例提供的方法,通过基于基准图像和第一图像之间的第一表情特征相似度,以及基准图像和第二图像之间的第二表情特征相似度训练得到表情提取网络,从而使得表情提取网络能够更好地区分同一人脸表情变化下的表情特征之间的差异,提取到的表情特征更多的聚焦于表情信息;并基于表情特征进行表情识别,避免了收集大量人脸表情数据,减少了人工标注成本的同时,有效提高了人脸表情识别结果的准确率和可靠性。

83.基于上述实施例,图2是本发明提供的初始提取网络的训练方法的流程示意图之一,如图2所示,该训练方法包括:

84.步骤210,确定初始提取网络,初始提取网络包括初始编码网络和初始表情提取分支;

85.步骤220,基于初始提取网络,分别确定基准图像、第一图像和第二图像的预测表情特征;

86.步骤230,基于基准图像和第一图像的预测表情特征,确定第一表情特征相似度,基于基准图像和第二图像的预测表情特征,确定第二表情特征相似度;

87.步骤240,基于第一表情特征相似度和第二表情特征相似度,确定表情提取损失;

88.步骤250,基于表情提取损失,对初始提取网络进行训练,得到编码网络和表情提取网络。

89.具体地,基准图像、第一图像和第二图像均是从同一人脸的样本人脸视频中选取出的表情样本图像。初始编码网络用于提取表情样本图像的图像特征,初始表情提取分支用于根据提取到的图像特征,进行表情特征提取,从而得到表情样本图像的预测表情特征。初始编码网络和初始表情提取分支构成初始提取网络。

90.将基准图像、第一图像和第二图像分别输入初始提取网络中的初始编码网络后,得到预测图像特征;再将预测图像特征分别输入初始提取网络中的初始表情提取分支后,得到基准图像、第一图像和第二图像的预测表情特征。

91.第一表情特征相似度可以根据基准图像和第一图像的预测表情特征来确定,具体可以采用特征相似度计算函数得到,例如,欧几里得距离函数、余弦相似度函数或相关系数等,本发明实施例对此不作具体限定。

92.相应地,第二表情特征相似度可以根据基准图像和第二图像的预测表情特征来确定,同样地可以采用特征相似度计算函数得到。

93.由第一表情特征相似度和第二表情特征相似度确定的表情提取损失,用于实现第一表情特征相似度的最大化,以及第二表情特征相似度的最小化。例如,表情提取损失可以约束第一表情特征相似度和第二表情特征相似度的差值或者比值最大化。

94.由此确定的表情提取损失,使得编码网络和表情提取网络在训练过程中能够尽量多地学习表情变化较小的两帧图像的共性特征,以及表情变化较大的两帧图像的差异性特征,从而训练得到的表情提取网络所提取的表情特征能够充分表征待识别人脸图像中的表情信息。

95.本发明实施例提供的方法,通过第一表情特征相似度和第二表情特征相似度确定表情提取损失,并基于表情提取损失训练初始提取网络,从而使训练得到的编码网络和表情提取网络能够更好的区分同一人脸的表情差异,提高表情特征提取的准确率和可靠性。

96.基于上述任一实施例,步骤240具体包括:

97.基于第一表情特征相似度和第二表情特征相似度之间的差值,确定表情提取损失。

98.具体地,为了实现第一表情特征相似度的最大化,以及第二表情特征相似度的最小化,可以根据第一表情特征相似度和第二表情特征相似度之间的差值,确定表情提取损失。两者之间的差值越大,表示表情提取损失越小;两者之间的差值越小,表示表情提取损失越大。

99.进一步地,针对每一个样本人脸视频,可以选取多张表情样本图像,进而可根据多张表情样本图像构成表情样本图像组,每一组均包含三张图像,分别是基准图像、第一图像和第二图像。则初始提取网络的损失可以由该表情样本图像组分别确定的表情提取损失确定。

100.在一个实施例中,在初始提取网络训练的过程中,每次随机采样k个视频段,则初始提取网络的损失可以表示为如下形式:

[0101][0102]

式中,即第一组表情样本图像中,基准图像和第一图像之间的第一表情特征相似度,即第一组表情样本图像中,基准图像和第二图像之间的第二表情特征相似度;即第二组表情样本图像中,基准图像和第一图像之间的第一表情特征相似度,即第二组表情样本图像中,基准图像和第二图像之间的第二表情特征相似度;

[0103]

γ为超参数,在训练过程中需要手动调节,网络训练的最终优化目标即最小化损失函数l

exp

。

[0104]

其中,和具体可以表示为如下形式:

[0105][0106][0107][0108][0109]

式中,x

k1

至x

k5

分别表示从第k个视频段选取的表情样本图像,在第一组表情样本图像中,中的x

k1

可表示基准图像,x

k2

可表示第一图像,中的x

k5

可表示第二图像;在第二组表情样本图像中,中的x

k5

可表示基准图像,x

k4

可表示第一图像,中的x

k1

可表示第二图像,f(x)表示初始编码网络,g

exp

(x)表示初始表情提取分支,此处,初始表情提取分支中可以包括投影模块用于实现输入的特征从图像编码维度向表情特征维度的转换。

[0110]

基于上述任一实施例,初始提取网络还包括初始身份提取分支,图3是本发明提供的初始提取网络的训练方法的流程示意图之二,如图3所示,步骤250中基于表情提取损失,对初始提取网络进行训练,包括:

[0111]

步骤251,基于初始编码网络,确定样本图像的预测图像特征;

[0112]

步骤252,基于初始身份提取分支,对样本图像的预测图像特征进行身份特征提取,得到样本图像的预测身份特征;

[0113]

步骤253,基于对应同一人脸的各样本图像的预测身份特征,确定第一身份特征相似度,基于对应不同人脸的各样本图像的预测身份特征,确定第二身份特征相似度;

[0114]

步骤254,基于第一身份特征相似度和第二身份特征相似度,确定身份提取损失;

[0115]

步骤255,基于表情提取损失和身份提取损失,对初始提取网络进行训练。

[0116]

具体地,由于经编码网络提取得到的图像特征可以包括表情特征和身份特征,为了实现在表情提取网络提取到的表情特征更多的聚焦于表情信息上,尽量减少身份特征的影响,在进行表情特征提取的同时,进行身份特征的提取,实现表情特征和身份特征解耦。因此,初始提取网络还包括初始身份提取分支,用于对身份特征进行特征提取。

[0117]

此处的样本图像可以是从样本人脸视频中选取的视频帧,将样本图像输入初始提取网络中的初始编码网络后,得到预测图像特征;再将预测图像特征输入初始提取网络中的初始身份提取分支后,得到样本图像的预测身份特征。

[0118]

可以理解的是,初始表情提取分支和初始身份提取分支共享初始提取网络中的初始编码部分,通过共用图像特征提取部分实现表情特征和身份特征之间的信息共享。

[0119]

第一身份特征相似度即对应同一人脸的各样本图像的预测身份特征之间的相似度,由于各样本图像对应同一人脸,第一身份特征相似度越高,则各样本图像的预测身份特征越能够反映各样本图像的身份特征的共性特征。

[0120]

第二身份特征相似度即对应不同人脸的各样本图像的预测身份特征之间的相似度,由于各样本图像对应不同的人脸,第二身份特征相似度越低,则各样本图像的预测身份特征越能够反映各样本图像的身份特征的差异性特征。

[0121]

第一身份特征相似度和第二身份特征相似度可以根据相对应的预测身份特征来确定,具体可以采用特征相似度计算函数得到,例如,欧几里得距离函数、余弦相似度函数或相关系数等,本发明实施例对此不作具体限定。

[0122]

由第一身份特征相似度和第二身份特征相似度确定的身份提取损失,用于实现第一身份特征相似度的最大化,以及第二身份特征相似度的最小化。由此确定的身份提取损失,使得编码网络和身份提取网络在训练过程中能够尽量多地学习身份相同的样本图像的共性特征,以及身份不同的样本图像的差异性特征。

[0123]

随即,可以联合表情提取损失和身份提取损失,对初始提取网络进行训练,从而使得训练得到的表情提取网络所提取得到的表情特征能够充分表征待识别人脸图像中的表情信息,训练得到的身份提取网络所提取的身份特征能够充分表征待识别人脸图像中的身份信息,使得表情特征和身份特征充分解耦。

[0124]

本发明实施例提供的方法,通过基于第一身份特征相似度和第二身份特征相似度,确定身份提取损失;并基于表情提取损失和身份提取损失,对初始提取网络进行训练,使得表情特征和身份特征充分解耦。

[0125]

在一个实施例中,在网络训练的过程中,每次随机采样k个视频段,对于每一个视频段,选取5帧样本图像,因此共获得5k个视频帧。则初始身份提取分支的损失可以表示为如下形式:

[0126][0127]

式中,x

ki

和x

kj

分别表示对应同一人脸的各样本图像,x

pn

和x

qn

分别表示对应不同人脸的各样本图像,f(x)表示初始编码网络,g

id

(x)表示初始身份提取分支,此处,初始身份提取分支中可以包括投影模块,用于实现输入的特征从图像编码维度向表情特征维度的转换。身份提取分支的最终优化目标即最小化损失函数l

id

。

[0128]

因此,初始提取网络的损失函数可以由表情损失和身份损失共同确定,可表示为如下形式:

[0129]

l=l

id

λ1l

exp

[0130]

式中,λ1是超参数,可以根据具体的实验进行调节。

[0131]

基于上述任一实施例,初始提取网络还包括初始解码网络,图4是本发明提供的初始提取网络的训练方法的流程示意图之三,如图4所示,步骤255具体包括:

[0132]

步骤2551,基于初始解码网络,对样本图像的预测表情特征和预测身份特征进行

特征解码,得到样本图像的重建图像特征;

[0133]

步骤2552,基于样本图像的预测图像特征和重建图像特征,确定解码损失;

[0134]

步骤2553,基于表情提取损失和身份提取损失,以及解码损失,对初始提取网络进行训练。

[0135]

具体地,为了进一步验证表情特征提取和身份特征提取的独立性和完整性,初始提取网络还包括初始解码网络,初始解码网络用于对样本图像的预测表情特征和预测身份特征进行特征解码。

[0136]

具体可以是将任意一帧样本图像,送进初始编码网络,得到样本图像的预测图像特征;

[0137]

预测图像特征分别经过初始表情提取分支和初始身份提取分支后,得到解耦之后的预测表情特征和预测身份特征;

[0138]

将预测表情特征和预测身份特征融合后,送入初始解码网络,对融合后的预测表情特征和预测身份特征进行特征解码,得到样本图像的重建图像特征。

[0139]

在此基础上,即可基于预测预测图像特征和重建图像特征,确定解码损失。此处,解码损失可以表征样本图像的预测图像特征和重建图像特征之间的差异性,差异性越大,表示解码损失越大;差异性越小,表示解码损失越小。为了保证图像特征解耦成表情特征和身份特征的独立性和完整性,可以约束解码损失最小。

[0140]

进一步地,可以根据样本图像的预测图像特征和重建图像特征之间的差值,表征两者之间的差异性。

[0141]

从而可以根据情提取损失和身份提取损失,以及解码损失,对初始提取网络进行训练,使得训练得到的初始提取网络可以同时学习到表情特征和身份特征,并且能够根据解耦得到的表情特征和身份特征,通过特征解码,恢复到解耦之前的图像特征。

[0142]

在一个实施例中,初始解码网络的损失可以表示为如下形式:

[0143][0144]

式中,x

kn

表示任意一帧样本图像,h(x)表示初始解码网络。初始解码网络的最终优化目标即最小化损失函数l

decoder

。

[0145]

因此,初始提取网络的损失函数可以由表情损失、身份损失和解码损失共同确定,可表示为如下形式:

[0146]

l=l

id

λ1l

exp

λ2l

decoder

[0147]

式中,λ1和λ2都是超参数,可以根据具体的实验进行调节。

[0148]

本发明实施例提供的方法,通过联合表情损失、身份损失和解码损失,使得训练得到的初始提取网络可以同时学习到表情特征和身份特征,并且能够根据解耦得到的表情特征和身份特征,通过特征解码,恢复到解耦之前的图像特征,进一步提高了表情特征提取的准确率和可靠性。

[0149]

基于上述任一实施例,图5是本发明提供的初始提取网络的训练方法的流程示意图之四,如图5所示,步骤2553具体包括:

[0150]

基于表情提取损失和身份提取损失,以及解码损失,对初始提取网络进行第一阶

段训练,得到第一阶段训练后的初始提取网络作为第一提取网络;

[0151]

基于对应不同人脸的样本图像的预测身份特征和预测表情特征,生成扰动特征;

[0152]

基于第一提取网络中的第一解码网络,对扰动特征进行特征解码,得到扰动重建特征;

[0153]

基于第一提取网络中的第一表情提取分支,对扰动重建特征进行表情特征提取,得到扰动特征的重建表情特征,和/或,基于第一提取网络中的第一身份提取分支,对扰动重建特征进行身份特征提取,得到扰动特征的重建身份特征;

[0154]

基于扰动特征的重建表情特征和预测表情特征,确定表情扰动损失,和/或,基于扰动特征的重建身份特征和预测身份特征,确定身份扰动损失;

[0155]

基于表情提取损失和表情扰动损失,和/或,基于身份提取损失和身份扰动损失对第一表情提取分支和/或第一身份提取分支进行训练。

[0156]

具体地,初始提取网络训练一定的时间之后,此时初始人脸表情分支与初始人脸身份分支已经能够各自学习到较好的表征信息了,并且初始解码网络也具有较强的解码能力。此时初始提取网络已经完成了第一阶段的训练,得到第一提取网络。

[0157]

为了使得表情提取分支和身份提取分支能够学习到更加聚焦各自分支的特征信息,使得学习到的特征信息更加具有鲁棒性,在第一提取网络的基础上继续对表情提取分支和身份提取分支进行扰动训练,具体可以对两个分支相互添加扰动。

[0158]

针对表情提取分支,每一帧图像的特征向量都代表从该帧提取的表情信息,因此即使对表情提取分支添加身份信息扰动,该分支应该依然能够提取出表情信息;同理,对身份提取分支添加表情信息扰动,身份分支依然能够提取出身份信息。

[0159]

将对应不同人脸的样本图像分别送入第一提取网络,得到预测身份特征和预测表情特征,此处的预测身份特征即添加扰动之前的身份特征,预测表情特征即添加扰动之前的表情特征。

[0160]

基于预测身份特征和预测表情特征,生成扰动特征,扰动特征可以是预测身份特征和预测表情特征的融合特征,例如两者相加得到的融合特征。

[0161]

需要说明的是,针对表情提取分支,扰动特征可以表示对表情提取分支添加身份信息扰动;而针对身份提取分支,扰动特征可以表示对身份提取分支添加表情信息扰动。

[0162]

将扰动特征送入第一提取网络中的第一解码网络,对扰动特征进行特征解码,得到扰动重建特征。

[0163]

针对表情提取分支而言,可以将扰动重建特征送入第一提取网络中的第一表情提取分支,对扰动重建特征进行表情特征提取,得到扰动特征的重建表情特征。表情扰动损失用来表征扰动特征的重建表情特征和预测表情特征之间的差异性,即重建表情特征和添加扰动前的表情特征之间的差异性。两者之间的差异越大,表示表情扰动损失越大;两者之间的差异越小,表示表情扰动损失越小。为了约束重建表情特征与添加扰动前的表情特征逼近,从而使得表情提取分支能够学习到不受身份信息影响的表情信息,提升该分支的鲁棒性,可以约束表情扰动损失最小。

[0164]

同理,针对身份提取分支而言,可以将扰动重建特征送入第一提取网络中的第一身份提取分支,对扰动重建特征进行身份特征提取,得到扰动特征的重建身份特征。身份扰动损失用来表征扰动特征的重建身份特征和预测身份特征之间的差异性,即重建身份特征

和添加扰动前的身份特征之间的差异性。两者之间的差异越大,表示身份扰动损失越大;两者之间的差异越小,表示身份扰动损失越小。为了约束重建身份特征与添加扰动前的身份特征逼近,从而使得身份提取分支能够学习到不受表情信息影响的身份信息,提升该分支的鲁棒性,可以约束身份扰动损失最小。

[0165]

因此,可以联合表情提取损失和表情扰动损失,对第一表情提取分支进行训练;联合身份提取损失和身份扰动损失,对第一身份提取分支进行训练。

[0166]

需要说明的是,在对第一表情提取分支进行训练,和/或,对第一身份提取分支进行训练时,可以将第一解码网络的参数固定住不参与训练,仅调整第一表情提取分支和/或第一身份提取分支的参数。

[0167]

本发明实施例提供的方法,通过在第一提取网络的基础上继续对表情提取分支和/或身份提取分支进行扰动训练,分别对两个分支相互添加扰动,使得表情提取分支和身份提取分支学习到的特征信息更加具有鲁棒性。

[0168]

基于上述任一实施例,基于扰动特征的重建表情特征和预测表情特征,确定表情扰动损失,和/或,基于扰动特征的重建身份特征和预测身份特征,确定身份扰动损失,包括:

[0169]

基于扰动特征的重建表情特征和预测表情特征之间的差值,确定表情扰动损失;和/或,基于扰动特征的重建身份特征和预测身份特征之间的差值,确定身份扰动损失。

[0170]

具体地,表情扰动损失用来表征扰动特征的重建表情特征和预测表情特征之间的差异性,具体可以根据重建表情特征和预测表情特征之间的差值,确定表情扰动损失;身份扰动损失用来表征扰动特征的重建身份特征和预测身份特征之间的差异性,具体可以根据重建身份特征和预测身份特征之间的差值,确定身份扰动损失。

[0171]

进一步地,表情扰动损失的损失函数可以表示为如下形式:

[0172][0173]

sub to:k

′

=ran int(1,k)and k

′

≠k;n

′

=ran int(1,5)

[0174]

式中,x

kn

和xk′n′

分别表示对应不同人脸的样本图像,g

exp

(f(x

kn

))表示第k个视频中第n个样本图像的预测表情特征;g

exp

(f(x

kn

)) g

id

(f(xk′n′

))表示第k个视频中第n个样本图像的预测表情特征和第k

′

个视频中第n

′

个样本图像的预测身份特征相加,得到的扰动特征;h(g

exp

(f(x

kn

)) g

id

(f(xk′n′

)))表示对扰动特征进行特征解码后,得到的扰动重建特征;g

exp

(h(g

exp

(f(x

kn

)) g

id

(f(xk′n′

))))表示扰动特征的重建表情特征。表情扰动损失的最终优化目标即最小化损失函数l

exp1

。

[0175]

身份扰动损失的损失函数可以表示为如下形式:

[0176][0177]

sub to:k

′

=ran int(1,k)and k

′

≠k;n

′

=ran int(1,5)

[0178]

式中,g

id

(f(x

kn

))表示第k个视频中第n个样本图像的预测身份特征;g

id

(f(x

kn

)) g

exp

(f(xk′n′

))表示第k个视频中第n个样本图像的预测身份特征和第k

′

个视频中第n

′

个样

本图像的预测表情特征相加,得到的扰动特征;h(g

id

(f(x

kn

)) g

exp

(f(xk′n′

)))表示对扰动特征进行特征解码后,得到的扰动重建特征;g

id

(h(g

id

(f(x

kn

)) g

exp

(f(xk′n′

))))表示扰动特征的重建身份特征。身份扰动损失的最终优化目标即最小化损失函数l

exp1

。

[0179]

因此,第一提取网络的损失函数可以表示为如下形式:

[0180]

l=l

id

λ3l

id1

λ4l

exp

λ5l

exp1

[0181]

式中,l

id

表示身份提取损失,l

id1

表示身份扰动损失,l

exp

表示表情提取损失,l

exp1

表示表情扰动损失,λ3、λ4和λ5都是超参数,可以根据具体的实验进行调节。

[0182]

当网络训练的损失值保持稳定之后,停止训练。

[0183]

基于上述任一实施例,步骤250中基于表情提取损失,对初始提取网络进行训练,之后还包括:

[0184]

基于携带表情分类标签的样本图像,对训练完成的初始编码网络和初始表情提取分支,联合初始分类网络进行微调,将微调完成后的初始编码网络、初始表情提取分支和初始分类网络分别作为编码网络、表情提取网络和表情分类网络。

[0185]

具体地,基于表情提取损失,对初始提取网络进行训练,得到训练完成的初始编码网络和初始表情提取分支。由于该训练完成的初始编码网络和初始表情提取分支并未使用真实的人脸表情有标签数据进行训练,因此为了更好地利用表情信息,进一步提高人脸表情识别的精度,需要利用有标签数据对该网络做迁移学习,直到训练损失稳定为止。

[0186]

此处携带表情分类标签的样本图像即对样本图像进行了标记,标记了该样本图像所指示的表情分类,例如,开心、惊讶或者难过等。

[0187]

初始分类网络可以是分类器或者神经网络,例如,vgg16网络或者残差网络等。

[0188]

微调完成后的初始编码网络可以作为编码网络,用来对待识别图像进行图像特征提取,得到图像特征;微调完成后的初始表情提取分支可以作为表情提取网络,用来进一步对图像特征进行表情特征提取,得到表情特征;微调完成后的初始分类网络可以作为表情分类网络,用来对表情特征进行表情分类,得到表情识别结果。

[0189]

需要说明的是,相较于直接使用标签图像进行网络训练,使用携带表情分类标签的样本图像对网络进行微调,能够大大减少标签样本数量,减少标注成本,省时省力。

[0190]

本发明实施例提供的方法,通过使用携带表情分类标签的样本图像对网络进行微调,能够进一步提高人脸表情识别精度的同时,大大减少标签样本数量,减少标注成本,省时省力,提高了表情识别的效率。

[0191]

基于上述任一实施例,图6是本发明提供的基准图像、第一图像和第二图像确定方法的流程示意图,如图6所示,基准图像、第一图像和第二图像基于如下步骤确定:

[0192]

步骤610,确定样本人脸视频,样本人脸视频中的各帧图像对应同一人脸;

[0193]

步骤620,从样本人脸视频的图像帧序列中,提取相邻两帧图像作为基准图像和第一图像,提取与基准图像间的时间间隔最远的一帧图像作为第二图像。

[0194]

具体地,样本人脸视频即包含人脸的样本视频,每一个样本人脸视频中的各帧图像对应同一人脸,也就是说,来自于同一个样本人脸视频的各帧图像,其中的人脸都是同一个人。

[0195]

可以从样本人脸视频中选取不同时刻的图像帧,按照时间顺序排列成图像帧序列,提取相邻两帧图像作为基准图像和第一图像,提取与基准图像间的时间间隔最远的一

帧图像作为第二图像,由此提取得到的基准图像与第一图像间的时间间隔小于基准图像与第二图像间的时间间隔。

[0196]

在一个实施例中,对于任意一个样本人脸视频,可以等间隔选取5帧图像,按时间顺序排列成x1、x2、x3、x4、x5,将前两帧x1、x2与最后一帧x5构成一个样本图像组,其中x1和x2分别作为基准图像和第一图像,x5作为第二图像;还可以将第一帧x1与最后两帧x4、x5构成另一个样本图像组,其中x4和x5分别作为基准图像和第一图像,x1作为第二图像。

[0197]

基于上述任一实施例,样本人脸视频可以通过如下步骤确定:

[0198]

准备初始数据集:从网络下载大量的短视频或电影、电视剧等可能包含人脸的长视频,还可以是通过视频采集设备得到的。

[0199]

对于得到的大量长视频,需要从其中将每一个人的不连续的视频段切分出来,因此可以借助人脸检测与人脸跟踪模型,具体步骤如下:

[0200]

①

对每一个长视频的视频帧进行人脸检测,以检测到人脸的第一帧为起始帧,并确定其中人脸框的位置;

[0201]

②

对确定的人脸进行跟踪,直到检测不到人脸或人物身份发生变化,将这个过程中的视频段切割出来;

[0202]

③

对所有切割出的视频段再根据时长进行处理,将时长大于5秒的,按每5秒进行切分,并且将所有时长小于3秒的视频进行丢弃;

[0203]

依据上述步骤,可得到最终用于训练的所有的视频段,即样本人脸视频。

[0204]

基于上述任一实施例,表情识别还可以通过表情识别模型实现,将待识别图像输入表情识别模型,从而得到表情识别结果。其中,表情识别模型包括编码网络、表情提取网络和表情分类网络。

[0205]

可以构建一个自监督学习网络,对初始表情识别模型进行训练,从而得到训练完成的表情识别模型。图7是本发明提供的自监督学习网络的数据流向示意图,如图7所示,自监督学习网络包括初始编码网络、初始表情提取分支、初始身份提取分支和初始解码网络,其中,初始表情提取分支和初始身份提取分支共享初始编码网络。

[0206]

表情识别模型的训练过程中,通过自监督学习分别学习人脸表情特征和人脸身份特征,分别对初始表情提取分支和初始身份提取分支施加不同的约束条件,从而使得模型能够学习到相应的表征信息,使得表情特征和身份特征解耦。

[0207]

同时添加了初始解码网络,目的是为了使得表情特征和身份特征融合之后依然能恢复出解耦之间的特征。

[0208]

首先,为了让初始身份提取分支能够很好地学习到人物身份信息,通过设计相应的对比学习损失来约束该分支。身份提取的损失函数设计思想如下:对于来自于同一个视频段的视频帧,默认其中的人脸都是同一个人,而来自于不同视频段的视频帧中包含的人脸来自于不同的人。因此对于每一个视频段,等间隔地选取5帧图像,基于来自于同一个视频段的视频帧,确定第一身份特征相似度;基于来自于不同视频段的视频帧,确定第二身份特征相似度。并基于第一身份特征相似度和第二身份特征相似度,确定身份提取损失函数。

[0209]

同时,对于初始表情提取分支,由于人的表情变化是一个连续的过程,因此在一个视频段中,离的越近的视频帧之间表情相似度越高,而离的越远的视频帧之间表情相似度越低,因此时序上离得近的两帧的特征相似度大于时序上离得远的两帧的特征相似度,并

据此来设计表情提取损失函数。

[0210]

对于初始解码网络,目标是将任何一帧图像送进初始编码网络,通过初始表情提取分支和初始身份提取分支解耦之后的人脸表情表征向量与人脸身份表征向量相加,之后送入初始解码网络依然能恢复出解耦之前的特征表示,并据此来设计解码损失函数。

[0211]

在网络训练的第一阶段,利用身份提取损失函数和表情提取损失函数分别监督初始人脸身份提取分支、初始人脸表情提取分支以及初始编码网络的训练,利用解码损失函数监督初始解码网络的训练。分别得到第一编码网络、第一人脸身份提取分支、第一人脸表情提取分支和第一解码网络。

[0212]

之后设计网络训练的第二阶段,在第二阶段将第一解码网络的参数固定住不参与训练,为了使得两个提取分支能够学习到更加鲁棒的特征,对两个分支相互添加扰动,进行扰动训练。扰动损失函数的设计思想是:针对第一表情提取分支,对于每一个视频段等间隔选取的5帧图像提取到的表情表征向量随机添加其他任意一个视频段图像提取的一个身份表征向量,将两者相加并送入第一解码网络,之后通过第一解码网络解码出的特征表示再送入第一人脸表情提取分支得到人脸表情向量,通过约束该向量与添加扰动之前的表情向量逼近,设计表情扰动损失。同理,针对第一身份提取分支,设计身份扰动损失。

[0213]

上述两个阶段训练完毕后,为了更好地利用表情信息,将第一编码网络及第一人脸表情提取分支提取出来,联合表情分类网络,利用有标签数据对其进行微调,直到训练损失稳定为止,得到表情识别模型,用来对待识别图像进行表情识别。

[0214]

本发明实施例提供的将人脸身份信息与人脸表情信息解耦的自监督学习方案,通过同时学习人脸身份信息与人脸表情信息,并将两者进行解耦,且在学习的过程中进行相互扰动,从而学习到更加鲁棒的身份信息与表情信息,因此可以更好地迁移到下游人脸表情识别任务上。

[0215]

下面对本发明提供的表情识别装置进行描述,下文描述的表情识别装置与上文描述的表情识别方法可相互对应参照。图8是本发明提供的表情识别装置的结构示意图,如图8所示,该装置包括:

[0216]

图像特征确定单元810,用于基于编码网络,确定待识别的人脸图像的图像特征;

[0217]

表情特征提取单元820,用于基于表情提取网络,对所述图像特征进行表情特征提取,得到表情特征;

[0218]

表情识别单元830,用于基于表情分类网络,对所述表情特征进行表情识别;

[0219]

所述表情提取网络基于基准图像和第一图像之间的第一表情特征相似度,以及所述基准图像和第二图像之间的第二表情特征相似度训练得到,所述基准图像、第一图像和第二图像对应样本人脸视频中的同一人脸,所述基准图像与所述第一图像间的时间间隔小于所述基准图像与所述第二图像间的时间间隔。

[0220]

本发明提供的表情识别装置,通过基于基准图像和第一图像之间的第一表情特征相似度,以及基准图像和第二图像之间的第二表情特征相似度训练得到表情提取网络,从而使得表情提取网络能够更好地区分同一人脸表情变化下的表情特征之间的差异,提取到的表情特征更多的聚焦于表情信息;并基于表情特征进行表情识别,避免了收集大量人脸表情数据,减少了人工标注成本的同时,有效提高了人脸表情识别结果的准确率和可靠性。

[0221]

基于上述任一实施例,该装置还包括网络训练单元,网络训练单元用于:

[0222]

确定初始提取网络,所述初始提取网络包括初始编码网络和初始表情提取分支;

[0223]

基于所述初始提取网络,分别确定所述基准图像、所述第一图像和所述第二图像的预测表情特征;

[0224]

基于所述基准图像和所述第一图像的预测表情特征,确定所述第一表情特征相似度,基于所述基准图像和所述第二图像的预测表情特征,确定所述第二表情特征相似度;

[0225]

基于所述第一表情特征相似度和所述第二表情特征相似度,确定表情提取损失;

[0226]

基于所述表情提取损失,对所述初始提取网络进行训练,得到所述编码网络和所述表情提取网络。

[0227]

基于上述任一实施例,网络训练单元进一步用于:

[0228]

基于所述第一表情特征相似度和所述第二表情特征相似度之间的差值,确定表情提取损失。

[0229]

基于上述任一实施例,网络训练单元进一步用于:

[0230]

基于所述初始编码网络,确定样本图像的预测图像特征;

[0231]

基于所述初始身份提取分支,对所述样本图像的预测图像特征进行身份特征提取,得到所述样本图像的预测身份特征;

[0232]

基于对应同一人脸的各样本图像的预测身份特征,确定第一身份特征相似度,基于对应不同人脸的各样本图像的预测身份特征,确定第二身份特征相似度;

[0233]

基于所述第一身份特征相似度和第二身份特征相似度,确定身份提取损失;

[0234]

基于所述表情提取损失和所述身份提取损失,对所述初始提取网络进行训练。

[0235]

基于上述任一实施例,网络训练单元进一步用于:

[0236]

基于所述初始解码网络,对所述样本图像的预测表情特征和预测身份特征进行特征解码,得到所述样本图像的重建图像特征;

[0237]

基于所述样本图像的预测图像特征和重建图像特征,确定解码损失;

[0238]

基于所述表情提取损失和所述身份提取损失,以及所述解码损失,对所述初始提取网络进行训练。

[0239]

基于上述任一实施例,网络训练单元进一步用于:

[0240]

基于所述表情提取损失和所述身份提取损失,以及所述解码损失,对所述初始提取网络进行第一阶段训练,得到第一阶段训练后的初始提取网络作为第一提取网络;

[0241]

基于对应不同人脸的样本图像的预测身份特征和预测表情特征,生成扰动特征;

[0242]

基于所述第一提取网络中的第一解码网络,对所述扰动特征进行特征解码,得到扰动重建特征;

[0243]

基于所述第一提取网络中的第一表情提取分支,对所述扰动重建特征进行表情特征提取,得到所述扰动特征的重建表情特征,和/或,基于所述第一提取网络中的第一身份提取分支,对所述扰动重建特征进行身份特征提取,得到所述扰动特征的重建身份特征;

[0244]

基于所述扰动特征的重建表情特征和预测表情特征,确定表情扰动损失,和/或,基于所述扰动特征的重建身份特征和预测身份特征,确定身份扰动损失;

[0245]

基于所述表情提取损失和所述表情扰动损失,和/或,基于所述身份提取损失和所述身份扰动损失,对所述第一表情提取分支和/或所述第一身份提取分支进行训练。

[0246]

基于上述任一实施例,网络训练单元进一步用于:

[0247]

基于所述扰动特征的重建表情特征和预测表情特征之间的差值,确定表情扰动损失;和/或,基于所述扰动特征的重建身份特征和预测身份特征之间的差值,确定身份扰动损失。

[0248]

基于上述任一实施例,本发明实施例提供的表情识别装置还包括网络微调单元,网络微调单元用于:

[0249]

基于携带表情分类标签的样本图像,对训练完成的初始编码网络和初始表情提取分支,联合初始分类网络进行微调,将微调完成后的初始编码网络、初始表情提取分支和初始分类网络分别作为所述编码网络、所述表情提取网络和所述表情分类网络。

[0250]

基于上述任一实施例,本发明实施例提供的表情识别装置还包括图像提取单元,图像提取单元用于:

[0251]

确定样本人脸视频,所述样本人脸视频中的各帧图像对应同一人脸;

[0252]

从所述样本人脸视频的图像帧序列中,提取相邻两帧图像作为基准图像和第一图像,提取与所述基准图像间的时间间隔最远的一帧图像作为第二图像。

[0253]

图9示例了一种电子设备的实体结构示意图,如图9所示,该电子设备可以包括:处理器(processor)910、通信接口(communications interface)920、存储器(memory)930和通信总线940,其中,处理器910,通信接口920,存储器930通过通信总线940完成相互间的通信。处理器910可以调用存储器930中的逻辑指令,以执行图像识别方法,该方法包括:基于编码网络,确定待识别的人脸图像的图像特征;基于表情提取网络,对所述图像特征进行表情特征提取,得到表情特征;基于表情分类网络,对所述表情特征进行表情识别;所述表情提取网络基于基准图像和第一图像之间的第一表情特征相似度,以及所述基准图像和第二图像之间的第二表情特征相似度训练得到,所述基准图像、第一图像和第二图像对应样本人脸视频中的同一人脸,所述基准图像与所述第一图像间的时间间隔小于所述基准图像与所述第二图像间的时间间隔。

[0254]

此外,上述的存储器930中的逻辑指令可以通过软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。基于这样的理解,本发明的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质中,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本发明各个实施例所述方法的全部或部分步骤。而前述的存储介质包括:u盘、移动硬盘、只读存储器(rom,read-only memory)、随机存取存储器(ram,random access memory)、磁碟或者光盘等各种可以存储程序代码的介质。

[0255]

另一方面,本发明还提供一种计算机程序产品,所述计算机程序产品包括计算机程序,计算机程序可存储在非暂态计算机可读存储介质上,所述计算机程序被处理器执行时,计算机能够执行上述各方法所提供的图像识别方法,该方法包括:基于编码网络,确定待识别的人脸图像的图像特征;基于表情提取网络,对所述图像特征进行表情特征提取,得到表情特征;基于表情分类网络,对所述表情特征进行表情识别;所述表情提取网络基于基准图像和第一图像之间的第一表情特征相似度,以及所述基准图像和第二图像之间的第二表情特征相似度训练得到,所述基准图像、第一图像和第二图像对应样本人脸视频中的同一人脸,所述基准图像与所述第一图像间的时间间隔小于所述基准图像与所述第二图像间

的时间间隔。

[0256]

又一方面,本发明还提供一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现以执行上述各方法提供的图像识别方法,该方法包括:基于编码网络,确定待识别的人脸图像的图像特征;基于表情提取网络,对所述图像特征进行表情特征提取,得到表情特征;基于表情分类网络,对所述表情特征进行表情识别;所述表情提取网络基于基准图像和第一图像之间的第一表情特征相似度,以及所述基准图像和第二图像之间的第二表情特征相似度训练得到,所述基准图像、第一图像和第二图像对应同一人脸,所述基准图像与所述第一图像间的时间间隔小于所述基准图像与所述第二图像间的时间间隔。

[0257]

以上所描述的装置实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。本领域普通技术人员在不付出创造性的劳动的情况下,即可以理解并实施。

[0258]

通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到各实施方式可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件。基于这样的理解,上述技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在计算机可读存储介质中,如rom/ram、磁碟、光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行各个实施例或者实施例的某些部分所述的方法。

[0259]

最后应说明的是:以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。