以存储器内计算阵列进行神经网络的卷积层的并行处理

1.根据35u.s.c.

§

119的优先权要求

2.本专利申请要求于2019年9月19日提交的题为“parallel processing of a convolutional layer of a neural network with compute-in-memory array(以存储器内计算阵列进行神经网络的卷积层的并行处理)”的非临时申请no.16/576,597的优先权,该非临时申请被转让给本技术受让人并因而通过援引被明确纳入于此。

3.公开领域

4.本公开的各方面一般涉及以存储器内计算阵列进行神经网络的卷积层的并行处理。

背景技术:

5.常规地,卷积神经网络(cnn)中的卷积层使用小尺寸过滤器。然而,卷积神经网络有时具有非常大量的输入输出通道。因此,过滤器在乘法和累加(mac)运算中被重用多次以生成所有的输出,这花费众多循环,而且耗时。

6.在一些数字实现(例如,32位或以下的数字实现)中,卷积神经网络的过滤器可被数字克隆。尽管数字克隆过滤器减少了卷积神经网络的循环,但数字克隆过滤器显著增加了功耗。这是因为数字克隆过程涉及移动过滤器权重和并行激活,这在短时间段内消耗大量能量。

7.概述

8.一种装置包括第一和第二存储器内计算(cim)阵列。第一cim阵列被配置成:存储与过滤器张量相对应的多个权重,以接收与输入的第一感受野相对应的第一组激活,并使用这些权重来处理第一组激活,以生成对应的输出值第一张量。第二cim阵列被配置成:存储与该过滤器张量相对应的这些权重的第一副本,接收与该输入的第二感受野相对应的第二组激活,并使用这些权重的第一副本来处理第二组激活,以生成对应的输出值第二张量。第一存储器内计算阵列和第二存储器内计算阵列被配置成并行地处理第一感受野和第二感受野。

9.用于卷积神经网络的卷积层的处理方法包括将与过滤器张量相对应的多个权重存储在第一存储器内计算阵列中。该方法还包括:由第一存储器内计算阵列来接收与输入的第一感受野相对应的第一组激活。该方法包括将与该过滤器张量相对应的这些权重的第一副本存储在第二存储器内计算阵列中。该方法进一步包括:由第二存储器内计算阵列来接收与该输入的第二感受野相对应的第二组激活。此外,该方法包括:在第一存储器内计算阵列中使用这些权重来处理第一组激活以生成对应的输出值第一张量,并且在第二存储器内计算阵列中使用这些权重的第一副本来处理第二组激活以生成对应的输出值第二张量。第一存储器内计算阵列和第二存储器内计算阵列被配置成并行地处理第一感受野和第二感受野。

10.一种设备包括用于在一组激活上执行逐位运算和位计数的第一和第二装置。第一装置被配置成:存储与过滤器张量相对应的多个权重,接收与输入的第一感受野相对应的

第一组激活,并使用这些权重来处理第一组激活,以生成对应的输出值第一张量。第二装置被配置成:存储与该过滤器张量相对应的这些权重的第一副本,接收与该输入的第二感受野相对应的第二组激活,并使用这些权重的第一副本来处理第二组激活,以生成对应的输出值第二张量。第一装置和第二装置被配置成并行地处理第一感受野和第二感受野。

11.这已较宽泛地勾勒出本公开的特征和技术优势以便下面的详细描述可被更好地理解。本公开的附加特征和优点将在下文描述。本领域技术人员应当领会,本公开可容易地被用作修改或设计用于实施与本公开相同的目的的其他结构的基础。本领域技术人员还应认识到,这样的等效构造并不脱离所附权利要求中所阐述的本公开的教导。被认为是本公开的特性的新颖特征在其组织和操作方法两方面连同进一步的目的和优点在结合附图来考虑以下描述时将被更好地理解。然而,要清楚理解的是,提供每一幅附图均仅用于解说和描述目的,且无意作为对本公开的限定的定义。

12.附图简述

13.在结合附图理解下面阐述的详细描述时,本公开的特征、本质和优点将变得更加明显,在附图中,相同附图标记始终作相应标识。

14.图1解说了根据本公开的某些方面的使用片上系统(soc)(包括通用处理器)来设计神经网络的示例实现。

15.图2a、2b和2c是解说根据本公开的各方面的神经网络的示图。

16.图2d是解说根据本公开的各方面的示例性深度卷积网络(dcn)的示图。

17.图3是解说根据本公开的各方面的示例性深度卷积网络(dcn)的示图。

18.图4解说了具有存储器内计算(cim)阵列的示例性卷积层架构。

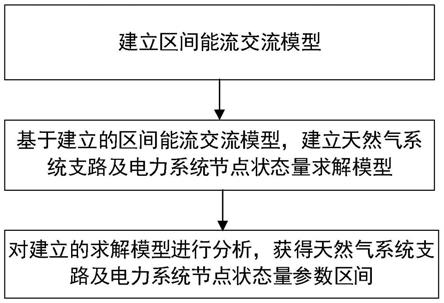

19.图5解说了根据本公开的各方面的用于卷积层中的存储器内计算(cim)并行处理的神经网络架构。

20.图6解说了根据本公开的各方面的人工神经网络的存储器内计算(cim)阵列的架构。

21.图7解说了根据本公开的各方面的存储器内计算阵列的位单元。

22.图8示出了用于存储器内计算(cim)阵列运算的各种信号的时序图。

23.图9解说了根据本公开的各方面的卷积神经网络的卷积层的并行处理方法。

24.详细描述

25.以下结合附图阐述的详细描述旨在作为各种配置的描述,而无意表示可实践本文中所描述的概念的仅有配置。本详细描述包括具体细节以提供对各种概念的透彻理解。然而,对于本领域技术人员将显而易见的是,没有这些具体细节也可以实践这些概念。在一些实例中,以框图形式示出众所周知的结构和组件以便避免湮没此类概念。

26.基于本教导,本领域技术人员应领会,本公开的范围旨在覆盖本公开的任何方面,不论其是与本公开的任何其他方面相独立地还是组合地实现的。例如,可以使用所阐述的任何数目的方面来实现装置或实践方法。另外,本公开的范围旨在覆盖使用作为所阐述的本公开的各个方面的补充或者与之不同的其他结构、功能性、或者结构及功能性来实践的此类装置或方法。应当理解,所披露的本公开的任何方面可由权利要求的一个或多个元素来实施。

27.措辞“示例性”在本文中用于意指“用作示例、实例、或解说”。本文中描述为“示例

性”的任何方面不必被解释为优于或胜过其他方面。

28.尽管本文描述了特定方面,但这些方面的众多变体和置换落在本公开的范围之内。虽然提到了优选方面的一些益处和优点,但本公开的范围并非旨在被限定于特定益处、用途或目标。相反,本公开的各方面旨在能宽泛地应用于不同的技术、系统配置、网络和协议,其中一些作为示例在附图以及以下对优选方面的描述中解说。详细描述和附图仅仅解说本公开而非限定本公开,本公开的范围由所附权利要求及其等效技术方案来定义。

29.常规地,卷积神经网络(cnn)中的卷积层使用小尺寸过滤器。然而,卷积神经网络有时具有非常大量的输入输出通道。因此,过滤器在乘法和累加(mac)运算中被重用多次以生成所有的输出,这花费众多个循环,而且耗时。

30.在一些数字实现(例如,32位或以下的数字实现)中,卷积神经网络的过滤器可被数字克隆。尽管数字克隆该过滤器减少了卷积神经网络的循环,但数字克隆过滤器显著增加了功耗。这是因为数字克隆过程涉及移动过滤器权重和并行激活,这在短时间段内消耗大量能量。

31.根据本公开的各方面来操作的具有二值激活和权重的二值神经网络(bnn)达成了对于大多数人工智能(ai)任务而言足够的准确性。作为模拟实现,存储器内计算(cim)是实现bnn的最佳方式之一。使用bnn允许用逐位运算(像xnor和位计数)来替换mac操作。在cim中实现bnn允许节省功率和时间。即,每个存储单元也是计算单元。存储器内计算二值神经网络中的优点之一是能量/功率降低。

32.本公开的各方面涉及克隆或复制卷积层过滤器/权重,并根据存储器内计算实现来执行并行乘法和累加功能。执行并行处理的卷积层可以是二值神经网络的一部分。在一个方面,接收与在存储器内计算阵列中实现的过滤器相对应的权重阵列,并将其加载到存储器内计算阵列的多个位单元中。复制该过滤器及其对应的权重。随后用过滤器和该过滤器的(诸)复本来执行并行卷积层乘法和累加(mac)功能。同时从该过滤器和该过滤器的(诸)复本中的每一者生成输出。

33.在一方面,用过滤器和该过滤器的(诸)复本来执行并行卷积层乘法和累加(mac)功能包括接收作为要由该卷积层处理的整个输入的一部分的第一感受野输入。该方法还包括接收作为要由该卷积层处理的整个输入的另一部分的第二感受野输入。第一感受野输入和第二感受野输入分别用过滤器和该过滤器的(诸)复本同时被处理。并行处理是存储器内计算阵列中的模拟。

34.本公开的各方面将神经网络的卷积层的循环时间至少减少四倍(4x),而同时保持与替换的数字实现相比有竞争力的能耗/功耗。例如,本公开的各方面可以达成比数字实现(例如,无并行处理的1位逻辑实现)的2倍或具有并行处理的1位逻辑的7倍多的能量节省。

35.图1解说了根据本公开的某些方面的片上系统(soc)100的示例实现,其可包括配置用于对卷积神经网络的卷积层进行并行处理的中央处理单元(cpu)102或多核cpu。变量(例如,神经信号和突触权重)、与计算设备相关联的系统参数(例如,带有权重的神经网络)、延迟、频率槽信息、以及任务信息可被存储在与神经处理单元(npu)108相关联的存储器块中、与cpu 102相关联的存储器块中、与图形处理单元(gpu)104相关联的存储器块中、与数字信号处理器(dsp)106相关联的存储器块中、存储器块118中,或可跨多个块分布。在cpu 102处执行的指令可从与cpu 102相关联的程序存储器加载或可从存储器块118加载。

36.soc 100还可包括为具体功能定制的附加处理块,诸如gpu 104、dsp 106、连通性块110(其可包括第五代(5g)连通性、第四代长期演进(4g lte)连通性、wi-fi连通性、usb连通性、蓝牙连通性等)以及例如可检测和识别姿势的多媒体处理器112。在一种实现中,npu实现在cpu、dsp、和/或gpu中。soc 100还可包括传感器处理器114、图像信号处理器(isp)116、和/或导航模块120(其可包括全球定位系统)。

37.soc 100可基于arm指令集。在本公开的一方面,加载到通用处理器102中的指令可包括用于接收与存储器阵列内计算阵列的过滤器相对应的权重阵列的代码。通用处理器102还可以包括用于将权重阵列加载到用于该过滤器的存储器内计算阵列的多个位单元的代码。通用处理器102可以进一步包括用于复制该过滤器的代码。此外,通用处理器102可以包括用于使用存储器内计算阵列的过滤器和该过滤器的复本来执行并行卷积层乘法和累加(mac)功能的代码。

38.深度学习架构可通过学习在每一层中以逐次更高的抽象程度来表示输入、藉此构建输入数据的有用特征表示来执行对象识别任务。以此方式,深度学习解决了常规机器学习的主要瓶颈。在深度学习出现之前,用于对象识别问题的机器学习办法可能严重依赖人类工程设计的特征,或许与浅分类器相结合。浅分类器可以是两类线性分类器,例如,其中可将特征向量分量的加权和与阈值作比较以预测输入属于哪一类。人类工程设计的特征可以是由拥有领域专业知识的工程师针对特定问题领域定制的模版或内核。相比之下,深度学习架构可学习以表示与人类工程师可能会设计的类似的特征,但它是通过训练来学习的。此外,深度网络可以学习以表示和识别人类可能还没有考虑过的新类型的特征。

39.深度学习架构可以学习特征阶层。例如,如果向第一层呈递视觉数据,则第一层可学习以识别输入流中的相对简单的特征(诸如边)。在另一示例中,如果向第一层呈递听觉数据,则第一层可学习以识别特定频率中的频谱功率。取第一层的输出作为输入的第二层可以学习以识别特征组合,诸如对于视觉数据识别简单形状或对于听觉数据识别声音组合。例如,更高层可学习以表示视觉数据中的复杂形状或听觉数据中的词语。再高层可学习以识别常见视觉对象或口语短语。

40.深度学习架构在被应用于具有自然阶层结构的问题时可能表现特别好。例如,机动交通工具的分类可受益于首先学习以识别轮子、挡风玻璃、以及其他特征。这些特征可在更高层以不同方式被组合以识别轿车、卡车和飞机。

41.神经网络可被设计成具有各种各样的连通性模式。在前馈网络中,信息从较低层被传递到较高层,其中给定层中的每个神经元向更高层中的神经元进行传达。如上所述,可在前馈网络的相继层中构建阶层式表示。神经网络还可具有回流或反馈(也被称为自顶向下(top-down))连接。在回流连接中,来自给定层中的神经元的输出可被传达给相同层中的另一神经元。回流架构可有助于识别跨越不止一个按顺序递送给该神经网络的输入数据组块的模式。从给定层中的神经元到较低层中的神经元的连接被称为反馈(或自顶向下)连接。当高层级概念的识别可辅助辨别输入的特定低层级特征时,具有许多反馈连接的网络可能是有助益的。

42.神经网络的各层之间的连接可以是全连接的或局部连接的。图2a解说了全连接神经网络202的示例。在全连接神经网络202中,第一层中的神经元可将它的输出传达给第二层中的每个神经元,从而第二层中的每个神经元将从第一层中的每个神经元接收输入。图

2b解说了局部连接的神经网络204的示例。在局部连接的神经网络204中,第一层中的神经元可连接到第二层中有限数目的神经元。更一般化地,局部连接的神经网络204的局部连接层可被配置成使得一层中的每个神经元将具有相同或相似的连通性模式,但其连接强度可具有不同的值(例如,210、212、214和216)。局部连接的连通性模式可能在更高层中产生空间上相异的感受野,这是由于给定区域中的更高层神经元可接收到输入,其通过训练被调谐到至网络的总输入的受限部分的性质。

43.局部连接神经网络的一个示例是卷积神经网络。图2c解说了卷积神经网络206的示例。卷积神经网络206可被配置成使得与针对第二层中每个神经元的输入相关联的连接强度被共享(例如,208)。卷积神经网络可能非常适合于其中输入的空间位置有意义的问题。

44.一种类型的卷积神经网络是深度卷积网络(dcn)。图2d解说了被设计成识别来自图像捕捉设备230(诸如车载相机)的图像226输入的视觉特征的dcn 200的详细示例。可对当前示例的dcn 200进行训练以标识交通标志以及在交通标志上提供的数字。当然,dcn 200可被训练用于其他任务,诸如标识车道标记或标识交通信号灯。

45.可以用受监督式学习来训练dcn 200。在训练期间,可向dcn 200呈递图像(诸如限速标志的图像226),并且随后可计算“前向传递(forward pass)”以产生输出222。dcn 200可包括特征提取区段和分类区段。在接收到图像226之际,卷积层232可向图像226应用卷积核(未示出),以生成第一特征图集合218。作为示例,卷积层232的卷积核可以是生成28x28特征图的5x5核。在本示例中,由于在第一特征图集合218中生成四个不同的特征图,因此在卷积层232处四个不同的卷积核被应用于图像226。卷积核还可被称为过滤器或卷积过滤器。

46.第一特征图集合218可由最大池化层(未示出)进行子采样以生成第二特征图集合220。最大池化层减小了第一特征图集合218的大小。即,第二特征图集合220的大小(诸如14x14)小于第一特征图集合218的大小(诸如28x28)。经减小的大小向后续层提供类似的信息,而同时减小了存储器消耗。第二特征图集合220可经由一个或多个后续卷积层(未示出)被进一步卷积,以生成一个或多个后续特征图集合(未示出)。

47.在图2d的示例中,第二特征图集合220被卷积以生成第一特征向量224。此外,第一特征向量224被进一步卷积以生成第二特征向量228。第二特征向量228的每个特征可包括与图像226的可能特征(诸如“标志”、“60”和“100”)相对应的数。softmax(软最大化)函数(未示出)可将第二特征向量228中的数转换为概率。如此,dcn 200的输出222是图像226包括一个或多个特征的概率。

48.在本示例中,输出222中关于“标志”和“60”的概率高于输出222的其他特征(诸如“30”、“40”、“50”、“70”、“80”、“90”和“100”)的概率。在进行训练之前,由dcn 200产生的输出222很可能是不正确的。由此,可计算输出222与目标输出之间的误差。目标输出是图像226的真值(例如,“标志”和“60”)。dcn 200的权重可随后被调整以使得dcn 200的输出222与目标输出更紧密地对齐。

49.为了调整权重,学习算法可为权重计算梯度向量。该梯度可指示在权重被调整情况下误差将增加或减少的量。在顶层处,该梯度可直接对应于连接倒数第二层中的活化神经元与输出层中的神经元的权重的值。在较低层中,该梯度可取决于权重的值以及所计算

出的诸较高层的误差梯度。权重可随后被调整以减小误差。这种调整权重的方式可被称为“后向传播”,因为其涉及穿过神经网络的“后向传递(backward pass)”。

50.在实践中,权重的误差梯度可能是在少量示例上计算的,从而计算出的梯度逼近真实误差梯度。这种逼近方法可被称为随机梯度下降法。随机梯度下降法可被重复,直到整个系统可达成的误差率已停止下降或直到误差率已达到目标水平。在学习之后,dcn可被呈递新图像(例如,图像226的限速标志)并且通过网络前向传递可产生输出222,其可被认为是该dcn的推断或预测。

51.深度置信网络(dbn)是包括多层隐藏节点的概率性模型。dbn可提取训练数据集的阶层式表示。dbn可通过堆叠数层受限波尔兹曼机(rbm)来获得。rbm是一种可在输入集上学习概率分布的人工神经网络。由于rbm可在没有关于每个输入应该被分类到哪个类的信息的情况下学习概率分布,因此rbm经常被用于无监督式学习中。使用混合无监督式和有监督式范式,dbn的底部rbm可按无监督方式被训练并且可以用作特征提取器,而顶部rbm可按有监督方式(在来自先前层的输入和目标类的联合分布上)被训练并且可用作分类器。

52.深度卷积网络(dcn)是卷积网络的网络,其配置有附加的池化和归一化层。dcn已在许多任务上达成现有最先进的性能。dcn可使用有监督式学习来训练,其中输入和输出目标两者对于许多典范是已知的并被用于通过使用梯度下降法来修改网络的权重。

53.dcn可以是前馈网络。另外,如上所述,从dcn的第一层中的神经元到下一更高层中的神经元群的连接跨第一层中的神经元被共享。dcn的前馈和共享连接可被利用于进行快速处理。dcn的计算负担可比例如类似大小的包括回流或反馈连接的神经网络的计算负担小得多。

54.卷积网络的每一层的处理可被认为是空间不变模版或基础投影。如果输入首先被分解成多个通道,诸如彩色图像的红色、绿色和蓝色通道,那么在该输入上训练的卷积网络可被认为是三维的,其具有沿着该图像的轴的两个空间维度以及捕捉颜色信息的第三维度。卷积连接的输出可被认为在后续层中形成特征图,该特征图(例如,220)中的每个元素从先前层(例如,特征图218)中一定范围的神经元以及从该多个通道中的每个通道接收输入。特征图中的值可以用非线性(诸如矫正max(0,x))进一步处理。来自毗邻神经元的值可被进一步池化(这对应于降采样)并可提供附加的局部不变性以及降维。还可通过特征图中神经元之间的侧向抑制来应用归一化,其对应于白化。

55.深度学习架构的性能可随着有更多被标记的数据点变为可用或随着计算能力提高而提高。现代深度神经网络用比仅仅十五年前可供典型研究者使用的计算资源多数千倍的计算资源来例行地训练。新的架构和训练范式可进一步推升深度学习的性能。经矫正的线性单元可减少被称为梯度消失的训练问题。新的训练技术可减少过拟合(over-fitting)并因此使更大的模型能够达成更好的泛化。封装技术可抽象出给定的感受野中的数据并进一步提升总体性能。

56.图3是解说深度卷积网络350的框图。深度卷积网络350可包括多个基于连通性和权重共享的不同类型的层。如图3中示出的,深度卷积网络350包括卷积块354a、354b。卷积块354a、354b中的每一者可配置有卷积层(conv)356、归一化层(lnorm)358、和最大池化层(max pool)360。

57.卷积层356可包括一个或多个卷积过滤器,其可被应用于输入数据以生成特征图。

尽管仅示出了两个卷积块354a、354b,但本公开不限于此,而是代之以根据设计偏好可将任何数目的卷积块354a、354b包括在深度卷积网络350中。归一化层358可对卷积过滤器的输出进行归一化。例如,归一化层358可提供白化或侧向抑制。最大池化层360可提供在空间上的降采样聚集以实现局部不变性和降维。

58.例如,深度卷积网络的并行过滤器组可被加载到soc 100的cpu 102或gpu 104上以达成高性能和低功耗。在替换实施例中,并行过滤器组可被加载到soc 100的dsp 106或isp 116上。另外,深度卷积网络350可访问其他可存在于soc 100上的处理块,诸如分别专用于传感器和导航的传感器处理器114和导航模块120。

59.深度卷积网络350还可包括一个或多个全连接层362(fc1和fc2)。深度卷积网络350可进一步包括逻辑回归(lr)层364。深度卷积网络350的每一层356、358、360、362、364之间是要被更新的权重(未示出)。每一层(例如,356、358、360、362、364)的输出可以用作深度卷积网络350中一后续层(例如,356、358、360、362、364)的输入以从第一卷积块354a处供应的输入数据352(例如,图像、音频、视频、传感器数据和/或其他输入数据)学习阶层式特征表示。深度卷积网络350的输出是针对输入数据352的分类得分366。分类得分366可以是概率集,其中每个概率是输入数据包括来自特征集的特征的概率。

60.图4解说了具有存储器内计算阵列408的示例性卷积层架构400。卷积层架构400是卷积神经网络的一部分(例如,二值神经网络或图2的卷积神经网络200)卷积神经网络可被设计有多维(张量)数据。例如,卷积层架构400的输入402具有1乘38乘11(1(深度)x38(高度)x11(宽度))的维度。第一层或卷积层1(由卷积层架构400来解说)具有六十四(64)个输出通道,并且相应地有64个过滤器,由过滤器张量414来表示。

61.过滤器张量414中的64个过滤器中的每个过滤器(例如,示例性过滤器412)具有一乘五乘二(1x5x2)的维度(总共地,这些过滤器或过滤器张量414等于一个64x5x2过滤器)。每个1x5x2过滤器(例如,过滤器412)与输入402卷积,以生成输出404的一个1x34x10层(总共地,输出404具有维度64x34x10)。输出404的每一层对于340个5x2感受野(例如,感受野输入406)和对应的过滤器(例如,过滤器412)指定三千四百(3400)次乘法和累加(mac)(或等效)运算。输出404的每个值指定(5x2过滤器乘5x2感受野的)10次乘法。例如,每个5x2过滤器与5x2个激活卷积(10次mac),以在输出404中生成输出值(例如,数)。

62.所有过滤器414(64x5x2)的六百四十(640)个权重可被存储在存储器内计算(cim)阵列408中。随后,三百四十(340)次使用字线(例如,416)将340个5x2感受野(例如,感受野输入406)中的每一者的十(10)个激活输入到cim阵列408并乘以对应的权重,以产生1x1x64的输出张量(例如,输出张量410)。总输出张量404是输入402的所有感受野(例如,感受野输入406)的1x1x64输出张量的累加。为简单起见,图4的存储器内计算阵列408仅示出用于存储器内计算阵列408中的输入和输出的一些解说性线。

63.存储器内计算阵列408包括字线416(例如,对应于存储器内计算阵列408的行的字线)(cim阵列408通过这些字线来接收感受野(例如,感受野输入406))以及位线418(对应于存储器内计算阵列408的列)存储器内计算阵列408还包括总体计数字线(pcwl)和读字线rwl(图4中未解说,但在图7中解说)。字线416被用于初始权重定义。然而,一旦初始权重定义发生,激活输入就激活cim位单元中专门设计的对应于pcwl的线以进行mac操作。位线418和字线416的每个交点表示过滤器权重值,将该权重值乘以字线416上的输入激活以生成

积。随后将沿每条位线418的个体积加总以生成输出张量410的对应输出值。加总值可以是电荷、电流或电压。在每个运算循环中,在字线416上输入对应感受野的十个值。

64.将在存储器内计算阵列408中执行的乘法加总并在存储器内计算阵列408的位线418处输出。处理卷积层的整个输入402后的输出张量404的维度为六十四乘三十四乘十(64x34x10)。然而,存储器内计算阵列408一次仅生成64个过滤器输出。因此,会延迟对整个输入402的乘法和累加运算,因为在每个运算循环中整个输入402的对应感受野中仅10个值被输入字线中,这导致增加的用于处理整个输入402的循环次数。例如,整个输入402的处理可以在34x10或即340个循环中完成。因此,过滤器在乘法和累加(mac)运算中被重用多次以生成所有的输出404,这花费众多循环,而且耗时。

65.图5解说了根据本公开的各方面的用于卷积层中存储器内计算并行处理的示例性神经网络架构500。出于解说的目的,图4的一些设备和特性与图5中的一些设备和特性类似。卷积层包括多个(例如,四个)并行存储器内计算阵列508a、508b、508c和508d,以同时并行处理整个输入502的多个感受野输入。并行存储器内计算阵列508a、508b、508c和508d中的每一者可以类似于图4的存储器内计算阵列408。输入502可以类似于图4的输入402。

66.在一个方面,存储器内计算阵列508a、508b、508c和508d是彼此的复制(或副本)。存储器内计算阵列508a、508b、508c和508d中的每一者的每个过滤器(例如,示例性过滤器512)具有一乘五乘二(1x5x2)的维度(所有一起,过滤器张量514的六十四(64)个过滤器等于一个64x5x2过滤器)。通过使用存储内计算阵列508a、508b、508c和508d中的每一者,所有过滤器(64x5x2)的六百四十(640)个权重被存储在存储器内计算阵列508a、508b、508c和508d中的每一者中。因此,存储器内计算阵列508a、508b、508c和508d包括对应于过滤器的权重阵列,该权重阵列与对应于存储器内计算阵列408的过滤器的权重阵列是相同的。

67.整个输入502的多个感受野输入可以包括第一感受野输入506a(例如,类似于图4的感受野输入406)、第二感受野输入506b、第三感受野输入506c和第四感受野输入506d。类似于图4的感受野输入406,感受野输入506a、506b、506c和506d中的每一者具有1x5x2的维度。感受野输入506a、506b、506c和506d的毗邻感受野输入交叠并且共享一些值。该多个感受野输入506a、506b、506c和506d可分别在多个(例如,四个)并行cim阵列508a、508b、508c和508d中同时被处理,以在图4的架构400处理输入402所需的四分之一的循环内处理输入502。该多个并行cim阵列508a、508b、508c和508d可以同时生成多个感受野输出510a、510b、510c和510d。例如,与图4中架构400的三百四十(340)个循环相反,同时使用多个并行cim阵列508a、508b、508c和508d的卷积仅占用八十五(85)个循环。相应地,神经网络架构500的总体能量使用可以使用并行处理来降低。注意,尽管以上已经描述了使用四个cim阵列的示例性实现,但替换实现可以具有任何适合的数目个并行工作的cim阵列(含对应修改)。

68.图6解说了根据本公开的各方面的用于人工神经网络的存储器内计算(cim)阵列的示例性架构600。存储器内计算阵列可被用于实现上述并行处理技术。存储器内计算是在存储器阵列内执行乘法和累加运算的一种技术。存储单元也是处理单元。存储器内计算阵列包括总体计数字线(pcwl)625a、625b和625c、读字线(rwl)627a、627b和627c、模数转换器(adc)611a、611b和611c、数字处理单元613以及位线618a、618b和618c。权重(例如,二值突触权重矩阵)被存储在sram单元中。示例性二值权重为解说被示出在sram单元中。图6示出了存储器内计算阵列的九个位单元605a-605i。在pcwl 625上提供输入激活(例如,可以是

输入向量的输入值)。

69.乘法发生在与位线相关联的每个位单元中,并且所有位单元乘法结果的累加(求和)发生在针对一列的同一位线上。每个位单元中的乘法是以对应的激活和权重的“与”运算的形式,其中积作为电荷被存储在对应的电容器623上。例如,仅在激活为1(在此,因为使用pmos,对于激活1,pcwl为0)且权重为1的情况下,才产生1的乘积,并且因此产生电容器623上的电荷。

70.例如,根据该方面,位线618a累加第一列中所有位单元的电荷。累加或求和的电荷包括位线618a的加总电荷603、位线618b的加总电荷607和位线618c的加总电荷609。位线618a的加总电荷603被传递到比较器或adc 611a上,在此加总电荷603被转换为数字输出(例如,数字信号/数),其是神经网络的下一层输入。每个位线中的数字输出可被相加在一起、或可不被相加在一起,这取决于它是单个位还是多个位的神经网络(nn)运算。当总体计数字线(pcwl)625a、625b和625c上的激活例如为1、0、1时,则位线618a-c的总和分别为0 0 1=1、1 0 0=1和1 0 1=2。adc 611a、611b和611c的输出被传递到数字处理单元613以供进一步处理。

71.图7解说了根据本公开的各方面的存储器内计算阵列的示例性位单元700(例如,图6的位单元605)的更多细节。例如,位线721类似于位线618a,电容器723类似于电容器623,读字线727类似于读字线627a,并且总体计数字线725类似于总体计数字线625a。位单元700包括具有附加晶体管711(例如,pmos晶体管)和713(例如,nmos晶体管)的静态随机存取存储器(sram)单元701以及耦合到地的电容器723。尽管pmos晶体管被用于晶体管711,但是可以使用其它晶体管(例如,nmos晶体管)来代替pmos晶体管(在对其各自的控制信号进行对应的调整(例如,反转)的情况下)。这同样适用于本文所述的其它晶体管。根据本公开的各方面,包括了附加晶体管711和713以实现存储器内计算阵列。在一方面,sram单元701是常规的六晶体管(6t)sram单元。

72.对位单元中的权重的编程可以针对众多激活执行一次。例如,在运算中,sram单元701经由字线716在节点717和719处仅接收一位信息。例如,当在节点717处所接收到的信息是“1”(例如,高电压)时,另一节点719不接收信息,或者在节点719处所接收到的信息是“0”(例如,低电压)。类似地,当在节点717处所接收到的信息是“0”时,在节点719处所接收到的信息是“1”。权重编程之后可继以激活输入和乘法步骤,以根据对应的积来对电容器充电。晶体管711由激活信号(pcwl信号)通过存储器内计算阵列的总体计数字线(pcwl)725来激活,并且晶体管713由信号(rwl信号)通过存储器内计算阵列的另一字线(例如,读字线(rwl)727)来激活。读字线727被提供给行中的所有位单元,并且被导通以累加这些位单元的值。

73.如果节点717是“0”(例如,当所存储的权重值为“0”时),则即使低pcwl在晶体管711的栅极处指示激活“1”,电容器723也不会被充电。相应地,没有电荷被提供给位线721。然而,如果对应于权重值的节点717是“1”,并且pcwl被设置为低(例如,当激活输入为高时),这导通pmos晶体管711,其充当短路,从而允许电容器723被充电。在电容器723被充电之后,晶体管711被关断,从而电荷被存储在电容器723中。为了将电荷从电容器723移到位线721,nmos晶体管713由rwl 727导通,从而使得nmos晶体管713充当短路。

74.图8示出了解说在存储器内计算(cim)阵列运算期间各种信号的定时的时序图

800。时序图800的第一行示出正变低的总体计数字线pcwl(例如,图6的625a或图7的725)。低pcwl指示激活“1”。当pcwl为低时,pmos晶体管导通,这允许对电容器进行充电(如果权重为“1”)。第二行示出读字线rwl(例如,图6的读字线627a或图7的727)。第三行示出读位线rbl(例如618或721),第四行示出模数转换器(adc)读出信号,并且第五行示出复位信号。例如,参照图7的晶体管711,当读字线rwl为高时,来自电容器723的电荷逐渐被传递到读位线rbl上。

75.加总电荷/电流/电压(例如,图6中的603或从图7的位线721求和的电荷)被传递到比较器或adc(例如,图6的adc 611a)上,在此加总电荷被转换为数字输出(例如,数字信号/数)。电荷的加总可以发生在时序图800的累加区域中,并且从adc读出可以与时序图800的adc读出区域相关联。在获得adc读出之后,复位信号对所有的电容器(例如,电容器623)放电,以准备处理下一组激活输入。

[0076][0077][0078]

表1

[0079]

表1解说了存储器内计算阵列运算的示例。表1的第一列包括传入激活信号的可能值。根据本公开的各方面,第二列包括激活设计用于实现存储器内计算阵列的晶体管的pcwl。因为晶体管711是pmos晶体管,所以pcwl值是激活值的逆。例如,存储器内计算阵列包括由激活信号(pcwl信号)通过总体计数字线(pcwl)725来激活的晶体管711。

[0080]

第三列包括存储在存储器内计算阵列的sram单元节点中的与过滤器张量相对应的多个权重。第四列示出将作为电荷被储存在电容器上的所得积。例如,该电荷可被存储在电容器723的节点或电容器623a-623i之一的节点处。当晶体管713被激活时,将来自电容器723的电荷移到位线721。例如,参照晶体管711,当单元节点717处的权重为“1”(例如,高电压)且输入激活为“1”(因此pcwl为“0”)时,电容器723被充电(例如,电容器的节点是“1”)。对于所有其他组合,电容器节点将具有0值。

[0081]

本公开的并行处理技术可有助于涉及人工神经网络的任何类型的边缘计算。这些技术在神经网络处理的推理阶段或任何其他阶段都具有适用性。当不需要高准确性时,二值网络是适用的。虽然讨论主要关于二值神经网络,但也构想了其他低位宽的神经网络。

[0082]

图9解说了根据本公开的各方面的卷积神经网络的卷积层的并行处理方法900。如图9所示,在框902,与过滤器张量相对应的多个权重被存储在第一存储器内计算阵列中。在框904,与输入的第一感受野相对应的第一组激活由第一存储器内计算阵列来接收。在框906,与过滤器张量相对应的权重的第一副本被存储在第二存储器内计算阵列中。在框908,与输入的第二感受野相对应的第二组激活由第二存储器内计算阵列来接收。在框910,在第一存储器内计算阵列中使用权重来处理第一组激活以生成对应的输出值第一张量,并且在

第二存储器内计算阵列中使用权重的第一副本来处理第二组激活以生成对应的输出值第二张量。第一存储器内计算阵列和第二存储器内计算阵列被配置成并行地处理第一感受野和第二感受野。

[0083]

根据本公开的进一步方面,描述了用于卷积神经网络的卷积层的并行处理设备。该并行处理设备包括用于在一组激活上执行逐位运算和位计数的第一装置。第一装置包括存储器内计算阵列408或508a、深度卷积网络200、深度卷积网络350、卷积层232、soc 100、cpu 102、和/或卷积块354a。该并行处理设备进一步包括用于在该组激活上执行逐位运算和位计数的第二装置。第二装置包括存储器内计算阵列508b、深度卷积网络200、深度卷积网络350、卷积层232、soc 100、cpu 102、和/或卷积块354a。

[0084]

该并行处理装备进一步包括用于在该组激活上执行逐位运算和位计数的第三装置。第三装置包括存储器内计算阵列508c、深度卷积网络200、深度卷积网络350、卷积层232、soc 100、cpu 102、和/或卷积块354a。在另一方面,前述装置可以是被配置成执行由前述装置叙述的功能的任何模块或任何设备。

[0085]

以上所描述的方法的各种操作可由能够执行相应功能的任何合适的装置来执行。这些装置可包括各种硬件和/或(诸)软件组件和/或(诸)模块,包括但不限于电路、专用集成电路(asic)、或处理器。一般而言,在附图中有解说的操作的场合,那些操作可具有带相似编号的相应配对装置加功能组件。

[0086]

如本文所使用的,术语“确定”涵盖各种各样的动作。例如,“确定”可包括演算、计算、处理、推导、研究、查找(例如,在表、数据库或另一数据结构中查找)、查明及诸如此类。另外,“确定”可包括接收(例如接收信息)、访问(例如访问存储器中的数据)、及类似动作。此外,“确定”可包括解析、选择、选取、确立及类似动作。

[0087]

如本文中所使用的,引述一列项目“中的至少一者”的短语是指这些项目的任何组合,包括单个成员。作为示例,“a、b或c中的至少一个”旨在涵盖:a、b、c、a-b、a-c、b-c和a-b-c。

[0088]

结合本公开所描述的各种解说性逻辑框、模块、以及电路可用设计成执行本文中所描述的功能的通用处理器、数字信号处理器(dsp)、专用集成电路(asic)、现场可编程门阵列信号(fpga)或其他可编程逻辑器件(pld)、分立的门或晶体管逻辑、分立的硬件组件或其任何组合来实现或执行。通用处理器可以是微处理器,但在替换方案中,处理器可以是任何市售的处理器、控制器、微控制器、或状态机。处理器还可以被实现为计算设备的组合,例如,dsp与微处理器的组合、多个微处理器、与dsp核心协同的一个或多个微处理器、或任何其他此类配置。

[0089]

结合本公开所描述的方法或算法的步骤可直接在硬件中、在由处理器执行的软件模块中、或在这两者的组合中实施。软件模块可驻留在本领域所知的任何形式的存储介质中。可使用的存储介质的一些示例包括随机存取存储器(ram)、只读存储器(rom)、闪存、可擦除可编程只读存储器(eprom)、电可擦除可编程只读存储器(eeprom)、寄存器、硬盘、可移动盘、cd-rom,等等。软件模块可包括单条指令、或许多条指令,且可分布在若干不同的代码段上,分布在不同的程序间以及跨多个存储介质分布。存储介质可被耦合到处理器以使得该处理器能该存储介质读取信息以及向该存储介质写入信息。在替换方案中,存储介质可被整合到处理器。

[0090]

本文所公开的方法包括用于实现所描述的方法的一个或多个步骤或动作。这些方法步骤和/或动作可以彼此互换而不会脱离权利要求的范围。换言之,除非指定了步骤或动作的特定次序,否则具体步骤和/或动作的次序和/或使用可以改动而不会脱离权利要求的范围。

[0091]

所描述的功能可在硬件、软件、固件或其任何组合中实现。如果以硬件实现,则示例硬件配置可包括设备中的处理系统。处理系统可以用总线架构来实现。取决于处理系统的具体应用和整体设计约束,总线可包括任何数目的互连总线和桥接器。总线可将包括处理器、机器可读介质、以及总线接口的各种电路链接在一起。总线接口可将网络适配器等经由总线连接至处理系统。网络适配器可实现信号处理功能。对于某些方面,用户接口(例如,按键板、显示器、鼠标、操纵杆,等等)也可以被连接到总线。总线还可以链接各种其他电路,诸如定时源、外围设备、稳压器、功率管理电路以及类似电路,它们在本领域中是众所周知的,因此将不再进一步描述。

[0092]

处理器可负责管理总线和一般处理,包括对存储在机器可读介质上的软件的执行。处理器可用一个或多个通用和/或专用处理器来实现。示例包括微处理器、微控制器、dsp处理器、以及其他能执行软件的电路系统。软件应当被宽泛地解释成意指指令、数据、或其任何组合,无论是被称作软件、固件、中间件、微代码、硬件描述语言、或其他。作为示例,机器可读介质可包括随机存取存储器(ram)、闪存存储器、只读存储器(rom)、可编程只读存储器(prom)、可擦式可编程只读存储器(eprom)、电可擦式可编程只读存储器(eeprom)、寄存器、磁盘、光盘、硬驱动器、或者任何其他合适的存储介质、或其任何组合。机器可读介质可被实施在计算机程序产品中。该计算机程序产品可包括包装材料。

[0093]

在硬件实现中,机器可读介质可以是处理系统中与处理器分开的一部分。然而,如本领域技术人员将容易领会的,机器可读介质或其任何部分可在处理系统外部。作为示例,机器可读介质可包括传输线、由数据调制的载波、和/或与设备分开的计算机产品,所有这些都可由处理器通过总线接口来访问。替换地或补充地,机器可读介质或其任何部分可被集成到处理器中,诸如高速缓存和/或通用寄存器文件可能就是这种情形。虽然所讨论的各种组件可被描述为具有特定位置,诸如局部组件,但它们也可按各种方式来配置,诸如某些组件被配置成分布式计算系统的一部分。

[0094]

处理系统可被配置为通用处理系统,该通用处理系统具有一个或多个提供处理器功能性的微处理器、以及提供机器可读介质中的至少一部分的外部存储器,它们都通过外部总线架构与其他支持电路系统链接在一起。替换地,该处理系统可包括一个或多个神经元形态处理器以用于实现本文中所描述的神经元模型和神经系统模型。作为另一替换方案,处理系统可以用带有集成在单块芯片中的处理器、总线接口、用户接口、支持电路系统、和至少一部分机器可读介质的专用集成电路(asic)来实现,或者用一个或多个现场可编程门阵列(fpga)、可编程逻辑器件(pld)、控制器、状态机、门控逻辑、分立硬件组件、或者任何其他合适的电路系统、或者能执行本公开通篇所描述的各种功能性的电路的任何组合来实现。取决于具体应用和加诸于整体系统上的总设计约束,本领域技术人员将认识到如何最佳地实现关于处理系统所描述的功能性。

[0095]

机器可读介质可包括数个软件模块。这些软件模块包括当由处理器执行时使处理系统执行各种功能的指令。这些软件模块可包括传送模块和接收模块。每个软件模块可以

驻留在单个存储设备中或者跨多个存储设备分布。作为示例,当触发事件发生时,可以从硬驱动器中将软件模块加载到ram中。在软件模块执行期间,处理器可以将一些指令加载到高速缓存中以提高访问速度。可随后将一个或多个高速缓存行加载到通用寄存器文件中以供处理器执行。在以下述及软件模块的功能性时,将理解此类功能性是在处理器执行来自该软件模块的指令时由该处理器来实现的。此外,应领会,本公开的各方面产生对处理器、计算机、机器或实现此类方面的其它系统的机能的改进。

[0096]

如果以软件实现,则各功能可作为一条或多条指令或代码存储在计算机可读介质上或藉其进行传送。计算机可读介质包括计算机存储介质和通信介质两者,这些介质包括促成计算机程序从一地向另一地转移的任何介质。存储介质可以是能被计算机访问的任何可用介质。作为示例而非限定,此类计算机可读介质可包括ram、rom、eeprom、cd-rom或其他光盘存储、磁盘存储或其他磁存储设备、或能用于携带或存储指令或数据结构形式的期望程序代码且能被计算机访问的任何其他介质。另外,任何连接也被正当地称为计算机可读介质。例如,如果软件是使用同轴电缆、光纤电缆、双绞线、数字订户线(dsl)、或无线技术(诸如红外(ir)、无线电、以及微波)从web网站、服务器、或其他远程源传送而来,则该同轴电缆、光纤电缆、双绞线、dsl或无线技术(诸如红外、无线电、以及微波)就被包括在介质的定义之中。如本文所使用的盘(disk)和碟(disc)包括压缩碟(cd)、激光碟、光碟、数字多用碟(dvd)、软盘、和碟,其中盘(disk)常常磁性地再现数据,而碟(disc)用激光来光学地再现数据。因此,在一些方面,计算机可读介质可包括非瞬态计算机可读介质(例如,有形介质)。另外,对于其他方面,计算机可读介质可包括瞬态计算机可读介质(例如,信号)。以上的组合应当也被包括在计算机可读介质的范围内。

[0097]

由此,某些方面可包括用于执行本文中给出的操作的计算机程序产品。例如,此类计算机程序产品可包括其上存储(和/或编码)有指令的计算机可读介质,这些指令能由一个或多个处理器执行以执行本文中所描述的操作。对于某些方面,该计算机程序产品可包括包装材料。

[0098]

此外,应当领会,用于执行本文中所描述的方法和技术的模块和/或其他恰适装置可由用户终端和/或基站在适用的场合下载和/或以其他方式获得。例如,此类设备能被耦合到服务器以促成用于执行本文中所描述的方法的装置的转移。替换地,本文中所描述的各种方法能经由存储装置(例如,ram、rom、诸如压缩碟(cd)或软盘之类的物理存储介质等)来提供,以使得一旦将该存储装置耦合到或提供给用户终端和/或基站,该设备就能获得各种方法。此外,可利用适于向设备提供本文中所描述的方法和技术的任何其他合适的技术。

[0099]

将理解,权利要求并不被限于以上所解说的精确配置和组件。可在以上所描述的方法和装置的布局、操作和细节上作出各种改动、更换和变形而不会脱离权利要求的范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。