1.本发明涉及一种元宇宙系统及其交互方法,属于增强现实技术领域。

背景技术:

2.传统虚拟现实技术,主要为通过服务设备来模拟产生一个三维的虚拟场景,使用户可以通过用户端设备观看虚拟场景画面或虚拟与现实场景的简单组合,用户端设备一般为ar、vr、mr等类型的头显设备。交互方式比较单一,不同用户之间不能交流或交流不方便;仅能在同一个现实空间地点互动,交流地点受到限制;场景固定,不能按照自己的要求布置。

技术实现要素:

3.本发明第一个目的是丰富交互内容,使交流更加真实和丰富。第二个目的是使用户之间交互不受空间或时间的限制。第三个目的是实现多人之间的便捷交互。本方案可广泛应用于社交、旅游、购物、电影院、ktv、娱乐、会议、展会、直播、演唱会等多种应用场景。

4.为达到上述目的,本发明的技术方案为:元宇宙系统,包括一个或多个服务设备、一个或多个用户端设备,其特征在于,所述服务设备包含物体3d模型数据、人体3d模型数据、地图数据,物体3d模型数据包括建筑物3d模型、家具3d模型、家电3d模型、商品3d模型、文字标识3d模型,所述用户端设备可自定义设置的内容包括物体3d模型的地理位置、人体3d模型和物体3d模型的类型、文字或二维码标识3d模型的文字内容以及二维码内容和空间位置、物体3d模型和人体3d模型的空间位置,可通过自定义设置搭建出用户所需的虚拟场景;优选的,所述服务设备数量为1、2、3、4、5、6、7、8、9、10、16、20、30、40、50、60、70、80、90、100、1000、1万、5万、10万、100万、1000万、1亿、10亿、100亿、1000亿个;优选的,所述用户端设备数量为1、2、3、4、5、6、7、8、9、10、16、20、30、40、50、60、70、80、90、100、1000、1万、5万、10万、100万、1000万、1亿、10亿、100亿、1000亿个。

5.进一步的,所述服务设备,可通过用户端设备导入的数据包括物体3d模型数据文件、人体3d模型数据文件。

6.进一步的,所述服务设备还包括天气数据,有太阳、天空、云彩、雨、雪、风、温度、湿度、雾、阴天、白天、黑夜、月亮,可在虚拟场景中显示;在虚拟场景地图数据中不同地理位置的所述天气数据是现实中相应地理位置的实际天气信息实时数据。

7.进一步的,所述地图数据包括道路、街道、河流、湖、海、山脉、村庄、城镇、田地、景点、建筑物;所述服务设备还包括3d模型颜色数据、动物3d模型数据、植物3d模型数据,所述建筑物3d模型包括一层建筑物3d模型、多层建筑物3d模型、建筑物外墙3d模型、建筑物内部布局及装修3d模型、建筑物内部装饰3d模型、灯光3d模型;所述人物3d模型包括发型3d模型、饰品3d模型、镜子3d模型、摄像头3d模型、衣服3d模型、鞋子3d模型、手套3d模型、面部3d模型,面部3d模型可支持照片换脸;每种3d模型数量均为10个以上不同数据,上述每种3d模

型均可支持更换颜色数据和用照片更换外观;优选的,每种3d模型不同数据的数量为1、2、3、4、5、6、7、8、9、10、16、20、30、40、50、60、70、80、90、100、1000、1万、5万、10万、100万、1000万、1亿、10亿、100亿、1000亿、10000亿、100000亿个。

8.进一步的,所述用户端设备还包括圆柱形或圆筒形显示仓,显示仓包括外壳、主控器,还包括与主控器相连的电源模块、可连接网络的通讯模块、声音传感器、扬声器、肢体动作传感器、面部表情识别传感器、摄像头,四周的显示屏和顶部显示屏、底部显示屏;可用于场景显示或真实人物图像获取。

9.进一步的,所述元宇宙系统还包括云端计算机,通过mr头显设备对云端计算机进行远程控制。

10.进一步的,所述用户端设备为mr头显设备,可显示虚拟场景或现实场景或虚拟现实结合的场景,mr头显设备包括外壳、主控器和与主控器相连的显示屏、声音传感器、扬声器、肢体动作传感器、定位模块、可连接网络的通讯模块;可以通过网络远程连接和控制云端计算机,可连接云端计算机并显示云端计算机的桌面图像,可显示虚拟键盘、虚拟鼠标、虚拟人手,虚拟键盘显示于桌面图像的下方,虚拟鼠标显示于虚拟键盘的右侧;mr头显设备还包括人手扫描跟踪系统,扫描和跟踪下方人手的位置和每个手指的动作轨迹,当手或手指动作时虚拟人手也做相应的动作。引导人进行相应的动作来操作虚拟键盘或者虚拟鼠标,进行操作计算机;优选的,所述肢体动作传感器为陀螺仪、电子罗盘、加速传感器、角度传感器、位移传感器、摄像头,所述人手扫描跟踪系统的传感器为als光线感应器、ps距离传感器、红外传感器、摄像头、陀螺仪、加速度传感器、角度传感器、位移传感器。

11.进一步的,所述mr头显设备,在未连接云端计算机时,可通过手部扫描跟踪系统扫描和跟踪手和手指的动作轨迹,当手或手指动作时,虚拟人手也做相应的动作,用于引导人操作和点选系统菜单;用户a和用户b分别可通过mr头显设备a和mr头显设备b进行语音交流和互动;所述手部扫描跟踪系统包含自动稳定器,当人头部带动mr头显设备小幅度移动,但手部未动时,自动稳定器让手部扫描跟踪系统的传感器保持不动,可使在mr头显设备小幅度移动时显示画面中虚拟人手保持不动;优选的,所述自动稳定器的传感器为摄像头、陀螺仪、加速度传感器、角度传感器、位移传感器。

12.进一步的,所述mr头显设备还包括嘴部动作传感器、面部表情传感器,用户a可通过mr头显设备a设置自己的虚拟角色为人体3d模型a,mr头显设备a可将使用该设备的用户a的肢体动作、表情动作、嘴部动作信息上传至服务设备,可由服务设备发送给在同一虚拟空间的mr头显设备b,使用mr头显设备b的用户b可看到人体3d模型a及与用户a相应的肢体动作、表情动作、嘴部动作;所述的mr头显设备可通过wifi通讯模块连接智能手机,并显示智能手机的屏幕界面和播放手机的声音,还显示虚拟人手,可通过手势实现点选、滑动操作,来控制智能手机界面,可通过mr头显设备的显示屏、声音传感器和扬声器实现远程视频通话;优选的,所述嘴部动作传感器、面部表情传感器为红外传感器、摄像头、als光线感应器、ps距离传感器。

13.进一步的,所述mr头显设备具有录像功能,还包括摄像头,该摄像头具有移动机构,水平旋转角度大于等于180度,垂直旋转角度大于等于45度;mr头显设备a可通过网络与mr头显设备b连接,mr头显设备a可实时显示mr头显设备b的摄像头所获取的视频信息,mr头显设备a可实时通过扬声器播放mr头显设备b声音传感器获得的声音信息,mr头显设备b同

样可以把通过摄像头和声音传感器获得的视频信息、声音信息实时传递给mr头显设备a,mr头显设备a通过显示屏和扬声器实时广播该视频信息和声音信息;所述mr头显设备a可以同时连接n个mr头显设备b,其中n≥10;优选的,n为10、16、20、30、40、50、60、70、80、90、100、1000、1万、10万、100万、1000万、1亿、10亿、100亿、1000亿。

14.进一步的,所述mr头显设备b可通过二维码扫描或输入编码与mr头显a进行连接,所述mr头显设备还包括即时通讯软件,包含通讯录,可与好友或陌生用户进行视频通话、语音通话、文字交流通讯。

15.进一步的,所述的mr头显设备,其特征在于,具有智能手机功能,包括语音通话、视频通话、短信通讯、运行安装和操作app功能;外壳上还包括指纹识别模块,可通过指纹识别模块实现指纹密码、指纹支付、启动扫描二维码的功能;所述头mr显设备可通过扫描二维码或输入编码指令进入某一虚拟空间;所述头mr显设备也可通过在虚拟地图上点击位置进入或输入地理位置信息搜索进入某一虚拟空间,或者通过输入地图经纬度进入某一虚拟空间;所述的mr头显设备包括ar、vr、mr三种工作模式。

16.进一步的,所述的元宇宙系统还包括云端投影仪,所述云端投影仪,包含可连接网络的通讯模块,云端计算机的桌面图像可远程投影到云端投影仪。

17.进一步的,所述的元宇宙系统还包括云端打印机,所述云端打印机,包含可连接网络的通讯模块,可通过云端计算机连接到云端打印机打印文件。

18.进一步的,所述mr头显设备具有计算机功能,可处理文件、连接云端投影仪进行投影或连接云端打印机进行打印。

19.进一步的,所述的元宇宙系统,还包括3d扫描仪,可将现实中的物体或人物、动物创建为3d模型数据文件传输到服务设备供用户选择和设置。

20.进一步的,所述的元宇宙系统还包括具有通讯模块的智能汽车,智能汽车通过通讯模块连接网络,用户可通过用户端设备远程驾驶智能汽车,所述通讯模块为5g通讯模块。

21.进一步的,所述用户端设备还包括替身机器人,用于所述mr头显设备现实场景的视频图像、语音信息实时获取;所述替身机器人,包括外壳、主控器和与主控器相连的电源模块、可连接网络的通讯模块、摄像头、声音传感器、扬声器、距离传感器、用于身体移动的传动机构,其特征在于,用户可将mr头显设备通过网络与替身机器人通讯,mr头显设备可实时显示替身机器人获取的视频信息和声音信息,用户也可通过mr头显设备将声音信息实时传递给替身机器人,替身机器人可通过扬声器实时广播该声音信息。用户也可通过mr头显设备将声音信息实时传递给替身机器人,替身机器人可通过扬声器实时广播该声音信息。

22.进一步的,所述替身机器人包含蓄电池,在电量不足时可自行移动到充电器旁进行充电。

23.进一步的,所述服务设备可将替身机器人a的摄像头捕捉到的替身机器人b的现实外观图像替换为用户指定的虚拟人体3d模型b,替身机器人b移动的同时,虚拟人体3d模型b也可相应的移动。所述替身机器人还包括可动作的四肢、身体表面的触摸传感器,所述mr头显设备还包括四肢动作传感器、触摸动作执行器,当使用mr头显设备的用户a四肢动作时,替身机器人的四肢也可做相应的动作。当用户b触摸替身机器人的触摸传感器时,mr头显设备相应的触摸动作执行器则动作,使用户a感觉到该动作;所述身体表面的触摸传感器,为电阻式或电容式,传感器数量为两个及以上;所述触摸执行器为电动机式或电磁铁式振动

器,数量为两个及以上,安装于衣服上。优选的,传感器或触摸执行器数量为2、3、4、5、6、7、8、9、10、16、20、30、40、50、60、70、80、90、100、1000、1万、5万、10万、100万、1000万、1亿、10亿、100亿、1000亿、10000亿、100000亿个。

24.进一步优选的,所述用户端设备的通讯模块为wifi无线通讯模块或5g通讯模块。

25.进一步的,所述服务设备或用户端设备包含语音翻译软件,支持不同国家语言之间的实时语音翻译或文字翻译。

26.进一步的,所述用户端设备还包括支付软件,可实现支付功能,用户之间可进行支付交易。

27.进一步的,所述支付软件交易的货币为数字货币。

28.更进一步的,所述元宇宙系统中用户交互方法为,用户通过用户端设备连接到服务设备,在服务设备的虚拟地图上选取需要搭建虚拟场景的地点,从服务设备选取建筑物3d模型数据进行房屋虚拟场景搭建,建筑物3d模型则放置于该地点上,再从服务设备选取家具3d模型、商品3d模型、文字或二维码标识3d模型进行房屋内虚拟场景的搭建,将3d模型放置于房屋内空间的固定位置,也可放置于房屋外部空间的固定位置。

29.更进一步的,所述元宇宙系统中用户交互方法包括用户可以从服务设备选取人体3d模型作为自己的虚拟替身,该虚拟替身显示于虚拟场景中,当用户肢体、嘴巴、表情发生变化或移动时,虚拟替身也作出相应的变化或移动。

30.更进一步的,所述元宇宙系统中用户交互方法包括用户a和用户b分别通过用户端设备a和用户端设备b进入同一虚拟空间,用户b通过用户端设备b看到用户a的虚拟替身a,用户a通过用户端设备a看到用户b的虚拟替身b,用户a和用户b可通过肢体动作和语音进行交流,所述用户端设备数量为2个及以上,优选值为2、3、4、5、6、7、8、9、10、16、20、30、40、50、60、70、80、90、100、1000、1万、5万、10万、100万、1000万、1亿、10亿、100亿、1000亿。

31.更进一步的,所述元宇宙系统中用户交互方法包括用户a通过用户端设备a看到自己的虚拟替身a,用户b通过用户端设备b在虚拟场景中布置服装商品3d模型和价格标签、收款二维码来展示服装商品,用户a通过虚拟替身a选取服装商品3d模型a进行试穿,则服装商品3d模型a穿在虚拟替身a身上。

32.更进一步的,所述元宇宙系统中用户交互方法包括用户a通过触摸用户端设备a的指纹识别模块来启动二维码扫描功能,扫描收款二维码后启动支付功能,再通过触摸指纹识别模块完成支付;在虚拟场景中当虚拟人体3d模型a站在镜子3d模型前面,则看到虚拟人体3d模型a的镜像。

33.更进一步的,所述元宇宙系统中所述用户端设备包括替身机器人,用户交互方法包替身机器人a通过摄像头和声音传感器获得现实场景图像及声音,将图像及声音信息上传至服务设备,服务设备中存储有替身机器人b的外观数据,当服务设备识别到图像中包含替身机器人b的外观时,将图像中的用户端设备b外观替换为虚拟人体3d模型b,将虚拟人体3d模型b与虚拟场景或现实场景组合,实现现实场景出现虚拟人物或虚拟场景出现虚拟人物。

34.更进一步的,所述元宇宙系统中所述用户端设备包括替mr头显设备,当用户b身体移动时,替身机器人b也相应移动,且虚拟人体3d模型b也做相应的移动;当用户a触摸替身机器人b的触摸传感器时,mr头显设备b相应的触摸动作执行器则动作,使用mr头显设备b的

用户b感觉到该动作。

35.更进一步的,所述元宇宙系统中用户交互方法包括所述用户端设备a获得现实场景图像及声音,将图像及声音信息上传至服务设备,服务设备将人物图像分离出来生成真实人物图像a,将真实人物图像a与虚拟场景组合,实时显示在用户端设备b上,实现虚拟场景中出现真实人物。

36.更进一步的,所述元宇宙系统中用户交互方法包括所述用户端设备a获得现实场景图像及声音,将图像及声音信息上传至服务设备,服务设备将人物图像分离出来生成真实人物图像a,将真实人物图像a与现实场景组合,实时显示在用户端设备b的显示器上,实现现实场景中出现异地的真实人物;所述现实场景的获取方式为用户端设备b的显示器为半透明显示器,用户b在显示器中看到真实人物图像a的同时可看到周围的现实场景;或者所述现实场景的获取方式为用户端设备b通过摄像头获取现实场景。

37.更进一步的,所述元宇宙系统中用户语音交互方法包括用户a对用户端设备a的声音传感器说话用语言类型a,通过翻译软件翻译为语言类型b,并通过用户端设备b的扬声器传递出语言类型b,用户b对用户端设备b的声音传感器说话用语言类型b,通过翻译软件翻译为语言类型a,再通过用户端设备a的扬声器传递出语言类型a,语言类型可通过用户端设备进行设置。

38.更进一步的,所述元宇宙系统中用户交互方法包括每个服务设备中包含不同地图数据,地图数据单位为、村、镇、市,省,国家、洲,用户通过mr头显设备点选图标进入服务设备的地图数据,点选地图数据的具体位置,显示当前位置的虚拟场景。

39.更进一步的,所述元宇宙系统中所述建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的选择方式包括,用户通过用户端设备上传3d模型数据文件到服务设备,再从服务设备中选取。

40.更进一步的,所述元宇宙系统中所述建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的外观更改方法包括,用户通过用户端设备上传图片或照片文件到服务设备,再从服务设备中选取图片或照片文件,选取需要变更外观的建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的相应部位,则该相应部位外观变化为图片或照片的相应外观。

41.更进一步的,所述元宇宙系统中用户端设备可显示计算机或手机桌面图像、虚拟键盘、虚拟鼠标、虚拟人手,虚拟键盘显示于桌面图像的下方,虚拟鼠标显示于虚拟键盘的右侧;用户端设备扫描和跟踪人手的位置和每个手指的动作轨迹,当手或手指动作时虚拟人手也做相应的动作,引导人进行相应的动作来操作虚拟键盘或者虚拟鼠标,进行操作手机或计算机;所述手部扫描跟踪系统包含自动稳定器,当人头部带动户端设备小幅度移动,但手部未动时,自动稳定器让手部扫描跟踪系统的传感器保持不动,可使用户端设备小幅度移动时显示画面中虚拟人手保持不动。

42.更进一步的,在虚拟场景中,人体3d模型a与人体3d模型b距离越近则语音交流声音越大。

43.本实用新型的有益效果为:一是人与人之间可通过用户端设备连接网络实现语音、视频、动作、体感多方位的互动,使交流更加真实和丰富。

44.二是人与人之间可根据需要在不同地点通过用户端设备连接网络实时交互,不受空间和时间的限制。

45.三是可实现多人之间通过多个用户端设备连接网络在同一虚拟空间进行语音、视频、动作、体感多方位的互动,使多人之间的交互更加便捷。

附图说明

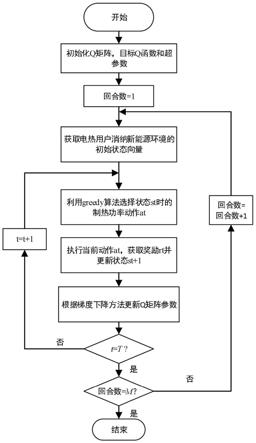

46.图1为本发明实施例一、二、三的元宇宙系统架构示意图。

47.图2为本发明实施例一、二、三的用户端设备外观示意图。

48.图3为本发明实施例三替身机器人a外观示意图。

49.图4为本发明实施例三替身机器人b外观示意图。

具体实施方式

50.为了加深对本发明的理解,下面结合实施例和附图对本发明作进一步描述,该实施例仅用于解释本发明,并不构成对本发明保护范围的限定。

51.实施例一。

52.元宇宙系统,包括2个服务设备、100个用户端设备,所述服务设备包含物体3d模型数据、人体3d模型数据、地图数据,物体3d模型数据包括建筑物3d模型、家具3d模型、家电3d模型、商品3d模型、文字标识3d模型,所述用户端设备可自定义设置的内容包括物体3d模型的地理位置、人体3d模型和物体3d模型的类型、文字或二维码标识3d模型的文字内容以及二维码内容和空间位置、物体3d模型和人体3d模型的空间位置,可通过自定义设置搭建出用户所需的店铺虚拟场景。

53.所述服务设备,可通过用户端设备导入的数据包括物体3d模型数据文件、人体3d模型数据文件。

54.所述地图数据包括道路、街道、河流、湖、海、山脉、村庄、城镇、田地、景点、建筑物;所述服务设备还包括3d模型颜色数据、动物3d模型数据、植物3d模型数据,所述建筑物3d模型包括一层建筑物3d模型、多层建筑物3d模型、建筑物外墙3d模型、建筑物内部布局及装修3d模型、建筑物内部装饰3d模型、灯光3d模型;所述人物3d模型包括发型3d模型、饰品3d模型、镜子3d模型、摄像头3d模型、衣服3d模型、鞋子3d模型、手套3d模型、面部3d模型,面部3d模型可支持照片换脸;每种3d模型数量均为10个以上不同数据,上述每种3d模型均可支持更换颜色数据和用照片更换外观;优选的,每种3d模型不同数据的数量为1000个。

55.所述用户端设备为mr头显设备,可显示虚拟场景或现实场景或虚拟现实结合的场景,mr头显设备包括外壳、主控器和与主控器相连的显示屏、声音传感器、扬声器、肢体动作传感器、定位模块、可连接网络的通讯模块,所述肢体动作传感器为电子罗盘、陀螺仪。

56.所述mr头显设备还包括嘴部动作传感器、面部表情传感器,所述嘴部动作传感器、面部表情传感器为摄像头,用户a可通过mr头显设备a设置自己的虚拟角色为人体3d模型a,mr头显设备a可将使用该设备的用户a的肢体动作、表情动作、嘴部动作信息上传至服务设备,可由服务设备发送给在同一虚拟空间的mr头显设备b,使用mr头显设备b的用户b可看到人体3d模型a及与用户a相应的肢体动作、表情动作、嘴部动作。

57.所述mr头显设备a可以同时连接n个mr头显设备b,其中n=80。

58.所述的mr头显设备,外壳上还包括指纹识别模块,可通过指纹识别模块实现指纹密码、指纹支付、启动扫描二维码的功能;所述头mr显设备可通过扫描二维码或输入编码指令进入某一虚拟空间;所述头mr显设备也可通过在虚拟地图上点击位置进入或输入地理位置信息搜索进入某一虚拟空间,或者通过输入地图经纬度进入某一虚拟空间;所述的mr头显设备包括ar、vr、mr三种工作模式。

59.所述的元宇宙系统,还包括3d扫描仪,可将现实中的物体或人物、动物创建为3d模型数据文件传输到服务设备供用户选择和设置。

60.所述用户端设备的通讯模块为wifi无线通讯模块。

61.所述服务设备或用户端设备包含语音翻译软件。

62.所述用户端设备还包括支付软件,可实现支付功能,用户之间可进行支付交易。

63.所述支付软件交易的货币为数字货币。

64.所述元宇宙系统中用户交互方法为,用户通过用户端设备连接到服务设备,在服务设备的虚拟地图上选取需要搭建虚拟场景的地点,从服务设备选取建筑物3d模型数据进行房屋虚拟场景搭建,建筑物3d模型则放置于该地点上,再从服务设备选取家具3d模型、商品3d模型、文字或二维码标识3d模型进行房屋内虚拟场景的搭建,将3d模型放置于房屋内空间的固定位置,也可放置于房屋外部空间的固定位置。

65.所述元宇宙系统中用户交互方法包括用户可以从服务设备选取人体3d模型作为自己的虚拟替身,该虚拟替身显示于虚拟场景中,当用户肢体、嘴巴、表情发生变化或移动时,虚拟替身也作出相应的变化或移动。

66.所述元宇宙系统中用户交互方法包括用户a和用户b分别通过用户端设备a和用户端设备b进入同一虚拟空间,用户b通过用户端设备b看到用户a的虚拟替身a,用户a通过用户端设备a看到用户b的虚拟替身b,用户a和用户b可通过肢体动作和语音进行交流。

67.所述元宇宙系统中用户交互方法包括用户a通过用户端设备a看到自己的虚拟替身a,用户b通过用户端设备b在虚拟场景中布置服装商品3d模型和价格标签、收款二维码来展示服装商品,用户a通过虚拟替身a选取服装商品3d模型a进行试穿,则服装商品3d模型a穿在虚拟替身a身上。

68.所述元宇宙系统中用户交互方法包括用户a通过触摸用户端设备a的指纹识别模块来启动二维码扫描功能,扫描收款二维码后启动支付功能,再通过触摸指纹识别模块完成支付;在虚拟场景中当虚拟人体3d模型a站在镜子3d模型前面,则看到虚拟人体3d模型a的镜像,这样也可看到衣服的试穿效果;在模拟现实视角的模式下用户的眼睛等同于模拟人体3d模型的的眼睛,不能看到模拟人体3d模型的全貌,可以通过镜子3d模型来观看模拟人体3d模型的全貌;在游戏视角的模式下,用户可看到模拟人体3d模型的全貌。

69.用户b也可在虚拟场景中布置其他商品3d模型,供用户a选购,商品3d模型可以为3d软件制作的作品,也可以通过3d扫描仪将现实中的物品扫描生成商品3d模型,由用户自行通过用户端设备或计算机设备上传至服务设备。

70.所述元宇宙系统中用户交互方法包括所述用户端设备a获得现实场景图像及声音,将图像及声音信息上传至服务设备,服务设备将人物图像分离出来生成真实人物图像a,将真实人物图像a与虚拟场景组合,实时显示在用户端设备b上,实现虚拟场景中出现真实人物。

71.所述元宇宙系统中用户交互方法包括所述用户端设备a获得现实场景图像及声音,将图像及声音信息上传至服务设备,服务设备将人物图像分离出来生成真实人物图像a,将真实人物图像a与现实场景组合,实时显示在用户端设备b的显示器上,实现现实场景中出现异地的真实人物;所述现实场景的获取方式为用户端设备b的显示器为半透明显示器,用户b在显示器中看到真实人物图像a的同时可看到周围的现实场景;或者所述现实场景的获取方式为用户端设备b通过摄像头获取现实场景。

72.所述元宇宙系统中用户语音交互方法包括用户a对用户端设备a的声音传感器说话用语言类型a,通过翻译软件翻译为语言类型b,并通过用户端设备b的扬声器传递出语言类型b,用户b对用户端设备b的声音传感器说话用语言类型b,通过翻译软件翻译为语言类型a,再通过用户端设备a的扬声器传递出语言类型a,语言类型可通过用户端设备进行设置。

73.所述元宇宙系统中用户交互方法包括每个服务设备中包含不同地图数据,地图数据单位为、村、镇、市,省,国家、洲,用户通过mr头显设备点选图标进入服务设备的地图数据,点选地图数据的具体位置,显示当前位置的虚拟场景,也可通过扫描二维码或输入场景对应的编号进入相应场景,也可通过搜索地址进入相应场景。

74.所述元宇宙系统中所述建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的选择方式包括,用户通过用户端设备上传3d模型数据文件到服务设备,再从服务设备中选取。

75.所述元宇宙系统中所述建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的外观更改方法包括,用户通过用户端设备上传图片或照片文件到服务设备,再从服务设备中选取图片或照片文件,选取需要变更外观的建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的相应部位,则该相应部位外观变化为图片或照片的相应外观。

76.该实施例可用于购物、直播等场景,商家或主播在虚拟场景中出售自己的商品,多位客户可同时进入该场景进行选购商品,可看到比较真实的商品3d模型,方便客户购买决策,还可以与商家实时进行语音、视频、动作、体感多方位的互动,使购物场景类似于现实场景,还可以不受地点的限制,不同地点的人通过网络进行互通交流,也可进入其他地区的虚拟场景,购买当地的特产,体验当地的文化气息。

77.当商家与客户的语言不通时,可以通过翻译软件实时翻译为可听懂的语言,交流非常方便。

78.在虚拟场景中,人体3d模型a与人体3d模型b距离越近则语音交流声音越大。

79.实施例二。

80.元宇宙系统,包括10个服务设备、1万个用户端设备,所述服务设备包含物体3d模型数据、人体3d模型数据、地图数据,物体3d模型数据包括建筑物3d模型、家具3d模型、家电3d模型、商品3d模型、文字标识3d模型,所述用户端设备可自定义设置的内容包括物体3d模型的地理位置、人体3d模型和物体3d模型的类型、文字或二维码标识3d模型的文字内容以及二维码内容和空间位置、物体3d模型和人体3d模型的空间位置,可通过自定义设置搭建出用户所需的展会虚拟场景。

81.所述服务设备,可通过用户端设备导入的数据包括物体3d模型数据文件、人体3d

模型数据文件。

82.所述地图数据包括道路、街道、河流、湖、海、山脉、村庄、城镇、田地、景点、建筑物;所述服务设备还包括3d模型颜色数据、动物3d模型数据、植物3d模型数据,所述建筑物3d模型包括一层建筑物3d模型、多层建筑物3d模型、建筑物外墙3d模型、建筑物内部布局及装修3d模型、建筑物内部装饰3d模型、灯光3d模型;所述人物3d模型包括发型3d模型、饰品3d模型、镜子3d模型、摄像头3d模型、衣服3d模型、鞋子3d模型、手套3d模型、面部3d模型,面部3d模型可支持照片换脸;每种3d模型数量均为10个不同数据,上述每种3d模型均可支持更换颜色数据和用照片更换外观;优选的,每种3d模型不同数据的数量为10000个。

83.所述元宇宙系统还包括云端计算机,通过mr头显设备对云端计算机进行远程控制。

84.所述的元宇宙系统还包括云端投影仪,所述云端投影仪,包含可连接网络的通讯模块,云端计算机的桌面图像可远程投影到云端投影仪。

85.所述的元宇宙系统还包括云端打印机,所述云端打印机,包含可连接网络的通讯模块,可通过云端计算机连接到云端打印机打印文件。

86.所述mr头显设备具有计算机功能,可处理文件、连接云端投影仪进行投影或连接云端打印机进行打印。

87.所述用户端设备为mr头显设备,可显示虚拟场景或现实场景或虚拟现实结合的场景,mr头显设备包括外壳、主控器和与主控器相连的显示屏、声音传感器、扬声器、肢体动作传感器、定位模块、可连接网络的通讯模块;可以通过网络远程连接和控制云端计算机,其特征在于,可连接云端计算机并显示云端计算机的桌面图像,可显示虚拟键盘、虚拟鼠标、虚拟人手,虚拟键盘显示于桌面图像的下方,虚拟鼠标显示于虚拟键盘的右侧;mr头显设备还包括人手扫描跟踪系统,扫描和跟踪下方人手的位置和每个手指的动作轨迹,当手或手指动作时虚拟人手也做相应的动作,引导人进行相应的动作来操作虚拟键盘或者虚拟鼠标,进行操作计算机;所述肢体动作传感器为为陀螺仪、电子罗盘、加速传感器、角度传感器、位移传感器、摄像头;所述人手扫描跟踪系统的传感器为als光线感应器、ps距离传感器、红外传感器、摄像头、陀螺仪、加速度传感器、角度传感器、位移传感器。

88.所述mr头显设备,在未连接云端计算机时,可通过手部扫描跟踪系统扫描和跟踪手和手指的动作轨迹,当手或手指动作时,虚拟人手也做相应的动作,用于引导人操作和点选系统菜单;用户a和用户b分别可通过mr头显设备a和mr头显设备b进行语音交流和互动;所述手部扫描跟踪系统包含自动稳定器,当人头部带动mr头显设备小幅度移动,但手部未动时,自动稳定器让手部扫描跟踪系统的传感器保持不动,可使在mr头显设备小幅度移动时显示画面中虚拟人手保持不动;所述自动稳定器的传感器为摄像头、陀螺仪。

89.所述用户端设备为mr头显设备,可显示虚拟场景或现实场景或虚拟现实结合的场景,mr头显设备包括外壳、主控器和与主控器相连的显示屏、声音传感器、扬声器、肢体动作传感器、定位模块、可连接网络的通讯模块。

90.所述mr头显设备还包括嘴部动作传感器、面部表情传感器,用户a可通过mr头显设备a设置自己的虚拟角色为人体3d模型a,mr头显设备a可将使用该设备的用户a的肢体动作、表情动作、嘴部动作信息上传至服务设备,可由服务设备发送给在同一虚拟空间的mr头显设备b,使用mr头显设备b的用户b可看到人体3d模型a及与用户a相应的肢体动作、表情动

作、嘴部动作;所述嘴部动作传感器、面部表情传感器为红外传感器、摄像头。

91.所述mr头显设备a可以同时连接n个mr头显设备b,其中n=10000。

92.所述的mr头显设备,外壳上还包括指纹识别模块,可通过指纹识别模块实现指纹密码、指纹支付、启动扫描二维码的功能;所述头mr显设备可通过扫描二维码或输入编码指令进入某一虚拟空间;所述头mr显设备也可通过在虚拟地图上点击位置进入或输入地理位置信息搜索进入某一虚拟空间,或者通过输入地图经纬度进入某一虚拟空间;所述的mr头显设备包括ar、vr、mr三种工作模式。

93.所述的元宇宙系统,还包括3d扫描仪,可将现实中的物体或人物、动物创建为3d模型数据文件传输到服务设备供用户选择和设置。

94.所述用户端设备的通讯模块为5g无线通讯模块。

95.所述服务设备或用户端设备包含语音翻译软件,支持汉语-英语、英语-汉语、汉语-俄语、俄语-汉语之间的实时语音翻译和文字翻译。

96.所述用户端设备还包括支付软件,可实现支付功能,用户之间可进行支付交易。

97.所述支付软件交易的货币为数字货币。

98.所述元宇宙系统中用户交互方法为,用户通过用户端设备连接到服务设备,在服务设备的虚拟地图上选取需要搭建虚拟场景的地点,从服务设备选取建筑物3d模型数据进行房屋虚拟场景搭建,建筑物3d模型则放置于该地点上,再从服务设备选取家具3d模型、商品3d模型、文字或二维码标识3d模型进行房屋内虚拟场景的搭建,将3d模型放置于房屋内空间的固定位置,也可放置于房屋外部空间的固定位置。

99.所述元宇宙系统中用户交互方法包括用户可以从服务设备选取人体3d模型作为自己的虚拟替身,该虚拟替身显示于虚拟场景中,当用户肢体、嘴巴、表情发生变化或移动时,虚拟替身也作出相应的变化或移动。

100.所述元宇宙系统中用户交互方法包括用户a和用户b分别通过用户端设备a和用户端设备b进入同一虚拟空间,用户b通过用户端设备b看到用户a的虚拟替身a,用户a通过用户端设备a看到用户b的虚拟替身b,用户a和用户b可通过肢体动作和语音进行交流。

101.所述元宇宙系统中用户交互方法包括用户a通过用户端设备a看到自己的虚拟替身a,用户b通过用户端设备b在虚拟场景中布置服装商品3d模型和价格标签、收款二维码来展示服装商品,用户a通过虚拟替身a选取服装商品3d模型a进行试穿,则服装商品3d模型a穿在虚拟替身a身上。

102.所述元宇宙系统中用户交互方法包括用户a通过触摸用户端设备a的指纹识别模块来启动二维码扫描功能,扫描收款二维码后启动支付功能,再通过触摸指纹识别模块完成支付;在虚拟场景中当虚拟人体3d模型a站在镜子3d模型前面,则看到虚拟人体3d模型a的镜像,这样也可看到衣服的试穿效果;在模拟现实视角的模式下用户的眼睛等同于模拟人体3d模型的的眼睛,不能看到模拟人体3d模型的全貌,可以通过镜子3d模型来观看模拟人体3d模型的全貌;在游戏视角的模式下,用户可看到模拟人体3d模型的全貌。

103.用户b也可在虚拟场景中布置其他商品3d模型,供用户a选购,商品3d模型可以为3d软件制作的作品,也可以通过3d扫描仪将现实中的物品扫描生成商品3d模型,由用户自行通过用户端设备或计算机设备上传至服务设备。

104.所述元宇宙系统中用户交互方法包括所述用户端设备a获得现实场景图像及声

音,将图像及声音信息上传至服务设备,服务设备将人物图像分离出来生成真实人物图像a,将真实人物图像a与虚拟场景组合,实时显示在用户端设备b上,实现虚拟场景中出现真实人物。

105.所述元宇宙系统中用户交互方法包括所述用户端设备a获得现实场景图像及声音,将图像及声音信息上传至服务设备,服务设备将人物图像分离出来生成真实人物图像a,将真实人物图像a与现实场景组合,实时显示在用户端设备b的显示器上,实现现实场景中出现异地的真实人物;所述现实场景的获取方式为用户端设备b的显示器为半透明显示器,用户b在显示器中看到真实人物图像a的同时可看到周围的现实场景;或者所述现实场景的获取方式为用户端设备b通过摄像头获取现实场景。

106.所述元宇宙系统中用户语音交互方法包括用户a对用户端设备a的声音传感器说话用语言类型a,通过翻译软件翻译为语言类型b,并通过用户端设备b的扬声器传递出语言类型b,用户b对用户端设备b的声音传感器说话用语言类型b,通过翻译软件翻译为语言类型a,再通过用户端设备a的扬声器传递出语言类型a,语言类型可通过用户端设备进行设置。

107.所述元宇宙系统中用户交互方法包括每个服务设备中包含不同地图数据,地图数据单位为、村、镇、市,省,国家、洲,用户通过mr头显设备点选图标进入服务设备的地图数据,点选地图数据的具体位置,显示当前位置的虚拟场景,也可通过扫描二维码或输入场景对应的编号进入相应场景,也可通过搜索地址进入相应场景。

108.所述元宇宙系统中所述建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的选择方式包括,用户通过用户端设备上传3d模型数据文件到服务设备,再从服务设备中选取。

109.所述元宇宙系统中所述建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的外观更改方法包括,用户通过用户端设备上传图片或照片文件到服务设备,再从服务设备中选取图片或照片文件,选取需要变更外观的建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的相应部位,则该相应部位外观变化为图片或照片的相应外观。

110.在虚拟场景中,人体3d模型a与人体3d模型b距离越近则语音交流声音越大。

111.该实施例可用于展会、会议等场景,不同厂家用户在虚拟场景搭建出自己的展台,搭建出自己想展示的商品,多位客户可同时进入该场景进行参观交流或选购,客户之间也可以看到对方的人体3d模型或真实人物图像,进行互动交流,可看到比较真实的商品3d模型,方便客户参观;还可以与商家实时进行语音、视频、动作、体感多方位的互动,使交互场景类似于现实场景,还可以不受地点的限制,不同地点的人通过网络进入同一个虚拟空间进行互动交流。

112.会议场景下可通过云端计算机连接云端投影仪进行投影观看幻灯片等文件。

113.当厂家与客户的语言不通时,可以通过翻译软件实时翻译为可听懂的语言,交流非常方便。

114.在虚拟场景中,人体3d模型a或真实人物图像a与人体3d模型b或真实人物图像b距离越近则语音交流声音越大。

115.实施例三。

116.元宇宙系统,包括100个服务设备、10万个用户端设备,其特征在于,所述服务设备包含物体3d模型数据、人体3d模型数据、地图数据,物体3d模型数据包括建筑物3d模型、家具3d模型、家电3d模型、商品3d模型、文字标识3d模型,所述用户端设备可自定义设置的内容包括物体3d模型的地理位置、人体3d模型和物体3d模型的类型、文字或二维码标识3d模型的文字内容以及二维码内容和空间位置、物体3d模型和人体3d模型的空间位置,可通过自定义设置搭建出用户所需的虚拟场景。

117.所述服务设备,可通过用户端设备导入的数据包括物体3d模型数据文件、人体3d模型数据文件。

118.所述服务设备还包括天气数据,有太阳、天空、云彩、雨、雪、风、温度、湿度、雾、阴天、白天、黑夜、月亮,可在虚拟场景中显示;在虚拟场景地图数据中不同地理位置的所述天气数据是现实中相应地理位置的实际天气信息实时数据。

119.所述地图数据包括道路、街道、河流、湖、海、山脉、村庄、城镇、田地、景点、建筑物;所述服务设备还包括3d模型颜色数据、动物3d模型数据、植物3d模型数据,所述建筑物3d模型包括一层建筑物3d模型、多层建筑物3d模型、建筑物外墙3d模型、建筑物内部布局及装修3d模型、建筑物内部装饰3d模型、灯光3d模型;所述人物3d模型包括发型3d模型、饰品3d模型、镜子3d模型、摄像头3d模型、衣服3d模型、鞋子3d模型、手套3d模型、面部3d模型,面部3d模型可支持照片换脸;每种3d模型数量均为100万个不同数据,上述每种3d模型均可支持更换颜色数据和用照片更换外观。

120.所述用户端设备还包括圆柱形或圆筒形显示仓,显示仓包括外壳、主控器,还包括与主控器相连的电源模块、可连接网络的通讯模块、声音传感器、扬声器、肢体动作传感器、面部表情识别传感器、摄像头,四周的显示屏和顶部显示屏、底部显示屏。

121.进一步的,所述元宇宙系统还包括云端计算机,通过mr头显设备对云端计算机进行远程控制。

122.进一步的,所述用户端设备为mr头显设备,可显示虚拟场景或现实场景或虚拟现实结合的场景,mr头显设备包括外壳、主控器和与主控器相连的显示屏、声音传感器、扬声器、肢体动作传感器、定位模块、可连接网络的通讯模块;可以通过网络远程连接和控制云端计算机,其特征在于,可连接云端计算机并显示云端计算机的桌面图像,可显示虚拟键盘、虚拟鼠标、虚拟人手,虚拟键盘显示于桌面图像的下方,虚拟鼠标显示于虚拟键盘的右侧;mr头显设备还包括人手扫描跟踪系统,扫描和跟踪下方人手的位置和每个手指的动作轨迹,当手或手指动作时虚拟人手也做相应的动作;引导人进行相应的动作来操作虚拟键盘或者虚拟鼠标,进行操作计算机;所述肢体动作传感器为陀螺仪、电子罗盘、加速传感器、角度传感器、位移传感器、摄像头,所述人手扫描跟踪系统的传感器为als光线感应器、ps距离传感器、红外传感器、摄像头、陀螺仪、加速度传感器、角度传感器、位移传感器。

123.进一步的,所述mr头显设备,在未连接云端计算机时,可通过手部扫描跟踪系统扫描和跟踪手和手指的动作轨迹,当手或手指动作时,虚拟人手也做相应的动作,用于引导人操作和点选系统菜单;用户a和用户b分别可通过mr头显设备a和mr头显设备b进行语音交流和互动;所述手部扫描跟踪系统包含自动稳定器,当人头部带动mr头显设备小幅度移动,但手部未动时,自动稳定器让手部扫描跟踪系统的传感器保持不动,可使在mr头显设备小幅度移动时显示画面中虚拟人手保持不动;所述自动稳定器的传感器为摄像头、陀螺仪、加速

度传感器、角度传感器、位移传感器。

124.进一步的,所述mr头显设备还包括嘴部动作传感器、面部表情传感器,用户a可通过mr头显设备a设置自己的虚拟角色为人体3d模型a,mr头显设备a可将使用该设备的用户a的肢体动作、表情动作、嘴部动作信息上传至服务设备,可由服务设备发送给在同一虚拟空间的mr头显设备b,使用mr头显设备b的用户b可看到人体3d模型a及与用户a相应的肢体动作、表情动作、嘴部动作;所述的mr头显设备可通过wifi通讯模块连接智能手机,并显示智能手机的屏幕界面和播放手机的声音,还显示虚拟人手,可通过手势实现点选、滑动操作,来控制智能手机界面,可通过mr头显设备的显示屏、声音传感器和扬声器实现远程视频通话;所述嘴部动作传感器、面部表情传感器为红外传感器、摄像头、als光线感应器、ps距离传感器。

125.进一步的,所述mr头显设备具有录像功能,还包括摄像头,该摄像头具有移动机构,水平旋转角度大于等于180度,垂直旋转角度大于等于45度;mr头显设备a可通过网络与mr头显设备b连接,mr头显设备a可实时显示mr头显设备b的摄像头所获取的视频信息,mr头显设备a可实时通过扬声器播放mr头显设备b声音传感器获得的声音信息,mr头显设备b同样可以把通过摄像头和声音传感器获得的视频信息、声音信息实时传递给mr头显设备a,mr头显设备a通过显示屏和扬声器实时广播该视频信息和声音信息;所述mr头显设备a可以同时连接n个mr头显设备b,其中n=50000。

126.所述mr头显设备b可通过二维码扫描或输入编码与mr头显a进行连接,所述mr头显设备还包括即时通讯软件,包含通讯录,可与好友或陌生用户进行视频通话、语音通话、文字交流通讯。

127.所述的mr头显设备,其特征在于,具有智能手机功能,包括语音通话、视频通话、短信通讯、运行安装和操作app功能;外壳上还包括指纹识别模块,可通过指纹识别模块实现指纹密码、指纹支付、启动扫描二维码的功能;所述头mr显设备可通过扫描二维码或输入编码指令进入某一虚拟空间;所述头mr显设备也可通过在虚拟地图上点击位置进入或输入地理位置信息搜索进入某一虚拟空间,或者通过输入地图经纬度进入某一虚拟空间;所述的mr头显设备包括ar、vr、mr三种工作模式。

128.所述的元宇宙系统,还包括3d扫描仪,可将现实中的物体或人物、动物创建为3d模型数据文件传输到服务设备供用户选择和设置。

129.所述用户端设备还包括替身机器人,用于所述mr头显设备现实场景的视频图像、语音信息实时获取;所述替身机器人,包括外壳、主控器和与主控器相连的电源模块、可连接网络的通讯模块、摄像头、声音传感器、扬声器、距离传感器、用于身体移动的传动机构,其特征在于,用户可将mr头显设备通过网络与替身机器人通讯,mr头显设备可实时显示替身机器人获取的视频信息和声音信息,用户也可通过mr头显设备将声音信息实时传递给替身机器人,替身机器人可通过扬声器实时广播该声音信息。用户也可通过mr头显设备将声音信息实时传递给替身机器人,替身机器人可通过扬声器实时广播该声音信息。

130.所述服务设备可将替身机器人a的摄像头捕捉到的替身机器人b的现实外观图像替换为用户指定的虚拟人体3d模型b,替身机器人b移动的同时,虚拟人体3d模型b也可相应的移动。所述替身机器人还包括可动作的四肢、身体表面的触摸传感器,所述mr头显设备还包括四肢动作传感器、触摸动作执行器,当使用mr头显设备的用户a四肢动作时,替身机器

人的四肢也可做相应的动作。当用户b触摸替身机器人的触摸传感器时,mr头显设备相应的触摸动作执行器则动作,使用户a感觉到该动作;所述身体表面的触摸传感器,为电阻式或电容式,传感器数量为两个及以上;所述触摸执行器为电动机式或电磁铁式振动器,数量为两个及以上,安装于衣服上。优选的,传感器或触摸执行器数量为100个。

131.所述用户端设备的通讯模块为5g通讯模块。

132.所述服务设备或用户端设备包含语音翻译软件,支持汉语-英语、英语-汉语、汉语-俄语、俄语-汉语之间的实时语音翻译和文字翻译。

133.所述用户端设备还包括支付软件,可实现支付功能,用户之间可进行支付交易。

134.所述支付软件交易的货币为数字货币。

135.所述元宇宙系统中用户交互方法为,用户通过用户端设备连接到服务设备,在服务设备的虚拟地图上选取需要搭建虚拟场景的地点,从服务设备选取建筑物3d模型数据进行房屋虚拟场景搭建,建筑物3d模型则放置于该地点上,再从服务设备选取家具3d模型、商品3d模型、文字或二维码标识3d模型进行房屋内虚拟场景的搭建,将3d模型放置于房屋内空间的固定位置,也可放置于房屋外部空间的固定位置。

136.所述元宇宙系统中用户交互方法包括用户可以从服务设备选取人体3d模型作为自己的虚拟替身,该虚拟替身显示于虚拟场景中,当用户肢体、嘴巴、表情发生变化或移动时,虚拟替身也作出相应的变化或移动。

137.所述元宇宙系统中用户交互方法包括用户a和用户b分别通过用户端设备a和用户端设备b进入同一虚拟空间,用户b通过用户端设备b看到用户a的虚拟替身a,用户a通过用户端设备a看到用户b的虚拟替身b,用户a和用户b可通过肢体动作和语音进行交流,所述用户端设备数量为50000个。

138.所述元宇宙系统中用户交互方法包括用户a通过用户端设备a看到自己的虚拟替身a,用户b通过用户端设备b在虚拟场景中布置服装商品3d模型和价格标签、收款二维码来展示服装商品,用户a通过虚拟替身a选取服装商品3d模型a进行试穿,则服装商品3d模型a穿在虚拟替身a身上。

139.所述元宇宙系统中用户交互方法包括用户a通过触摸用户端设备a的指纹识别模块来启动二维码扫描功能,扫描收款二维码后启动支付功能,再通过触摸指纹识别模块完成支付;在虚拟场景中当虚拟人体3d模型a站在镜子3d模型前面,则看到虚拟人体3d模型a的镜像。

140.所述元宇宙系统中所述用户端设备包括替身机器人,用户交互方法包替身机器人a通过摄像头和声音传感器获得现实场景图像及声音,将图像及声音信息上传至服务设备,服务设备中存储有替身机器人b的外观数据,当服务设备识别到图像中包含替身机器人b的外观时,将图像中的用户端设备b外观替换为虚拟人体3d模型b,将虚拟人体3d模型b与虚拟场景或现实场景组合,实现现实场景出现虚拟人物或虚拟场景出现虚拟人物。

141.所述元宇宙系统中所述用户端设备包括替mr头显设备,当用户b身体移动时,替身机器人b也相应移动,且虚拟人体3d模型b也做相应的移动;当用户a触摸替身机器人b的触摸传感器时,mr头显设备b相应的触摸动作执行器则动作,使用mr头显设备b的用户b感觉到该动作。

142.所述元宇宙系统中用户交互方法包括所述用户端设备a获得现实场景图像及声

音,将图像及声音信息上传至服务设备,服务设备将人物图像分离出来生成真实人物图像a,将真实人物图像a与虚拟场景组合,实时显示在用户端设备b上,实现虚拟场景中出现真实人物。

143.所述元宇宙系统中用户交互方法包括所述用户端设备a获得现实场景图像及声音,将图像及声音信息上传至服务设备,服务设备将人物图像分离出来生成真实人物图像a,将真实人物图像a与现实场景组合,实时显示在用户端设备b的显示器上,实现现实场景中出现异地的真实人物;所述现实场景的获取方式为用户端设备b的显示器为半透明显示器,用户b在显示器中看到真实人物图像a的同时可看到周围的现实场景;或者所述现实场景的获取方式为用户端设备b通过摄像头获取现实场景。

144.所述元宇宙系统中用户语音交互方法包括用户a对用户端设备a的声音传感器说话用语言类型a,通过翻译软件翻译为语言类型b,并通过用户端设备b的扬声器传递出语言类型b,用户b对用户端设备b的声音传感器说话用语言类型b,通过翻译软件翻译为语言类型a,再通过用户端设备a的扬声器传递出语言类型a,语言类型可通过用户端设备进行设置。

145.所述元宇宙系统中用户交互方法包括每个服务设备中包含不同地图数据,地图数据单位为、村、镇、市,省,国家、洲,用户通过mr头显设备点选图标进入服务设备的地图数据,点选地图数据的具体位置,显示当前位置的虚拟场景。

146.所述元宇宙系统中所述建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的选择方式包括,用户通过用户端设备上传3d模型数据文件到服务设备,再从服务设备中选取。

147.所述元宇宙系统中所述建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的外观更改方法包括,用户通过用户端设备上传图片或照片文件到服务设备,再从服务设备中选取图片或照片文件,选取需要变更外观的建筑物3d模型、家具3d模型、商品3d模型、文字或二维码标识3d模型、人体3d模型的相应部位,则该相应部位外观变化为图片或照片的相应外观。

148.所述元宇宙系统中用户端设备可显示计算机或手机桌面图像、虚拟键盘、虚拟鼠标、虚拟人手,虚拟键盘显示于桌面图像的下方,虚拟鼠标显示于虚拟键盘的右侧;用户端设备扫描和跟踪人手的位置和每个手指的动作轨迹,当手或手指动作时虚拟人手也做相应的动作,引导人进行相应的动作来操作虚拟键盘或者虚拟鼠标,进行操作手机或计算机;所述手部扫描跟踪系统包含自动稳定器,当人头部带动户端设备小幅度移动,但手部未动时,自动稳定器让手部扫描跟踪系统的传感器保持不动,可使用户端设备小幅度移动时显示画面中虚拟人手保持不动。

149.该实施例可用于社交、旅游、购物、电影院、ktv、娱乐、会议、展会、直播、演唱会等多种应用场景等多种场景;尤其适用于社交、旅游、娱乐场景,多位用户可同时进入虚拟场景,用户之间也可以看到对方的人体3d模型或真实人物图像,进行互动交流,也可通过替身机器人进入现实的场景中,看到真实的场景,用户之间还可以实时进行语音、视频、动作、体感多方位的互动,使场景更加真实,还可以不受地点的限制,不同地点的人通过网络进行互通交流和欣赏美景;也可进入国外的虚拟场景或现实场景,与当地人交流互动。

150.例如某景区设置有10000台替身机器人,用户a通过mr头显设备a申请连接并控制

替身机器人a,用户a可控制替身机器人a的移动,通过替身机器人a的摄像头看到真实的景区场景,实现异地旅游。

151.或者用户a家里放置有1台替身机器人b,用户b通过mr头显设备b申请连接并控制替身机器人b,用户b可控制替身机器人b的移动,通过替身机器人b的摄像头看到真实的场景,用户b实现与用户a异地交流互动。

152.当用户之间的语言不通时,可以通过翻译软件实时翻译为可听懂的语言,交流非常方便。

153.以上所述仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。