1.本技术涉及电力计量技术领域,尤其涉及一种非介入式电力负荷分解与识别方法、装置、电子设备及存储介质。

背景技术:

2.目前,针对非介入式负荷分解的研究集中在对负荷分解精度的提高之上,常见的有模式识别、最优模板匹配、隐马尔可夫模型等传统方式,以及rnn、lstm、seq2seq等基于深度学习的方式。采用传统方式对负荷分解精度的提升有限,特征提取需要人工干预,使得特征选取具有主观性,且无法根据实际情况做出自适应的调整,导致预测时精度的不稳定性。而采用基于深度学习的方式所使用的负荷数据通常是公开数据集,且均为国外负荷数据,在此基础上训练的模型无法适应国内地区的负荷分解需求,泛化能力较差。此外,目前对于非介入式负荷分解大多是单独进行负荷分解或者负荷识别,未考虑二者之间的联系,且模型参数量大,泛化能力不足。

技术实现要素:

3.有鉴于此,本技术一个或多个实施例提供了一种非介入式电力负荷分解与识别方法、装置、电子设备及存储介质,实现了同时进行非介入式电力的负荷分解以及识别。

4.本技术一个或多个实施例提供了一种非介入式电力负荷分解与识别方法,包括:获取各待测用电设备在监测时间段内各采样点的负荷数据,得到各待测用电设备的负荷序列;根据所述负荷序列利用预先训练好的神经网络模型确定在所述监测时间段内各待测用电设备的功率以及工作状态;输出在所述监测时间段内各待测用电设备的功率以及工作状态;其中,所述神经网络模型是根据电网中各用电设备的样本数据训练得到的双路时序卷积神经网络。

5.可选的,所述方法还包括:在获取各待测用电设备在监测时间段内各采样点的负荷数据,得到各所述用电设备的负荷序列之前,采集电网中各用电设备在预设时间段内的负荷数据,得到各用电设备的负荷序列;针对所述各用电设备中的任意目标用电设备,创建与所述目标用电设备的第一负荷序列等长的第二负荷序列,其中,所述第二负荷序列中的元素均为0;以第一预设概率,保持所述第二负荷序列不变,以第二预设概率在所述第一负荷序列中随机选取所述目标用电设备的第一负荷数据,在确保将所述第一负荷数据完全放入所述第二负荷序列的基础上,在所述第二负荷序列中随机选择起点将所述第一负荷数据叠加至所述第二负荷序列中;以第三预设概率随机选取各用电设备中除所述目标用电设备之外的其他用电设备的负荷序列中的第二负荷数据,在所述第二序列中随机选择起点,将所述第二负荷数据部分或全部叠加至所述第二序列中,得到所述目标用电设备在所述预设时间段内的所述样本数据。

6.可选的,所述神经网络模型,包括:输入层、双支路层、融合层以及输出层;其中,所

述输入层包括卷积层,所述双支路层的两个支路均包括带有膨胀卷积的残差块,所述残差块包括带有批归一化层和修正线性单元的卷积层以及带有批归一化层和修正线性单元的短接,所述融合层包括由所述两个支路的非线性变换的结果融合,所述输出层包括展平层以及全连接层。

7.可选的,所述双支路层的两个支路中均包括三个所述残差块,各所述残差块由其输入端至输入端依次包括两个带有批归一化层和修正线性单元的一维卷积层和一个带有批归一化层和修正线性单元的短接。

8.可选的,所述方法还包括:在输出在所述监测时间段内各待测用电设备的功率以及工作状态之后,计算以下至少一项指标,将所述至少一项指标作为所述神经网络模型的评估指标;确定出的用电设备的功率对应的均方误差、确定出的用电设备的功率对应的平均绝对误差、确定出的用电设备的工作状态的准确率、确定出的用电设备的工作状态精准率、确定出的用电设备的工作的状态召回率以及确定出的用电设备的工作状态对应的f1分数。

9.本技术一个或多个实施例还提供了一种非介入式电力负荷分解与识别装置,包括:获取模块,被配置为获取各用待测电设备在监测时间段内各采样点的负荷数据,得到各待测用电设备的负荷序列;确定模块,被配置为根据所述负荷序列利用预先训练好的神经网络模型确定在所述监测时间段内各待测用电设备的功率以及工作状态;输出模块,被配置为输出在所述监测时间段内各待测用电设备的功率以及工作状态;其中,所述神经网络模型是根据电网中各用电设备的样本数据训练得到的双路时序卷积神经网络。

10.可选的,所述装置还包括:采集模块,被配置为在获取各待测用电设备在监测时间段内各采样点的负荷数据,得到各所述用电设备的负荷序列之前,采集电网中各用电设备在预设时间段内的负荷数据,得到各用电设备的负荷序列;创建模块,被配置为针对所述各用电设备中的任意目标用电设备,创建与所述目标用电设备的第一负荷序列等长的第二负荷序列,其中,所述第二负荷序列中的元素均为0;第一叠加模块,被配置为以第一预设概率,保持所述第二负荷序列不变,以第二预设概率在所述第一负荷序列中随机选取所述目标用电设备的第一负荷数据,在确保将所述第一负荷数据完全放入所述第二负荷序列的基础上,在所述第二负荷序列中随机选择起点将所述第一负荷数据叠加至所述第二负荷序列中;第二叠加模块,被配置为以第三预设概率随机选取各用电设备中除所述目标用电设备之外的其他用电设备的负荷序列中的第二负荷数据,在所述第二序列中随机选择起点,将所述第二负荷数据部分或全部叠加至所述第二序列中,得到所述目标用电设备在所述预设时间段内的所述样本数据。

11.可选的,所述神经网络模型,包括:输入层、双支路层、融合层以及输出层;其中,所述输入层包括卷积层,所述双支路层的两个支路均包括带有膨胀卷积的残差块,所述残差块包括带有批归一化层和修正线性单元的卷积层以及带有批归一化层和修正线性单元的短接,所述融合层包括由所述两个支路的非线性变换的结果融合,所述输出层包括展平层以及全连接层。

12.本技术一个或多个实施例还提供了一种电子设备,包括:处理器;和存储器,其上存储有计算机可执行指令,所述指令在被处理器执行时用于实现上述任意一种非介入式电力负荷分解与识别方法。

13.本技术一个或多个实施例还提供了一种计算机可读存储介质,其上存储有计算机可执行指令,所述指令在被处理器执行时用于实现上述任意一种非介入式电力负荷分解与识别方法。

14.本技术一个或多个实施例的非介入式电力负荷分解与识别方法、装置、电子设备及存储介质,利用预先训练好的双路时序卷积神经网络模型根据获取到的待测用电设备的负荷序列确定在监测时间段内各待测用电设备的功率以及工作状态,实现了同时进行非介入式电力的负荷分解以及识别,提高了系统的处理效率。

附图说明

15.为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其它的附图。

16.图1是根据本技术一个或多个实施例示出的一种非介入式电力负荷分解与识别方法的流程图;

17.图2是根据本技术一个或多个实施例示出的一种神经网络模型的示意图;

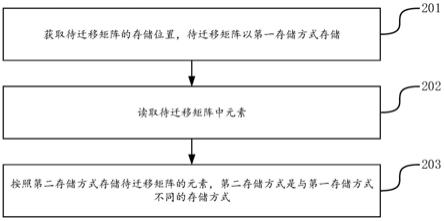

18.图3是根据本技术一个或多个实施例示出的一种基于神经网络模型的负荷分解与识别的流程示意图;

19.图4是根据本技术一个或多个实施例示出的一种非介入式电力负荷分解与识别装置的结构示意图;

20.图5是根据本技术一个或多个实施例示出的一种电子设备的结构示意图。

具体实施方式

21.下面结合附图对本技术实施例进行详细描述。

22.应当明确,所描述的实施例仅仅是本技术一部分实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其它实施例,都属于本技术保护的范围。

23.图1是根据本技术一个或多个实施例示出的一种非介入式电力负荷分解与识别方法的流程图,如图1所示,该方法包括:

24.步骤101:获取各待测用电设备在监测时间段内各采样点的负荷数据,得到各待测用电设备的负荷序列;

25.例如,可向各待测用电设备发送负荷数据查询请求,接收各待测用电设备返回的在监测时间段内各采样点的负荷数据。

26.步骤102:根据所述负荷序列利用预先训练好的神经网络模型确定在所述监测时间段内各待测用电设备的功率以及工作状态;

27.其中,预先训练好的神经网络模型可以是根据电网中各用电设备的样本数据预先训练完成的双路时序卷积神经网络,通过时序卷积神经网络算法训练模型在不损失负荷分解精度情况下,相比于通过rnn(recurrent neural network,循环神经网络)算法训练模型所消耗的时间减少50%左右,提高了模型训练效率。

28.在步骤102中,可将步骤101中获取的待测各用电设备的负荷序列作为神经网络模型输入层的变量,将各用电设备的功率以及工作状态作为神经网络模型输出层的变量。

29.在上述步骤101中,例如可根据时间序列数据的特征,采用滑动窗口获取待测用电设备的负荷序列,从而可在步骤102中,将输入神经网络模型的负荷序列中间位置的数据作为输出,从而可减少计算量,提高模型预测效率。

30.步骤103:输出在所述监测时间段内各待测用电设备的功率以及工作状态。

31.在本技术的一个或多个实施例中,在将各待测用电设备的负荷序列输入上述神经网络型后,神经网络模型可输出在监测时间段内各用电设备的功率以及工作状态,例如,神经网络模型可输出在监测时间段内各用电设备对应时刻的功率值p以及各用电设备在该时刻的开关状态s。

32.本技术一个或多个实施例的非介入式电力负荷分解与识别方法,利用预先训练好的双路时序卷积神经网络模型根据获取到的待测用电设备的负荷序列确定在监测时间段内各待测用电设备的功率以及工作状态,实现了同时进行非介入式电力的负荷分解以及识别,提高了系统的处理效率。

33.在本技术的一个或多个实施例中,在执行上述步骤101之前,可先基于各用电设备在预设时间段内的样本数据,训练上述神经网络模型(下文中也简称模型),在获取样本数据时,基于数据采集的工作量较大以及提高模型在生产环境中的泛化性能的考虑,采用实际采集的负荷数据构造一部分样本数据,将构造的样本数据与实际采集的负荷数据作为上述样本数据,基于此,本技术实施例的非介入式电力负荷分解与识别方法还可包括:

34.在获取各待测用电设备在监测时间段内各采样点的负荷数据,得到各所述用电设备的负荷序列之前,采集电网中各用电设备在预设时间段内的负荷数据,得到各用电设备的负荷序列;

35.其中,在预设时间段内采集的各用电设备的负荷数据例如采用低频采样,稳态特征选择有功功率、无功功率,基于稳态信号的数据采样方式对测量设备的要求较低,例如可以直接从智能电表中获取样本数据。举例说明,可以利用时间采样频率为50hz,空间采样频率为6.4khz的智能电表来采集上述样本。

36.针对所述各用电设备中的任意目标用电设备,创建与所述目标用电设备的第一负荷序列等长的第二负荷序列,其中,所述第二负荷序列中的元素均为0;

37.以第一预设概率,保持所述第二负荷序列不变,以第二预设概率在所述第一负荷序列中随机选取所述目标用电设备的第一负荷数据,在确保将所述第一负荷数据完全放入所述第二负荷序列的基础上,在所述第二负荷序列中随机选择起点将所述第一负荷数据叠加至所述第二负荷序列中;

38.以第三预设概率随机选取各用电设备中除所述目标用电设备之外的其他用电设备的负荷序列中的第二负荷数据,在所述第二序列中随机选择起点,将所述第二负荷数据部分或全部叠加至所述第二序列中,得到所述目标用电设备在所述预设时间段内的所述样本数据。

39.实验结果表明,按照上述方式构造的样本数据训练上述神经网络模型,可在不降低模型精度的同时降低模型的参数量,便于模型在嵌入式设备等边端侧设备进行部署,极大地提高了模型的易用性以及可用性,使得模型对实际负荷分解情境有更强的适应能力。

40.以下对获取上述样本数据的过程进行示例性说明。

41.在该例子中,假设算法的输入为固定长度的负荷序列l,用电设备的种类为n种,对于目标用电设备m(为上述目标用电设备的一个示例),可根据下列步骤构造其对应的训练数据(即上述样本数据):

42.步骤1,根据该用电设备m对应的输入负荷序列q1(为上述第一负荷序列的一个示例)长度l新建一段与其等长的全零序列q2(即序列中的元素均为0,为上述第二负荷序列的一个示例);

43.步骤2,以50%概率(为上述第一预设概率的一个示例),随机选取该用电设备的一次负荷激活,即某次运行阶段的功率消耗数据,并在保证该段负荷激活完整放入序列q2中的前提下,随机在序列q2中选取起点将其叠加进序列q2中;在另外的50%概率(为上述第二预设概率的一个示例)下,保持序列q2不变。

44.步骤3,对于除该用电设备m之外的其他n-1个干扰用电设备,均可以25%的概率(为上述第三预设概率的一个示例)随机选取一次负荷激活并叠加到序列q2中(不需要保证随机选取的负荷激活完整的放入序列q2中)。

45.步骤4,将步骤1至步骤3重复执行w次,构建包含w条数据的样本数据。

46.需要说明的是,上述步骤3中引入其他干扰用电设备的负荷激活的概率可随实际情况进行调整,例如,如发现多用电设备同时工作的概率较高,则可以将上述概率从25%向上调整,这将使得模型具备更强的泛化能力。

47.本技术实施例可在一个端到端的网络中同时完成负荷分解与识别工作,故,在搭建神经网络时,设计了具有两路分支的双路时序卷积神经网络。该两路时序神经网络可具有相同的网络结构,每个支路都可由三个带有膨胀卷积的残差块构成。

48.上述神经网络模型可包括:输入层、双支路层、融合层以及输出层;

49.其中,所述输入层包括卷积层,所述双支路层的两个支路均包括带有膨胀卷积的残差块,所述残差块包括带有批归一化层和修正线性单元的卷积层以及带有批归一化层和修正线性单元的短接,所述融合层包括由所述两个支路的非线性变换的结果融合,所述输出层包括展平层以及全连接层。

50.在本技术的一个或多个实施例中,在保证膨胀卷积能够完全覆盖整个负荷序列的情况下,可采用较小输入负荷序列的长度,这样既能降低运算复杂度,又可提高了分解精度。

51.在本技术的一个或多个实施例中,所述双支路层的两个支路中可均包括三个所述残差块,各所述残差块由其输入端至输入端依次包括两个带有批归一化层和修正线性单元的一维卷积层和一个带有批归一化层和修正线性单元的短接。

52.图2是根据本技术一个或多个实施例示出的一种神经网络模型的示意图,如图2所示。该神经网络模型的输入层是由一个一维卷积层组成;双支路层的每个支路均由三个带有膨胀卷积的残差块组成。每个残差块由两个带有批归一化(batch normalization,bn)层和修正线性单元(rectified linear unit,relu)的一维卷积层和一个带有bn及relu的短接(short cut)组成。融合层由两个支路的非线性变换的结果融合组成;输出层是由一个展平层和全连接层组成,展平层和全连接层中间有一个值为0.5的dropout(表示在模型训练时让网络某些隐含层节点以一定的概率不工作)。

53.本技术一个或多个实施例采用一维膨胀卷积的卷积运算方式,相比采用普通卷积的seq2point方式,不考虑未来时刻点对于当前时刻点的影响,计算量明显减少,且更符合时间序列预测的实际认知,同时可以对历史信息进行回溯,把握更多的特征。

54.在本技术的一个或多个实施例中,非介入式电力负荷分解与识别方法还可包括:

55.在输出在所述监测时间段内各待测用电设备的功率以及工作状态之后,计算以下至少一项指标,将所述至少一项指标作为所述神经网络模型的评估指标;

56.确定出的用电设备的功率对应的均方误差(mse,mean square error)、确定出的用电设备的功率对应的平均绝对误差(mea,mean absolute error)、确定出的用电设备的工作状态的准确率accuracy、确定出的用电设备的工作状态精准率pr ecision、确定出的用电设备的工作的状态召回率re call以及确定出的用电设备的工作状态对应的f1分数f1score。

57.其中,确定出的用电设备的功率对应的均压误差mse可通过如下公式(1)进行计算:

[0058][0059]

确定出的用电设备的功率对应的平均绝对误差mea可通过如下公式(2)进行计算:

[0060][0061]

在上式(1)以及上式(2)中,n表示负荷样本个数,y表示模型输出的负荷功率值,表示负荷的实际功率值。

[0062]

确定出的用电设备的工作状态的准确率accuracy可以通过如下公式(3)进行计算:

[0063]

accuracy=tp tn/(tp tn fp fn)

ꢀꢀ

(3)

[0064]

确定出的用电设备的工作状态的9精确率pr ecision可以通过如下公式(4)进行计算:

[0065]

pr ecision=tp/(tp fp)

ꢀꢀ

(4)

[0066]

确定出的用电设备的工作状态的召回率re call可通过如下公式(5)进行计算:

[0067]

re call=tp/(tp fn)

ꢀꢀ

(5)

[0068]

确定出的用电设备的工作状态对应的f1score分数(表示pr ecision和recall的调和平均)可通过如下公式(6)进行计算:

[0069]

f1score=2*pr ecision*re call/(pr ecision re call)

ꢀꢀ

(6)

[0070]

在上述公式(3)至公式(6)中,tp表示负荷实际状态为打开,模型预测结果为打开的数量;fn表示负荷实际状态为打开,模型预测结果为关闭的数量;fp表示负荷实际状态为关闭,模型预测结果为打开的数量;tn表示负荷实际状态为关闭,模型预测结果为关闭的数量。

[0071]

在本技术的一个或多个实施例中,在对上述样本数据进行训练中,可利用带mini-batch(微批数据集)的随机梯度下降算法来迭代和更新卷积核状态w和偏置b。每次进行微批数据集运算,并采用随机梯度下降算法寻找全局最优解。

[0072]

在cnn(convolutional neural networks,卷积神经网络)的工作处理过程中,卷

积层之间通过卷积滤波器联系,卷积滤波器的定义可以表示为w

×h×c×

d,其中,c代表被滤波图像的通道数;w、h分别代表滤波范围的宽、高;d代表卷积滤波器的种类。

[0073]

上述神经网络的输入层含有一个卷积层,输入层特征提取公式表示如下:

[0074]

f1(x 1)=w 1*x 1 b 1

ꢀꢀ

(7)

[0075]

上述公式(7)中,x 1为进入所述输入层的特征图,w 1为所述输入层的卷积滤波器的尺寸,b 1为偏置;w 1的尺寸例如是1

×3×1×

16,它表示16种不同的卷积滤波器,每个卷积的核尺寸为1

×3×

1,f1(x 1)是输入层得到的特征图。输入数据为1

×

599

×

1的特征图,表示特征图为序列长度为599,单个元素维度为1的时序数据。经过卷积层输出特征图的宽w1和高h1,计算公式如公式(8)所示,kernel为卷积的核大小;stride为卷积核的步长,当取值为1时,提取重叠的时序数据,效果较好;pad为边缘补零像素的个数。在本技术实施例中,设定kernel的值为3,stride的值为1,膨胀率d为1时,pad的值为1;膨胀率d为2时,pad的值为3;膨胀率d为4时,pad的值为5。因此,输入数据经过输入层16个3

×

1的卷积核之后会产生16

×

599的特征图。

[0076]

w1=(w pad*2-kenel-(kenel-1)*(d-1))/stride 1 (8)

[0077]

如图2所示,支路层由a、b两个支路构成,两个支路可具有相同的网络结构。每个支路具有三个带有膨胀卷积的残差块。第一个残差块的输入x形状大小为16

×

599,首先经过两个1维卷积,每个卷积的卷积核大小均为3

×

1,膨胀率d为1,卷积核个数为32。经过两个卷积之后均连接了批归一化层和修正线性单元。批归一化层设置在卷积层和relu激活函数中间,可避免神经网络模型训练时的收敛速度慢和梯度爆炸等无法训练的情况。同时,批归一化层加快了神经网络模型的训练速度,提高了训练完成的模型的精度。最后,特征图经过修正线性单元,提高了特征的非线性。经过两个1维卷积之后,得到的特征图r大小为32

×

599。然后,将支路的输入进行卷积核个数为32的升维卷积操作,得到大小为32

×

599的特征图short cut(短接),接着将特征图r与short cut进行元素级相加,得到同样大小为32

×

599的特征图o。同样将特征图o连接批归一化层和修正线性单元,得到第一个残差块的输出特征图o1,o1形状大小为32

×

599。与第一个残差块相比,第二个残差块和第三个残差块具有相同的网络结构。在第二个残差块中,卷积核个数为64,膨胀率d为2,残差块的输出形状为64

×

599;在第三个残差块中,卷积核个数为64,膨胀率d为4,残差块的输出形状为64

×

599。因此,任一支路的输出形状为64

×

599。

[0078]

两个支路的卷积神经网络经过非线性变换之后的输出结果进行对应位置的特征值相加得到线性融合层的输出结果,支路a、b的非线性变换层输出的特征图大小均为64

×

599,融合层的输出结果为64

×

599的特征图。如公式(9)所示:

[0079]ci

=ai biꢀꢀ

(9)

[0080]

上述公式(9)中,ci代表融合层输出的特征图在i位置的元素值,ai代表a支路经过非线性变换后输出的特征图在i位置的元素值,bi代表b支路经过非线性变换后输出的特征图在i位置的元素值。

[0081]

在输出层的输出重建过程中,特征图输入到包含有一个展平层和一个全连接层的输出层。经过展平层后的特征图大小为38336

×1×

1,最后经过一个38336

×

2的全连接层,网络最后输出的特征图大小为1

×

2。

[0082]

采集得到的训练数据集经过该网络进行训练,迭代预设次数,例如100次以上后得

到每轮训练得到的模型,模型可被保存到文件中。

[0083]

图3是根据本技术一个或多个实施例示出的一种非介入式电力负荷分解与识别的流程示意图,如图3所示,该流程可包括离线部分以及在线部分,离线部分包括神经网络框架的搭建,采集训练数据集,神经网络模型的训练以及神经网络模型的导出与保存。在线部分包括获取待测用电设备的负荷序列的获取,利用神经网络模型基于待测用电设备的负荷序列进行分解和识别,输出分解结果与识别结果,对识别结果与分解结果进行评价,流程结束。

[0084]

图4是根据本技术一个或多个实施例示出的一种非介入式电力负荷分解与识别装置的结构示意图,如图4所示,该装置40包括:

[0085]

获取模块41,被配置为获取各待测用电设备在监测时间段内各采样点的负荷数据,得到各待测用电设备的负荷序列;

[0086]

确定模块42,被配置为根据所述负荷序列利用预先训练好的神经网络模型确定在所述监测时间段内各待测用电设备的功率以及工作状态;

[0087]

输出模块43,被配置为输出在所述监测时间段内各待测用电设备的功率以及工作状态;

[0088]

其中,所述神经网络模型是根据电网中各用电设备的样本数据训练得到的双路时序卷积神经网络。

[0089]

在本技术的一个或多个实施例中,上述装置还可包括:

[0090]

采集模块,被配置为在获取各待测用电设备在监测时间段内各采样点的负荷数据,得到各所述用电设备的负荷序列之前,采集电网中各用电设备在预设时间段内的负荷数据,得到各用电设备的负荷序列;

[0091]

创建模块,被配置为针对所述各用电设备中的任意目标用电设备,创建与所述目标用电设备的第一负荷序列等长的第二负荷序列,其中,所述第二负荷序列中的元素均为0;

[0092]

第一叠加模块,被配置为以第一预设概率,保持所述第二负荷序列不变,以第二预设概率在所述第一负荷序列中随机选取所述目标用电设备的第一负荷数据,在确保将所述第一负荷数据完全放入所述第二负荷序列的基础上,在所述第二负荷序列中随机选择起点将所述第一负荷数据叠加至所述第二负荷序列中;

[0093]

第二叠加模块,被配置为以第三预设概率随机选取各用电设备中除所述目标用电设备之外的其他用电设备的负荷序列中的第二负荷数据,在所述第二序列中随机选择起点,将所述第二负荷数据部分或全部叠加至所述第二序列中,得到所述目标用电设备在所述预设时间段内的所述样本数据。

[0094]

在本技术的一个或多个实施例中,所述神经网络模型,可包括:

[0095]

输入层、双支路层、融合层以及输出层;

[0096]

其中,所述输入层包括卷积层,所述双支路层的两个支路均包括带有膨胀卷积的残差块,所述残差块包括带有批归一化层和修正线性单元的卷积层以及带有批归一化层和修正线性单元的短接,所述融合层包括由所述两个支路的非线性变换的结果融合,所述输出层包括展平层以及全连接层。

[0097]

在本技术的一个或多个实施例中,所述双支路层的两个支路中均包括三个所述残

差块,各所述残差块由其输入端至输入端依次包括两个带有批归一化层和修正线性单元的一维卷积层和一个带有批归一化层和修正线性单元的短接。

[0098]

在本技术的一个或多个实施例中,上述装置还可包括:

[0099]

计算模块,被配置为在输出在所述监测时间段内各待测用电设备的功率以及工作状态之后,计算以下至少一项指标,将所述至少一项指标作为所述神经网络模型的评估指标;

[0100]

确定出的用电设备的功率对应的均方误差、确定出的用电设备的功率对应的平均绝对误差、确定出的用电设备的工作状态的准确率、确定出的用电设备的工作状态精准率、确定出的用电设备的工作的状态召回率以及确定出的用电设备的工作状态对应的f1分数。

[0101]

本技术一个或多个实施例还提供了一种电子设备,包括:处理器;和存储器,其上存储有计算机可执行指令,所述指令在被处理器执行时用于实现上述任意一种所述的非介入式电力负荷分解与识别方法。

[0102]

本技术一个或多个实施例还提供了一种计算机可读存储介质,其上存储有计算机可执行指令,所述指令在被处理器执行时用于实现上述任意一种非介入式电力负荷分解与识别方法。

[0103]

图5示出了根据本技术一个或多个实施例示出的一种电子设备的结构示意图,该设备可以包括:处理器1010、存储器1020、输入/输出接口1030、通信接口1040和总线1050。其中处理器1010、存储器1020、输入/输出接口1030和通信接口1040通过总线1050实现彼此之间在设备内部的通信连接。

[0104]

处理器1010可以采用通用的cpu(central processing unit,中央处理器)、微处理器、应用专用集成电路(application specific integrated circuit,asic)、或者一个或多个集成电路等方式实现,用于执行相关程序,以实现本说明书实施例所提供的技术方案。

[0105]

存储器1020可以采用rom(read only memory,只读存储器)、ram(random access memory,随机存取存储器)、静态存储设备,动态存储设备等形式实现。存储器1020可以存储操作系统和其他应用程序,在通过软件或者固件来实现本说明书实施例所提供的技术方案时,相关的程序代码保存在存储器1020中,并由处理器1010来调用执行。

[0106]

输入/输出接口1030用于连接输入/输出模块,以实现信息输入及输出。输入输出/模块可以作为组件配置在设备中(图中未示出),也可以外接于设备以提供相应功能。其中输入设备可以包括键盘、鼠标、触摸屏、麦克风、各类传感器等,输出设备可以包括显示器、扬声器、振动器、指示灯等。

[0107]

通信接口1040用于连接通信模块(图中未示出),以实现本设备与其他设备的通信交互。其中通信模块可以通过有线方式(例如usb、网线等)实现通信,也可以通过无线方式(例如移动网络、wifi、蓝牙等)实现通信。

[0108]

总线1050包括一通路,在设备的各个组件(例如处理器1010、存储器1020、输入/输出接口1030和通信接口1040)之间传输信息。

[0109]

需要说明的是,尽管上述设备仅示出了处理器1010、存储器1020、输入/输出接口1030、通信接口1040以及总线1050,但是在具体实施过程中,该设备还可以包括实现正常运行所必需的其他组件。

[0110]

此外,本领域的技术人员可以理解的是,上述设备中也可以仅包含实现本说明书实施例方案所必需的组件,而不必包含图中所示的全部组件。需要说明的是,在本文中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。而且,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

[0111]

本说明书中的各个实施例均采用相关的方式描述,各个实施例之间相同相似的部分互相参见即可,每个实施例重点说明的都是与其他实施例的不同之处。

[0112]

尤其,对于装置实施例而言,由于其基本相似于方法实施例,所以描述的比较简单,相关之处参见方法实施例的部分说明即可。

[0113]

为了描述的方便,描述以上装置是以功能分为各种单元/模块分别描述。当然,在实施本技术时可以把各单元/模块的功能在同一个或多个软件和/或硬件中实现。

[0114]

以上所述,仅为本技术的具体实施方式,但本技术的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本技术揭露的技术范围内,可轻易想到的变化或替换,都应涵盖在本技术的保护范围之内。因此,本技术的保护范围应以权利要求的保护范围为准。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。