1.本发明属于计算机视觉技术领域,尤其涉及基于图像生成和共 享学习网络的跨模态行人重识别方法。

背景技术:

2.行人重识别,是视频监控、智能城市建设和多媒体应用中的一项 重要任务,其目的是在多个不重叠的摄像头获得的图像或视频序列中 匹配特定的人。给定来自一个相机视图的行人的查询图像,它尝试从 不相交的相机视图捕获的一组候选行人图库中识别相同的人的id图 像。大部分的研究主要集中在单模态相机捕获的可见人物图像上,并 将行人重识别任务定义为单模态(可见-可见)匹配问题。单模态行 人重识别的主要挑战是不同视点、遮挡、姿态和复杂背景等引起的模 态内问题。大多数方法主要集中在深度特征表示学习或深度度量学习。 前者的目标是学习一个鲁棒和区别性的特征表示,后者的目标是学习 一个距离度量来处理上述匹配问题,这两种方法都取得了令人鼓舞的 成功。

3.然而,单模态行人重识别在光照条件较差时,即光线较弱或不可 用时,受到很大的限制。例如,在有监视和刑事侦查的情况下,大多 数犯罪嫌疑人选择在白天收集信息,晚上进行犯罪行为。由于公众安 全需求的迫切和红外监控摄像机数量的不断增加,跨模态(红外-可 见光)行人重识别是智能监控系统中必不可少的一项技术,具有重要 的研究影响和现实意义。

4.与只有模态内差异问题的单模态行人重识别任务不同,iv-reid 还遇到了由于不同光谱相机成像过程不同而导致的模态间差异问题。 如图1所示,红外图像和可见光图像具有本质上的差异性和异质性, 并且具有不同的波长范围。因此,跨模态图像既面临着模态内差异的 挑战,也面临着模态间差异的挑战,这意味着跨模态行人重识别还有 很长的路要走。为了解决上述问题,现有研究大多集中于通过单一的 特征级别约束来弥合红外图像与可见光图像之间的差距。基本的思想 都是通过将不同的模态嵌入到相同的特征空间来学习模态共享表示。 然而,单一的特征级别约束是有上限的,无法有效解决跨模态行人重 识别遇到的问题。并且,在这些方法中都采用具有共享全连接层的双 流网络来学习跨模态特征,而忽略了特征提取层中的共享信息。

5.近些年,随着生成式对抗网络的快速发展,大多数研究尝试着利 用图像翻译模型将图像从一种形态转换为另一种形态,生成模型所生 成的图像必须具有良好的质量和足够的多样性,以弥补红外图像和可 见光图像之间的模态差异。因此,如何达到模态级别和特征级别的对 齐是当下需要解决的技术问题。

技术实现要素:

6.针对现有技术不足,本发明的目的在于提供基于图像生成 和共享学习网络的跨模态行人重识别方法,首先,提出了一个跨 模态生成和共享学习联合框架,该框架主要由一个跨模态图像生成网 络和一个双路径共享学习网络组成,跨模态图像生成网络可以通

过分 解行人的模态特征和外观特征,生成多样的跨模态图像,在保持特定 身份一致性的同时实现模态级别对齐,在双路径共享学习网络中,采 用参数共享模块去获取更具区分性的行人特征信息,实现特征级别对 齐。将两个子网络级联并以端到端方式进行优化,从而使网络提取到 更加具有区分性的行人特征,有效的提升了跨模态行人重识别的性能。

7.本发明提供如下技术方案:

8.基于图像生成和共享学习网络的跨模态行人重识别方法,包 括以下步骤:

9.步骤1:跨模态图像生成网络的构建,采用两种不同深度的编码 器解缠红外图像和可见光图像,并获得它们的模态特征和外观特征, 然后将它们映射为统一的特定模态空间和共享外观空间,最后,交换 共享外观空间的特征并生成成对的跨模态图像以实现模态级别的对 齐;

10.步骤2:跨模态图像生成网络损失函数的设计,为了保证生成的 跨模态图像具有真实性和多样性,设计多种损失函数进行模型的优化;

11.步骤3:双路径共享学习网络的构建,将跨模态图像生成网络生 成的红外伪图像与真实红外图像组合成一对输入图像,在线输入到双 路径共享学习网络进行训练,提取具有区分性的中层特征信息,实现 特征级别对齐;

12.步骤4:共享学习损失函数的设计,给定一组训练图像,利用kl 发散损失最小化各特征分布之间的距离,以改善具有相同身份的跨模 态图像的相似度分布;

13.步骤5:损失函数的联合优化,将跨模态图像生成网络和双路径 共享学习网络进行联合训练,以端到端的方式优化总目标。

14.优选的,在步骤1中,首先将真实的红外图像和可见光图像分 别定义为和其中h和w分别是图 像的高和宽,每一个红外与可见光真实图像分别对应一个真实标签 y∈{1,2,...,n},n是数据集中行人id的个数。对于每一个由外观编码器 和模态编码器解缠模态图像得到的外观特征和模态特征分别表示为 f

aj

和f

mj

:

[0015][0016]

其中上标j=i,v,分别表示真实图像的模态属性,ea和em分别代表外 观编码器和模态编码器,随后,交换两种不同模态图像的外观特征, 生成伪红外与可见光图像:

[0017][0018]

其中gi和gv分别表示红外生成器与可见光生成器。

[0019]

优选的,在步骤2中,首先,跨模态生成侧重于不同模态的图 像生成,在这个过程中,获得两张不同模式的图像后,首先通过跨模 态图像生成网络交换它们的模态特征或外观特征,合成一对新图像, 在此过程中,对图像之间引入跨模态解缠损失,此损失使用l1范数 在图像边缘获得更好的生成性能,跨模态解缠损失公式如下:

[0020]

[0021]

其中分别是可见光和红外图像的模态特征和外观 特征,由于生成的伪跨模态图像不存在真实值监督,具有与原始图像 相同的身份,此时,引入循环一致性损失,通过交换从生成的伪红外 和可见光图像中再次分离出来的模态特征和外观特征,重构出两幅原 始图像。

[0022]

优选的,循环一致性损失公式可以表示为:

[0023][0024]

其中分别为生成的伪红外图像和可见光图像的模态 特征和外观特征,跨模态图像生成网络的目标是生成成对的跨模态行 人图像,为了进一步正则化生成器,提高生成样本的质量,在同一模 态下引入重构损失。

[0025]

优选的,重构损失可以表示为:

[0026][0027]

图像生成任务最重要的目标是在跨模态行人重识别领域生成真实 的图像,真实的图像能够实现数据的增强,减少不同模态之间的差异, 因此,引入对抗性损失来监督图像生成过程,在对抗性训练中分别使 用红外和可见光两种辨别器,生成器试图使用生成的假图像来欺骗辨 别器,而辨别器则试图区分正确和错误的结果,生成器和辨别器在互 相博弈中不断优化网络,对抗性损失如下:

[0028]

l

adv

=e[logdi(xi) log(1-di(xi′

))] e[logdv(xv) log(1-dv(xv′

))]

ꢀꢀꢀꢀ

(6)

[0029][0030]

其中di和dv分别对应于红外模态和可见光模态的辨别器。

[0031]

优选的,在步骤3中,在imagenet上预训练的resnet-50作 为主干网络,所述resnet-50包括5个卷积块:conv1、conv2_x、conv3_x、 conv4_x和conv5_x,通过共享较低层次的卷积块以获得更多的判别 信息,在参数共享模块的阶段1,使用conv1、conv2_x和conv3_x 作为两个参数独立的分支,提取红外和可见光图像对应的特定模态信 息,在阶段2,利用conv4_x和conv5_x作为参数共享网络,获取具 有区分性的中层通道共享信息,去掉主干网络原有的全连接层,增加 一个全局平均池化层和512-dim全连接层来提取特征。

[0032]

优选的,kl散度损失为:

[0033]

l

kl

=e[d

kl

(fi||fi′

)] e[d

kl

(fv||fv′

)]

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(7)

[0034]

其中,并且特征向量f∈f来自双路径共 享模块512-dim全连接层的输出,f的上标代表网络的两个分支,下 标代表跨模态图像生成网络生成的伪图像,为了减小模态间的差异, 将交叉熵损失和相似度学习的三重熵损失作为共享学习网络的目标 函数,三元组损失可以表述为:

[0035][0036]

其中fa表示为表示锚点,f

p

和fn分别表示与fa相同的正样本和与fa不同的负样本,d(

·

,

·

)计算欧氏距离,m为边界参数,[x]

=max(x,0)将负 数截断为零,同时保持正数不变。

[0037]

优选的,使用交叉熵损失进行身份学习,通过双路径共享网络的 最后一个全连接层,可以得到训练图像yi对应的预测值yj′

,交叉熵损 失如下所示:

[0038]

l

ce

=e[-log(p(yj′

|yj))]

ꢀꢀ

(9)

[0039]

其中p(yj′

|yj)是输入样本属于真实类的预测概率。

[0040]

优选的,在步骤5中,总体损失函数可以表示为:

[0041][0042]

其中超参数λ

dis

和λ

cyc

是控制生成图像的图像跨模态解缠损失和循 环一致性损失重要性的权重,通过优化上述损失,跨模态图像生成网 络可以将红外图像转换为可见光图像,并减少各模态之间的差异,双 路径共享学习网络则能够提取到不同模态图像的具有区分性的中层 特征信息,提高模型的性能。

[0043]

与现有技术相比,本发明具有以下有益效果:

[0044]

(1)本发明基于图像生成和共享学习网络的跨模态行人 重识别方法,设计多种损失函数进行模型的优化,保证生成的跨模 态图像具有真实性和多样性。

[0045]

(2)本发明基于图像生成和共享学习网络的跨模态行人 重识别方法,引入对抗性损失来监督图像生成过程,实现了数据 的增强,减少了不同模态之间的差异。

[0046]

(3)本发明基于图像生成和共享学习网络的跨模态行人 重识别方法,利用kl发散损失最小化各特征分布之间的距离, 改善了具有相同身份的跨模态图像的相似度分布。

[0047]

(4)本发明基于图像生成和共享学习网络的跨模态行人 重识别方法,通过采用两种不同深度的编码器来解缠红外图像和可 见光图像,并获得它们的模态特征和外观特征。然后将它们映射为统 一的特定模态空间和共享外观空间,最后,交换共享外观空间的特征 并生成成对的跨模态图像以实现模态级别的对齐。

附图说明

[0048]

为了更清楚地说明本发明实施方式的技术方案,下面将对 实施方式中所需要使用的附图作简单地介绍,应当理解,以下 附图仅示出了本发明的某些实施例,因此不应被看作是对范围 的限定,对于本领域普通技术人员来讲,在不付出创造性劳动 的前提下,还可以根据这些附图获得其他相关的附图。

[0049]

图1跨模态行人的两种模态示意图。

[0050]

图2为本发明的总体网络框图。

[0051]

图3为本发明的双路径共享学习网络框图。

[0052]

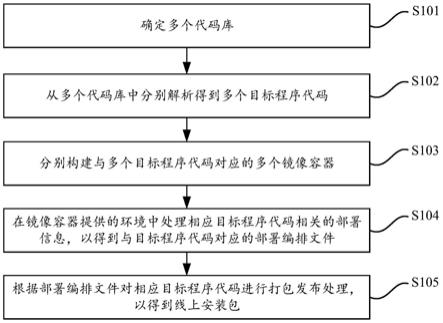

图4为本发明的流程图。

具体实施方式

[0053]

为使本发明实施方式的目的、技术方案和优点更加清楚, 下面将结合本发明实施方式中的附图,对本发明实施方式中的 技术方案进行清楚、完整地描述。显然,所描述的实施方式是 本发明一部分实施方式,而不是全部的实施方式。基于本发明 中的实施方式,本领域普通技术人员在没有作出创造性劳动前 提下所获得的所有其他实施方式,都属于本发明保护的范围。

[0054]

因此,以下对在附图中提供的本发明的实施方式的详细描 述并非旨在限制要求

保护的本发明的范围,而是仅仅表示本发 明的选定实施方式。基于本发明中的实施方式,本领域普通技 术人员在没有作出创造性劳动前提下所获得的所有其他实施方 式,都属于本发明保护的范围。

[0055]

实施例一:

[0056]

结合图4所示,基于图像生成和共享学习网络的跨模态行人 重识别方法,

[0057]

步骤1:跨模态图像生成网络的构建,结合图2所示,采用两种 不同深度的编码器来解缠红外图像和可见光图像,并获得它们的模态 特征和外观特征,模态特征包括姿势,视角等,外观特征包括光照、 衣服和包的颜色、风格等,然后将它们映射为统一的特定模态空间和 共享外观空间。最后,交换共享外观空间的特征并生成成对的跨模态 图像以实现模态级别的对齐。

[0058]

首先将真实的红外图像和可见光图像分别定义为 和其中h和w分别是图像的高和 宽。每一个红外与可见光真实图像分别对应一个真实标签y∈{1,2,...,n}, n是数据集中行人id的个数。对于每一个由外观编码器和模态编码 器解缠模态图像得到的外观特征和模态特征分别表示为f

aj

和f

mj

。

[0059][0060]

其中上标j=i,v,分别表示真实图像的模态属性。ea和em分别代表 外观编码器和模态编码器。随后,交换两种不同模态图像的外观特征, 生成伪红外与可见光图像,

[0061][0062]

其中gi和gv分别表示红外生成器与可见光生成器。

[0063]

步骤2:跨模态图像生成网络损失函数的设计,为保证生成的跨 模态图像具有真实性和多样性,设计多种损失函数进行模型的优化。 首先,跨模态生成侧重于不同模态的图像生成。在这个过程中,获得 两张不同模式的图像后,首先通过跨模态图像生成网络交换它们的模 态特征或外观特征,合成一对新图像。在此过程中,本发明对图像之 间引入了一种跨模态解缠损失。此损失使用l1范数在图像边缘获得 更好的生成性能。因此,跨模态解缠损失公式如下:

[0064][0065]

其中分别是可见光和红外图像的模态特征和外观特征。 并且,由于生成的伪跨模态图像不存在真实值监督,但具有与原始图 像相同的身份,引入循环一致性损失,通过交换从生成的伪红外和可 见光图像中再次分离出来的模态特征和外观特征,重构出两幅原始图 像,循环一致性损失公式可以表示为:

[0066][0067]

其中分别为生成的伪红外图像和可见光图像的模态 特征和外观

特征。跨模态图像生成网络的目标是生成成对的跨模态行 人图像,但为了进一步正则化生成器,提高生成样本的质量,在同一 模态下引入了一个重构损失。重构损失可以表示为:

[0068][0069]

图像生成任务最重要的目标是在跨模态行人重识别领域生成真实 的图像,只有真实的图像才能实现数据的增强,减少不同模态之间的 差异。因此,引入对抗性损失来监督图像生成过程。具体来说,在对 抗性训练中分别使用了红外和可见光两种辨别器。生成器试图使用生 成的假图像来欺骗辨别器,而辨别器则试图区分正确和错误的结果。 生成器和辨别器在互相博弈中不断优化网络,对抗性损失如下:

[0070]

l

adv

=e[logdi(xi) log(1-di(xi′

))] e[logdv(xv) log(1-dv(xv′

))]

ꢀꢀ

(6)

[0071]

其中di和dv分别对应于红外模态和可见光模态的辨别器。

[0072]

步骤3:双路径共享学习网络的构建。如图3所示,将跨模态图 像生成网络生成的红外(可见)伪图像与真实红外(可见)图像组合成一 对输入图像,在线输入到双路径共享学习网络进行训练。由于 resnet-50在防止梯度消失和获得区分性特征方面的有效性,其在计 算机视觉领域得到了广泛的应用,因此采用在imagenet上预训练的 resnet-50作为主干网络。resnet-50包括5个卷积块:conv1、conv2_x、 conv3_x、conv4_x和conv5_x。通过共享较低层次的卷积块以获得更 多的判别信息。在参数共享模块的阶段1,使用conv1、conv2_x和 conv3_x作为两个参数独立的分支,提取红外和可见光图像对应的特 定模态信息。在阶段2,利用conv4_x和conv5_x作为参数共享网络, 获取具有区分性的中层通道共享信息,并且去掉了主干网络原有的全 连接层,增加了一个全局平均池化层和512-dim全连接层来提取特征。

[0073]

步骤4:共享学习损失函数的设计。给定一组训练图像,利用kl 发散损失最小化各特征分布之间的距离,以改善具有相同身份的跨模 态图像的相似度分布。kl散度损失为:

[0074]

l

kl

=e[d

kl

(fi||fi′

)] e[d

kl

(fv||fv′

)]

ꢀꢀ

(7)

[0075]

其中,并且特征向量f∈f来自双路径共享 模块512-dim全连接层的输出。f的上标代表网络的两个分支,下标 代表跨模态图像生成网络生成的伪图像。为了减小模态间的差异,将 交叉熵损失和相似度学习的三重熵损失作为共享学习网络的目标函 数。三元组损失可以表述为:

[0076][0077]

其中fa表示为表示锚点,f

p

和fn分别表示与fa相同的正样本和与fa不同的负样本。d(

·

,

·

)计算欧氏距离,m为边界参数。[x]

=max(x,0)将负 数截断为零,同时保持正数不变。

[0078]

使用交叉熵损失进行身份学习,通过双路径共享网络的最后一个 全连接层,可以得到训练图像yi对应的预测值yj′

。交叉熵损失如下所 示:

[0079]

l

ce

=e[-log(p(yj′

|yj))]

ꢀꢀ

(9)

[0080]

其中p(yj′

|yj)是输入样本属于真实类的预测概率。

[0081]

步骤5:损失函数的联合优化。本发明将跨模态图像生成网络和 双路径共享学习

网络进行联合训练,以端到端的方式优化总目标。总 体损失函数可以表示为:

[0082][0083]

其中超参数λ

dis

和λ

cyc

是控制生成图像的图像跨模态解缠损失和循 环一致性损失重要性的权重。通过优化上述损失,本发明的跨模态图 像生成网络可以将红外(或可见光)图像转换为可见光(或红外)图像, 并减少各模态之间的差异。双路径共享学习网络则能够提取到不同模 态图像的具有区分性的中层特征信息,提高模型的性能。

[0084]

步骤6:实验环境及评估标准。实验环境为ubuntu16.04版本的 操作系统,编程环境为pycharm,配备了2.50ghz e5-2678 v3 cpu和 显卡为16g的tesla t4 gpu的设备进行网络的训练。同时,使用 pytorch的深度学习框架进行网络的搭建,采用的数据集为跨模态行 人重识别领域常用的sysu-mm01和regdb数据集。遵循现有跨模 态行人重识别方法的标准评价协议,采用cmc曲线和map指标来 评价所提方法的性能。

[0085]

步骤7:模型实验评估。首先选用训练集对构建的网络模型进行 训练,对训练完成的模型提取查询集和图库集中行人图片的特征,通 过计算查询集中的行人的特征与图库集中的行人特征的余弦距离,判 断模型性能。在sysu-mm01数据集中,模型的rank-1达到45.47%, map值达到46.29%。在regdb数据集,模型的rank-1达到74.98%, map值达到68.85%。本方法在两种数据集上都有着优秀的表现,提 高了跨模态行人重识别的准确率以及鲁棒性。

[0086]

实施例二

[0087]

基于图像生成和共享学习网络的跨模态行人重识别方法,

[0088]

步骤1:跨模态图像生成网络的构建,结合图2所示,采用两种 不同深度的编码器来解缠红外图像和可见光图像,并获得它们的模态

[0089]

首先将真实的红外图像和可见光图像分别定义为 和其中h和w分别是图像的高和 宽。每一个红外与可见光真实图像分别对应一个真实标签y∈{1,2,...,n}, n是数据集中行人id的个数。对于每一个由外观编码器和模态编码 器解缠模态图像得到的外观特征和模态特征分别表示为f

aj

和f

mj

。

[0090][0091]

其中上标j=i,v,分别表示真实图像的模态属性。ea和em分别代表 外观编码器和模态编码器。随后,交换两种不同模态图像的外观特征, 生成伪红外与可见光图像,

[0092][0093]

其中gi和gv分别表示红外生成器与可见光生成器。

[0094]

在跨模态图像生成网络中,外观编码器采用以resnet-50为主干 的深度网络结构,为了保留更多的纹理信息,使用自适应最大池化层 代替原始的全局平均池化层和全连接层,之后将得到2048

×4×

1中 的行人外观特征,模态编码器是由四个卷积块、四个残差块和一个空 间金字塔池化层组成的浅层网络,并将输出128

×

64

×

32的模态特征, 生成器

和由四个卷积块和四个残差块处理外观特征和模态特征,辨别 器则遵循流行的多尺度patchgan有三个不同的输入尺度:64

×

32、 128

×

64和256

×

128。对于跨模态图像生成网络,采用随机梯度下降 法(sgd)对网络进行训练。

[0095]

步骤2:跨模态图像生成网络损失函数的设计,为保证生成的跨 模态图像具有真实性和多样性,设计多种损失函数进行模型的优化。 首先,跨模态生成侧重于不同模态的图像生成。在这个过程中,获得 两张不同模式的图像后,首先通过跨模态图像生成网络交换它们的模 态特征或外观特征,合成一对新图像。在此过程中,本发明对图像之 间引入了一种跨模态解缠损失。此损失使用l1范数在图像边缘获得 更好的生成性能。因此,跨模态解缠损失公式如下:

[0096][0097]

其中分别是可见光和红外图像的模态特征和外观特征。 并且,由于生成的伪跨模态图像不存在真实值监督,但具有与原始图 像相同的身份,引入循环一致性损失,通过交换从生成的伪红外和可 见光图像中再次分离出来的模态特征和外观特征,重构出两幅原始图 像,循环一致性损失公式可以表示为:

[0098][0099]

其中分别为生成的伪红外图像和可见光图像的模态特 征和外观特征。跨模态图像生成网络的目标是生成成对的跨模态行人 图像,但为了进一步正则化生成器,提高生成样本的质量,在同一模 态下引入了一个重构损失。重构损失可以表示为:

[0100][0101]

图像生成任务最重要的目标是在跨模态行人重识别领域生成真实 的图像,只有真实的图像才能实现数据的增强,减少不同模态之间的 差异。因此,引入对抗性损失来监督图像生成过程。具体来说,在对 抗性训练中分别使用了红外和可见光两种辨别器。生成器试图使用生 成的假图像来欺骗辨别器,而辨别器则试图区分正确和错误的结果。 生成器和辨别器在互相博弈中不断优化网络,对抗性损失如下:

[0102]

l

adv

=e[logdi(xi) log(1-di(xi′

))] e[logdv(xv) log(1-dv(xv′

))]

ꢀꢀ

(6)

[0103]

其中di和dv分别对应于红外模态和可见光模态的辨别器。

[0104]

步骤3:双路径共享学习网络的构建。如图3所示,将跨模态图 像生成网络生成的红外(可见)伪图像与真实红外(可见)图像组合成一 对输入图像,在线输入到双路径共享学习网络进行训练。由于 resnet-50在防止梯度消失和获得区分性特征方面的有效性,其在计 算机视觉领域得到了广泛的应用,因此采用在imagenet上预训练的 resnet-50作为主干网络。resnet-50包括5个卷积块:conv1、conv2_x、 conv3_x、conv4_x和conv5_x。通过共享较低层次的卷积块以获得更 多的判别信息。在参数共享模块的阶段1,使用conv1、conv2_x和 conv3_x作为两个参数独立的分支,提取红外和可见光图像对应的特 定模态信息。在阶段2,利用conv4_x和conv5_x作为参数共享网络, 获取具有区分性的中层通道共享信息,并且去掉了主干网络原有的全 连接层,增加了一个全局平均池化层和512-dim全连接层来提取特征。

[0105]

采用在imagenet上预先训练过的resnet-50作为主干网络,并 将最后卷积块的步长从2改变为1。在训练阶段,红外图像与可见图 像均统一调整为256

×

128

×

3。超参数λ

dis

和λ

cyc

分别设为0.5和10。 对于双路径共享学习网络,采用adam优化器进行训练。

[0106]

步骤4:共享学习损失函数的设计。给定一组训练图像,利用kl 发散损失最小化各特征分布之间的距离,以改善具有相同身份的跨模 态图像的相似度分布。kl散度损失为:

[0107]

l

kl

=e[d

kl

(fi||fi′

)] e[d

kl

(fv||fv′

)]

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(7)

[0108]

其中,并且特征向量f∈f来自双路径共享模 块512-dim全连接层的输出。f的上标代表网络的两个分支,下标代 表跨模态图像生成网络生成的伪图像。为了减小模态间的差异,将交 叉熵损失和相似度学习的三重熵损失作为共享学习网络的目标函数。 三元组损失可以表述为:

[0109][0110]

其中fa表示为表示锚点,f

p

和fn分别表示与fa相同的正样本和与fa不同的负样本。d(

·

,

·

)计算欧氏距离,m为边界参数。[x]

=max(x,0)将负 数截断为零,同时保持正数不变。

[0111]

使用交叉熵损失进行身份学习,通过双路径共享网络的最后一个 全连接层,可以得到训练图像yi对应的预测值yj′

。交叉熵损失如下所 示:

[0112]

l

ce

=e[-log(p(yj′

|yj))]

ꢀꢀ

(9)

[0113]

其中p(yj′

|yj)是输入样本属于真实类的预测概率。

[0114]

步骤5:损失函数的联合优化。本发明将跨模态图像生成网络和 双路径共享学习网络进行联合训练,以端到端的方式优化总目标。总 体损失函数可以表示为:

[0115][0116]

其中超参数λ

dis

和λ

cyc

是控制生成图像的图像跨模态解缠损失和循 环一致性损失重要性的权重。通过优化上述损失,本发明的跨模态图 像生成网络可以将红外(或可见光)图像转换为可见光(或红外)图像, 并减少各模态之间的差异。双路径共享学习网络则能够提取到不同模 态图像的具有区分性的中层特征信息,提高模型的性能。

[0117]

步骤6:实验环境及评估标准。实验环境为ubuntu16.04版本的 操作系统,编程环境为pycharm,配备了2.50ghz e5-2678 v3 cpu和 显卡为16g的tesla t4 gpu的设备进行网络的训练。同时,使用 pytorch的深度学习框架进行网络的搭建,采用的数据集为跨模态行 人重识别领域常用的sysu-mm01和regdb数据集。遵循现有跨模 态行人重识别方法的标准评价协议,采用cmc曲线和map指标来 评价所提方法的性能。

[0118]

步骤7:模型实验评估。首先选用训练集对构建的网络模型进行 训练,对训练完成的模型提取查询集和图库集中行人图片的特征,通 过计算查询集中的行人的特征与图库集中的行人特征的余弦距离,判 断模型性能。在sysu-mm01数据集中,模型的rank-1达到45.47%, map值达到46.29%。在regdb数据集,模型的rank-1达到74.98%,map值达到68.85%。本方法在两种数据集上都有着优秀的表现,提 高了跨模态行人重识别的准确率以及鲁棒性。

[0119]

通过上述技术方案得到的装置是基于图像生成和共享学习 网络的跨模态行人重识别方法,首先,提出了一个跨模态生成和 共享学习联合框架,该框架主要由一个跨模态图像生成网络和一个双 路径共享学习网络组成,跨模态图像生成网络可以通过分解行人的模 态特征和外观特征,生成多样的跨模态图像,在保持特定身份一致性 的同时实现模态级别对齐,在双路径共享学习网络中,采用参数共享 模块去获取更具区分性的行人特征信息,实现特征级别对齐。将两个 子网络级联并以端到端方式进行优化,从而使网络提取到更加具有区 分性的行人特征,有效的提升了跨模态行人重识别的性能。

[0120]

以上所述仅为本发明的优选实施方式而已,并不用于限制 本发明,对于本领域的技术人员来说,本发明可以有各种更改 和变化;凡在本发明的精神和原则之内,所作的任何修改、等 同替换、改进等,均应包含在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。