1.各种示例一般来说关于微加工装置的自动操作控制。更具体地,各种示例关于使用机器学习算法的自动操作控制。

背景技术:

2.微加工装置促进了与微观或次微观样品(例如半导体装置、晶片、生物样品、微光学件等)的相互作用。举例来说,相互作用可包含样品的微观成像。微加工装置可依靠的成像模式的示例包含扫描电子显微镜(sem)、原子力显微镜(afm)、x射线成像、聚焦离子束(fib)成像等。相互作用也可包含样品的微观操作。示例包含fib铣削、使用光刻工具的抗蚀剂曝光、隧道电子显微镜(tem)薄层的制备、材料沉积等。

3.这种微加工装置的操作参数通常具有很大空间的可用设定。换句话说:选择操作参数的合适设定的自由度很大。此外,通常会观察到参数漂移,因此设定需要在一段时间内进行调整。

4.这通常使微加工装置的操作成为复杂且易于出错的任务。举例来说,在操作微加工装置时,可能需要熟练的人员来执行复杂的工作流程。

5.因此,已经发现,微加工装置的操作具有各种限制和缺点。举例来说,对熟练人员的需求将限制微加工装置的可用性为某些特定任务。由于产量的限制,广泛使用(例如在晶片制造中)通常是不可能的。此外,由于操作参数设定的控制的复杂性,操作控制易于出错。有时,甚至可能由于人为错误(例如由于微操纵工具与光学件的碰撞等)而导致样品或微加工装置的损坏。

技术实现要素:

6.因此,需要控制微加工装置的操作的先进技术。特别地,需要克服或减轻至少一些上述限制和缺点的技术。

7.独立权利要求的特征满足了这种需求。从属权利要求的特征定义了实施例。

8.一种控制微加工装置的操作的方法包含获得图像的时间序列。图像是在使用微加工装置的操作参数的一个或多个第一设定时所获取的。方法也包含将图像的时间序列的每一图像提供给一个或多个第一算法,并从一个或多个第一算法获得图像中所包含的预定义特征的一个或多个特性的时间序列。方法更包含将一个或多个特性的时间序列提供给第二算法,并从第二算法获得对微加工装置的操作参数的第二设定的预测。方法更包含根据操作参数的第二设定来控制微加工装置的操作。

9.计算机程序或计算机程序产品或计算机可读储存介质包含程序代码。程序代码可由至少一个处理器加载和执行。在执行程序代码时,至少一个处理器执行控制微加工装置的操作的方法。方法包含获得图像的时间序列。图像是在使用微加工装置的操作参数的一个或多个第一设定时所获取的。方法也包含将图像的时间序列的每一图像提供给一个或多个第一算法,并从一个或多个第一算法获得图像中所包含的预定义特征的一个或多个特性

的时间序列。方法更包含将一个或多个特性的时间序列提供给第二算法,并从第二算法获得对微加工装置的操作参数的第二设定的预测。方法更包含根据操作参数的第二设定来控制微加工装置的操作。

10.微加工装置包含控制电路。控制电路配置为获得图像的时间序列,图像是在使用微加工装置的操作参数的一个或多个第一设定时所获取的。控制电路进一步配置为将图像的时间序列的每一图像提供给一个或多个第一算法,并从一个或多个第一算法获得图像中所包含的预定义特征的一个或多个特性的时间序列。控制电路进一步配置为将一个或多个特性的时间序列提供给第二算法,并从第二算法获得对微加工装置的操作参数的第二设定的预测。控制电路进一步配置为根据操作参数的第二设定来控制微加工装置的操作。

11.一种控制微加工装置的操作的方法包含使用依顺序耦合的第一机器学习算法和第二机器学习算法。第一机器学习算法基于与工作流程相关联的图像中的特征识别来决定预定义工作流程中的进度。第二机器学习算法根据预定义工作流程中的进度来预测微加工装置的操作参数的设定。

12.计算机程序或计算机程序产品或计算机可读储存介质包含程序代码。程序代码可由至少一个处理器加载和执行。在执行程序代码时,至少一个处理器执行控制微加工装置的操作的方法。方法包含使用依顺序耦合的第一机器学习算法和第二机器学习算法。第一机器学习算法基于与工作流程相关联的图像中的特征识别来决定预定义工作流程中的进度。第二机器学习算法根据预定义工作流程中的进度来预测微加工装置的操作参数的设定。

13.微加工装置包含控制电路,该控制电路配置为使用依顺序耦合的第一机器学习算法和第二机器学习算法。第一机器学习算法基于与工作流程相关联的图像中的特征识别来决定预定义工作流程中的进度。第二机器学习算法根据预定义工作流程中的进度来预测微加工装置的操作参数的设定。

14.应当理解,在不脱离本发明范围的情况下,上述特征以及在下文中将要说明的特征不仅可用于所示的各个组合中,而且也可用于其他组合或单独地使用。

附图说明

15.图1示意性地显示了根据各种示例的微加工装置;

16.图2示意性地显示了根据各种示例的使用两个依顺序配置的算法在微加工装置上实施的工作流程的自动化;

17.图3示意性地显示了在使用示例性微加工装置所获得并通过根据各种示例的算法进行分析的图像中所包含的三聚体-小光束特征;

18.图4示意性地显示了根据各种示例的使用两个依顺序配置的算法在微加工装置上实施的工作流程的自动化;

19.图5示意性地显示了根据各种示例的使用两个依顺序配置的算法在微加工装置上实施的工作流程的自动化;

20.图6为根据各种示例的方法的流程图;以及

21.图7示意性地显示了根据各种示例的通过算法对操作参数的设定的预测。

具体实施方式

22.本发明的一些示例一般提供多个电路或其他电子装置。对电路和其他电子装置以及它们各自提供的功能的所有参照并不旨在限于仅包含本文所显示和所描述的内容。尽管可将特定的标签分配给所揭露的各种电路或其他电子装置,但这样的标签并不旨在限制电路和其他电子装置的操作范围。这类电路和其他电子装置可基于期望的特定类型的电子实现方式而以任何方式彼此组合和/或分离。应认识到,本文所揭露的任何电路或其他电子装置可包含任何数量的微控制器、图形处理器单元(gpu)、集成电路、存储器装置(例如,快闪存储器、随机存取存储器(ram)、只读存储器(rom)、电子可编程只读存储器(eprom)、电子可抹除可编程只读存储器(eeprom)、或其合适的其他变型)、以及相互协作以执行本文所揭露的操作的软件。另外,任何一个或多个电子装置可配置为执行体现于非暂时性计算机可读介质中的程序代码,其程序化以执行所揭露的任何数量的功能。

23.在下文中,将参考所附图式来详细描述本发明的实施例。应理解到,以下对实施例的描述不应视为限制性的。本发明的范围并不意图受限于下文所描述的实施例或附图,其仅为示例性的。

24.附图应被认为是示意性表示,并且附图中所示的元件不必按比例绘示。相反地,各种元件被表示使得它们的功能和一般目的对于本领域技术人员而言是显而易见的。附图中所示或本文所描述的功能块、装置、部件、或其他物理或功能单元之间的任何连接或耦合也可通过间接连接或耦合来实现。部件之间的耦合也可通过无线连接来建立。功能块可使用硬件、固件、软件、或其组合来实现。

25.在下文中,将描述控制微加工装置的操作的技术。这些技术可用于各种使用情况,以及用于各式各样类型的微加工装置。举例来说,技术可用于控制微加工装置的显微镜成像模块的操作。替代地或附加地,技术可用于控制微加工装置的微操纵模块的操作。微加工装置的示例性显微成像模块包含但不限于:sem;fib显微镜;x射线显微镜;afm;光场显微镜;激光扫描显微镜;超分辨率显微镜(例如使用发光);在明场或暗场中的光学显微镜等。微加工装置的微操纵模块的示例包含但不限于:fib铣削;电子或光子曝光;微操纵器(例如电接触)等等。

26.通常,本文使用的术语“微”表示在微米或更小的空间长度尺度(例如,纳米)上的特性。

27.在下文中,将描述有助于自动控制微加工装置的操作的技术。更具体地,有可能使与微加工装置的操作相关联的工作流程自动化。工作流程可由多个步骤来特征化。工作流程可例如根据某些预定义的要求来提供样品的成像和/或操纵。更一般地,工作流程可为成像和/或操纵做准备。因此,可控制操作,使得有可能对样品进行后续的成像和/或操纵。举例来说,工作流程可定义与相应控制操作相关的步骤序列,其依序地调整微加工装置的操作参数的设定,例如以实现某个目标,例如某些成像模式或微操纵任务。

28.根据实施方式,可能有更大或更小的自动化程度。举例来说,根据一些示例,在与操作控制相关联的工作流程中可能依赖使用者输出和/或使用者输入(使用者互动)。因此,可促进持续的使用者引导。在其他示例中,工作流程可完全地自动化。

29.通常,取决于微加工装置的种类和类型,并进一步取决于工作流程的种类和类型,受自动操作控制的操作参数和适当设定可有很大的不同。设定可指定操作参数所采用的实

际值。举例来说,对于基于颗粒的成像技术(例如sem或fib成像),操作参数可为加速或提取电压、样品或样品台上的压力、颗粒通量、光学件、聚焦、孔径、停留时间、源距离、样品台的倾斜和位置,仅举几例。举例来说,对于使用微操纵器的操纵技术,微操纵器的方向和位置、驱动路径等将是操作参数的示例。

30.本文描述的各种技术依赖于计算机实现的逻辑,用于微加工装置的操作控制的自动化。特别地,根据各种示例,可使用一或多种算法,以由计算机执行与操作控制相关联的一个或多个任务。在一些示例中,一或多种算法中的至少一些可依赖于机器学习的技术。在这方面,算法可非预先定义的,而是可基于训练数据在训练阶段中进行配置。可检测模式,并可依赖于在训练阶段过程中获得的知识的推断。在此,基于使用者输入,可实施(半)监督学习,其配置了机器学习算法。这与事先配置且未基于数据进行训练的非机器学习算法不同。

31.根据示例,采用两步法。在此,第一算法和第二算法依序配置。即,第一算法的输出形成第二算法的输入。第一算法和/或第二算法可能包含机器学习核心,即机器学习算法。

32.第一算法和第二算法可执行不同的任务。特别地,第一算法有可能决定与微加工装置相关的图像中的预定义特征的特性。

33.预定义特征可与用于微加工装置的操作的工作流程相关联。预定义特征的特定外观可与工作流程中的进度相关联。由第一算法决定的特性可指示预定义特征的外观。举例来说,预定义特征可与工作流程的完成程度相关联。举例来说,如果微加工装置的操作的工作流程已成功完成,则取决于实现方式,预定义特征可在图像中清晰可见或可不存在于图像中。举一个例子:预定义特征可通过图像中绘示的半导体结构的对准标记来实现。操作的工作流程可与聚焦和对准sem成像模块相关联。如果对准标记在sem成像模块所获取的图像中聚焦,则对准已成功完成。因此,有可能借助于第一算法将清晰度因子或对比度决定为对准标记特征的特性。清晰度因子(或通常是任何其他特性)可在最小值和最大值之间逐渐变化。

34.然后,有可能提供第一算法的输出,即预定义特征的优先性,作为第二算法的输入。然后,第二算法可预测微加工装置的一个或多个操作参数的未来设定。换句话说,预测可关于尚未实现但将来可实现以达成某个目标的设定。特别地,可应用由第二算法所预测的未来设定,以实现与工作流程相关的目标,针对该工作流程以自动化方式控制微加工装置的操作。

35.因此,有可能接着根据未来的控制参数设定来控制微加工装置的操作。

36.详细地,第二算法有可能基于预定义特征的特性的时间序列来进行操作,以做出预测。在这方面,可能针对在不同时间点的多个图像,多次执行第一算法。由此,获得预定义特征的特性的时间序列,且可提供状态的时间序列作为第二算法的输入,以进行预测。基于这样的时间序列,可做出预测。

37.第二算法的机器学习核心的示例实施方式基于循环神经网络(rnn)。这样的rnn可在时间序列上运行作为输入。另一示例实施方式将包含多层感知器(mlp)或另一个前馈人工神经网络。

38.通过使用包含依序排列的第一算法和第二算法的这类两步法,可以实现对微加工装置的控制参数的未来设定的精确预测。特别地,有可能首先使用第一算法分析预定义特

征的一个或多个特性,该特征与旨在被自动化的工作流相关联。接着,基于此预评估,可使用第二算法来预测适当的设定以取得工作流程中的进展。

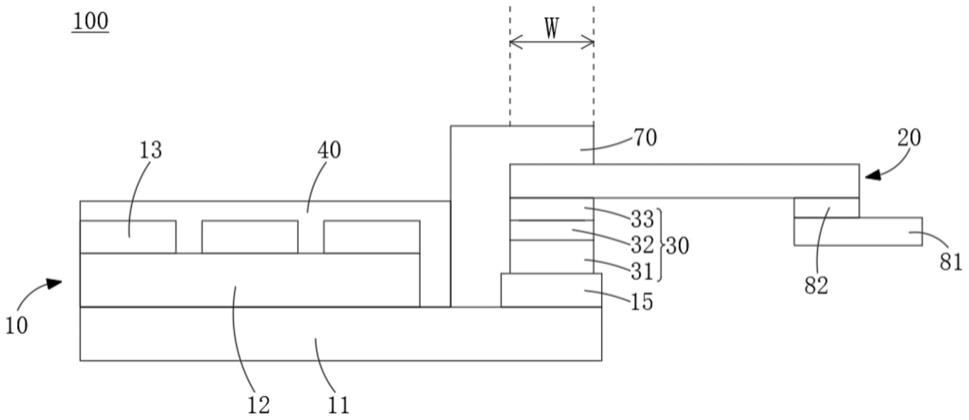

39.图1示意性地显示了根据各种示例的微加工装置90。微加工装置90包含成像模块95和微操纵模块96。在本文所述的各种示例中,微加工装置90有可能包含成像模块95或微操纵模块96、或两者。

40.可将样品99加载到微加工装置90中,以促进微加工装置90和样品99之间的相互作用。

41.显微成像模块95配置为通过获取其显微图像而与样品99相互作用。

42.微操纵模块96配置为通过操纵其结构而与样品99相互作用。举例来说,可移除样品99的材料,或可将材料沉积在样品99的表面上。材料可植入样品99中。在空间上解析地实现操纵的情况下可使用光刻。

43.微加工装置90还包含处理器91,其与存储器92耦合。处理器91和存储器92形成控制电路。举例来说,处理器91可从存储器92载入程序代码并执行程序代码。执行程序代码可使处理器91执行以下一或多项:执行与微加工装置90(特别是成像模块95和/或微操纵模块96)的操作控制相关的一或多种算法;例如基于从人机界面(hmi)93接收的使用者输入来执行一个或多个机器学习算法的训练;例如基于一或多种算法的输出来控制微加工装置90(特别是成像模块95和/或微操纵模块96)的操作。

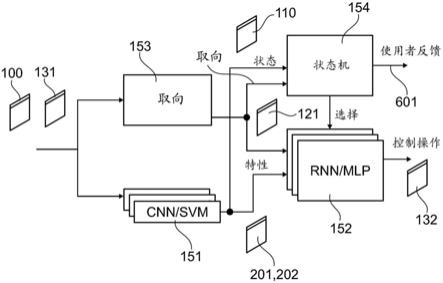

44.图2为功能流程图。图2显示了与微加工装置90的操作控制有关的方面。

45.最初,获得图像101-104的时间序列100。图像101-104可描绘样品或可不描绘样品。在一示例中,图像101-104可通过微加工装置90的成像模块95来获取。替代地或补充地,图像101-104可通过另一种成像模态来获取。对于跨模态工具而言,使用第一模态获取图像101-104并描绘第二模态是可能的。举例来说,图像101-104可使用sem来获取,并可描绘微操纵器。

46.在1901,将图像101-104的时间序列100作为输入提供给算法151。在图2的示例中,算法151实现为卷积神经网络(cnn)或支持向量机(svm);更一般地,算法151可使用机器学习核心来实现。为了简单起见,在下文中,假设算法151实施为svm,但可设想其他情况。

47.接着,在1902处执行算法151。在1903,svm 151输出图像101-104中所包含的预定义特征的一个或多个特性。可训练svm 151以决定预定义特征的一个或多个特性。

48.更具体地说,svm 151可输出预定义特征的一个或多个特性的时间序列/时序(time series/temporal sequence)。举例来说,可对时间序列100的每一图像101-104执行一次svm 151。对于在1902的svm 151的每次执行,可输出在相应图像101-104中的预定义特征的相应一个或多个特性。

49.接着,将此时间序列输入至在1904执行的算法152。在图2的示例中,算法152实施为rnn或mlp。为了简单起见,在下文中将参照算法152为mlp的实施方式,但其他的实施方式也是可能的。

50.接着,mlp 152预测微加工装置90的一个或多个操作参数的未来设定132;这些在1905处被输出,并有可能根据此设定132来控制微加工装置90的操作。

51.图2的示例有助于微加工装置90的精确自动化控制,例如以实现与预定义特征相关联的特定工作流程。特别地,mlp 152可预测未来设定132,使得在根据未来设定132控制

微加工装置90的操作时,预定义特征的一个或多个特性根据工作流程的设定/目标特性来作用。这将结合图3使用一具体的示例用例来作进一步的详细解释。

52.图3显示了图像101-104的时间序列100。使用气体场离子源(gfis)作为成像模块95来获取图像101-104。在图3的示例中,gfis可实现三原子锐利尖端以形成所谓的三聚体。

53.在图3中,对特征210进行预定义,其对应于三聚体小光束。如图3所示,图像101不包含三聚体小光束特征210;图像102-104包含三聚体小光束特征210。这可能是由于更改了成像模块95的操作参数的设定131。

54.在不加载样品99的情况下,可在图像中描绘三聚体小光束特征210。

55.三聚体小光束特征210在每一个图像102-104中具有不同的特性201-202。第一特性201与图像102-104内的三聚体枪的顶点位置有关。第二特性202与图像102-104中的三聚体原子的对比度水平有关。表格1表示这些特性。

[0056][0057]

表1:三聚体小光束(trimer beamlet)特征210的特性(参见图3)

[0058]

注意,表格1所示的预定义特征的特性仅为示例。其他特性也是可能的。举例来说,可结合三聚体小光束特征210进行定义的另一特性可与三聚体小光束特征210的几何结构有关,例如,指定相邻小光束之间的角度、小光束的紧密堆积的程度、三聚体小光束特征的能谱密度、强度水平等,仅举几个例子。

[0059]

算法151可决定这些特性并将其输出。

[0060]

将认识到,除了三聚体小光束特征210的外观所固有的这种定量特性201-202外,三聚体小光束特征210在图像101-104中也采取不同状态。表格2中列出了示例状态。

[0061][0062]

表格2:三聚体小光束特征210的特性(参见图3)

[0063]

在此示例中,可决定与三聚体的健康状况相对应的状态。举例来说,根本没有检测到三聚体,这可能是三聚体枪与gfis成像模块95的孔径未对准。举例来说,如果检测到三聚体枪的顶点,但太多原子是可见的,则顶点可能不健康,例如,因为它没有形成分面的三原

子尖端(faceted three-atom tip)。

[0064]

应当理解,状态可对应于将图像中预定义特征的外观分类为预定义类别。

[0065]

健康状况是有可能决定的。健康状态可对应于预定义特征的可见性或预定义特征的前驱物的可见性(在此:图像102中的多原子小光束)。

[0066]

图3也显示了关于与微加工装置90的操作相关联的工作流程3000的方面。在图3的示例场景中,使用本文所描述的技术而自动化的工作流程3000对应于用于成像的三聚体的形成和对准。三聚体形成和对准的健康状态由三聚体小光束特征210表示。

[0067]

工作流程3000可包含以下步骤。在步骤3001,对保持样品99的样品室减压。接着,在步骤3002,将原子尖端的加速电压接通,例如最初到相当低的值。接着,观察对应图像101的第一光。

[0068]

随着工作流程3000的进行,可在步骤3003执行孔径的场光阑对准。此外,在步骤3004可选择光学件。举例来说,可执行聚焦。接着,在图像102中,原子尖端变得可见。然而,三聚体尚未下降。

[0069]

因此,工作流程3000继续进行,且在步骤3005,执行原子尖端的原子的场蒸发,从而形成顶点的三原子尖端。接着在步骤3006,有可能提高加速电压。因此,在图像102中,三聚体小光束特征210出现且为可见的。

[0070]

随着工作流程3000的进一步进行,在步骤3007,执行精细对准,这进一步增加了图像104中三聚体小光束特征210的对比度。

[0071]

因此,从前文可理解到,三聚体小光束特征210与工作流程3000中的进度相关联。

[0072]

另外,参见hlawacek,gregor等人在journal of vacuum science&technology b,nanotechnology and microelectronics:materials,processing,measurement,and phenomena 32.2(2014):020801中提出的“氦离子显微镜(helium ion microscopy)”。

[0073]

已发现有时决定预定义特征的状态可能是有帮助的。将结合图4对此进行解释。

[0074]

图4为功能流程图。图4显示了与微加工装置90的操作控制有关的方面。图4的示例为图2示例的扩展。

[0075]

第一扩展关于提供用于获取图像101-104的时间序列100(参见图3)的一个或多个第一设定131作为算法151的输入。由此,算法151可更准确地决定预定义特征210的特性201-202。有可能达成更精确和更快的训练。

[0076]

第二扩展关于使用多个算法151。特别地,如图4所示,有可能使用多个算法151来首先决定特性201-202,接着决定状态110。举例来说,算法151中的第一个可决定特性201-202,而算法151中的第二个可决定状态110。由此,多个算法151中的每一个的训练数据集可更小。这有助于训练。

[0077]

在图4的示例中,预定义特征的状态110用于从多个候选算法中选择算法152。这是通过将状态110馈入至状态机154来实现的,其接着执行选择;对于此选择,其他实施方式也是可能的。

[0078]

举例来说,对于不同的状态110(参见表格1),可选择不同的算法152来决定预测设定132。这种实现方式具有的优点是,每个个别算法152需要处理的参数空间相当地有限,特别是与没有发生取决于状态110的选择的情况相比。由此,促进了算法152的训练。此外,使用算法152的操作趋于更加准确。

[0079]

如图4所示,有可能向使用者提供关于主动状态110的反馈601。举例来说,如果预定义特征处于不健康状态,则可发出警告。举例来说,如果预定义特征处于不健康状态,则可请求(重新)校准。可将使用者反馈601提供给hmi 93(参见图1)。

[0080]

一般来说,也有可能使用状态110来控制微加工装置90的操作。如图4所示,状态110也可输入到所选的mlp 152。选择性地,也可根据状态机154的输出来控制微加工装置90的操作(图4中未示出)。

[0081]

与图2的实行方式相比,图4的实行方式的第三扩展涉及使用第三算法153。算法153与算法151并行耦合。算法153可不需要机器学习核心。而是,可使用传统的先验定义算法核心。算法153配置为决定在时间序列100的图像101-104的其中至少一些中的预定义特征210的取向121和/或位置。举例来说,算法153可采用特征点检测。

[0082]

举例来说,参考图3的示例,算法153有可能检测三聚物小光束特征210的取向,例如,在x-y坐标系统中的旋转角度。

[0083]

然后,将预定义特征的取向121和/或定位提供给算法152中所选的一个作为输入。选择性地,也有可能将预定义特征的取向121和/或定位提供给状态机154作为输入,使得也可根据此输入来从候选算法中选择算法152。

[0084]

图5是功能流程图。图5显示了与微加工装置90的操作控制有关的方面。

[0085]

在2001,将图像101-104的时间序列100提供给一个或多个算法151作为相应的输入。

[0086]

在2002,将图像101-104的时间序列100提供给算法153作为相应的输入。

[0087]

在2003及2004,将在获取图像101-104时处于活动状态的微加工装置90的一个或多个控制参数的设定131分别提供给一个或多个算法151和算法153作为输入。这通常是选择性的。

[0088]

在2004,执行一个或多个算法151。云端计算是可能的。卸载到服务器是可能的。

[0089]

在2005,执行算法153。云端计算是可能的。卸载到服务器是可能的。

[0090]

在2006,与预定义特征的特性201-202有关的一个或多个算法151的输出被提供给算法152。更特别地,如图5所示,存在特性201-202的时间序列209(例如,对应于表格1的列)。这是因为时间序列100的图像101-104中的每一个被个别地提供给一个或多个算法151,且在2004触发一个或多个算法151的相应执行。因此,对于时间序列100的图像101-104中的每一个,决定至少一个预定义特征210的相应特性201-202,从而产生时间序列209。

[0091]

在2007,将状态110提供给状态机154,其在2009处从多个候选算法中选择适当的算法152。这一般为选择性的。在2008,状态机154也获得取向121作为输入;这也是选择性的。

[0092]

在2010,算法153将取向121的时间序列120提供给算法152。同样地,对于时间序列100的图像101-104中的每一图像,算法153可能会执行多次。由此,多次决定取向121,图像101-104中的每个图像一次,从而产生时间序列120。

[0093]

在2011,执行算法152。可使用云端计算。执行可卸载到服务器。接着,在2012,预测设定132用于控制微加工装置90的操作。

[0094]

图5也显示了关于算法151-152的训练的方面,即学习阶段。

[0095]

一般来说,学习阶段可整合到执行阶段。即,可在自动化实时工作流程时执行训

练。在其他示例中,训练阶段和执行阶段可以分开。

[0096]

举例来说,基于控制算法151-152的操作的控制位元,可在(i)执行阶段和(ii)训练阶段之间进行区分。举例来说,如果控制位元被设定,则训练阶段可被激活。可例如使用误差后向传播来实现训练模式。

[0097]

可基于使用者输入来激活训练模式。举例来说,使用者可手动地切换到训练模式。或者,有可能在进行自动化工作流程时,检测与hmi 93所提供的使用者界面的任何使用者互动,然后在检测到使用者互动时切换到训练模式。

[0098]

首先,讨论一个或多个算法151的训练。在2021,例如从hmi 93(参见图1)接收使用者输入602。使用者输入602关于预定义特征的特性201-202。举例来说,使用者输入602可手动地指定在一个或多个图像101-104中的预定义特征的特性。接着,在2021,可将反馈171提供给一个或多个算法151作为训练输入。反馈171可基于预定义特征的使用者输入602与一个或多个算法151的输出之间的比较。在另一示例中,反馈171可简单地对应于使用者输入602。基于反馈171,可执行一个或多个算法151的训练。根据一个或多个算法151的特定实现,可使用本领域中已知的用于训练一个或多个算法151的机器学习核心的不同训练技术。

[0099]

将会认识到,通过接收使用者输入602并使用使用者输入602进行训练,可训练算法151以决定人类可理解的特性,例如,结合图3针对顶点定位特性201和对比度特性202所作的讨论。这可促进在自动化工作流程中的连续使用者导引。使用者可理解一个或多个算法151的输出并对之做出反应。

[0100]

训练可在工作流程期间进行。特别地,有可能在执行工作流程时,使用者根据算法151-153来监视自动化处理并与之互动。然后,有可能进行线上训练。

[0101]

以与前文已结合特性201-202进行解释的一个或多个算法151的训练类似的方式,也可能针对状态110对一个或多个算法151进行训练。使用者可手动地指定状态110,且训练可基于此。

[0102]

接下来,将解释算法152的训练。在此处,在2023,例如从hmi 93接收使用者输入603。使用者输入603可关于用以控制微加工装置90的操作的另一设定133。接着,在2024,有可能执行算法152所预测的设定132和使用者所提供的设定133之间的比较,并决定提供给算法152作为训练输入的相应反馈172。接着,算法152的机器学习核心的训练可基于反馈172(即,设定132和133之间的比较)。

[0103]

训练算法151-152的另一选择(其可代替地或补充地应用于基于反馈171-172的训练)为对算法151-152的组合序列进行端到端训练。特别地,有可能在2025提供反馈172,其为对一个或多个算法151的训练输入。

[0104]

端到端训练的优点在于,一个或多个算法151的输出不限于人类可理解的状态特性。相反地,可识别在精确的操作控制中特别有利的状态特性。

[0105]

图6是根据各种示例的方法的流程图。图6的方法可由控制电路执行。举例来说,当从存储器92(参见图1)载入程序代码时,图6的方法可由处理器91执行。在图6中用虚线表示选择性框。

[0106]

在框1001,获得图像的时间序列。使用适当的成像模态来捕获图像的时间序列。图像的时间序列可为或可不为显微样品。显微样品被放置在微加工装置中,例如前文所述的微加工装置90中。在激活微加工装置的操作参数的一个或多个第一设定时,获取图像的时

间序列。

[0107]

在框1002,选择在框1001获得的图像的时间序列的当前图像。

[0108]

在框1003,将当前图像提供作为一个或多个第一算法(例如,一个或多个算法151)的输入。由此,有可能获得在当前图像中所描绘的至少一个预定义特征的特性和/或状态。因此,框1003对应于图5的示例实施方式的2001和2004。

[0109]

在选择性框1004处,提供当前图像作为第三算法(例如,算法153)的输入。接着,第三算法决定在当前图像中所描绘的预定义特征的取向和/或定位。举例来说,可相对于与当前图像相关联的参考坐标系统来决定预定义特征的取向和/或定位。因此,框1004对应于图5的示例实施方式的2002和2005。

[0110]

在框1005,检查是否存在时间序列的另一图像。若是,则使用另一图像作为当前图像来重新执行框1002-1004。

[0111]

否则,方法从选择性框1006开始。在框1006,检查由第一算法1003输出的状态是否在预定义的设定/目标范围内。因此,通过框1006,有可能监视预定义特征的状态。举例来说,如果预定义特征的状态对应于健康状态,则可检测预定义特征的健康的劣化。这种劣化可能是由于操作参数的时间漂移造成的。

[0112]

如果状态是可接受的,则可能无需采取措施;特别地,可能不需要调整微加工装置的操作参数的设定。因此,方法从重新执行框1001开始。否则,方法从选择性框1007开始。

[0113]

在选择性框1007,从多个候选算法中选择第二算法。举例来说,选择可基于框1003的输出和/或框1004的输出。更具体地,选择有可能基于在框1003从一个或多个第一算法所获得的状态。选择也可基于在框1004从第三算法所获得的取向和/或定位。因此,框1007对应于图5的2007-2009。

[0114]

在其他示例中,第二算法可为固定的和预定义的。

[0115]

接着,方法从框1008开始。在框1008处,提供从框1003(以及,选择性地从框1004)获得的特性(以及,选择性地,状态、取向和/或定位)的时间序列给第二算法作为输入。第二算法输出对微加工装置的操作参数的未来设定的预测。此预测显示于图7。如图7所示,在时间间隔801期间,当设定131处于活动状态时,获取时间序列100的图像101-104。接着,在时间点802,执行算法152(对应于图5中的2011)。算法152在将来的时间点803对设定132做出预测。接着,可应用设定132。

[0116]

再次参考图6。在框1009,可接着使用在框1008所预测的设定来控制微加工装置的操作。

[0117]

在选择性框1010,可接收使用者输入。使用者输入可用以改善或调整由第一算法在框1003所提供的特性和/或状态。选择性地,在框1011,使用者输入也可用于训练。参见图5:2022。

[0118]

在选择性框1012,可接收进一步的使用者输入。使用者输入可用于改善或调整由第二算法在框1008所提供的预测设定。选择性地,在框1013,使用者输入可用于训练,例如端到端训练。参见图5:2024和2025。

[0119]

尽管已经关于某些较佳实施例显示和描述了本发明,但是本技术领域技术人员在阅读和理解说明书之后将可进行等同和修改。本发明包含所有这类等同和修改,并仅由所附权利要求的范围所限制。

[0120]

总而言之,前文已经描述了有助于自动控制微加工装置的操作的技术。技术使用具有机器学习核心的第一算法和具有机器学习核心的第二算法,第一算法和第二算法系依顺序耦合。第一机器学习算法决定沿预定义工作流程的进度。这可基于在沿工作流程进行时所捕获的图像中对与工作流程相关联的预定义特征的特性和/或状态的特征识别。第二机器学习算法获得第一机器学习算法的输出作为输入。接着,第二机器学习算法根据预定义工作流程中的进度,预测微加工装置的操作参数设定。通过实施预测的设定,可取得预定义工作流程中的进一步进展。

[0121]

为了进行说明,前文已描述了各种示例,其中与gfis成像模块的三聚体的形成相关的工作流程是自动化的。然而,类似的示例也可应用于其他种类和类型的微加工装置以及其他种类和类型的工作流程。举例来说,有可能自动化与x射线成像模块的对准相关联的工作流程。在另一示例中,有可能将与电和/或光学晶片探测相关联的工作流程自动化。在此处,载物台位置和多个探针的探针位置必须对齐。视场、探针高度、成像参数、电探针参数等是需适当设定的一些其他操作参数的示例。并非确定性地决定所有这样的参数,而是根据示例,有可能使用机器学习算法来实现本文描述的技术以使工作流程自动化。这提供了一种灵活、稳健且通用的方法来实施晶片探测。

[0122]

为了进一步说明,前文已描述了各种示例,其中提供操作参数的当前设定作为算法的输入。替代地或附加地,也有可能提供与微加工装置的操作相关的测量作为所描述的一或多种算法的输入。测量示例可包含:温度;压力;湿度等等。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。