技术特征:

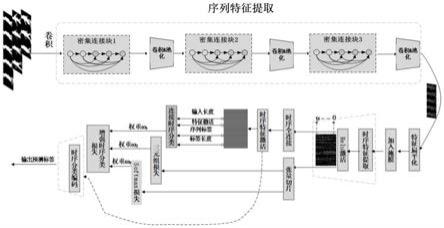

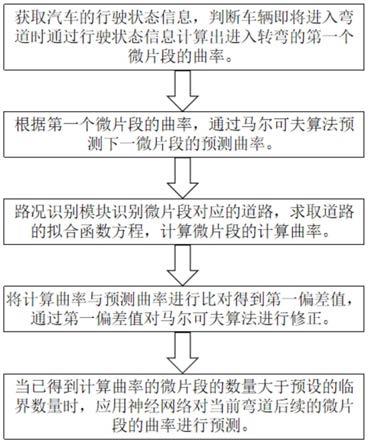

1.一种基于增强连接时序分类网络的步态识别方法,其特征在于包括:s1、将步态图片依据时序进行分组,并按组构建非完整周期的子步态能量图;s2、随机抽取预定长度的子步态能量图,依据时序先后构建具有相同序列标签的步态训练数据;通过深度卷积网络和具有时序特征的双向长短期记忆网络来提取步态的静态和动态时序特征,利用连接时序分类器在训练过程中自动对齐序列标签的优势,结合三元组损失,将样本分为正样本、负样本和自身样本,以提高分类器对细小差异的鉴别能力;s3、在仅对周期内固定行走条件的各类数据进行时序分类训练的前提下,针对周期内变化行走角度的曲线行走和合成的行走条件变化数据进行测试。2.根据权利要求1所述基于增强连接时序分类网络的步态识别方法,其特征在于,所述步骤s1中,将步态图片依据时序分成3~5帧/组。3.根据权利要求1所述基于增强连接时序分类网络的步态识别方法,其特征在于,所述步骤s2中,包括:(1)采用前馈的方式,利用深度卷积神经网络densenet的稠密连接机制,直接将所有层相连接,从而减少梯度消失,加强特征间的传递,同时减少相关参数和计算量;(2)利用长短期记功能的循环神经网络bi-lstm来提取步态时序特征;(3)利用深度卷积神经网络、循环神经网络和基于ctc的连接时序分类器,来构建端到端的增强连接时序分类网络模型en-ctcnet,以实现更加灵活的局部标签预测和步态识别;(4)构建增强连接时序分类网络en-ctcnet的多目标混合损失函数,包括ctc损失函数、triplet loss损失函数和softmax损失函数,利用triplet loss损失函数的优势扩大类间差异,缩小类内差异,提高识别效率。4.根据权利要求3所述基于增强连接时序分类网络的步态识别方法,其特征在于,所述步骤(1),具体为:1.1)令s为固定分布中的步态训练样本集;输入空间是所有i维向量的有限序列集合;目标空间(预测空间)表示为有限字符id条件下所有序列的集合,通常将元素称为标记或标记序列;每个步态训练样本都由一组序列(x,z)组成;目标序列z=(z1,z2,...,z

m

)小于或等于输入序列x=(x1,x2,...,x

t

),即m≤t;因为输入序列与目标序列通常具有不同的长度,输入序列可以是随机大小,而输出序列只能是一个或者几个id,所以没有先验的方法对输入序列和输出序列进行预对齐处理;利用步态样本集s来训练一个增强连接时序分类器,并能对任意长度的步态测试序列数据进行分类,输出最有可能的序列标签,即:1.2)利用densenet网络进行步态特征的降维和提取,其输出特征定义为1.3)使用长度为t的序列向量x=(x1,x2,...,x

t

),其中并将x作为bi-lstm网络的输入。5.根据权利要求3所述基于增强连接时序分类网络的步态识别方法,其特征在于,所述步骤(2),具体为:2.1)长短期记功能的循环神经网络是基于x

t

和h

t-1

来计算h

t

,只不过对内部的结构进行

了更加精心的涉及,加入了输入门i

t

、遗忘门f

t

以及输出门o

t

三个门和一个内部记忆单元c

t

;其中,输入门控制当前计算的新状态以多大程度更新到记忆单元中,遗忘门控制前一步记忆单元中的信息有多大程度被遗忘掉,输出门控制当前的输出有多大程度上取决于当前的记忆单元;2.2)在步态序列标记任务中,步态id的集合用a表示,在本发明提出的增强时序分类方法中,有softmax输出层单元|a|,表示为在时间节点t所观测到的相应标签概率;通过引入了一个额外的标签单元,名称为“边界间隔”,用表示;边界间隔用来观察和标记行条件的变化;带有的扩展步态id集合表示为在不同时间节点t,softmax输出层定义了所有id的概率,每一个时间节点取一个id并连接起来便构成了一条路径π;将这条路径所有时刻的id观察概率相乘得到路径总概率,它体现了输入序列到输出路径序列的概率;2.3)利用densenet网络输出特征定义为长度为t的序列向量x=(x1,x2,...,x

t

),其中并将x作为bi-lstm网络的输入;bi-lstm网络的输出与softmax层相连,连接权重定义为w

blstm

;bi-lstm网络输入与输出的关系为:即通过该子网络实现了序列空间的连续映射通过该映射将输入序列x映射到连续输出入序列x映射到连续输出定义为在时间t时观测到标签k的概率。6.根据权利要求3所述基于增强连接时序分类网络的步态识别方法,其特征在于,所述步骤(3),具体为:3.1)令a

′

t

为步态id集合上长度为t的序列集合;假设每次观察的条件概率都是输出独立的,可以通过输入序列x来获得集合中任何路径π的概率分布,输入序列x是原始步态序列图经过densenet步态空间特征提取网络和bi-lstm步态时序特征提取网络后输出的序列特征,其对应路径π的概率分布表示为:3.2)定义集合a

′

的一个id标签序列为l,因为集合a

′

可能有多个路径映射到同一序列,因此需要重新定义多对一的函数来重新映射路径集,并获得预测的id标签序列,即:f

m

:a

′

t

→

a≤t,其中a≤t表示可能的路径集,即在原始路径的基础上,预测的id序列的长度不大于输入序列的长度;定义映射函数f

m

的思想:从路径中删除所有重复的标签和区间边界例如:相当于网络从原始输入序列标签转换为预测标签,或者从预测到的标签转换为另一个新标签;与文本序列中有多个字母的情境不同,在步态识别中,步态序列通常具有相同的id,因此,如下的预测结果“id1id2id2id

2”就显得不那么合理了,因此引入投票策略来获得

最终预测结果,即:p

vote

(id1id2id2id2)=id2id2id2显然,基于ctc算法的识别方法不需要输入数据与预测标签之间的一一对齐,注意力更多的集中在整个序列的最终预测结果;最终将l∈a≤t标记为其对应的所有路径的概率之和,那么id标签序列的实际预测概率可以表示为:。7.根据权利要求3所述基于增强连接时序分类网络的步态识别方法,其特征在于,所述步骤(4),具体为:4.1)构建增强连接时序分类网络en-ctcnet的多目标混合损失函数,包括ctc损失函数、triplet loss损失函数以及softmax损失函数,根据id标签序列实际概率,定义ctc损失函数为:l

ctc

=-lnp(l|x)4.2)基于ctc的步态识别方法可以输出一个序列的id,该序列id非常适用于以随机步态帧作为输入来实现周期弱相关的步态识别,并且其还具有处理周期内步行条件变化的潜力;4.3)为了尽可能保留更多的步态识别信息,训练中对所有的样本,按照三元组进行分类,分为自身样本、正样本和负样本;其中,正样本与自身样本是属于同一类的样本,而负样本是与自身样本不在同一类的样本。定义基于三元组的能量损失函数:通过最小化三元组能量损失函数,完成对三元组分类器的学习,基于三元组的分类器,可以将同类样本差异极小化,不同类样本之间的差异最大化,很好地完成对测试样本的分类识别;同时,eh-ctcnet有效结合ctc损失函数、triplet loss损失函数以及softmax损失函数,总权重损失函数定义为:w

loss

=ω1l

ctc

ω2l

triples

ω3l

softmax

上式中ω1,ω2,ω3表权重值,满足ω1 ω2 ω3=1;通过控制ω1,ω2,ω3的大小,以提取到最适合网络训练的特征,实现不影响网络分类识别的同时,在一定程度上加快网络的收敛速度。8.根据权利要求1所述基于增强连接时序分类网络的步态识别方法,其特征在于,步骤s3中,利用ky4d和casia-b步态数据库的训练样本对基于增强连接时序分类网络模型进行训练,并对casia-b测试数据进行人为拼接测试。9.根据权利要求8所述基于增强连接时序分类网络的步态识别方法,其特征在于,所述步骤s3中,具体为:1)ky4d数据集包含42位具有3d视觉人体模型和2d步态图像序列的受试者;该步态数据

序列有16个摄像头进行捕获,图像分辨率为1032

×

776;每一个视角下都包含有4个正常行走序列{t1,t2,t3,t4}和2个曲线轨迹行走序列{t5,t6};casia-b数据集是一个多视图的步态数据集,主要考虑2个协变条件,即:服装变化和物体携带;该数据集包含有124名受试者的视频序列,对于每名受试者都有10个步态序列:6个正常行走条件序列(nm-01~nm-06)、2个携带背包序列,2个大衣序列,每个序列都有11个不同的视角,在0

°

~180

°

范围内,间隔为18

°

;每位受试者包含有11

×

(6 2 2)=110个序列;casia-b提供了背景减除法后的剪影基准图像,只需要通过对齐其质心来对齐这些轮廓,并将这些轮廓归一化处理为120

×

80;2)对于casia-b步态数据集验证所述的增强连接时序分类网络性能时,将正常行走背包、穿大衣协变条件下的数据各人为的选取1/2周期进行拼接测试。

技术总结

本发明公开了一种基于增强连接时序分类网络的步态识别方法,包括:S1、将步态图片依据时序进行分组,并按组构建非完整周期的子步态能量图;S2、随机抽取预定长度的子步态能量图,依据时序先后构建具有相同序列标签的步态训练数据;通过深度卷积网络和具有时序特征的双向长短期记忆网络来提取步态的静态和动态时序特征;S3、针对周期内变化行走角度的曲线行走和合成的行走条件变化数据进行测试。本发明综合了连接时序分类网络和三元组损失函数的优势,使得我们的步态识别方法对步态周期的依赖性降低,对协变条件具有更强的鲁棒性,能在步态周期不完整的条件下,并且面对步态行走条件实时变化的场景时,都能取得较好的识别效果。果。果。

技术研发人员:罗坚 代建华 江沸菠 黎梦霞 黄宇琛 阳强

受保护的技术使用者:湖南师范大学

技术研发日:2021.12.14

技术公布日:2022/3/3

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。