1.本发明属于图像处理与应用技术领域,具体涉及一种基于语义分割与超像素分割融合的农田作物识别方法。

背景技术:

2.现有主流的获取农情数据的途径是使用遥感卫星,利用遥感图像进行农情监测,具有范围广、高动态和速度快等特点。但是,耕地地形复杂多样、耕地分布零散、作物种类复杂等因素导致了卫星遥感图像无法提供十分精细化的农业图像,为了实现精准农业,需要更加精细化的农情数据作为卫星遥感图像的补充,以保证每一寸耕地都能被合理的利用。随着物联网、lbs、大数据等技术的快速发展,农情监测也早已进入大数据时代。普通用户也能够十分方便地使用手机、汽车、无人机等具有定位功能的终端设备帮助采集与上传农田图像及地理信息,这种获取信息的方式被称为自发地理信息(volunteered geographic information,简称vgi),通过这种方式获取的农情图像具有获取方便、数据量大、位置精确、分辨率高的优点,能够为基于卫星遥感图像的农情检测工作提供非常丰富的数据补充。

3.自发地理信息丰富了农情数据来源的同时也带来了一些难题,最主要的困难就是通过vgi方式获取的农情图像场景复杂、数据量巨大、图像质量参差不齐。若是仅借助人工的力量,要从如此繁多的农田场景图片中提取有效的农作物和耕地的信息,工作量太过庞大。因此,有必要借助计算机以及相应的图像识别算法对农田图像中的农作物进行自动化识别,提高农情信息的获取效率。

4.深度学习技术在基于rgb图像的农作物识别领域已经取得了一些研究进展,姜红花(参见姜红花,张传银,张昭,毛文华,王东,王东伟,基于mask r-cnn的玉米田间杂草检测方法[j].农业机械学报,2020,51(06):220-228 247)等人基于mask r-cnn目标检测网络实现了一种玉米田间杂草的检测方法,杂草识别率为91%。wu f等人通过vgi方式采集了大量的农田场景图片,收集整理成农田图像数据集,并训练了一个包含5种常见的神经网络分类模型的分类器,对农田图像中主要农作物的种类进行分类(参见wu f,wu b,zhang m,zeng h,tian f.identification of crop type in crowdsourced road view photos with deep convolutional neural network[j].sensors(basel,switzerland),2021,21(4))。yan等人利用谷歌街景图像数据,训练出能够识别苜蓿、杏仁、玉米、棉花、葡萄、大豆和开心果等作物类型的多层神经网络分类模型(参见yulin y,youngryel r.google street view and deep learning:a new ground truthing approach for crop mapping[j].arxiv preprint arxiv:1912.05024,2019)。ringland等人基于inception v3训练了一个多分类网络模型,实现了对路边多种农作物种类的分类,多分类器的平均准确率达到83.3%(参见ringland j,bohm m,baek s r.characterization of food cultivation along roadside transects with google street view imagery and deep learning[j].computers and electronics in agriculture,2019,158:36-50)。

[0005]

目前为止,国内外研究学者针对rgb图像的农作物识别提出了许多算法,但是仍然

存在着一些缺陷:(1)对农田图像中的农作物种类进行像素级标注的数据集极少,研究工作多为对农田图像中的农作物进行简单分类或是分割农田图像中单一种类农作物植株;(2)复杂农田场景下农作物种类识别准确率不够高;(3)现有的语义分割网络对于复杂边缘的物体分割效果不好。基于语义分割网络提供的像素级分类能力以及超像素分割对于物体边缘的精准分割能够在特定程度上克服这些缺点,但是目前对rgb农田图像使用融合语义分割与超像素分割进行像素级地块作物类型分类的方法在国内外未见相关研究。

技术实现要素:

[0006]

本发明的目的是提供一种基于语义分割与超像素分割融合的农田作物识别方法,旨在解决现有的基于深度学习农田场景图像农作物种类识别的算法种类识别准确率不高、边缘分割效果不好以及不适用于农作物种类复杂的场景的技术问题。

[0007]

实现本发明目的的具体技术方案是:

[0008]

一种基于语义分割与超像素分割融合的农田作物识别方法,该方法包括以下具体步骤:

[0009]

步骤一、图像预处理:对icrop农田图像数据集进行筛选,使用图像标注工具对筛选过后的农田图像中需要识别的农作物种类进行标注,并将数据集划分为训练集、验证集和测试集;

[0010]

步骤二、语义分割模型训练:利用步骤一标注好的训练集和验证集训练语义分割模型,使用准确率precision、召回率recall、平均交并比miou、系数f1-score和系数kappa数个评估指标作为依据,选择最优的语义分割模型参数;语义分割模型使用deeplabv3 作为基础框架,模型包括编码器与解码器;当把一张农田图像输入到语义分割模型后,先使用编码器对图像进行特征提取,编码器包括:

[0011]

(1)骨干网络aligned xception:骨干网络对输入图像进行多层卷积和下采样,得到若干层尺寸不同的图像特征;

[0012]

(2)纹理特征增强:纹理特征增强用于提取输入图像的纹理特征,并与骨干网络提取的图像特征相融合,得到纹理特征增强后的特征图;

[0013]

(3)多层注意力融合:利用骨干网络提取到的不同尺寸的特征图,提取农田图像的多层注意力特征;

[0014]

(4)空洞空间卷积池化金字塔aspp:利用不同采样率的空洞空间卷积,提取输入图像的上下文信息;

[0015]

编码器提取完图像特征之后,解码器会对编码器提取到的图像特征进行两次上采样解码,得到语义粗分割结果;

[0016]

步骤三、语义分割:使用步骤二训练好的语义分割模型对步骤一得到的测试集进行语义分割,得到语义粗分割结果;

[0017]

步骤四、超像素分割:使用slic超像素分割算法对步骤一得到的测试集进行超像素分割,得到超像素分割结果;

[0018]

步骤五、结果融合:使用threshold voting算法融合步骤三得到的语义粗分割结果与步骤四得到的超像素分割结果,最终得到农田图像语义细分割识别结果。

[0019]

步骤二中所述纹理特征增强,具体步骤如下:

[0020]

(1)使用卷积核尺寸kernel_size分别为7、11、15以及旋转角度θ分别为0,π/2,π,3π/2的12种gabor滤波器提取输入图像的纹理特征,得到12张尺寸为512

×

512的纹理特征图,将这12张纹理特征图拼接到一起,得到尺寸为12

×

512

×

512的纹理特征图;

[0021]

(2)将第(1)步得到的尺寸为12

×

512

×

512纹理特征图输入到可分离卷积层,可分离卷积层的输出维度为24,卷积核尺寸为3

×

3,再依次输入到激活层和最值池化层,得到尺寸为24

×

256

×

256特征图;

[0022]

(3)将第(2)步得到的特征图依次输入到维度为32,kernel_size为3

×

3的可分离卷积层,激活层以及最值池化层,得到尺寸为32

×

64

×

64特征图;

[0023]

(4)将第(3)步得到的特征图依次输入到维度为32,kernel_size为3

×

3的可分离卷积层,激活层以及最值池化层,得到32

×

33

×

33的纹理特征;

[0024]

(5)将骨干网络提取的输入图片的特征图与第(4)步得到的纹理特征进行特征融合,得到纹理特征增强后的特征图。

[0025]

步骤二中所述多层注意力融合,具体步骤如下:

[0026]

(1)将骨干网络中尺寸为64

×

257

×

257的特征图提取出来,分别输入到空间注意力机制和通道注意力机制中,将两种注意力机制结果相加,然后依次使用输出维度为64,kernel_size为3

×

3的可分离卷积层,输出维度为128,kernel_size为3

×

3的可分离卷积层,输出维度为256,kernel_size为3

×

3的可分离卷积层进行卷积,得到第一层注意力特征;

[0027]

(2)将骨干网络中尺寸为128

×

129

×

129的特征图提取出来,分别输入到空间注意力机制和通道注意力机制中,将两种注意力机制结果相加,然后依次使用输出维度为256,kernel_size为3

×

3的可分离卷积层,输出维度为256,kernel_size为3

×

3的可分离卷积层进行卷积,得到第二层注意力特征;

[0028]

(3)将骨干网络中尺寸为256

×

65

×

65的特征图提取出来,分别输入到空间注意力机制和通道注意力机制中,将两种注意力机制结果相加,然后使用输出维度为256,kernel_size为3

×

3的可分离卷积层进行卷积,得到第三层注意力特征;

[0029]

(4)将骨干网络中尺寸为728

×

33

×

33的特征图提取出来,分别输入到空间注意力机制和通道注意力机制中,将两种注意力机制结果相加,然后使用输出维度为256,kernel_size为1

×

1的可分离卷积层进行卷积,得到第四层注意力特征;

[0030]

(5)将四层注意力特征进行特征融合,然后使用输出维度为1024,kernel_size为1

×

1的可分离卷积层进行卷积,得到多层融合注意力特征。

[0031]

步骤五使用threshold voting算法进行结果融合,具体步骤如下:

[0032]

(1)根据步骤四得到的超像素分割结果遍历所有超像素,统计每一个超像素中对应位置中步骤三得到的语义粗分割结果,即统计每一个超像素中属于各个种类农作物类型的像素点的个数;

[0033]

(2)根据第(1)步的统计结果,计算每一个超像素中各个种类农作物像素点个数在超像素中所占的比例;

[0034]

(3)在遍历每一个超像素的同时,根据超像素中各类农作物像素点个数所占的比例,判断是否要对超像素对应位置的语义粗分割结果进行修改,若超像素中有某个种类农作物的像素点的比例超过阈值(threshold》0.5),则将超像素对应位置的语义粗分割结果

统一修改为该种类农作物;若超像素中没有农作物种类的像素点比例超过阈值,则保持超像素对应位置的语义粗分割结果;遍历完所有超像素之后,得到最终的语义细分割结果。

[0035]

本发明的有益效果:

[0036]

本发明在语义分割网络中引入纹理特征增强模块,加强了骨干网络中纹理特征所占的比例,解决了农田场景图像中农作物种类之间颜色特征接近而导致的分类不准确的问题。本发明考虑到农田图像中农作物地块分布较为零散而导致识别困难的问题,引入了多层注意力融合模块,加强全局范围内相同种类农作物地块之间的相互依赖性,以及同一位置不同特征通道维度之间的相互依赖性,进一步提高了农田图像的整体识别准确率。本发明使用了threshold voting算法融合了slic超像素分割与语义分割的结果,改善了语义分割网络因下采样而导致的地块边缘分割不准确的问题。

附图说明

[0037]

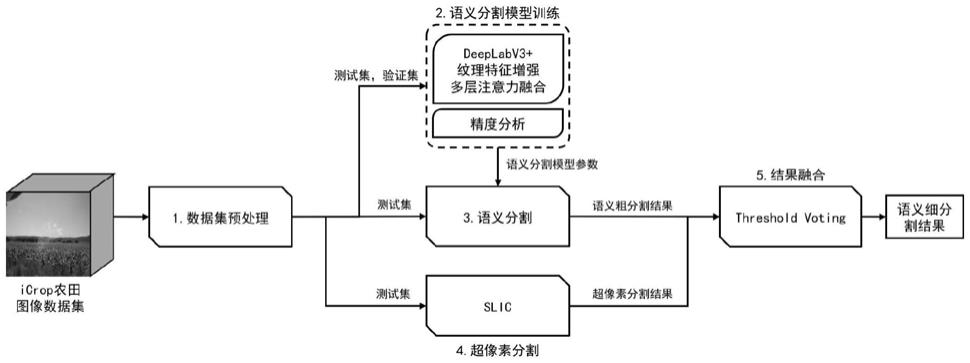

图1为本发明基于语义分割与超像素分割的农作物识别方法的流程图;

[0038]

图2为语义分割网络结构示意图;

[0039]

图3为纹理特征增强的结构示意图;

[0040]

图4为多层注意力融合的结构示意图;

[0041]

图5为本发明实施例1的农作物识别结果图。

具体实施方式

[0042]

为了使本发明的目的、技术特点及技术方案更加清晰明确,以下结合附图及实施例对本发明做详细说明。

[0043]

实施例1

[0044]

基于语义分割与超像素分割融合的rgb农田图像作物识别方法,以icrop农田图像数据集为例,实现流程如图1所示,具体实施步骤如下:

[0045]

步骤一、图像预处理:对icrop农田图像数据集进行筛选,去除重复、模糊、遮挡等不可使用的图片,将所有图像resize至512

×

512,使用图像标注工具labelme对筛选过后的农田图像中需要识别的五种农田作物种类(玉米、水稻、小麦、油菜花和裸地)进行标注,不需要识别的农作物种类统一标注为“其他”,将标注好的农田图像数据按照6∶2∶2的比例划分为训练集、验证集和测试集;

[0046]

步骤二、语义分割模型训练:使用步骤一得到的训练集和验证集对语义分割模型进行训练,并通过精度分析得到最优的语义分割模型参数;

[0047]

步骤三、语义分割:使用步骤二训练好的语义分割模型参数对步骤一得到的测试集进行语义粗分割,语义分割网络结构如图2所示,语义分割网络具体操作步骤如下:

[0048]

(1)将农田图像送入骨干网络进行图像特征的提取;

[0049]

(2)同时,输入图像也会被送入纹理特征增强模块,使用gabor滤波器获取农田图像多尺度纹理特征;

[0050]

(3)多层注意力融合模块从骨干网络获取4层不同尺度的特征图,得到多层注意力特征;

[0051]

(4)将第(3)步得到的4组注意力特征与第(1)步骨干网络提取的图像特征以及第

(2)步得到的多尺度纹理特征拼接到一起,进行特征融合;

[0052]

(5)将第(4)步得到的特征融合的结果输入到aspp中,获取多尺度感受野下的特征;

[0053]

(6)解码器从骨干网络中得到一组特定尺寸的特征图,并经过一层可分离卷积,同时将第(5)步输出的结果上采样至相同的尺寸,将二者进行特征融合,再经过可分离卷积层和4倍上采样,得到语义粗分割结果。

[0054]

纹理特征增强结构如图3所示,具体操作步骤如下:

[0055]

(1)使用卷积核尺寸kernel_size分别为7、11、15以及旋转角度θ分别为0,π/2,π,3π/2的12种gabor滤波器提取输入图像的纹理特征,得到12张尺寸为512

×

512的纹理特征图,将这12张纹理特征图拼接到一起,得到尺寸为12

×

512

×

512的纹理特征图;

[0056]

(2)将第(1)步得到的尺寸为12

×

512

×

512纹理特征图输入到可分离卷积层,可分离卷积层的输出维度为24,卷积核尺寸为3

×

3,再依次输入到激活层和最值池化层,得到尺寸为24

×

256

×

256特征图;

[0057]

(3)将第(2)步得到的特征图依次输入到维度为32,kernel_size为3

×

3的可分离卷积层,激活层以及最值池化层,得到尺寸为32

×

64

×

64特征图;

[0058]

(4)将第(3)步得到的特征图依次输入到维度为32,kernel_size为3

×

3的可分离卷积层,激活层以及最值池化层,得到32

×

33

×

33的纹理特征;

[0059]

(5)将骨干网络提取的输入图片的特征图与第(4)步得到的纹理特征进行特征融合,得到纹理特征增强后的特征图。

[0060]

多层注意力融合模块结构如图4所示,具体操作步骤如下:

[0061]

(1)将骨干网络中尺寸为64

×

257

×

257的特征图提取出来,分别输入到空间注意力机制和通道注意力机制中,将两种注意力机制结果相加,然后依次使用输出维度为64,kernel_size为3

×

3的可分离卷积层,输出维度为128,kernel_size为3

×

3的可分离卷积层,输出维度为256,kernel_size为3

×

3的可分离卷积层进行卷积,得到第一层注意力特征;

[0062]

(2)将骨干网络中尺寸为128

×

129

×

129的特征图提取出来,分别输入到空间注意力机制和通道注意力机制中,将两种注意力机制结果相加,然后依次使用输出维度为256,kernel_size为3

×

3的可分离卷积层,输出维度为256,kernel_size为3

×

3的可分离卷积层进行卷积,得到第二层注意力特征;

[0063]

(3)将骨干网络中尺寸为256

×

65

×

65的特征图提取出来,分别输入到空间注意力机制和通道注意力机制中,将两种注意力机制结果相加,然后使用输出维度为256,kernel_size为3

×

3的可分离卷积层进行卷积,得到第三层注意力特征;

[0064]

(4)将骨干网络中尺寸为728

×

33

×

33的特征图提取出来,分别输入到空间注意力机制和通道注意力机制中,将两种注意力机制结果相加,然后使用输出维度为256,kernel_size为1

×

1的可分离卷积层进行卷积,得到第四层注意力特征;

[0065]

(5)将四层注意力特征进行特征融合,然后使用输出维度为1024,kernel_size为1

×

1的可分离卷积层进行卷积,得到多层融合注意力特征。

[0066]

步骤四、超像素分割:使用slic超像素分割算法对待测试图片进行超像素分割,将尺寸大小为512

×

512的输入图像分割为1000个超像素;

[0067]

步骤五、结果融合:使用threshold voting算法融合步骤三得到的语义粗分割结果与步骤四得到的超像素分割结果,得到最终语义细分割结果,融合算法步骤如下:

[0068]

(1)根据步骤四得到的超像素分割结果遍历所有超像素,统计每一个超像素中对应位置中步骤三得到的语义粗分割结果,即统计每一个超像素中属于各个种类农作物类型的像素点的个数;

[0069]

(2)根据第(1)步的统计结果,计算每一个超像素中各个种类农作物像素点个数在超像素中所占的比例;

[0070]

(3)在遍历每一个超像素的同时,根据超像素中各类农作物像素点个数所占的比例,判断是否要对超像素对应位置的语义粗分割结果进行修改,若超像素中有某个种类农作物的像素点的比例超过阈值(threshold=0.7),则将超像素对应位置的语义粗分割结果统一修改为该种类农作物;若超像素中没有农作物种类的像素点比例超过阈值,则保持超像素对应位置的语义粗分割结果,不做修改。遍历完所有超像素之后,得到最终的语义细分割结果。

[0071]

利用上述方法,对语义分割网络模型进行训练,并对输入的测试集农田图像进行识别,得到如图5所示的识别结果,其中(a)为输入的待识别农田图像,(b)为农田作物种类的真实分布(gt),(c)为语义分割结果,(d)为融合了语义分割与超像素分割的最终识别结果,(b)、(c)、(d)中黑色表示背景,深灰色表示小麦,浅灰色表示其他无需识别的植物种类。

[0072]

本发明适用于rgb农田图像中各种类农作物的识别,依据上述的农作物识别流程,可以对农田图像中的农作物地块根据种类的不同进行比较精准的分割。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。