一种基于u型网络对医疗图像进行语义分割的方法

技术领域

1.本发明属于目标检测识别技术领域,特别涉及一种基于u型网络对医疗图像进行语义分割的方法。

背景技术:

2.医疗图像的语义分割识别是其图像处理上非常重要的一个环节,由于人体内部构造较为复杂,传统的机器视觉算法很难完整检出医疗图像特征,并且,仍然依赖丰富的经验与基础知识,且人工很难完全提取出数据中所包含的信息。同时,其复用性不大,导致浪费大量的人力成本。

3.深度学习的方法可以根据数据自动提取特征,免除了高昂的入门成本及人为因素的干扰。在图像处理、语音识别、医疗健康诊断等领域,机器学习和深度学习都已经在预测和聚类等方面取得了良好的结果。然而,在医疗图像的语义分割识别中,一方面要确保完整检出图像特征,另一方面还要具有较快的检测速度,现有的模型和算法尚无法有效兼顾这两方面的需求。

4.其中,u型网络以其素级识别的分割,在高像素、小缺陷的背景下具有应用前景。但是,目前的u型网络训练时间长,推理时间也较长,并且准确率较低,在进行完普通的语义分割后,还需要应用分类网络才能对图像进行识别。

技术实现要素:

5.为了克服上述现有技术的缺点,本发明的目的在于提供一种基于u型网络对医疗图像进行语义分割的方法,以期快速、准确地完成识别医疗图像中的目标检测识别。

6.为了实现上述目的,本发明采用的技术方案是:

7.一种基于u型网络对医疗图像进行语义分割的方法,包括以下步骤:

8.步骤1,获取样本集,并划分训练集和测试集;

9.所述样本集中,每张医疗图像及其自身掩图作为一组样本;

10.步骤2,构建识别模型,并利用所述训练集训练该识别模型,利用所述测试集测试训练效果,得到满足要求的优化模型;

11.所述识别模型基于改进的u型网络,所述改进的u型网络包括主干提取网络和特征加强网络;所述改进的u型网络,是在经典u型网络结构上,加入了二值化操作;

12.步骤3,将待识别的医疗图像输入所述优化模型,完成目标识别。

13.与现有技术相比,本发明的有益效果是:

14.在模型结构上借鉴了语义分割中的u型网络架构,有着很强的表达能力,可以看到非常长的历史和未来信息,相比普通的u型网络在鲁棒性和准确率上更出色。

15.本发明的优点在于可以准确快速的完成对医疗图像的语义分割,比传统的u型网络,速度更快,准确率更高,提高了医疗图像研究的效率。

附图说明

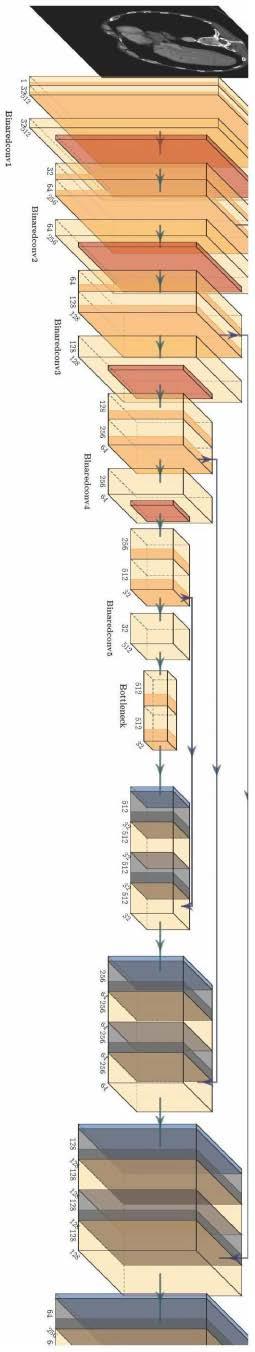

16.图1是本发明采用的网络结构。

17.图2是本发明所采用的图像示例图。

18.图3是本发明采用的掩图示例图。

19.图4是测试所用原图,所用原图的掩图,推理结果。

20.图5是本发明模型对测试集的结果。

21.图6是普通u型网络对测试集的结果。

具体实施方式

22.下面将结合实施例对本发明的实施方案进行详细描述,但是本领域的技术人员将会理解,下列实施例仅用于说明本发明,而不应视为限制本发明的范围。

23.如前所述,由于人体内部构造复杂,因此现有机器视觉算法很难完整地检出医疗图像特征,更难以提取出完整的信息,使得算法缺乏复用性和时效性。

24.为此,本发明提供了一种基于u型网络对医疗图像进行语义分割的方法,在经典u型网络结构的基础上加入了二值化操作作为语义分割网络,能够提取高级语义信息和浅层特征,且可以根据数据自动提取特征,预测时间短,准确率高,本发明将u型网络与医疗图像识别联系起来,提高了工作效率。

25.具体地,本发明对医疗图像进行语义分割的方法包括以下步骤:

26.步骤1,获取样本集,并划分训练集和测试集。

27.具体的,从现有的医疗图像数据库中获取医疗图像,将医疗图像及其自身掩图作为一组样本,将所有的样本组集合起来,作为样本集。

28.为便于训练模型,本发明还对样本进行了预处理,方法如下:

29.医疗图像的每个像素范围是[0-255],将每张医疗图像的每个像素值除以255,使其范围在[0-1]之间,并转换成tensor类型数据,再通过平均值和标准差标准化tensor图像,即,将医疗图像转换为标准的tensor图像。预处理的公式可表达为:

[0030]

output[channel]=(input[channel]-mean[channel])/std[channel]

[0031]

其中,channel代表通道数,一般图片是rgb(red green blue)图像,就是三个通道;output代表输出,input代表输入,mean代表均值,std代表标准差。

[0032]

得到的第一个(0.5,0.5,0.5)即三个通道的平均值,分别和tensor图像的三个通道对应,对每个通道做均值。

[0033]

得到的第二个(0.5,0.5,0.5)即三个通道的标准差,分别和tensor图像的三个通道对应,对每个通道做标准差。

[0034]

通过在每个通道上,将像素值除以255后的最大值和最小值,之后带入公式,从而使每个像素点的值除以255后的值映射到[-1,1]之间。

[0035]

通过预处理,使本发明对医疗图像的识别不仅仅停留在普通的框图,而是提升到像素集的识别,对医疗图像中的每个像素进行分类,更加准确。

[0036]

步骤2,构建识别模型,并利用训练集训练该识别模型,利用测试集测试训练效果,得到满足要求的优化模型。

[0037]

在本发明中,识别模型基于前述加入了二值化操作的改进的u型网络,参考图1,改

进的u型的网络结构主要包括两部分。第一部分为主干提取网络,第二部分为特征加强网络(上采样部分)。由于网络像u型,所以叫做u型网络。本发明识别模型中,在卷积之后和上采样过程中,加入了二值卷积(binarizeconv2d)操作,可加强特征的提取。

[0038]

其中,主干提取网络用于提取主干特征,利用主干提取网络获得若干有效特征层,并进行特征融合即得到主干特征,其依次包括:卷积层一、二值卷积层一、最大池化层一,卷积层二、二值卷积层二、最大池化层二,卷积层三、二值卷积层三、最大池化层三,卷积层四、二值卷积层四、最大池化层四、卷积层五、二值卷积层五、卷积层六,卷积层七、卷积层八、卷积层九、卷积层十和输出层sigmoid。也即,在本发明中,利用主干提取网络获得了五个有效特征层。

[0039]

特征加强网络用于提取加强特征,利用所述特征加强网络对所述若干有效特征层进行上采样,并进行特征融合,得到获得一个最终的,融合了所有特征的有效特征层,即加强特征。在本发明的实施例中,特征加强网络依次包括二值上采样层六、二值上采样层七、二值上采样层八和二值上采样层九。

[0040]

具体地,二值上采样层六和二值卷积层四的结果进行通道数堆叠;二值上采样层七和二值卷积层三的结果进行通道数堆叠;二值上采样层八和二值卷积层二的结果进行通道数堆叠;二值上采样层九和二值卷积层一的结果进行通道数堆叠。例如,在主干提取网络的二值卷积层结果是128*128*64,二值上采样的结果是128*128*64,其中64为通道数,通道数堆叠后为128*128*128,从而进行特征融合。

[0041]

各卷积层用于提取数据特征,每个卷积层包含两次卷积操作,卷积操作具体包括卷积(conv2d),归一化(bn)和非线性映射(采用激活函数relu),在一个卷积层中,两次卷积操作之间为串行关系,两次卷积操作的顺序为:conv relu bn conv relu bn,即,先进行完一次卷积操作,再做一次卷积操作。其中各卷积层的卷积核大小相同,kernel为3,padding为1。批量归一化单元用于加快网络预测模型的收敛速度,防止过拟合。relu激活函数用于完成数据的非线性变化,避免梯度爆炸和梯度消失。

[0042]

二值卷积层用于加强特征提取,使局部特征更加明显,每个二值卷积层包含一个二值卷积单元(binarizeconv2d),各二值卷积层的卷积核统一大小,kernel为3,stride为1,padding为1,本实施例的五个二值卷积层大小依次为:32*32*3*3、64*64*3*3、128*128*3*3、256*256*3*3、512*512*3*3。

[0043]

最大池化层采用kernel为2的最大池化(maxpool),将整个图像不重叠地分割成若干个同样大小的小块(pooling size),每个小块内只取最大的数字,再舍弃其他节点后,保持原有的平面结构得出output,主要功能是下采样(down-sampling)。

[0044]

每个二值上采样层包括上采样单元(upsample)、二值卷积(binarizeconv2d)单元,归一化单元(bn)和激活函数单元,激活函数单元采用hardtanh函数,是由于sign(x)函数的梯度,在二值当中几乎处处为0,不利于反向传播。

[0045]

示例地,本发明中,训练时,利用损失函数来衡量预测值与预期结果的匹配程度,并更新网络权重,得到优化模型;其中损失函数采用bcewithlogitsloss,bcewithlogitsloss损失函数更有利于二分类。更新网络权重采用adam算法。

[0046]

在训练时,将测试集数据输入训练完成的模型,评估其预测准确率和推理时间,得到预测掩图;其中单个测试数据的准确率有两个指标,为单个测试数据的交并比(iou)和单

个测数据的dice系数,测试集的准确率有三个指标,为整体测试集的miou、整体测试集的aver_hd和整体测试集的dv。

[0047]

其中,单个测试数据的交并比(iou),即原始测试数据的掩图a和模型推理出的掩图b之间的交并比,公式如下:

[0048][0049]

单个测数据的dice系数是一种集合相似度度量指标,通常用于计算两个样本的相似度,值阈为[0,1]。其用于图像分割时,分割的最好结果是1,最差结果为0,其方法是先获取两个图像的mask,mask中的前景用1表示,背景图像用0表示,将两个mask等成数组进行计算,公式如下:

[0050][0051]

pred为预测值,true为真实值;

[0052]

整体测试集的miou,是将每个图像的iou加起来求平均;

[0053]

整体测试集的aver_hd,是将每个图像和推理出的结果计算hausdorff距离,加起来再求平均。hd是豪斯多夫(hausdorff)距离,h(image_mask,predict)称为双向hausdorff距离,h(image_mask,predict)称为从点集image_mask到点集predict的单向hausdorff距离。相应地h(image_mask,predict)称为从点集predict到点集image_mask的单向hausdorff距离。双向hausdorff距离是单向hausdorff距离两者中的较大者,它度量了两个点集间的最大不匹配程度。

[0054]

整体测试集的dv,是将每个图像的dice加起来求平均。

[0055]

步骤3,将待识别的医疗图像做前述的预处理,之后输入步骤2得到的优化模型,完成目标识别。

[0056]

在本发明的一个具体实施例中,需要识别的医疗图像为肝脏超声图像,目的是识别出其中的肝脏信息,原始图像如图2所示,其中(a)和(b)为划分的训练集中原始的肝脏超声图像,图3是中(a)和(b)为相应的掩图,图4显示出了测试过程和结果,其中(a)和(b)分别示出了两个不同的输入,自左到右均分别包含了测试所用原图,利用本发明的模型推理结果以及原图的掩图,可以看出,利用本发明推理出来的结果和原图掩图重合度比较高。

[0057]

图5示出了本发明模型对测试集的测试结果,图6示出了普通u型网络对相同测试集的测试结果,其中测试集中包含了20个样本,图5和图6均分别示出了每个样本的iou、dice和time。可以明显看出,本发明的iou,dice,time的结果比普通u型网络的iou,dice,time更好,也即本发明推理的准确率和时间均明显优于现有的普通u型网络模型。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。