1.本发明属于语音处理的技术领域,尤其涉及一种基于注意力机制和卷积神经网络的单通道语音增强方法。

背景技术:

2.语音增强就是从带噪语音中还原纯净语音的一种技术,根据通道数量的不同分为单通道和多通道技术。根据处理的域不同又分为时域语音增强和频域语音增强。根据处理方法的不同还可以分为基于信号知识的语音增强方法和基于机器学习的语音增强方法。随着计算机技术的快速发展,深度学习方法对于解决各个领域中的问题均有较好的帮助,于是基于深度学习的语音增强方法正成为语音领域研究的热点。

3.传统的单通道语音增强方法研究中,通常需要对噪声信号和语音信号之间的作用关系做出一定的假设,正是由于其先决假设条件限制了系统的性能,适用性差、增强效果欠佳。基于深度学习的语音增强方法,不需要对语音信号和噪声信号做任何假设,通过大量训练数据,直接学习纯净语音和噪声之间的关系,克服了传统语音增强算法的固有缺陷,取得了更优异的去噪水平和泛化能力。

4.基于卷积神经网络的语音增强方法只能捕获语音的局部信息,无法高效利用语音的全局信息,这对语音增强是不利的。同时,基于注意力机制的神经网络虽然可以提取语音的上下文信息但无法较好的处理语音的局部信息。此外,大多数流行的语音增强方法是利用短时傅里叶变换将带噪语音转换到频域上进行处理,在频域上进行语音增强一般是忽略增强语音的相位信息,直接利用带噪语音的相位合成增强语音,相位信息的丢失也制约了增强语音的效果。

技术实现要素:

5.针对现有技术中的不足,本发明所要解决的技术问题在于提供一种基于注意力机制和卷积神经网络的单通道语音增强方法,直接在时域上对带噪语音进行增强,不但可以节省傅里叶变换的计算时间还可以尽可能的保留增强语音的相位信息,能取得较好的降噪效果。

6.为了解决上述技术问题,本发明通过以下技术方案来实现:

7.本发明提供一种基于注意力机制和卷积神经网络的单通道语音增强方法,包括训练阶段和增强阶段:

8.训练阶段:首先将噪声与纯净语音合成带噪语音,接着对带噪语音进行特征提取,然后将纯净语音与特征提取后的带噪语音一并送入神经网络模型中学习带噪语音和纯净语音之间的映射关系,训练阶段结束后,将训练好的模型保存下来;

9.增强阶段:首先对带噪语音进行特征提取,然后送入训练好的模型中进行语音增强,最后输出增强后的语音。

10.优选的,所述神经网络模型包括编码模块、降噪模块和解码模块,带噪语音首先经

过编码模块处理,然后送入降噪模块,接着编码模块的输出与降噪模块的输出相乘最后送入解码模块获得增强后的语音。

11.进一步的,所述编码模块的输出首先送入降噪模块中的注意力模块处理,然后再经过卷积模块处理后输出;在注意力模块中,语音特征经过层归一化、多头自注意力和dropout处理后和编码模块的输出逐点相加后输出;在卷积模块中,语音特征经过层归一化、逐点卷积、激活函数glu、深度卷积、批归一化、激活函数swish、逐点卷积和dropout处理后和注意力模块的输出逐点相加后输出。

12.进一步的,在解码模块中:首先,语音特征经过二维反卷积、批归一化和激活函数prelu处理后大小变为[b,128,k,s],接着语音特征经过重叠相加后大小变为[b,128,l],最后语音特征经过一维反卷积处理大小还原为[b,1,l]。

[0013]

由上,本发明的基于注意力机制和卷积神经网络的单通道语音增强方法至少具有如下有益效果:

[0014]

1、本发明基于深度学习的方法在时域对语音进行增强,节省了傅里叶变换的计算时间同时尽可能保留目标增强语音的相位信息。另外,本发明提出的注意力模块和卷积模块结合了注意力与卷积的优势,在突破了卷积神经网络不能并行计算的限制的同时,利用注意力机制赋予了其处理较长语音序列的能力,达到了可以对语音信息进行局部和全局建模的效果。

[0015]

2、本发明基于深度学习的方法,采用了基于注意力机制和卷积神经网络的框架从时域对带噪语音进行增强。在此过程中,利用网络结构直接学习带噪语音到纯净语音的映射关系。可以利用卷积神经网络和注意力机制充分提取带噪语音信号的局部信息和全局信息。与此同时,本发明直接在时域上对带噪语音进行增强,不但可以节省傅里叶变换的计算时间还可以尽可能的保留增强语音的相位信息,能取得较好的降噪效果。

[0016]

上述说明仅是本发明技术方案的概述,为了能够更清楚了解本发明的技术手段,而可依照说明书的内容予以实施,并且为了让本发明的上述和其他目的、特征和优点能够更明显易懂,以下结合优选实施例,并配合附图,详细说明如下。

附图说明

[0017]

为了更清楚地说明本发明实施例的技术方案,下面将对实施例的附图作简单地介绍。

[0018]

图1是本发明的语音增强方法的流程图;

[0019]

图2是本发明的神经网络模型图;

[0020]

图3是本发明的编码模块的结构图;

[0021]

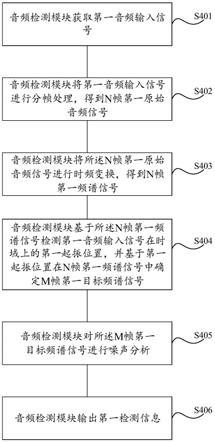

图4是本发明的分块的过程图;

[0022]

图5是本发明的注意力模块的结构图;

[0023]

图6是本发明的卷积模块的结构图;

[0024]

图7是本发明的解码模块的结构图。

具体实施方式

[0025]

下面结合附图详细说明本发明的具体实施方式,其作为本说明书的一部分,通过

实施例来说明本发明的原理,本发明的其他方面、特征及其优点通过该详细说明将会变得一目了然。在所参照的附图中,不同的图中相同或相似的部件使用相同的附图标号来表示。

[0026]

本发明旨在充分利用深度学习方法无需对噪声信号与语音信号做出任何假设的优势,在时域上直接对带噪语音进行增强。在节省傅里叶变换计算时间的同时,尽可能的保留增强语音的相位信息。并利用卷积神经网络和注意力机制更好的提取语音信号的局部和全局特征,致力于获取较好的降噪效果。本发明的方法具体的执行步骤如下:

[0027]

本发明的语音增强分两个阶段进行,包括训练阶段和增强阶段,如图1所示。

[0028]

训练阶段,首先将噪声与纯净语音合成带噪语音,接着对带噪语音进行特征提取,然后将纯净语音与特征提取后的带噪语音一并送入神经网络模型中学习带噪语音和纯净语音之间的映射关系。训练阶段结束后,将训练好的模型保存下来。

[0029]

增强阶段,首先对带噪语音进行特征提取,然后送入训练好的模型中进行语音增强,最后输出增强后的语音。

[0030]

本发明提出的神经网络模型如图2所示。本发明的模型由三部分构成,编码模块、解码模块和降噪模块。编解码的功能类似于傅里叶变换,都是将语音信号变换到高维空间便于降噪模块对其进行降噪处理。带噪语音首先经过编码模块处理,然后送入降噪模块,接着编码模块的输出与降噪模块的输出相乘最后送入解码模块获得增强后的语音。

[0031]

编码模块的内部构成如图3所示,将大小为[b,1,l]的带噪语音送入网络模型中。其中b代表batchsize,表示每次送入神经网络中需要训练的数据量,l表示语音信号的长度。首先经过一维卷积处理,大小变为[b,128,l];然后经过分块处理,大小变为[b,128,k,s]。最后经过二维卷积、批归一化和激活函数prelu处理,此时编码模块输出的大小为[b,256,k,s]。

[0032]

分块的过程如图4所示,首先,一维语音序列以帧长2d、帧移d的长度进行分帧处理。然后,每一帧语音数据都作为一个单独的数据块并将这些数据块堆叠在一起构成一个二维的数据矩阵。其中s表示长度为l的序列可分割块的数量,k表示帧长等于2d。

[0033]

编码模块的输出首先送入降噪模块中的注意力模块处理,然后再经过卷积模块处理后输出。在降噪模块处理过程中,语音特征的维度大小仍为[b,256,k,s]。注意力模块如图5所示,在注意力模块中,语音特征经过层归一化、多头自注意力和dropout处理后和编码模块的输出逐点相加后输出。

[0034]

卷积模块如图6所示,在卷积模块中,语音特征经过层归一化、逐点卷积、激活函数glu、深度卷积、批归一化、激活函数swish、逐点卷积和dropout处理后和注意力模块的输出逐点相加后输出。

[0035]

编码模块的输出和降噪模块的输出相乘后送入解码模块,大小为[b,256,k,s]。解码模块如图7所示,首先,语音特征经过二维反卷积、批归一化和激活函数prelu处理后大小变为[b,128,k,s],接着语音特征经过重叠相加后大小变为[b,128,l],最后语音特征经过一维反卷积处理大小还原为[b,1,l]。至此神经网络模型的处理过程结束,输出增强后的语音。

[0036]

其中,重叠相加是分块的逆过程。二维数据矩阵中相邻的两个数据块重叠的部分将会以求平均值的方式合并,将所有的块都合并后便将二维矩阵变换为一维的语音序列。

[0037]

选择voicebank和demand语音数据为例进行实验。我们选用的数据集由30个说话

人组成,其中28人用于训练,2人用于测试。训练数据由11572个带噪语音与纯净语音对组成,测试数据由824个语音对组成。

[0038]

本发明采用的损失函数结合了时域和频域两个方面。时频域的损失函数可以监督模型学习更多的信息,从而获得更高的语音清晰度和感知质量,其定义为:

[0039]

loss=α*lossf (1-α)loss

t

[0040][0041][0042]

其中,x和表示纯净语音和增强语音的频谱。r和i表示复值的实部和虚部。t表示帧数,f表示频点数,n表示采样数。α是一个可调参数,本发明中设置为0.2。

[0043]

为了验证本发明提出方法的有效性,将所提出的方法与其他语音增强方法进行对比。对比方法包括基于生成对抗网络的segan模型和基于u-net的wave-u-net模型。

[0044]

表1不同评价指标下本发明与不同算法对比

[0045]

评价指标\算法noisyseganwave-u-net本发明pesq1.972.162.402.42csig3.353.483.523.82ssnr1.687.739.9710.2

[0046]

从表中可以看出,本发明提出的方法在pesq、csig和ssnr指标上均高于对比算法,说明本发明提出的方法具有一定的优越性。

[0047]

本发明的基于深度学习的方法在时域对语音进行增强,节省了傅里叶变换的计算时间同时尽可能保留目标增强语音的相位信息。另外,本发明提出的注意力模块和卷积模块结合了注意力与卷积的优势:在突破了卷积神经网络不能并行计算的限制的同时,利用注意力机制赋予了其处理较长语音序列的能力,达到了可以对语音信息进行局部和全局建模的效果。

[0048]

经过实验验证,对比了本发明提出的方法与其他两种方法在pesq、csig和ssnr指标的数值。见表1,基于本发明的单通道语音增强算法取得了比其他两种算法更佳的降噪性能。说明本发明提出的方法具有一定的优越性。

[0049]

以上所述是本发明的优选实施方式而已,当然不能以此来限定本发明之权利范围,应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明原理的前提下,还可以做出若干改进和变动,这些改进和变动也视为本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。